Clear Sky Science · de

Einzelaufnahme Full-Stokes-Bildgebung durch streuende Medien

Klar sehen durch den Nebel

Ob es sich um ein autonomes Fahrzeug im starken Regen, eine Ärztin, die nach einem Tumor tief im Gewebe sucht, oder eine Wildkamera handelt, die durch Unterholz späht: Alle stehen vor demselben Problem: Licht wird beim Durchgang durch unordentliches, trübes Material durcheinandergeraten. Dieses Durcheinander verwandelt scharfe Bilder in körniges Speckle und verbirgt wichtige Details. Die Arbeit in diesem Paper zeigt einen neuen Weg, nicht nur die Helligkeit, sondern den vollständigen Polarisationszustand des Lichts wiederherzustellen — also Informationen darüber, wie die Lichtwellen schwingen — selbst wenn sehr starke Streuung vorliegt. Diese zusätzlichen Informationen können verborgene Objekte und subtile Unterschiede offenlegen, die gewöhnliche Kameras übersehen.

Warum herkömmliche Kameras im Blendlicht scheitern

Wenn Licht durch Nebel, Gewebe oder satiniertes Glas reist, wird es zufällig gestreut. Die einst glatte Wellenfront, die ein klares Bild trug, zerfällt zu einem lauten Specklemuster. Übliche Bildgebungsansätze können dieses Durcheinander manchmal rückgängig machen, aber nur bei schwacher Streuung. Sobald die Streuung stark wird, gehen die wenigen „ballistischen“ Photonen, die sich an ihre Herkunft erinnern, im Rauschen unter. Konventionelle Kameras zeichnen außerdem nur die Intensität auf — also wie hell das Licht an jedem Punkt ist — und verwerfen die Polarisation, die Auskunft darüber geben kann, wie Licht während seines Wegs mit Materialien interagiert hat. Deshalb wirken Szenen hinter dicken Streuschichten oft wie formloses Verschwimmen, egal wie ausgefeilt die Bildverarbeitungssoftware ist.

Die Form des Lichts als zusätzlicher Hinweis

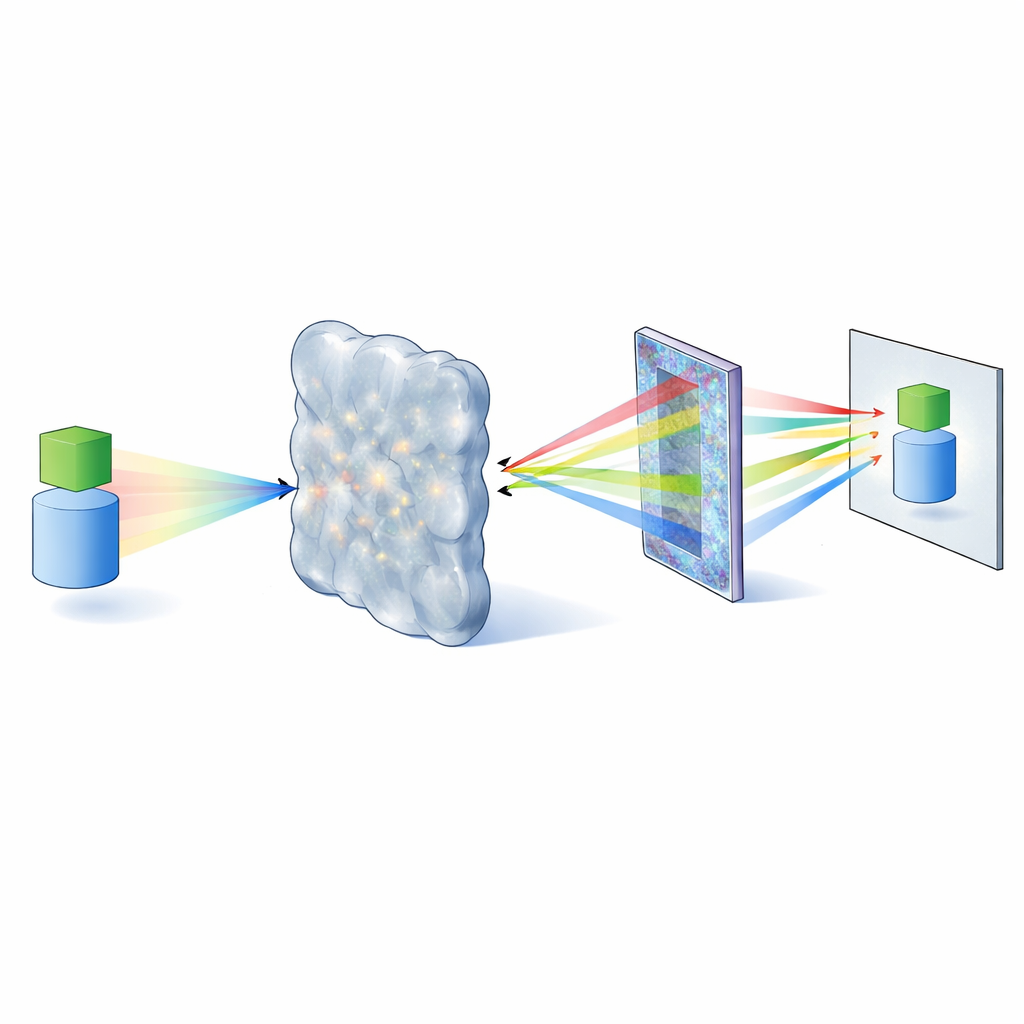

Lichtwellen können in verschiedenen Richtungen schwingen, und diese Polarisation trägt eine Art Fingerabdruck der Objekte und Materialien, die sie berührt haben. Die vollständige Beschreibung der Polarisation an jedem Punkt wird durch die sogenannten Stokes-Parameter erfasst, vier Zahlen, die zusammen Gesamthelligkeit sowie lineare und zirkulare Polarisation beschreiben. Jüngste Fortschritte bei flachen optischen Bauteilen, sogenannten Metaflächen — nanostrukturierte Filme, dünner als ein menschliches Haar — machen es möglich, alle vier Stokes-Parameter in einem einzigen Schnappschuss zu messen. Die Autoren entwickelten eine solche Metafläche, die einfallendes Licht in sechs Spots aufteilt, von denen jeder einem anderen Polarisationskanal entspricht. Aus einer einzelnen Aufnahme können sie das Full-Stokes-Polarisationbild mit hoher Präzision rekonstruieren, selbst für komplexe Muster und reale Proben wie Schmetterlingsflügel oder Brillengläser.

Ein neuronales Netz die Physik des Lichts lehren

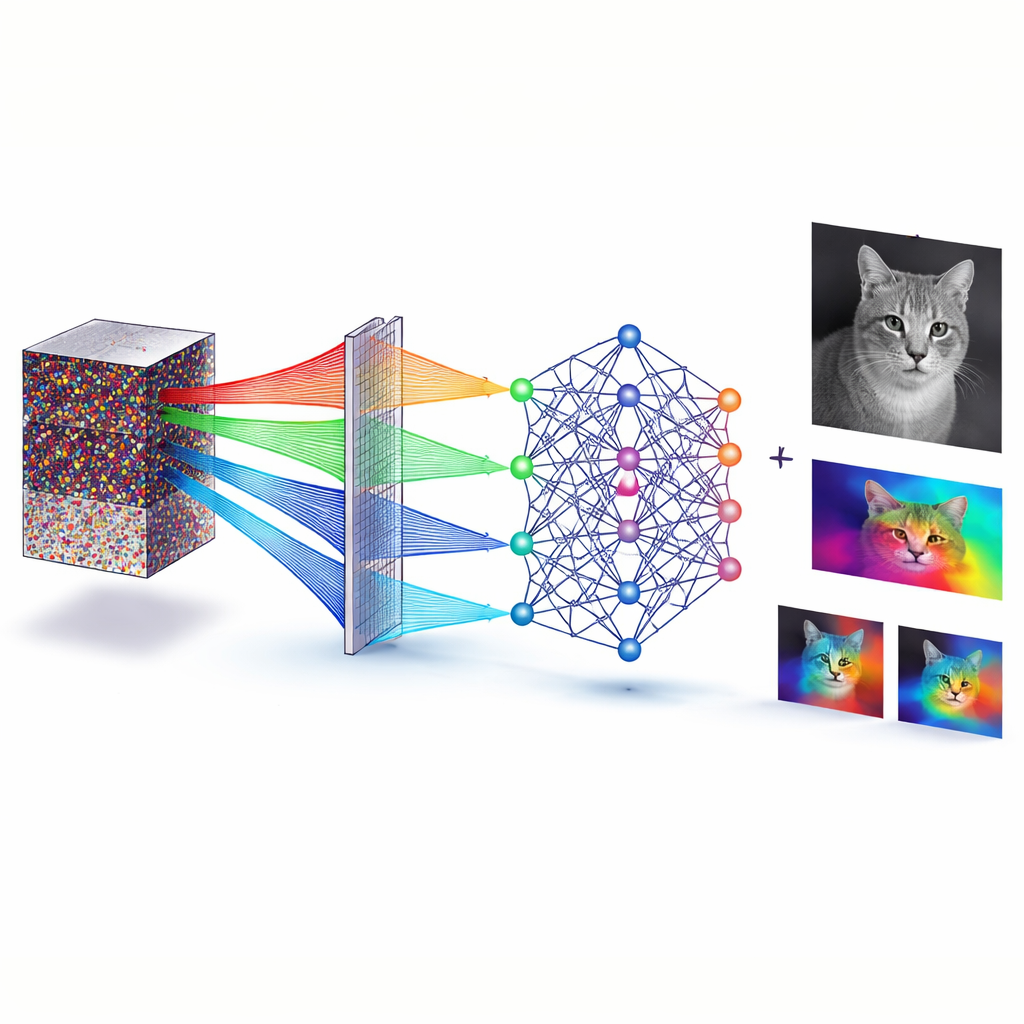

Das Erfassen vieler Polarisationskanäle ist nur die halbe Aufgabe; die andere Hälfte besteht darin, ein durcheinandergewürfeltes Specklemuster wieder in eine erkennbare Szene zu verwandeln. Dafür baute das Team ein spezialisiertes tiefes neuronales Netz namens PdU-Net, das die sechs polarisationsaufgelösten Specklebilder aufnimmt und die sauberen Full-Stokes-Bilder vorhersagt, die ohne die Streuschicht zu sehen gewesen wären. Statt sich nur auf Daten zu stützen, wird das Netz mit eingebauten physikalischen Regeln zur Polarisation trainiert. Diese Regeln fungieren als Leitplanken und zwingen die Ausgaben des Netzes, dieselben Beziehungen einzuhalten, die echte Stokes-Parameter erfüllen müssen. Indem diese Randbedingungen direkt in die Verlustfunktion eingebettet werden, lernt das Netz, sinnvolle Polarisationsstrukturen vom zufälligen Rauschen zu trennen und feine Details wiederherzustellen, die ein Standard-U-Net-Modell oder konventionelle Speckle-Korrelationsmethoden bei ähnlichen Streustärken nicht zurückgewinnen können.

Durch Tarnung und Bewegung hindurchsehen

Um ihren Ansatz unter harten Bedingungen zu testen, platzierten die Forschenden verschiedene Diffusoren zwischen Metafläche und Ziel und erreichten optische Tiefen, bei denen frühere Techniken völlig versagen. Selbst wenn die Erinnerung an die ursprüngliche Wellenfront nahezu ausgelöscht ist, konnte PdU-Net scharfe Bilder von Ziffern und Formen sowie deren vollständige Polarisationskarten aus einer einzigen Aufnahme rekonstruieren. Das Team erzeugte dann ein Tarnszenario: zwei dünne Polarisationsobjekte, die sich bewegten und ihre Form gegen einen unruhigen Hintergrund änderten, alles durch starke Streuung betrachtet. In konventionellen Intensitätsbildern verschmelzen die Objekte mit der Umgebung. Im Gegensatz dazu legen die rekonstruierten Karten von Polarisationswinkel und zirkularer Polarisation die Objekte klar frei und verfolgen sogar ihre Bewegung, weil ihre Polarisationssignaturen sich vom Hintergrund unterscheiden, selbst wenn ihre Helligkeit das nicht tut.

Was das für die Zukunft der Bildgebung bedeutet

Die Studie zeigt, dass wir durch das gemeinsame Entwerfen der Hardware, die Licht sammelt, und des neuronalen Netzes, das es interpretiert, durch stark streuende Medien sehen können auf eine Weise, die zuvor nicht möglich war. Die Metafläche sortiert Photonen kompakt und kameratauglich nach Polarisation, während das physik-informierte Netz diese zusätzlichen Hinweise nutzt, um schwere Verwürfelung rückgängig zu machen und das Full-Stokes-Polarisationbild in einer einzigen Aufnahme wiederherzustellen. Für Nicht-Fachleute ist die Kernaussage einfach: Anstatt nur die Helligkeit des Lichts zu messen, misst diese Methode auch dessen Orientierung und nutzt diese reichen Informationen, um den optischen Nebel zu durchdringen. Das könnte künftigen Systemen helfen, verborgene Tumoren zu entdecken, Tiere im dichten Laub zu verfolgen oder Fahrzeuge bei schlechtem Wetter zu navigieren — alles durch das Lesen subtiler Muster in der Form des Lichts selbst.

Zitation: Xiansong Ren, Ye Tian, Yanling Ren, Bo Wang, Shifeng Zhang, Anqi Hu, Kaveri A. Thakoor, and Xia Guo, "Single-shot full-Stokes imaging through scattering media," Optica 12, 1560-1568 (2025). https://doi.org/10.1364/OPTICA.572713

Schlüsselwörter: Polarisationsbildgebung, Metaflächen-Kamera, Bildgebung durch Streuung, physik-informiertes Deep Learning, Tarnkappenerkennung