Clear Sky Science · de

Thematische Analyse mit Open-Source-generativer KI und maschinellem Lernen: eine neue Methode zur induktiven Entwicklung von qualitativen Codebüchern

Warum das für Alltagsfragen wichtig ist

Immer wenn Menschen Umfragen ausfüllen oder Interviewfragen beantworten, hinterlassen sie reichhaltige Geschichten über Arbeit, Schule, Gesundheit oder das Gemeinschaftsleben. Einige Dutzend dieser Antworten zu lesen ist einfach; aus Tausenden Sinn zu machen ist es nicht. Dieser Artikel beschreibt eine neue Methode, mit der Forschende Open-Source-Künstliche Intelligenz nutzen können, um große Mengen schriftlicher Kommentare zu sichten und die Hauptideen herauszufiltern, während Menschen die Interpretation kontrollieren. Das Ziel ist, sorgfältige, nuancierte qualitative Forschung in Größenordnungen zu ermöglichen, die sonst meist der Big-Data-Statistik vorbehalten sind.

Eine intelligentere Art, Tausende von Kommentaren zu lesen

Die Autorinnen und Autoren konzentrieren sich auf einen in den Sozialwissenschaften verbreiteten Ansatz, die thematische Analyse, bei der Forschende Texte lesen und nach wiederkehrenden Mustern oder „Themen“ suchen, die ihre Forschungsfragen beantworten. Traditionell bedeutet das, jeden Kommentar langsam von Hand zu kodieren und ein Codebuch zu erstellen — eine strukturierte Liste von Themen und Unterthemen. Dieser Prozess funktioniert für einige Dutzend Interviews gut, wird jedoch überwältigend, wenn es zehntausende offene Antworten gibt. Der Artikel fragt: Können frei verfügbare generative Textmodelle und andere Open-Source-Werkzeuge bei den frühen, repetitiven Teilen dieser Arbeit helfen, ohne das menschliche Urteil zu ersetzen?

Vorstellung des GATOS-Workflows

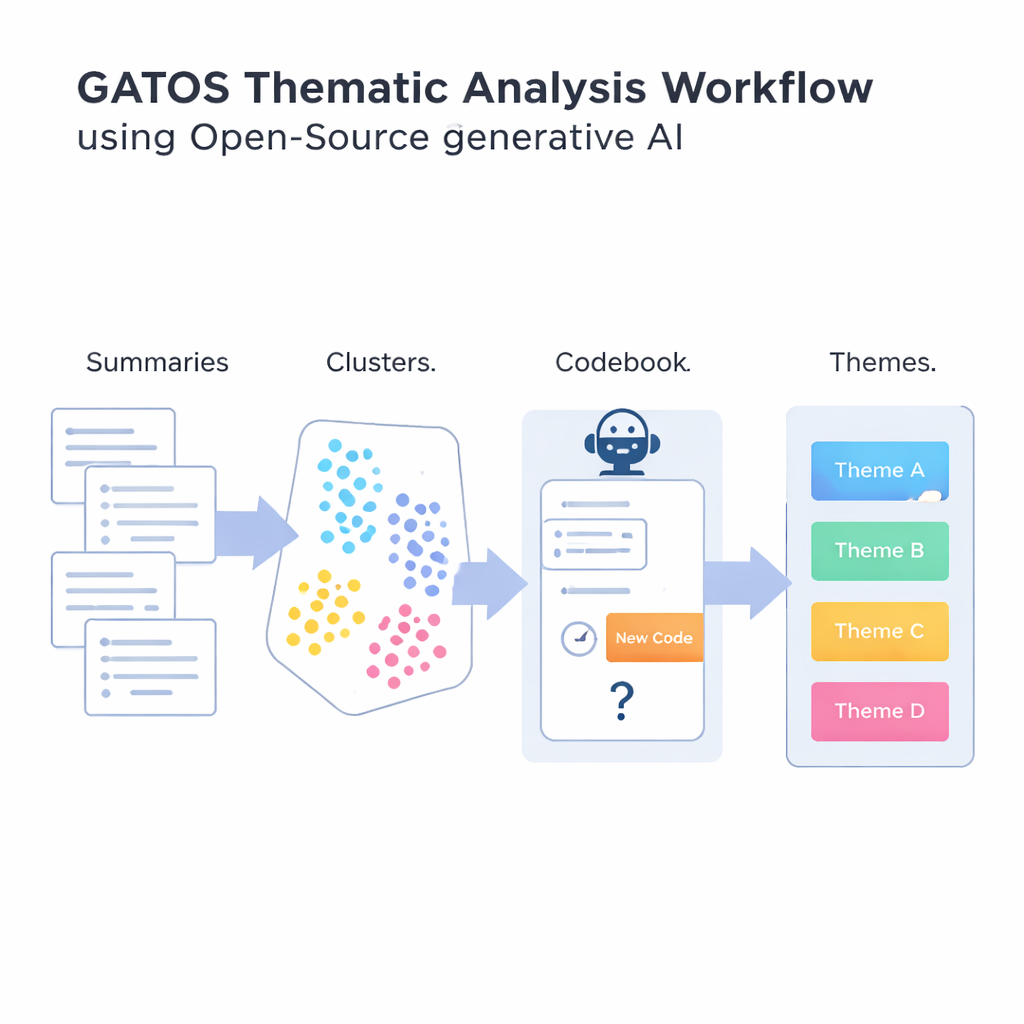

Um diese Frage zu beantworten, führen die Autorinnen und Autoren den Generative AI-enabled Theme Organization and Structuring-Workflow, kurz GATOS, ein. Dieser Workflow verknüpft mehrere Schritte. Zuerst liest ein Open-Source-Sprachmodell einzelne Antworten und verfasst kurze, fokussierte Zusammenfassungspunkte dessen, was jede Person sagt. Anschließend wandelt ein anderes Werkzeug diese Zusammenfassungen in numerische Repräsentationen um, sodass ein Computer ähnliche Ideen vergleichen und gruppieren kann. Diese Zusammenfassungen werden in Cluster geordnet, die wahrscheinlich gemeinsame Themen widerspiegeln, etwa Sorgen um die Vereinbarkeit von Beruf und Privatleben oder Frustrationen über unklare Kommunikation.

KI Vorschläge machen lassen, ohne eine Flut neuer Ideen zu erzeugen

Der innovativste Schritt kommt, wenn das System beginnt, einen Entwurf des Codebuchs zu erstellen. Für jedes Cluster verwandter Zusammenfassungen betrachtet ein weiteres generatives Modell die in diesem Cluster enthaltenen Ideen und die bereits im Codebuch vorhandenen Codes. Es wägt ab, ob ein tatsächlich neuer Code benötigt wird oder ob bestehende Codes ausreichen. Wenn ein neuer Winkel auftaucht — etwa „verlässliche Videokonferenz-Tools“ als spezifisches Anliegen — schlägt es ein kurzes Label und eine Definition vor, die hinzugefügt werden. Falls nicht, entscheidet es sich dafür, bereits vorhandene Codes wiederzuverwenden. Ein letzter Schritt gruppiert verwandte Codes zu breiteren Themen und schafft so eine strukturierte Karte von Rohkommentaren zu organisierten Einsichten. Dabei liegt der Schwerpunkt darauf, eine Flut nahezu doppelter Codes zu vermeiden und gleichzeitig subtile Unterschiede in den Erfahrungen der Menschen zu erfassen.

Test der Methode mit realistischer Schein-Daten

Weil reale Studien selten mit einem bekannten „Antwortschlüssel“ einhergehen, testete das Team GATOS mit synthetischen (computererzeugten) Daten, bei denen die verborgenen Themen im Vorhinein bekannt waren. Sie erstellten drei große, lebensechte Datensätze: Peer-Feedback zur Teamarbeit, Einschätzungen zur ethischen Kultur am Arbeitsplatz und Meinungen zur Rückkehr ins Büro nach der COVID-19-Pandemie. Für jeden Datensatz definierten sie zunächst acht Themen und mehrere Unterthemen und nutzten dann ein Sprachmodell, um Hunderte realistischer Antworten von verschiedenen Personas zu erzeugen, etwa Gewerkschaftsmitglieder, Führungskräfte oder Studierende. Nachdem sie GATOS auf diese Datensätze angewendet hatten, verglichen menschliche Gutachter die KI-generierten Themen mit den ursprünglichen, verborgenen Unterthemen, um zu sehen, wie gut sie übereinstimmten.

Wie gut funktionierte es und welche Kompromisse gibt es?

In allen drei Testfällen stellte der Workflow die Mehrheit der ursprünglichen Unterthemen recht genau wieder her: Die große Mehrheit hatte mindestens eine starke Entsprechung, und nur eine kleine Anzahl hatte kein gutes Gegenstück. Wichtig ist, dass das System, je mehr Daten es analysierte, immer weniger neue Codes vorschlug, was darauf hindeutet, dass es lernte, bestehende Ideen wiederzuverwenden statt endlose Variationen zu erfinden. Die Autorinnen und Autoren argumentieren, dass eine solche Open-Source-Lösung, die lokal ausführbar ist, Datenschutzbedenken mindern und es verschiedenen Forschungsteams erleichtern kann, die Arbeit voneinander zu reproduzieren. Gleichzeitig betonen sie, dass synthetische Daten einfacher sind als viele reale Situationen, dass der Workflow dennoch überlappende Codes erzeugen kann und dass menschliche Forschende weiterhin nötig sind, um das finale Codebuch zu verfeinern, zu interpretieren und zu bewerten.

Was das für Nicht-Expertinnen und Nicht-Experten bedeutet

Für Leserinnen und Leser außerhalb der Wissenschaft ist die Kernbotschaft, dass Open-Source-KI Sozialwissenschaftlerinnen und -wissenschaftlern und anderen Forschenden helfen kann, viel mehr Menschen zuzuhören, ohne ihre Worte auf rohe Zahlen zu reduzieren. Anstatt menschliche Analytiker zu ersetzen, fungiert der GATOS-Workflow wie ein sehr schneller, sehr organisierter Assistent, der Muster und Entwurfslabels vorschlägt und die Menschen darüber entscheiden lässt, was diese Muster wirklich bedeuten. Wenn weitere Studien diese Ergebnisse mit realen Daten bestätigen, könnten Werkzeuge wie GATOS es erleichtern, Arbeitsplatzrichtlinien, Bildungsprogramme und öffentliche Entscheidungen auf der vollen Tiefe dessen zu gründen, was Menschen tatsächlich sagen — und nicht nur auf Multiple-Choice-Antworten.

Zitation: Katz, A., Fleming, G.C. & Main, J.B. Thematic analysis with open-source generative AI and machine learning: a new method for inductive qualitative codebook development. Humanit Soc Sci Commun 13, 209 (2026). https://doi.org/10.1057/s41599-026-06508-5

Schlüsselwörter: qualitative Datenanalyse, thematische Analyse, generative KI, Open-Source-Sprachmodelle, Methoden der Sozialwissenschaften