Clear Sky Science · de

Chirurgischer RARP-Copilot: ein Vision-Language-Modell für robotisch-assistierte radikale Prostatektomie

Intelligentere Hilfe im Operationssaal

Moderne Prostatakrebsoperationen werden mit hochentwickelten Robotern und Kameras durchgeführt, dennoch müssen Chirurgen komplexe Entscheidungen treffen, sich wechselnde Sichtverhältnisse merken und ständig Fragen von Auszubildenden und Personal beantworten. Dieser Beitrag stellt einen künstlichen Intelligenz‑„Copiloten“ vor, der das Live‑Operationsvideo beobachtet und gesprochene Fragen sofort beantworten kann – ähnlich wie ein äußerst kundiger Assistent. Für Patientinnen und Patienten deutet das auf sicherere, konsistentere Eingriffe hin; für Chirurgen zeigt es eine Zukunft, in der Expertenrat und Lehrunterstützung in jedem Operationssaal verfügbar sind.

Ein digitaler Assistent, der sehen und sprechen kann

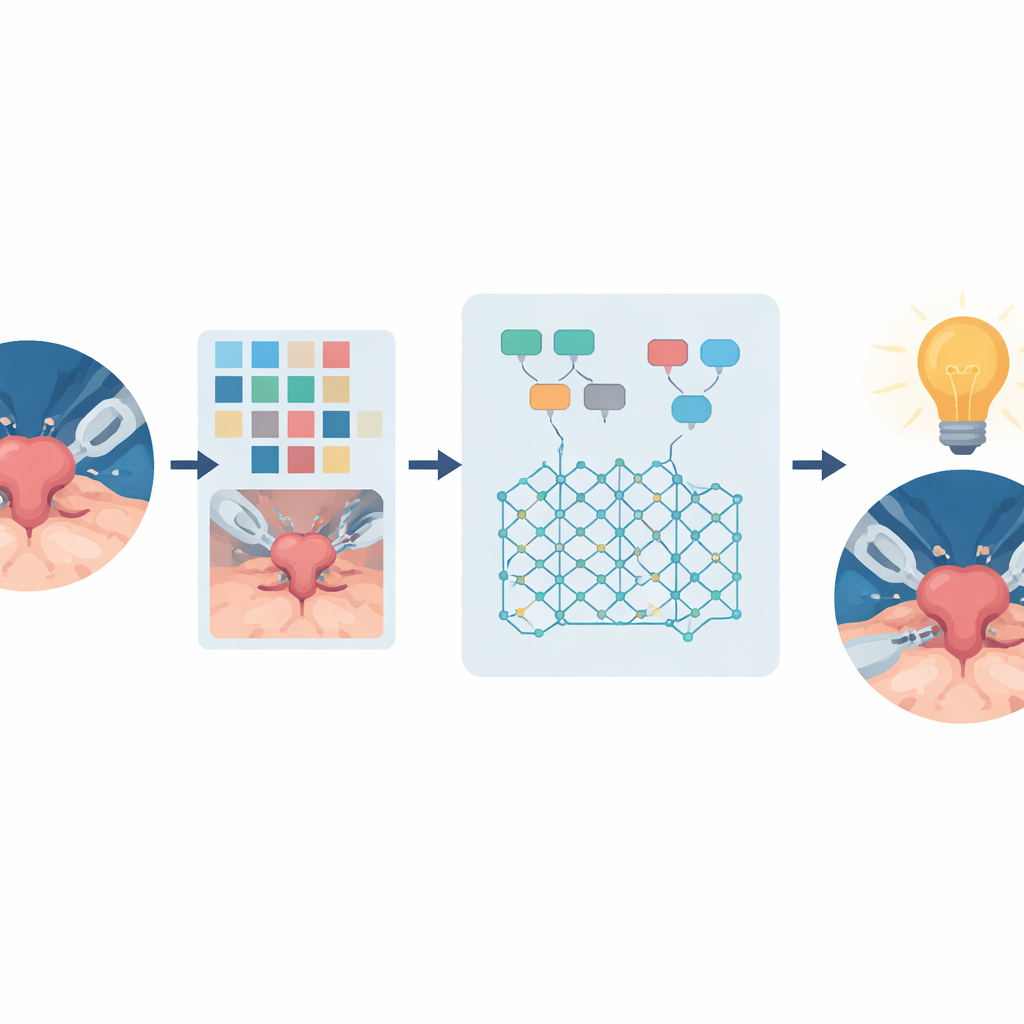

Die Forschenden entwickelten den Surgical RARP Copilot für eine spezifische Operation: die robotisch‑assistierte radikale Prostatektomie, das Standardverfahren für viele Männer mit lokalisiertem Prostatakrebs. Bei diesem Eingriff entfernt ein vom Chirurgen gesteuertes Robotersystem die Prostata durch kleine Schlüssellochinzisionen, gesteuert von einer hochauflösenden Kamera im Körperinneren. Traditionelle textbasierte KI‑Systeme verarbeiten nur Text und können daher nicht interpretieren, was die chirurgische Kamera zeigt. Der Copilot kombiniert stattdessen Computer Vision mit einem großen Sprachmodell, sodass er das Operationsfeld „sehen“ und in natürlicher Sprache erklären kann, was gerade passiert, welche Instrumente sichtbar sind oder welche nächsten Schritte im Eingriff sinnvoll wären.

Den Copiloten mit chirurgischem Wissen ausstatten

Um dem Copiloten sinnvolle chirurgische Expertise zu vermitteln, stellte das Team einen spezialisierten Trainingsdatensatz zusammen, statt sich auf allgemeine Internetbilder zu stützen. Sie sammelten fast 20.000 gelabelte Frames aus aufgezeichneten Prostataoperationen und markierten die Positionen von Instrumenten, Organen sowie den aktuellen Verfahrensschritt. Zusätzlich fügten sie grobe Tiefeninformationen hinzu, damit das System ableiten konnte, welche Objekte vor anderen liegen oder sich berühren. Mithilfe expertengestützter Regeln wurden diese Labels in detaillierte schriftliche Bildunterschriften umgewandelt, die beschreiben, was jedes Frame zeigt und an welcher Stelle des Eingriffs es aufgenommen wurde. Große Sprachmodelle wurden dann in verschiedenen „Personas“ – von erfahrenen Chirurgen bis zu neugierigen Kindern – dazu angeregt, auf Basis dieser Bildunterschriften über eine Million Frage‑Antwort‑Paare zu generieren. Ein separates Modell überprüfte diese Paare auf logische Konsistenz, und fehlerhafte Beispiele wurden vor dem Training herausgefiltert.

Wie gut der Copilot abschneidet

Nach dem Training wurde der Copilot auf verschiedene Weise getestet. Auf einer zurückgehaltenen Menge synthetischer Frage‑Antwort‑Paare erhöhte das Fine‑Tuning die Fähigkeit des Modells, zumindest teilweise korrekte Antworten zu geben, von etwa 61 % auf 83 %, und vollständig korrekte Antworten von 0 % auf 59 %. Anschließend stellten menschliche Gutachter 650 Fragen zu voraufgezeichneten Operationsbildern; fast sieben von zehn Antworten wurden als vollständig korrekt bewertet. Das System bewältigte außerdem klassische Computer‑Vision‑Aufgaben ohne zusätzliches Nachtraining: Es erkannte mit 82 % Genauigkeit, welcher Schritt der Prostatektomie auf einem einzelnen Videoframe gezeigt wurde, identifizierte chirurgische Instrumente mit einem F1‑Score von 94 % und schätzte gleichzeitig, wie viel Zeit im Eingriff noch verbleibt. Diese Ergebnisse deuten darauf hin, dass ein einzelnes, einheitliches Modell spezialisierte Werkzeuge in mehreren Aufgabenbereichen erreichen kann und zugleich offene, konversationelle Antworten liefert.

KI in einer Live‑Operation einsetzen

Die eindrücklichste Demonstration fand in einem realen Operationssaal statt. Der Copilot lief auf einem leistungsfähigen Edge‑Computer, der direkt mit dem Videoausgang des Roboters verbunden war. Während einer Live‑Prostatektomie, die auf einer anderen Roboterplattform als die Trainingsfälle durchgeführt wurde, stellten Chirurgen und Ingenieure im Publikum per Smartphone 276 Fragen. Nach dem Herausfiltern irrelevanter und doppelter Anfragen beurteilten Expertinnen und Experten, dass der Copilot etwa 77 % der verbleibenden Fragen korrekt beantwortete – vergleichbar mit seiner Offline‑Leistung. Das System begann seine Antwort in ungefähr einer halben Sekunde und erzeugte Texte schnell genug, um interaktiv zu wirken, wobei es Sicherheitsfilter anwendete und im Zweifel zurückhaltend reagierte.

Was das für die Chirurgie der Zukunft bedeutet

Für Nicht‑Fachleute ist die Kernbotschaft: Ein KI‑System kann nun eine komplexe Krebseingriff in Echtzeit beobachten und nützliche, kontextbewusste Antworten geben – darüber, was gerade passiert und was als Nächstes zu tun ist. Obwohl der aktuelle Copilot auf einen Operationstyp beschränkt ist, mit Momentaufnahmen statt vollständigem Videogedächtnis arbeitet und noch keinen Zugriff auf komplette medizinische Akten hat, zeigt er, dass multimodale KI sicher in den Operationssaal gebracht werden kann. Wenn ähnliche Systeme auf weitere Eingriffe ausgeweitet, mit umfangreicheren Patientendaten verknüpft und klinisch geprüft werden, könnten sie das Training unterstützen, die Teamkommunikation verbessern und letztlich dazu beitragen, komplexe Operationen sicherer und transparenter zu machen.

Zitation: Bogaert, W., Remy, F., Tejero, J.G. et al. Surgical RARP copilot: a vision language model for robot-assisted radical prostatectomy. npj Digit. Surg. 1, 3 (2026). https://doi.org/10.1038/s44484-025-00003-1

Schlüsselwörter: robotische Chirurgie, Prostatakrebs, chirurgische KI, Vision-Language-Modell, Unterstützung im Operationssaal