Clear Sky Science · de

Video-basierte Erkennung von Rinderverhalten für die Entwicklung digitaler Zwillinge in präzisen Milchviehsystemen

Warum es wichtig ist, Kühe zu beobachten

Auf modernen Milchviehbetrieben hängen Milchleistung, Gesundheit und Wohlbefinden direkt davon ab, was jede Kuh gerade tut – Fressen, Ruhen, Trinken oder Wiederkäuen. Landwirtinnen und Landwirte haben jedoch selten die Zeit, jede einzelne Kuh rund um die Uhr zu beobachten. Diese Studie zeigt, wie einfache Stallkameras in Kombination mit fortgeschrittener Computer‑Vision die täglichen Aktivitäten von Kühen automatisch verfolgen und diese Informationen in einen digitalen „virtuellen Zwilling“ der Herde einspeisen können. Solche Systeme könnten Bäuerinnen und Bauern helfen, Fütterung feiner abzustimmen, Krankheiten früher zu erkennen und Herden effizienter zu managen, ohne Geräte an den Tieren zu befestigen.

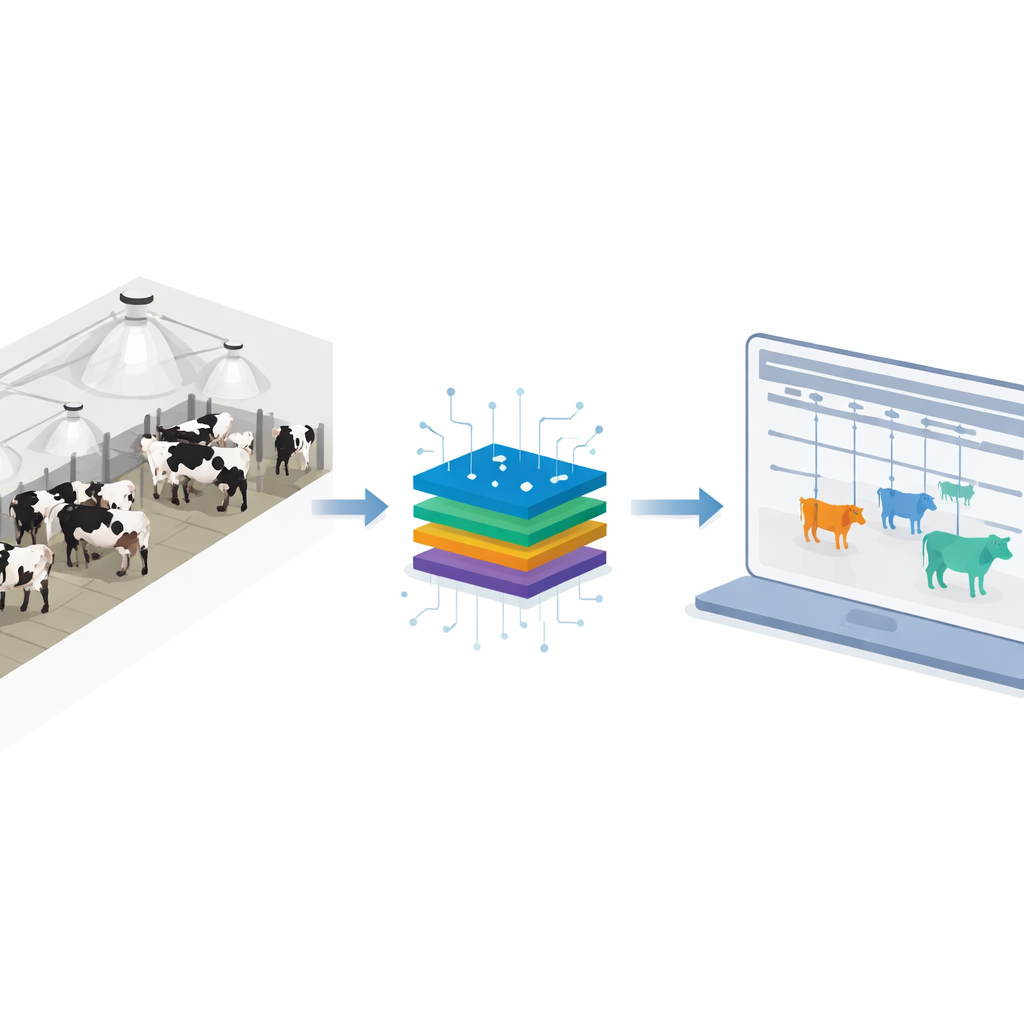

Vom realen Stall zur virtuellen Herde

Die Forschenden wollten die „Augen und Ohren“ für einen digitalen Zwilling im Milchviehbereich bauen – ein virtuelles Modell von Stall und Kühen, das sich nahezu in Echtzeit aktualisiert. Sie konzentrierten sich auf sieben alltägliche Aktivitäten, die für Gesundheit und Produktion am wichtigsten sind: Stehen, Liegen, Fressen im Stehen, Fressen im Liegen, Trinken sowie Wiederkäuen (Kauen) im Stehen oder Liegen. Anstatt auf tragbare Sensoren zu setzen, verwendeten sie Überkopf‑ und schräg angebrachte Sicherheitskameras in einem kommerziell anmutenden Anbinde‑Stall mit rund 80 Holsteinkühen. Kontinuierliche Videoaufnahmen wurden in kurze, 10‑sekündige Clips zentriert auf einzelne Kühe umgewandelt und bildeten das Rohmaterial, um Computern beizubringen, welche Aktivität jede Kuh gerade ausführt.

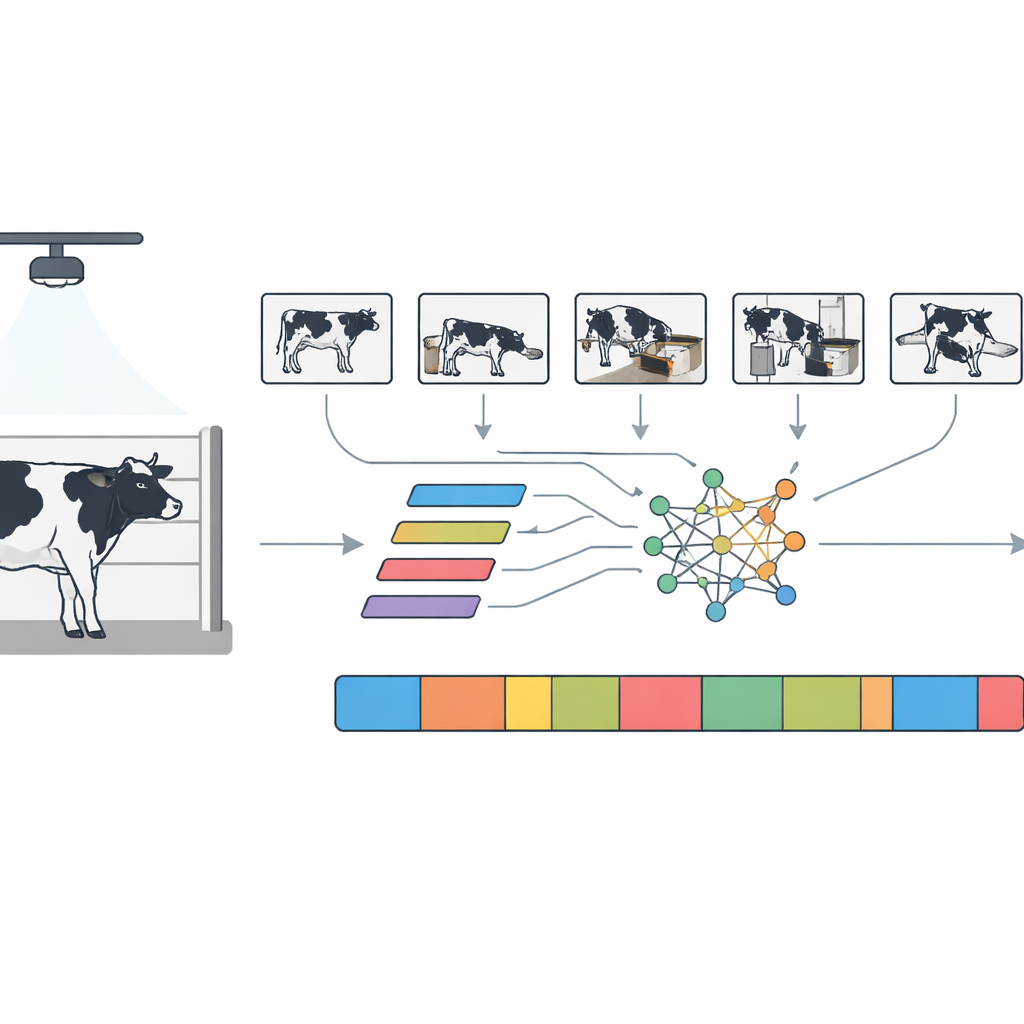

Computern beibringen, Kuhverhalten zu erkennen

Die Umwandlung von Rohmaterial in verwertbare Daten erforderte mehrere Schritte. Zuerst fand ein Objekterkennungssystem automatisch Kühe in jedem Frame, und ein Tracking‑Algorithmus hielt die Identität jeder Kuh konsistent, während sie sich bewegte, auch wenn sie teilweise verdeckt war. Das Programm schnitt dann jede Kuh heraus und skalierte sie zu standardisierten Videoclips. Menschliche Expertinnen und Experten etikettierten fast 5.000 dieser Clips mit dem korrekten Verhalten, wandten klare visuelle Regeln an und überprüften die Kennzeichnungen gegenseitig, um Konsistenz sicherzustellen. Da Kühe von Natur aus mehr Zeit mit Liegen und Stehen als mit Trinken oder Wiederkäuen verbringen, erweiterte das Team die selteneren Verhaltensweisen gezielt durch digitale „Augmentation“ – subtile Spiegelungen, Ausschnitte, Helligkeitsänderungen und zeitliche Anpassungen – um ein ausgewogeneres Trainingsset von etwa 9.600 Clips zu erzeugen.

Wie das System Muster über die Zeit erkennt

Um Verhaltensweisen zu erkennen, verglich das Team zwei führende Familien von Videoanalysemodellen. Das eine, SlowFast genannt, ahmt zwei Betrachtungsgeschwindigkeiten gleichzeitig nach: einen "langsamen" Pfad, der Haltung über längere Zeiträume erfasst, und einen "schnellen" Pfad, der sich auf schnelle Kopfbewegungen konzentriert. Das andere Modell, TimeSformer, verwendet Aufmerksamkeitsmechanismen, die ursprünglich für Sprachmodelle entwickelt wurden, um über Raum und Zeit hinweg zu schauen und zu entscheiden, welche Bildbereiche und welche Zeitpunkte in einem Clip am wichtigsten sind. Beim Training mit den Stallvideos schnitt TimeSformer leicht besser ab als SlowFast, klassifizierte Verhaltensweisen in etwa 85 % der Fälle korrekt und war dabei schnell genug für die Echtzeitnutzung auf einer modernen Grafikkarte. Visualisierungen zeigten, dass das Modell bei Futteraufnahme und Trinken natürlicherweise Kopf und Maul fokussierte und bei Liegen oder Stehen Rumpf und Beine – entsprechend dem Blick eines menschlichen Beobachters.

Von Verhaltensströmen zu betrieblichen Entscheidungen

Sobald das System Verhaltensclips zuverlässig erkannte, bauten die Forschenden eine vollständige Pipeline, die kontinuierlich Stallvideo auswertet. Das Programm verfolgt jede Kuh über die Zeit, wendet ein gleitendes Fenster auf die Videos an und glättet kurzzeitige Fehler, sodass kleine Aussetzer nicht als schnelle Zustandswechsel erscheinen. Das Ergebnis ist eine saubere Zeitlinie für jedes Tier: wann es fraß, lag, stand, trank oder wiederkäute, wie lange jede Phase dauerte und wie sicher das System war. Diese strukturierten Protokolle können direkt von Fütterungsmodellen genutzt werden, die aus Fresszeiten die Futteraufnahme schätzen, und sie können einen 3D‑digitalen Zwilling in einer spielähnlichen Umgebung antreiben, in der virtuelle Kühe das Verhalten ihrer realen Gegenstücke spiegeln. In einer 24‑stündigen Fallstudie einer Kuh rekonstruierte das System ihren Tagesablauf vollständig und schätzte anhand der Fressdauer plus grundlegender Tierdaten, wie viel Trockensubstanz sie wahrscheinlich aufgenommen hatte.

Was das für zukünftige Milchbetriebe bedeutet

Die Studie zeigt, dass preiswerte Kameras und sorgfältig entwickelte Videomodelle kontinuierliche, pro Kuh genaue Verhaltensaufzeichnungen liefern können, die als sensorische Grundlage eines digitalen Zwillings im Milchbetrieb dienen. Zwar automatisiert die Arbeit noch nicht die Entscheidungen – etwa Futterrationen zu ändern oder Personal bei Krankheit zu alarmieren –, sie liefert jedoch den entscheidenden Eingabestrom, auf dem solche höherwertigen Werkzeuge aufbauen. Wird der Ansatz auf offenere Stallkonzepte ausgeweitet und mit weiteren Sensoren kombiniert, könnten Landwirtinnen und Landwirte eine detaillierte, ständig verfügbare Sicht auf die Tagesrhythmen ihrer Tiere gewinnen und damit ein sanfteres, präziseres Management ermöglichen, das sowohl den Kühen als auch der Umwelt zugutekommt.

Zitation: Rao, S., Garcia, E. & Neethirajan, S. Video-based cattle behaviour detection for digital twin development in precision dairy systems. npj Vet. Sci. 1, 3 (2026). https://doi.org/10.1038/s44433-026-00004-x

Schlüsselwörter: Precision Livestock Farming, Computer Vision, Verhalten von Milchrindern, Digitaler Zwilling, Überwachung des Tierwohls