Clear Sky Science · de

Erkennung stigmatisierender Sprache in klinischen Notizen mit großen Sprachmodellen für die Suchtversorgung

Warum die Worte in Ihrer Krankenakte wichtig sind

Da immer mehr Patienten online Zugriff auf ihre Krankenakten erhalten, sind die Formulierungen, die Kliniker verwenden, nicht länger in Krankenhausrechnern verborgen — sie sind für diejenigen sichtbar, die beschrieben werden. Für Menschen mit Suchtproblemen kann bereits eine einzelne Formulierung wie „Drogenmissbraucher“ stillschweigend Scham verstärken, Vertrauen untergraben und sogar die Behandlung beeinflussen, die sie erhalten. Diese Studie stellt eine aktuelle Frage: Kann moderne künstliche Intelligenz Krankenhäusern dabei helfen, stigmatisierende Sprache in klinischen Notizen zu erkennen und zu reduzieren, bevor sie Patienten schadet?

Schädliche Etiketten, verborgen in Alltagsnotizen

Stigma im Gesundheitswesen zeigt sich nicht nur in Blickkontakt oder Tonfall; es ist auch in der schriftlichen Dokumentation verankert. Elektronische Gesundheitsakten enthalten Millionen von Notizen, die Patienten über Kliniken und Krankenhäuser hinweg begleiten. Begriffe wie „Alkoholmissbrauch“ oder „drogensuchendes Verhalten“ können beeinflussen, wie zukünftige Kliniker eine Person sehen — lange nach einem Notfallbesuch oder Krankenhausaufenthalt. Die Forschenden konzentrierten sich auf Intensivstationsnotizen von Patient:innen mit Substanzgebrauchsproblemen, wo die Einsätze hoch und die Dokumentation umfangreich ist. Sie orientierten sich an nationalen Leitlinien, die respektvolle, personenorientierte Sprache fördern, wie „Person mit einer Substanzgebrauchsstörung“ statt „Süchtiger“, und nutzten diese Vorgaben, um einen großen Datensatz mit Notizen zu erstellen, die als stigmatisierend oder nicht stigmatisierend gekennzeichnet wurden.

Dem KI beibringen, zwischen den Zeilen zu lesen

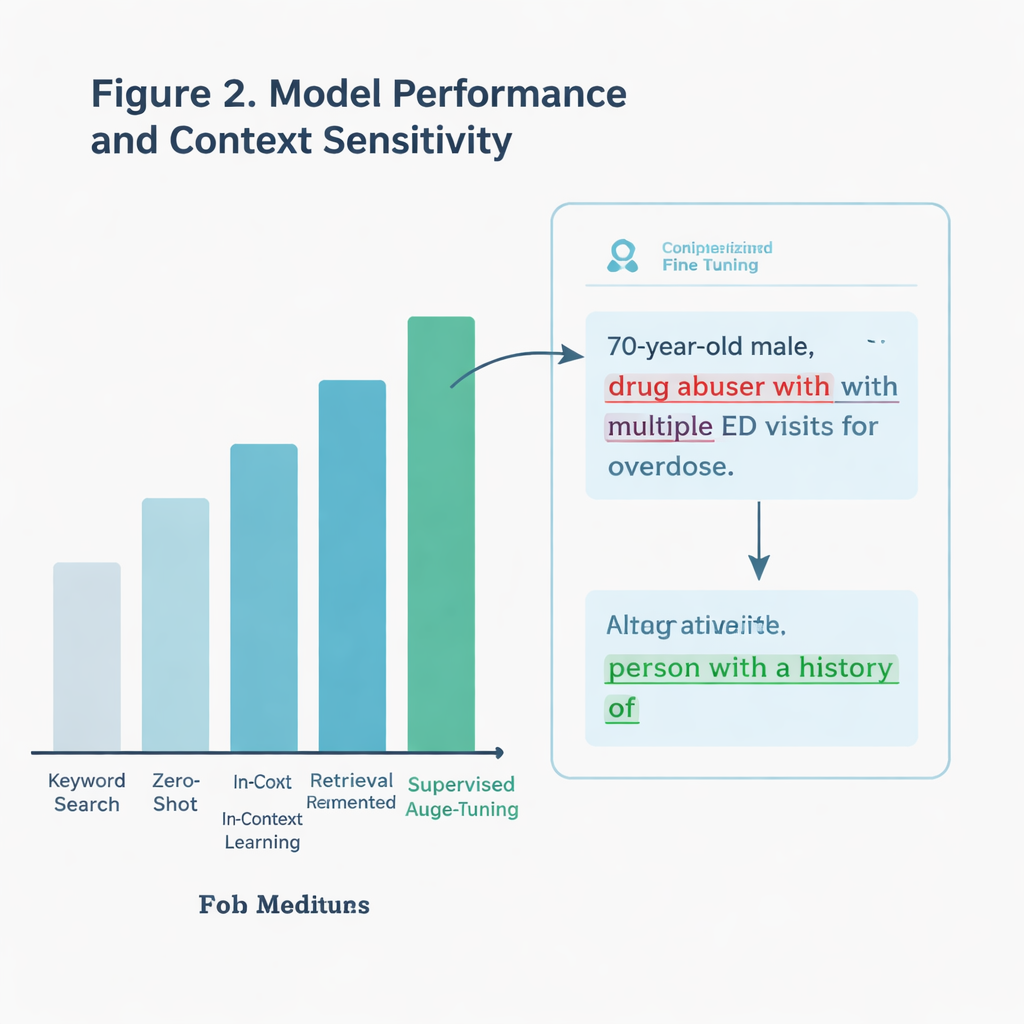

Statt nur nach schlechten Wörtern zu suchen, wollte das Team ein KI-System, das Kontext verstehen kann. Zum Beispiel könnte eine Notiz eine wörtliche Aussage eines Patienten wiedergeben, der sich selbst als „betrunken“ beschreibt — das ist nicht dasselbe wie die Anwendung dieses Etiketts durch einen Kliniker. Die Autor:innen verglichen mehrere Ansätze, die alle auf einem großen Sprachmodell basierten (eine Art KI, die Text verarbeitet und erzeugt). Eine einfache Methode suchte nur nach bestimmten Schlüsselwörtern aus den Leitlinien. Fortgeschrittenere Methoden forderten die KI auf, jede Notiz direkt zu beurteilen, entweder ohne zusätzliche Beispiele, mit ergänzender Anleitung aus Kommunikationsrichtlinien oder nachdem sie speziell auf Tausenden gekennzeichneter Intensivstationsnotizen trainiert — also „feinabgestimmt“ — worden war.

Was in der Praxis am besten funktionierte

Das feinabgestimmte Modell war der klare Sieger. In einem zurückbehaltenen Testsatz von mehr als 11.000 Notizen erkannte es stigmatisierende Sprache in etwa 97 Prozent der Fälle korrekt, deutlich besser als eine einfache Schlüsselwortsuche. Es hielt sich auch besser bei einer besonders kniffligen Untergruppe von Notizen, die potenziell aufgeladene Begriffe enthielten, die aber nicht immer schädlich verwendet wurden. Das Modell konnte zwischen tatsächlich wertenden Formulierungen und neutralen oder zitierten Verwendungen unterscheiden, wo eine gröbere Suche scheitern würde. Als das Team das System auf Notizen eines anderen Gesundheitssystems testete — fast 300.000 Intensivstationsnotizen aus einem anderen Bundesstaat — übertraf es ebenfalls die Schlüsselwortmethode, obwohl stigmatisierende Sprache in dieser realen Stichprobe selten war.

Neue problematische Formulierungen finden, die Kliniker übersehen haben

Die Forschenden gingen einen Schritt weiter und baten die KI, zu erklären, warum sie bestimmte Notizen markiert hatte. Ein Suchtfacharzt überprüfte dann diese Erklärungen. In Dutzenden von Fällen hoben die Modelle tatsächlich stigmatisierende Formulierungen hervor, die menschliche Annotator:innen ursprünglich übersehen hatten, einschließlich Phrasen, die in den bestehenden Leitlinien nicht aufgeführt waren. Beispiele waren Beschreibungen wie „drogensuchendes Verhalten“ oder beiläufige Erwähnungen von „alkoholischer Zirrhose“, die subtil der Person statt der Krankheit die Schuld zuschreiben. Das deutet darauf hin, dass gut gestaltete KI-Tools nicht nur aktuelle Best Practices durchsetzen, sondern auch helfen könnten, unser Verständnis dafür zu erweitern, wie schädliche Sprache aussieht, während sich das klinische Schreiben weiterentwickelt.

Vom Forschungstool zur Hilfe am Krankenbett

Die Studie betrachtete auch praktische Aspekte. Schlüsselwortsuche ist blitzschnell, aber oberflächlich. Das genaueste KI-Modell erforderte mehrere Stunden Training auf leistungsfähigen Grafikprozessoren, konnte danach aber Notizen in wenigen Sekunden filtern — langsam für eine Suchmaschine, aber akzeptabel für einen Hintergrundassistenten in einem Krankenhaus. Ein anderer, weniger maßgeschneiderter Ansatz, der nur auf sorgfältig formulierte Eingabeaufforderungen setzte, lieferte ohne zusätzliches Training eine annehmbare Leistung und deutet auf leichtergewichtige Optionen für Kliniken mit weniger technischen Ressourcen hin. Zusammen deuten diese Befunde auf Systeme hin, die risikobehaftete Formulierungen in Echtzeit markieren und respektvollere Alternativen vorschlagen können, während Kliniker:innen schreiben.

Ein Schritt zu respektvollerer Versorgung

Für Laien ist die wichtigste Botschaft einfach: Die Worte in Ihrer Akte sind nicht nur Fachjargon; sie beeinflussen, wie Sie behandelt werden. Diese Arbeit zeigt, dass große Sprachmodelle viele Formen stigmatisierender Sprache im Zusammenhang mit Sucht in Intensivstationsnotizen zuverlässig erkennen können, selbst wenn das Problem subtil ist. Auch wenn kein System perfekt ist, könnten solche Werkzeuge als stets aktive Editoren dienen, die Kliniker:innen zu einer Sprache anregen, die Menschen als mehr als ihre Diagnosen anerkennt. Langfristig könnte dieser Wandel — von Schuldzuweisung zu Respekt — für die Heilung genauso wichtig sein wie jedes Medikament oder Gerät.

Zitation: Sethi, R., Caskey, J., Gao, Y. et al. Detecting stigmatizing language in clinical notes with large language models for addiction care. npj Health Syst. 3, 15 (2026). https://doi.org/10.1038/s44401-026-00069-0

Schlüsselwörter: Suchtstigma, klinische Notizen, große Sprachmodelle, elektronische Gesundheitsakten, personenorientierte Sprache