Clear Sky Science · de

Erklärbares Mehrgranularitäts‑Attributions‑Reasoning‑Framework zur Erkennung von Falschnachrichten

Warum das Erkennen von Falschnachrichten schwieriger wird

Jeden Tag rasen Millionen von Beiträgen mit Text und Bildern durch soziale Medien. Einige sind harmlos, einige wahr, und einige sind sorgfältig gestaltete Fälschungen, die Aufmerksamkeit erregen, Emotionen schüren oder Meinungen beeinflussen sollen. Da Bildbearbeitungsprogramme und KI‑Generatoren immer günstiger und leichter zu bedienen sind, sind Falschnachrichten polierter und gefährlicher geworden. Dieses Papier stellt einen neuen Ansatz vor, um in Systeme zur Erkennung von Falschnachrichten hineinzusehen, sodass wir nicht nur erkennen, ob ein Beitrag wahrscheinlich falsch ist, sondern auch warum.

Wie Falschnachrichten unsere Augen und Gedanken täuschen

Ersteller von Falschnachrichten nutzen aus, dass Menschen Schlagzeilen und Bilder schnell überfliegen. Sie können Fotos fälschen oder nachbearbeiten, teilweise wahre Details in eine unmögliche Geschichte einfließen lassen, Stücke aus verschiedenen Ereignissen zusammensetzen oder Orte und Zeitabläufe vermischen, die nicht zusammengehören. Ein einzelner Beitrag zu einem aktuellen Ereignis kann ein dramatisches Bild aus einem anderen Vorfall von Jahren zuvor zeigen, oder ein überzeugendes Foto kann vollständig von einer KI erzeugt worden sein. Traditionelle Detektionssysteme behandeln meist alle Fälschungen gleich und pressen Text und Bild in eine einzige vermischte „Feature‑Suppe“. Dieser Ansatz kann einigermaßen gut funktionieren, verhält sich aber wie eine Blackbox: Für Journalisten, Plattformen oder Nutzer ist es schwer nachzuvollziehen, welche konkreten Hinweise den Alarm ausgelöst haben.

Eine neue Frage: „Warum ist das falsch?“

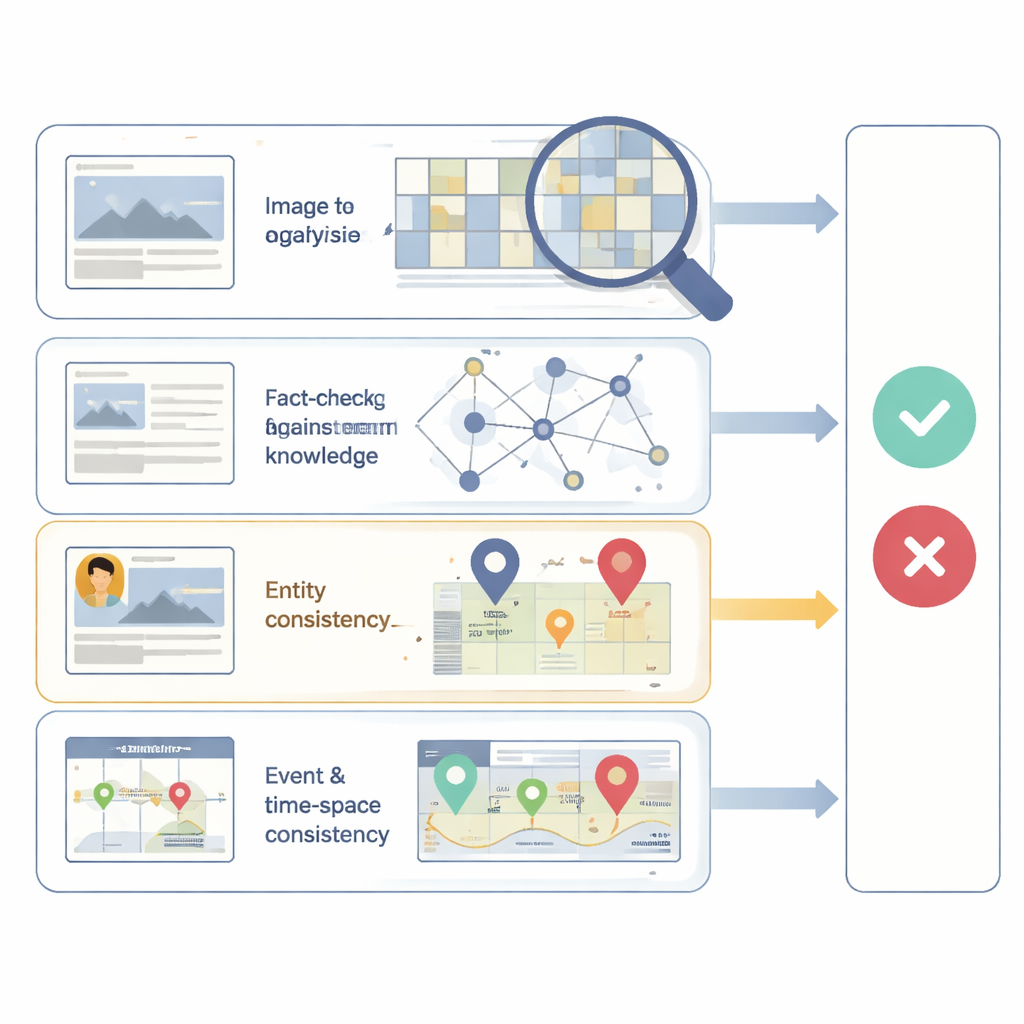

Die Autorinnen und Autoren schlagen ein erklärbares Framework namens EMAR‑FND vor, das Nachrichtenbeiträge aus vier verschiedenen Blickwinkeln betrachtet, die jeweils mit einer gängigen Fälschungsmethode verknüpft sind. Erstens prüft es, ob das Bild selbst Anzeichen von Manipulation oder synthetischer Erzeugung zeigt, indem es sich auf subtile kamera‑ oder sensorbedingte Rauschmuster konzentriert, die sich bei Bearbeitung verändern. Zweitens kontrolliert es, ob die Fakten der Geschichte mit vertrauenswürdigen externen Wissenquellen übereinstimmen, etwa bekannten Beziehungen zwischen Personen, Orten und Ereignissen. Drittens untersucht es, ob die im Text genannten Schlüsselenitäten – etwa eine öffentliche Person oder eine Stadt – tatsächlich mit dem im Bild Gezeigten übereinstimmen. Viertens bewertet es, ob das beschriebene Ereignis zeitlich und räumlich zusammenpasst, beispielsweise durch das Erkennen einer Diskrepanz zwischen einem behaupteten Ort und visuellen Hinweisen im Bild oder zwischen einem berichteten Zeitverlauf und anderen Belegen.

Hinweise aus vielen Perspektiven zusammensetzen

Jede dieser vier Prüfungen wird von einem eigenen Reasoning‑Modul durchgeführt, das ein Teilurteil darüber fällt, ob der jeweilige Aspekt vertrauenswürdig wirkt. Ein Modul konzentriert sich auf visuelle Manipulationen; ein anderes schließt logische Schlüsse über externe Wissensgraphen; ein drittes baut ein reiches Netzwerk auf, das Wörter, Objekte im Bild und extrahierte Ereignisse verbindet; und ein viertes vergleicht den Beitrag mit verwandten Belegen über Zeit und Raum. Anstatt diese Signale in einer einzigen verschmolzenen Repräsentation zu verbergen, hält EMAR‑FND ihre Beiträge getrennt und kombiniert sie dann in einem abschließenden Entscheidungsschritt, der abwägen kann, wie wichtig jede Sichtweise für den jeweiligen Fall ist. Das Ergebnis ist nicht nur eine finale Echt‑oder‑Falsch‑Punktzahl, sondern auch eine Attribution, die zum Beispiel zeigt, dass ein Beitrag hauptsächlich deshalb markiert wurde, weil das Bild manipuliert zu sein scheint oder weil das beschriebene Ereignis nicht zu den bekannten Fakten passt.

Erprobung des Systems in der Praxis

Um zu prüfen, wie gut dieser Ansatz funktioniert, wendeten die Forschenden EMAR‑FND auf zwei öffentliche Sammlungen echter und gefälschter Nachrichtenbeiträge an, die sowohl Text als auch Bilder enthalten. Über diese Datensätze hinweg übertraf ihre Methode mehrere starke bestehende Systeme und erzielte höhere Genauigkeit sowie ein besseres Gleichgewicht zwischen dem Erkennen von Fälschungen und dem Vermeiden von Fehlalarmen. Als sie betrachteten, wie Beiträge im Modell gruppiert wurden, bildeten echte Nachrichten tendenziell enge, konsistente Cluster, während Falschnachrichten verstreuter waren – was die vielen unterschiedlichen Tricks der Fälscher widerspiegelt. Auch die Attributionsausgaben erwiesen sich in schwierigen, realen Fällen als nützlich: Beiträge, bei denen Text und Bild auf den ersten Blick konsistent schienen, wurden entweder entlarvt, weil das Bild versteckte Manipulationsspuren zeigte, oder weil externes Wissen den behaupteten Fakten widersprach.

Was das für Alltagleser bedeutet

Kurz gesagt zeigt die Studie, dass es möglich ist, Falschnachrichten‑Detektoren zu bauen, die weniger wie Orakel und mehr wie sorgfältige Ermittler funktionieren. Anstatt eine bloße Ja‑oder‑Nein‑Antwort zu liefern, hebt EMAR‑FND hervor, welcher Teil eines Beitrags verdächtig ist: das Bild, die Fakten, die genannten Personen oder das Ereignis selbst. Diese Art von Erklärung kann Faktenprüfer, Plattformen und Leser dabei unterstützen, den Entscheidungen des Systems zu vertrauen und gängige Täuschungsmuster zu erkennen. Während sich Falschnachrichten weiterentwickeln, werden Werkzeuge, die Manipulationen sowohl erkennen als auch erklären können, entscheidend sein, um Online‑Informationsökosysteme gesünder und transparenter zu halten.

Zitation: Ji, W., Lv, H., Zhao, H. et al. Explainable multi-granularity attribution reasoning framework for fake news detection. npj Artif. Intell. 2, 38 (2026). https://doi.org/10.1038/s44387-026-00093-3

Schlüsselwörter: Erkennung von Falschnachrichten, multimodale Fehlinformation, erklärbare KI, Integrität sozialer Medien, Analyse von Bildfälschungen