Clear Sky Science · de

Die Entstehung kollektiven Verhaltens in Netzwerken kognitiver Agenten entschlüsseln

Warum denkende Schwärme wichtig sind

Von Roboterschwärmen bis zu Online-Communities können Gruppen einfacher Einheiten überraschend reichhaltiges Verhalten zeigen. Was aber passiert, wenn jede Einheit keineswegs simpel ist, sondern starke sprachbasierte Schlussfähigkeit besitzt wie heutige große KI-Modelle? Diese Studie untersucht, wie sich Schwärme solcher „kognitiven Agenten" im Vergleich zu klassischen regelbasierten Partikeln verhalten und welche Folgen das für Aufgaben wie Problemlösung und Gesellschaftssimulationen hat.

Von einfachen Partikeln zu sprechenden Agenten

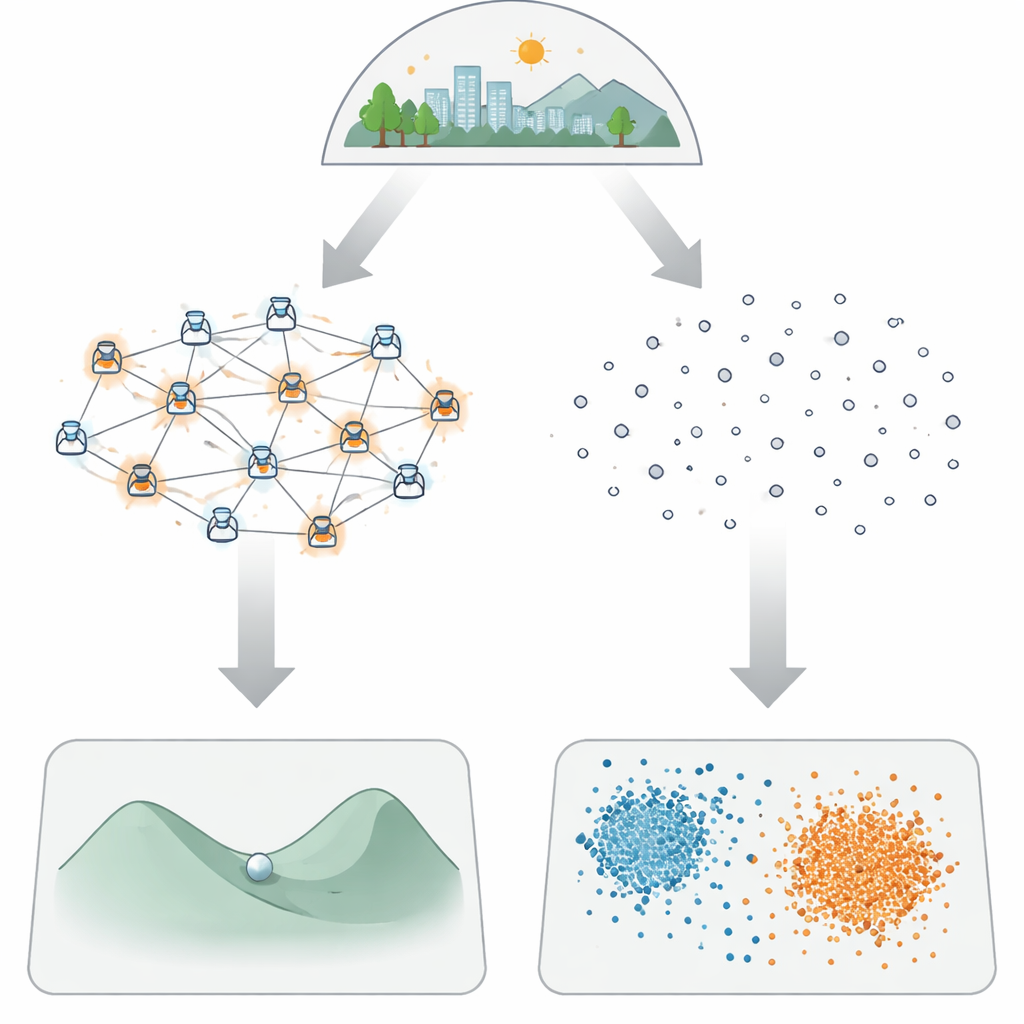

Traditionelle Modelle von Menschenmengen, Vogelschwärmen oder Insektenschwärmen behandeln Individuen als einfache Partikel, die festen Regeln folgen: auf einen Nachbarn zu bewegen, Kollisionen vermeiden, ähnliche Nachbarn bevorzugen usw. Im Gegensatz dazu werden die hier untersuchten Agenten durch große Sprachmodelle (LLMs) angetrieben. Sie nehmen ihre Umgebung in Worten wahr, überlegen, was als Nächstes zu tun ist, merken sich frühere Erfahrungen und kommunizieren sogar miteinander. Die Autoren stellen eine zentrale Frage: Verändern sich die auf Gruppenebene entstehenden Muster, wenn jede Einheit diese eingebaute „Intelligenz" besitzt — und falls ja, wie?

Schwärme auf harten Problemen testen

Um diese Frage zu untersuchen, vergleichen die Forschenden kognitive Agenten mit klassischen Partikeln bei zwei sehr unterschiedlichen Herausforderungen. Die erste ist Funktionsoptimierung, ein Stellvertreter für schwierige Suchprobleme, bei denen das Ziel darin besteht, die beste Lösung in einer zerklüfteten Landschaft mit vielen lokalen Fallen zu finden. Sie führen LLM Agent Swarm Optimization (llmASO) ein, bei der ein Netzwerk von LLM-Agenten Lösungsvorschläge in natürlicher Sprache macht und teilt. Dies wird mit einer bekannten partikelbasierten Methode namens Particle Swarm Optimization sowie mit einem einzelnen LLM-Optimierer verglichen, der alleine arbeitet. In einfacheren Landschaften finden einzelne LLM-Agenten schnell gute Antworten, indem sie Muster in vergangenen Versuchen erkennen. In unruhigeren Terrains mit vielen lokalen Senken neigen Einzelagenten jedoch dazu, sich zu früh auf nahe gelegene „gut genug"-Stellen festzulegen. Schwärme sprechender Agenten entdecken dagegen zuverlässig die tatsächlich beste Region — wenn auch langsamer — und ihr Erfolg ist empfindlich gegenüber der Art und Weise, wie Informationen durch ihr Kommunikationsnetz fließen.

Wie Sprechen soziale Muster verändert

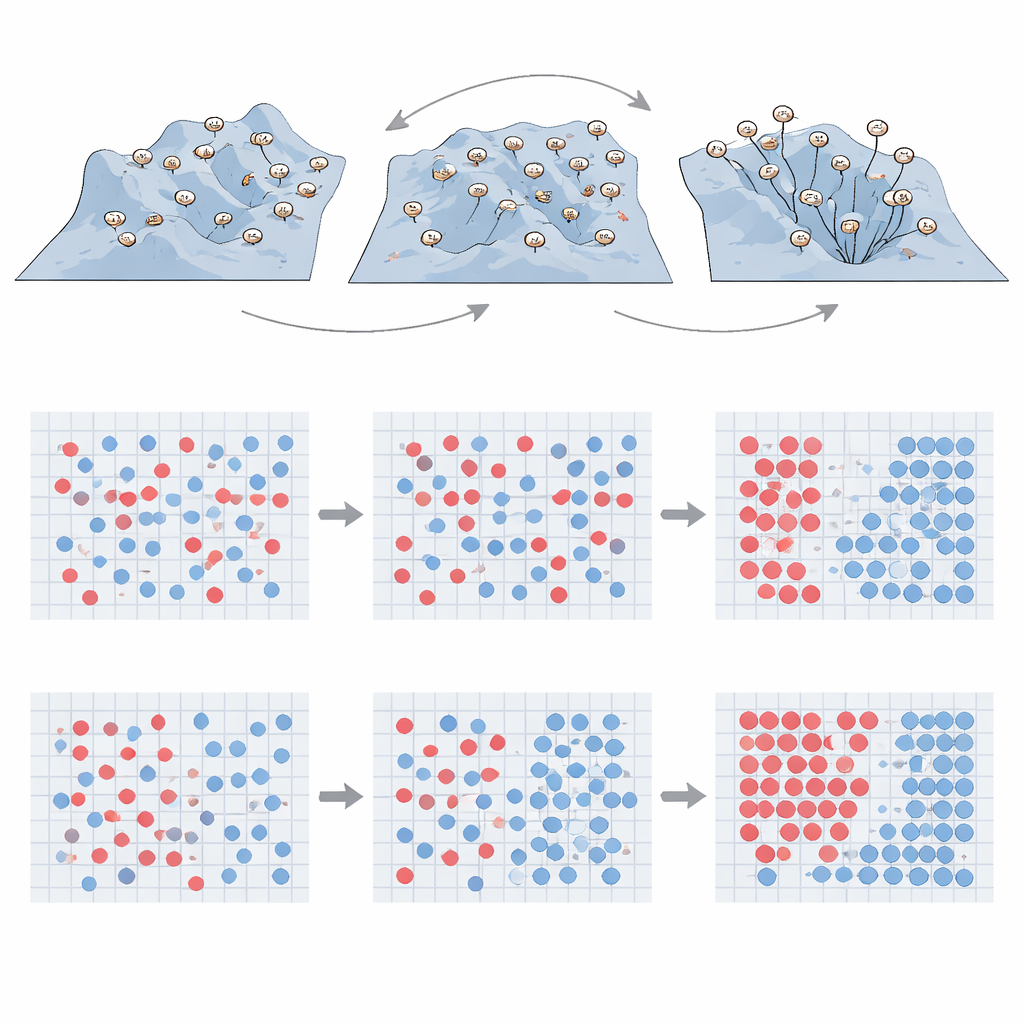

Der zweite Test greift das klassische Schelling-Modell der Segregation auf, das zeigt, wie milde Präferenzen für ähnliche Nachbarn zu starker Trennung zwischen Gruppen führen können. Hier bewegen sich die Agenten auf einem Gitter und gehören einem von zwei Typen an; sie sind „zufrieden", wenn nur wenige Nachbarn sich von ihnen unterscheiden. Bei standardmäßigen Partikeln, die einfachen Umzugsregeln folgen, treten mit verändernder Toleranz drei vertraute Phasen auf: ein gemischter Zustand mit ständigem Umhergehen, ein segregierter Zustand mit klaren Clustern und ein eingefrorener Zustand, in dem Bewegung weitgehend zum Stillstand kommt. Kognitive Agenten befolgen dieselbe grundlegende Zufriedenheitsregel, entscheiden aber nach dem Austausch von Nachrichten, wohin sie ziehen. Wenn jeder Agent mit jedem anderen sprechen kann, sieht das große Bild überraschend ähnlich wie im Partikelfall aus, was darauf hindeutet, dass das bloße Hinzufügen von Sprache und Schlussfolgerung bekannte Segregationsmuster nicht automatisch umwirft.

Netzwerkeffekte und "Vögel derselben Feder"

Die Lage ändert sich, sobald die Struktur der Gespräche realistischer gestaltet wird. Die Autoren verdrahten das Kommunikationsnetz so um, dass Agenten überwiegend mit nahen Peers sprechen oder Verbindungen Mustern folgen, wie sie in vielen realen sozialen Systemen mit einigen hoch vernetzten Knoten vorkommen. Sie experimentieren außerdem mit Homophilie (Agenten sprechen bevorzugt mit dem gleichen Typ) und Heterophilie (Bevorzugung des anderen Typs). Diese Feinabstimmungen haben starke Folgen: Wenn Agenten hauptsächlich mit ähnlichen Peers kommunizieren, koordinieren sie sich schnell, bilden effizient Cluster und können sogar die endlos gemischte Phase vermeiden. Wenn sie überwiegend typübergreifend sprechen, verläuft der Weg zur Zufriedenheit langsamer und komplexer, doch starke Segregation kann sich dennoch herausbilden — obwohl jede Unterhaltung die Gruppengrenzen überquert. Insgesamt formen lokale Gespräche und "Vögel derselben Feder"-Tendenzen, wie Segregation entsteht, auf Weisen, die für nicht-denkende Partikel nicht zugänglich sind.

Folgen für künftige KI-Schwärme und Gesellschaftssimulationen

Die Autoren kommen zu dem Schluss, dass fortgeschrittene sprachbasierte Fähigkeiten einzelner Agenten Gruppen nicht einfach generell besser machen. Stattdessen führen diese Fähigkeiten neue Kräfte ein — etwa raschen Konsens und Musterausbeutung — die je nach Vernetzung der Agenten nützlich oder schädlich sein können. Bei Optimierungsaufgaben können schlecht gestaltete Netzwerke intelligente Agenten dazu bringen, zu schnell einen mittelmäßigen Konsens zu erzielen; eine gezielte Begrenzung des Informationsflusses hilft ihnen, breiter zu suchen, auf Kosten der Geschwindigkeit. In Gesellschaftssimulationen können realistische Kommunikationsmuster und Homophilie Verhaltensweisen erzeugen, die sich von klassischen Modellen unterscheiden und menschliche Gesellschaften besser abbilden. Da Schwärme KI-gesteuerter Roboter und Netzwerke virtueller Agenten zunehmend verbreitet werden, wird das Verständnis und die Feinabstimmung dieser kollektiven Effekte entscheidend sein, um sichere und effektive Systeme zu entwerfen.

Zitation: Zomer, N., De Domenico, M. Unraveling the emergence of collective behavior in networks of cognitive agents. npj Artif. Intell. 2, 36 (2026). https://doi.org/10.1038/s44387-026-00091-5

Schlüsselwörter: kognitive Agenten, große Sprachmodelle, Schwarmoptimierung, Segregationsdynamik, Netzwerktopologie