Clear Sky Science · de

DeepKoopFormer: eine mit dem Koopman-Operator ergänzte Transformer-Architektur zur Zeitreihenprognose

Warum bessere Vorhersagen wichtig sind

Von Wetter- und Energieplanung bis hin zu Finanzmärkten hängen viele unserer wichtigsten Entscheidungen davon ab, vorherzusagen, wie sich Dinge über die Zeit verändern. Diese „Zeitreihen“ – Ströme von Messwerten wie Windgeschwindigkeit, Stromerzeugung oder Kurswerte – werden länger, verrauschter und komplexer. Moderne KI-Werkzeuge namens Transformer können diese Daten verarbeiten, verhalten sich aber oft wie Blackboxes und können bei langfristigen Vorhersagen instabil werden. Dieses Papier stellt DeepKoopFormer vor, eine Prognosemethode, die die Vorhersagekraft von Transformern bewahrt und gleichzeitig mathematische Struktur hinzufügt, damit ihr Verhalten über lange Horizonte stabiler, besser interpretierbar und zuverlässiger wird.

Ein neuer Weg, leistungsstarke Modelle zu stabilisieren

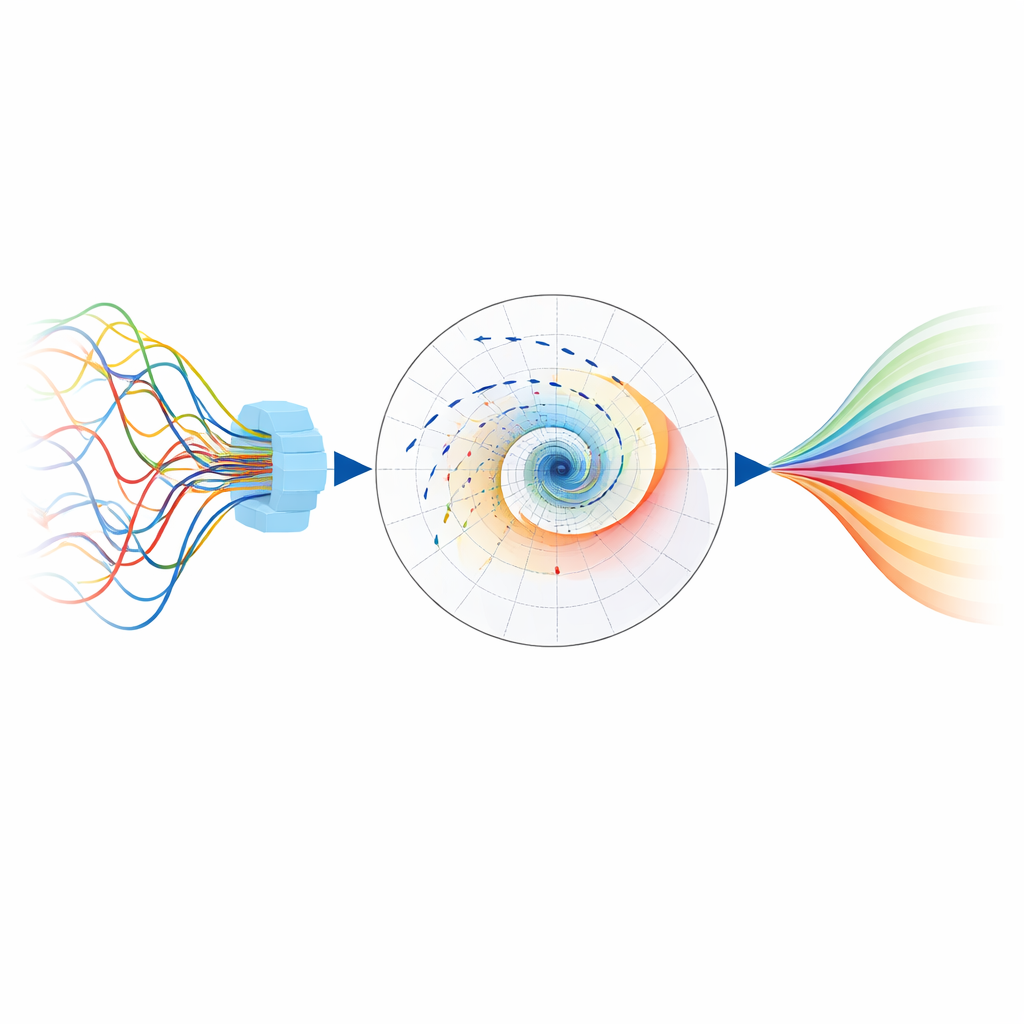

Die Autoren bauen auf einer vertrauten Idee der heutigen KI auf: Einen Transformer zu nutzen, um rohe Zeitreihen in eine reiche interne Repräsentation zu überführen. DeepKoopFormer fügt dann eine sorgfältig gestaltete Zwischenschicht ein, die von einem Konzept der Dynamischen Systeme inspiriert ist, dem Koopman-Operator. Anstatt das Modell auf komplizierte, vollständig nichtlineare Weise fortschreiten zu lassen, aktualisiert diese Zwischenschicht den internen Zustand mittels einer einfachen linearen Transformation in einem verborgenen Raum. Entscheidend ist, dass diese Transformation so konstruiert ist, dass ihr Einfluss im Zeitverlauf allmählich schrumpft statt sich explosionsartig zu verstärken; mathematisch garantiert das, dass langfristige Vorhersagen nicht auseinanderlaufen oder unkontrolliert oszillieren.

Wie das Modell sein Gleichgewicht hält

Um diese Stabilität zu erzwingen, beschränkt DeepKoopFormer den linearen Schritt auf mehrere Weisen. Die Transformation wird in drei Teile zerlegt: zwei orthogonale Matrizen (die Längen und Winkel bewahren), die um eine Diagonalmatrix von Skalierungsfaktoren gelegt sind, deren Einträge alle kleiner als eins erzogen werden. Das bedeutet, dass der versteckte Zustand bei jeder Aktualisierung sanft kontrahiert statt verstärkt wird. Eine zweite Zutat, die sogenannte Lyapunov-Regularisierung, fügt während des Trainings eine Strafterm hinzu, wann immer die „Energie“ des versteckten Zustands von einem Schritt zum nächsten wächst. Zusammen sorgen diese Mechanismen dafür, dass die internen Dynamiken ruhig und wohlverhalten bleiben, während der Transformer davor und der lineare Decoder danach weiterhin expressive Freiheiten behalten. Die Fähigkeit des Modells, reichhaltige Muster zu lernen, und seine Stabilität werden durch getrennte Einstellungen gesteuert, sodass Anwender das eine justieren können, ohne das andere zu zerstören.

Erprobung der Methode

Die Forschenden evaluieren DeepKoopFormer sowohl an kontrollierten als auch an realen Problemen. Zunächst testen sie ihn an klassischen chaotischen Systemen wie dem Lorenz-Attraktor, wo kleine Änderungen zu sehr unterschiedlichen Zukünften führen können, und fügen zufälliges Rauschen hinzu, um reale Messungen zu simulieren. Über verschiedene Transformer-Backbones hinweg verfolgen die koopman-ergänzten Varianten die tatsächlichen Trajektorien genau und behalten gleichzeitig über viele kurzfristige Vorhersagen ein stabiles Innenverhalten bei. Anschließend wenden die Autoren die Methode auf anspruchsvolle reale Datensätze an: Klimaprojektionen und Reanalysen über Deutschland (Windgeschwindigkeit und Bodendruck), Kryptowährungspreise und Stromerzeugung aus verschiedenen Quellen in Spanien. In diesen Fällen werden DeepKoopFormer-Varianten mit einem standardmäßigen Long Short-Term Memory (LSTM)-Netzwerk und einfacheren linearen Baselines verglichen, über viele Wahlmöglichkeiten von Eingabefensterlänge, Vorhersagehorizont und Modellgröße hinweg.

Was die Experimente zeigen

Über Klima-, Finanz- und Energiefälle hinweg erzielen die mit Koopman erweiterten Transformer-Modelle im Allgemeinen geringere Vorhersagefehler und ein stabileres Verhalten als die LSTM-Baseline, insbesondere bei vielen Schritten in die Zukunft oder bei hochdimensionalen Daten. Für Wind und Druck über Deutschland sowie für die Stromerzeugung schneiden die PatchTST- und Informer-Varianten von DeepKoopFormer tendenziell am besten ab und erfassen zuverlässig sowohl glatte Trends als auch schnelle Schwankungen. In einigen Spezialfällen, in denen die zugrundeliegenden Muster nahezu vollständig linear sind, gewinnt eine sehr einfache lineare Methode bei der Testgenauigkeit, was unterstreicht, dass kein einzelnes Modell universell optimal ist. Die koopman-basierten Designs zeigen jedoch durchgängig glattere Fehlerverläufe bei wachsenden Vorhersagehorizonten, was auf eine bessere Kontrolle langfristiger Unsicherheit und eine geringere Neigung zum Überanpassen an eigenartige Details der Trainingsdaten hindeutet.

Warum dieser Ansatz vielversprechend ist

Am Ende zeigt DeepKoopFormer, dass es möglich ist, die Flexibilität des Deep Learning mit den Garantien klassischer Theorie dynamischer Systeme zu verbinden. Indem eine strukturierte, stabile lineare Stufe in eine ansonsten standardmäßige Transformer-Pipeline eingefügt wird, erhalten die Autoren Vorhersagen, die genau, rauschrobust und mathematisch leichter zu analysieren sind. Für Praktiker, die auf langfristige Vorhersagen in der Klimawissenschaft, in Energiesystemen oder in der Finanzwelt angewiesen sind – Bereiche, in denen Stabilität und Interpretierbarkeit genauso wichtig sind wie rohe Genauigkeit – bietet dieses Framework eine Möglichkeit, mächtigen neuronalen Modellen etwas mehr zu vertrauen und zu verstehen, wie und warum ihre Vorhersagen sich über die Zeit verhalten.

Zitation: Forootani, A., Khosravi, M. & Barati, M. DeepKoopFormer: a Koopman enhanced transformer based architecture for time series forecasting. npj Artif. Intell. 2, 35 (2026). https://doi.org/10.1038/s44387-026-00085-3

Schlüsselwörter: Zeitreihenprognose, Transformermodelle, Koopman-Operator, stabile Dynamik, Klima- und Energiedaten