Clear Sky Science · de

Ein variationales Rahmenwerk für residualbasierte Adaptivität in neuronalen PDE‑Solvern und Operatorlernen

Intelligenteres KI für schwierige Gleichungen

Viele der heutigen wissenschaftlichen Durchbrüche – von Klimamodellen bis zur Entwicklung neuer Materialien – hängen davon ab, komplexe Gleichungen zu lösen, die beschreiben, wie sich Flüssigkeiten bewegen, Wellen ausbreiten oder chemische Fronten wandern. Neuronale Netze sind in letzter Zeit zu leistungsfähigen Werkzeugen für diese Aufgaben geworden, doch sie geraten oft an ihre Grenzen, wenn die Physik anspruchsvoll wird: scharfe Schocks, feine Strukturen und Langzeitvorhersagen können zu Fehlern führen. Diese Arbeit stellt eine systematische Methode vor, damit diese KI‑Löser ihren Aufwand genau dort konzentrieren, wo sie am meisten Probleme haben, sodass sie sowohl schneller als auch genauer werden.

Warum neuronale Netze Anleitung brauchen

Im wissenschaftlichen maschinellen Lernen werden neuronale Netze entweder darauf trainiert, die Lösung einer einzelnen Gleichung nachzubilden (wie bei physik‑informierten neuronalen Netzen, PINNs) oder eine gesamte Abbildung von Eingaben auf Lösungen zu lernen (bekannt als Operatorlernen). In beiden Fällen wird das Netz anhand eines „Residuals“ beurteilt, eines Maßes dafür, wie stark es die zugrundeliegende Gleichung an jedem Punkt in Raum und Zeit verletzt. Im Standardtraining werden alle Punkte gleich behandelt und der durchschnittliche Fehler minimiert. Das funktioniert bei einfachen Problemen, aber bei Gleichungen mit steilen Gradienten, sich bewegenden Fronten oder lokalisierten Strukturen kann ein niedriger Durchschnitt schwerwiegende Fehler in kritischen Regionen verschleiern. Forschende haben mit Ad‑hoc‑Regeln reagiert, die mehr Trainingspunkte dort platzieren, wo das Residual groß ist, doch bisher blieben diese Regeln heuristisch und schwach begründet.

Ein einheitliches Rezept für adaptive Aufmerksamkeit

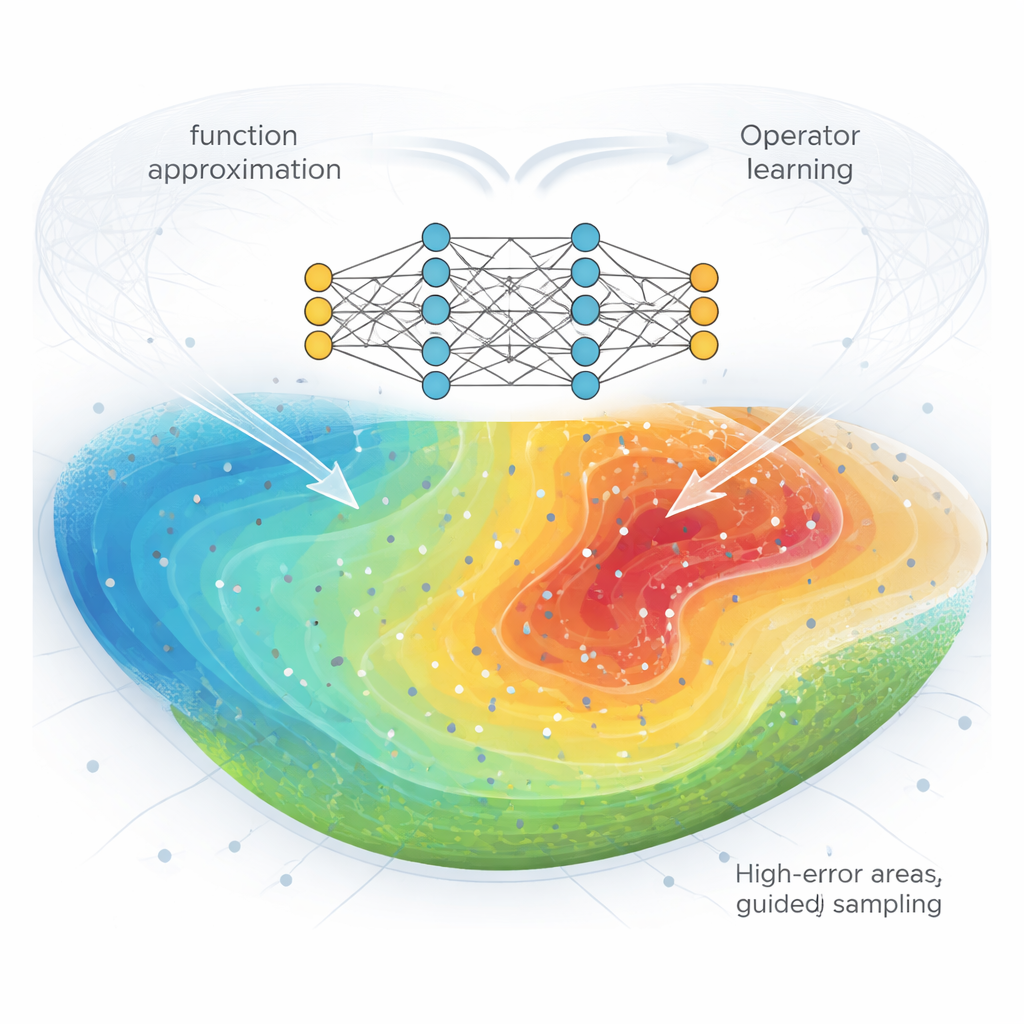

Die Autoren entwickeln ein variationales Rahmenwerk, das diese Heuristiken in ein prinzipielles Vorgehen überführt. Die Kernidee ist, Stichprobenahme und Gewichtung als Entscheidungen darüber zu sehen, welche Wahrscheinlichkeitsverteilung über den Raum (und über Trainingsbeispiele) das Netz am meisten beachten sollte. Sie führen eine Familie von „Potenzial“-Funktionen ein, die das Residual in ein neues Ziel umwandeln. Unterschiedliche Potenziale entsprechen unterschiedlichen Prioritäten: Ein exponentielles Potenzial treibt das Netz dazu, den einzelnen schlimmsten Fehler zu reduzieren, während ein quadratisches Potenzial die Verringerung der Streuung bzw. Varianz des Fehlers im Domain betont. Mathematisch führt die Optimierung dieser transformierten Ziele natürlicherweise dazu, in Regionen mit großem Residual häufiger zu sampeln. Die resultierende Methode, variational residual‑based attention (vRBA), umfasst viele bestehende adaptive Schemata und bietet einen klaren Weg, neue zu entwickeln.

Ausdehnung auf das Lernen ganzer physikalischer Abbildungen

Moderne KI‑Löser zielen zunehmend darauf ab, nicht nur eine Lösung, sondern einen gesamten Operator zu lernen: eine Abbildung von Eingaben wie Anfangsbedingungen oder Anregungen zu vollständigen Raum‑Zeit‑Feldern. Das ist das Ziel neuronaler Operatorarchitekturen wie DeepONet, Fourier Neural Operators (FNO) und zeitkonditionierten U‑Nets. Hier verdoppelt sich die Herausforderung: Es gibt Variationen über verschiedene Eingabefunktionen hinweg und Variationen in Raum und Zeit innerhalb jedes Beispiels. Die Autoren passen ihr Rahmenwerk an dieses Produkt setting an, indem sie zwei Ebenen der Adaptivität kombinieren. Zuerst gewichten sie räumliche Punkte innerhalb jedes Beispiels so um, dass Bereiche mit hohen Residuen stärker ins Gewicht fallen. Zweitens verwenden sie die akkumulierten Residuen, um ganze Trainingsbeispiele bevorzugt neu zu sampeln, die am schwersten zu lernen sind. Dieses hybride Schema lässt sich direkt in gängige Operator‑Learning‑Modelle einbauen, ohne deren Architektur neu entwerfen zu müssen.

Schärfere Details, langsamere Fehlerzunahme

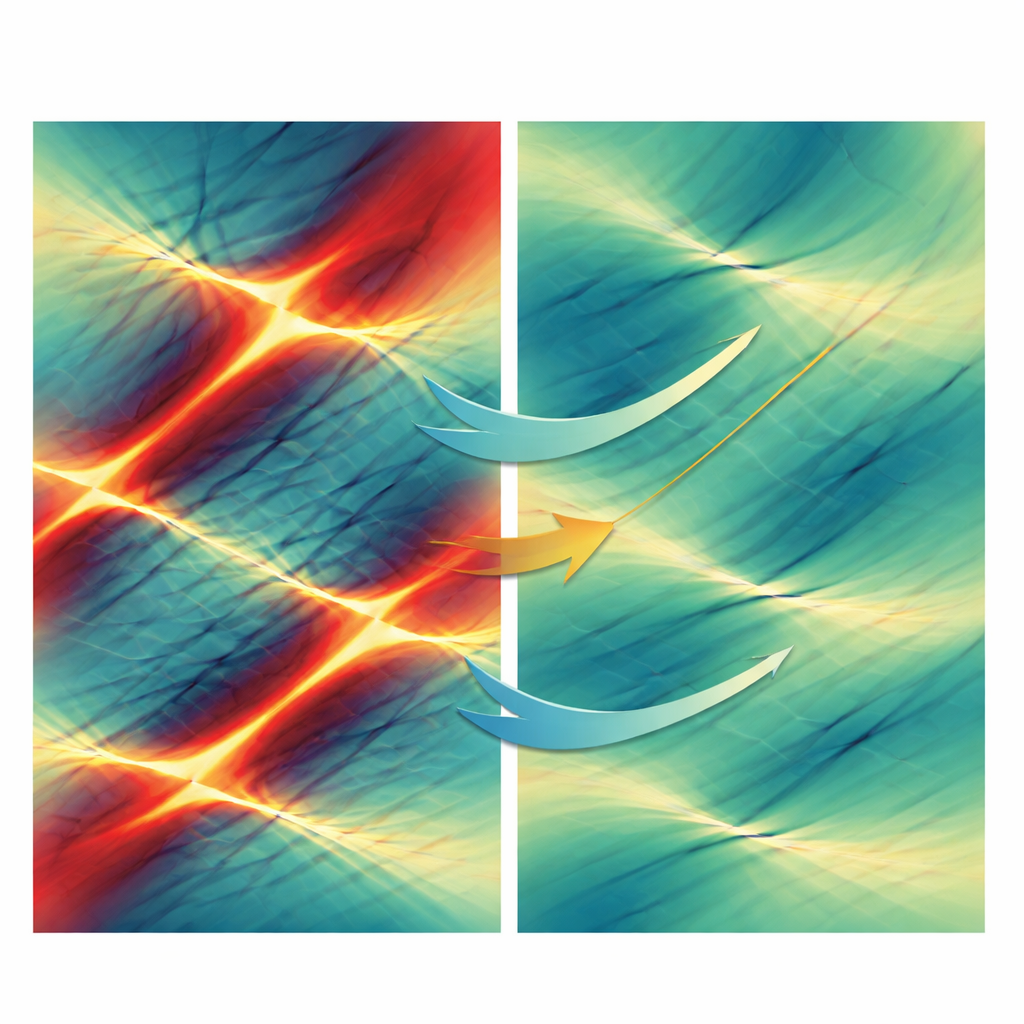

Über eine breite Palette von Benchmark‑Aufgaben übertrifft der vRBA‑Ansatz konstant das traditionelle Training. Für PINNs testet das Team klassische nichtlineare Gleichungen wie Allen–Cahn, Burgers’ und Korteweg–De Vries. Einige dieser Probleme sind dafür bekannt, Standard‑PINNs zu überfordern, sei es durch scharfe interne Schichten oder interagierende Wellenpulse. Mit vRBA konvergieren dieselben Netze schneller und erreichen deutlich niedrigere Fehler; in schwierigen Fällen, in denen die Baseline praktisch versagt, liefern die adaptiven Methoden wieder genaue Lösungen. Beim Operatorlernen wenden sie vRBA auf Blasenwachstum in Flüssigkeiten, hochdruckbelastete Schockrohrströmungen, zweidimensionale Turbulenzen und Wellenausbreitung an. Hier ist der Hauptvorteil nicht nur ein besserer Endfehler, sondern eine viel langsamere Fehlerakkumulation über die Zeit, was entscheidend ist, wenn die Ausgabe eines Modells wiederholt als eigener Eingang verwendet wird.

Rauschreduktion im Lernsignal

Die Autoren führen diese Gewinne auf zwei Haupteffekte zurück. Erstens reduziert vRBA durch Änderung der Stichprobenahme oder Gewichtung von Trainingspunkten das statistische Rauschen in der geschätzten Verlustfunktion: Zufällige Zufallsauswahlen von Punkten liefern ein verlässlicheres Bild davon, wie gut das Netz insgesamt abschneidet. Das verringert direkt den Diskretisierungsfehler, die Lücke zwischen dem kontinuierlichen idealen Ziel und der in der Praxis verwendeten endlichen Punktmenge. Zweitens verbessert die Methode das Signal‑Rausch‑Verhältnis der Gradienten, die das Lernen antreiben, sodass verschiedene Bereiche der Domäne stärker „übereinstimmen“ bezüglich der Richtung, in die die Parameter bewegt werden sollten. Dadurch entkommen Netze langsamen, unentschlossenen Trainingsphasen deutlich früher und treten in einen Bereich ein, in dem der Fehler schnell sinkt. Das Rahmenwerk macht außerdem deutlich, wann aggressive Strategien – also solche, die die größten Residuen stark bestrafen – hilfreich sein können und wann sie das Training destabilisieren können.

Was das für zukünftige wissenschaftliche KI bedeutet

Für Nicht‑Expertinnen und Nicht‑Experten lautet die Botschaft: Intelligenteres Augenmerk darauf, wo ein KI‑Löser falsch liegt, kann ihn zu einem weitaus vertrauenswürdigeren Werkzeug für Wissenschaft und Technik machen. Anstatt sich auf Trial‑and‑Error‑Regeln zu verlassen, bietet diese Arbeit einen mathematischen Bauplan, um neuronale Netze auf die informativsten Teile eines Problems zu lenken, seien es Schockfronten, feine Oszillationen oder Langzeitverhalten. Wenn wissenschaftliche Modelle größer werden und in sicherheitskritischen Einsatzbereichen genutzt werden, werden solche prinzipiengeleiteten Strategien zur Fehlerreduktion und Stabilisierung des Lernens entscheidend, um leistungsfähige neuronale Netze in zuverlässige wissenschaftliche Instrumente zu verwandeln.

Zitation: Toscano, J.D., Chen, D.T., Ooomen, V. et al. A variational framework for residual-based adaptivity in neural PDE solvers and operator learning. npj Artif. Intell. 2, 32 (2026). https://doi.org/10.1038/s44387-026-00084-4

Schlüsselwörter: physik‑informierte neuronale Netze, Operatorlernen, adaptive Stichprobenahme, wissenschaftliches maschinelles Lernen