Clear Sky Science · de

KI-Agenten im Gesundheitswesen: Anwendungen, Bewertungen und zukünftige Richtungen

Warum intelligente digitale Helfer in der Medizin wichtig sind

Krankenhäuser versinken in Daten, Ärztinnen und Ärzte sind überlastet, und Patientinnen und Patienten wünschen sich klarere Antworten zu ihrer Gesundheit. Eine neue Art von künstlicher Intelligenz, aufgebaut auf großen Sprachmodellen, die wie Menschen lesen und schreiben können, wird inzwischen zu „KI-Agenten“ weiterentwickelt, die mehrstufige Aufgaben durchdenken können. Dieser Übersichtsartikel erklärt, wie diese digitalen Helfer beginnen, bei Diagnose, Therapieentscheidungen, Dokumentation, Patientengesprächen und sogar in der medizinischen Ausbildung zu unterstützen — und warnt zugleich, was getan werden muss, damit sie genau, gerecht und sicher bleiben.

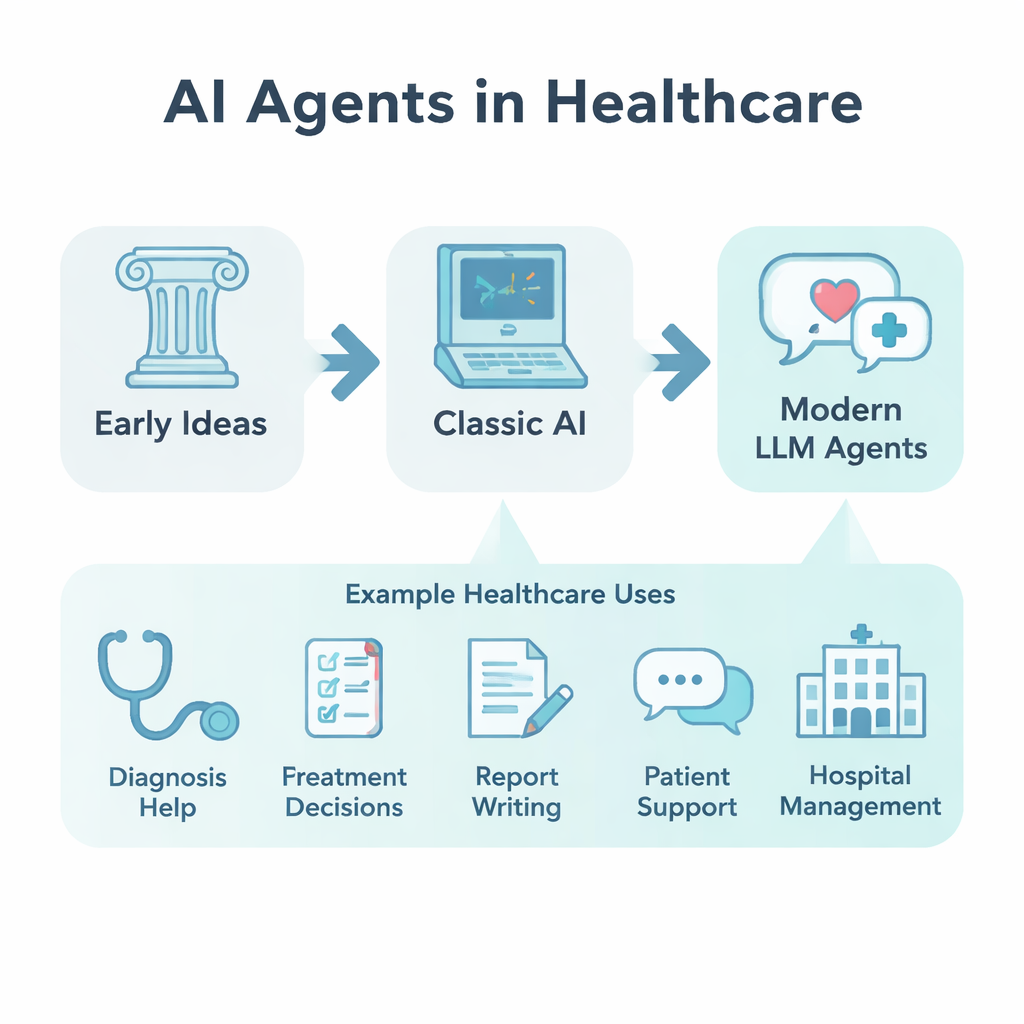

Von Gedankenexperimenten zu praktischen digitalen Kolleginnen und Kollegen

Die Idee eines „Agenten“, der mit Zielen und Absichten handeln kann, reicht bis in die antike Philosophie zurück. Moderne Varianten entstanden mit der frühen künstlichen Intelligenz, Expertensystemen und später mit Machine Learning und Deep Learning, die Computern erlaubten, Muster aus Daten zu lernen. Der Durchbruch der großen Sprachmodelle (LLMs) nach 2022 ging einen Schritt weiter: Statt nur Fragen zu beantworten, können diese Modelle jetzt planen, sich frühere Schritte merken und andere Softwarewerkzeuge aufrufen. Im Gesundheitswesen bedeutet das, dass ein KI-Agent Patientenakten lesen, Leitlinien nachschlagen, Notizen entwerfen und nächste Handlungsempfehlungen vorschlagen kann — weniger wie eine Suchmaschine und mehr wie ein digitaler, junioriger Kollege.

Wodurch sich diese Agenten von gewöhnlicher KI unterscheiden

Nach der im Artikel verwendeten Definition ist ein KI-Agent im Gesundheitswesen mehr als ein einzelnes Modell. Im Kern steht ein LLM, eingehüllt von vier Schlüsselkompetenzen: Planung, Gedächtnis, Werkzeugnutzung und Selbstreflexion. Planung erlaubt es, eine komplexe medizinische Aufgabe in kleinere Schritte zu zerlegen. Gedächtnis ermöglicht, die Geschichte einer Patientin oder eines Patienten oder einen langen Entscheidungsprozess nachzuverfolgen. Werkzeugnutzung heißt, dass er beispielsweise Laborergebnisse aus einer elektronischen Akte ziehen oder eine medizinische Datenbank durchsuchen kann. Selbstreflexionsmodule prüfen und überarbeiten eigene Antworten. Zusammen mit starken Sprachfähigkeiten und wachsender Kapazität für logisches Schließen machen diese Funktionen Agenten flexibel genug, um zwischen Aufgaben und medizinischen Fachgebieten zu wechseln.

Wie KI-Agenten in realer klinischer Arbeit getestet werden

Forschende bauen und simulieren inzwischen viele Arten von Agenten, um herauszufinden, wo sie am meisten helfen. Einige sind so konzipiert, dass sie Diagnosen unterstützen, indem sie Gespräche zwischen virtuellen Ärztinnen und Ärzten und Patientinnen und Patienten nachspielen oder mehrere Spezialisten-Agenten einen schwierigen Fall debattieren lassen. Andere konzentrieren sich auf Therapieentscheidungen, indem sie Eingaben von virtuellen Allgemeinmedizinerinnen, Spezialistinnen und Apothekerinnen kombinieren, um einen gemeinsamen Plan zu entwickeln. Es gibt Agenten, die Radiologieberichte aus Thoraxröntgenbildern entwerfen oder technische Befunde in eine verständliche, patientenfreundliche Sprache übersetzen. Chatbot-ähnliche Systeme werden für psychische Gesundheitsunterstützung, Gewichtsreduktionscoaching und Medikations‑Erinnerungen pilotiert. Weitere Agenten helfen bei der Verordnungskontrolle, erkennen Nebenwirkungen von Medikamenten, vereinfachen elektronische Akten oder bilden Medizinstudierende mit realistischen simulierten Patientinnen und Patienten aus.

Beurteilen, ob diese Systeme für Patientinnen und Patienten geeignet sind

Weil Fehler in der Medizin lebensbedrohlich sein können, argumentiert die Übersichtsarbeit, dass KI-Agenten an mehr als nur an Cleverness gemessen werden müssen. Die Autorinnen und Autoren gliedern Tests in zwei Ebenen. Basisprüfungen fragen: Sind die Antworten sachlich korrekt? Entspricht die Formulierung Expertenberichten? Schließt der Agent die Aufgabe zuverlässig ab, einschließlich des korrekten Aufrufs der richtigen Werkzeuge? Entwicklungsorientierte Prüfungen betrachten Geschwindigkeit, Verständlichkeit und wie gut das System mit Menschen kommuniziert, einschließlich Respekt, Empathie und Gerechtigkeit über verschiedene Patientengruppen hinweg. Studien vergleichen Agenten sowohl mit anderen führenden Sprachmodellen als auch mit menschlichen Ärztinnen und Ärzten, und Aufsichtsbehörden in Europa, dem Vereinigten Königreich, China und anderswo beginnen, offizielle „Sandbox“-Programme zu entwerfen, um Sicherheit, Fairness und klinischen Nutzen vor der Einführung zu testen.

Nächste Schritte: Roboter, Regeln und menschliches Vertrauen

Mit Blick nach vorn hebt der Artikel sieben Prioritäten hervor: Agenten an physische Roboter anzubinden, die in der realen Welt handeln können; allgemeine Modelle mit kleineren Expertenmodellen zu kombinieren; die Bewertung auf Kosten, Sicherheitsvorfälle und Patientenzufriedenheit auszudehnen; stärkere Schutzmaßnahmen und Aufsicht aufzubauen; Ethik- und Datenschutzschutzmaßnahmen zu verankern; für Benutzervertrauen und kontinuierliches Feedback zu gestalten; und dem medizinischen Personal zu helfen, ihre Berufskarrieren auf die Zusammenarbeit mit KI auszurichten, statt durch sie ersetzt zu werden. Die Autorinnen und Autoren schließen, dass KI-Agenten zu mächtigen Partnern im Gesundheitswesen werden könnten — aber nur, wenn sie mit derselben Sorgfalt entwickelt, getestet und reguliert werden, die die Gesellschaft von jeder neuen Medizintechnologie verlangt.

Zitation: Zhao, L., Liu, S., Xin, T. et al. AI agent in healthcare: applications, evaluations, and future directions. npj Artif. Intell. 2, 31 (2026). https://doi.org/10.1038/s44387-026-00076-4

Schlüsselwörter: KI-Agenten im Gesundheitswesen, große Sprachmodelle, klinische Entscheidungsunterstützung, medizinische Chatbots, digitale Gesundheit