Clear Sky Science · de

Verbesserung der Few-Shot-Named-Entity-Recognition für große Sprachmodelle durch strukturiertes dynamisches Prompting mit Retrieval-Augmented Generation

Warum schlauere Analyse medizinischer Texte wichtig ist

Die moderne Medizin erzeugt riesige Mengen an Text—von Intensivstationsberichten bis zu Online-Diskussionen über Medikamentenkonsum. In diesen Worten verbergen sich wichtige Hinweise zu Krankheiten, Behandlungen und Nebenwirkungen. Das automatische Finden und Kennzeichnen dieser Informationsstellen, eine Aufgabe namens „Named Entity Recognition“, kann Forschenden helfen, Ausbrüche zu verfolgen, Arzneimittelprobleme früher zu erkennen und Ärztinnen und Ärzte in Echtzeit zu unterstützen. Traditionelle Systeme benötigen jedoch große, manuell annotierte Datensätze, deren Erstellung teuer ist und die besonders für seltene oder neu auftretende Gesundheitsfragen oft fehlen. Diese Studie untersucht, wie große Sprachmodelle—wie die hinter heutigen Chatbots—mit sorgfältig gestalteten Prompts und intelligenter Beispielrecherche so geführt werden können, dass sie diese Kennzeichnungsaufgabe auch mit nur wenigen annotierten Beispielen gut erfüllen.

Maschinen beibringen, wichtige Begriffe zu erkennen

Die Autorinnen und Autoren konzentrieren sich auf biomedizinische Named-Entity-Recognition—das Auffinden von Erwähnungen zu Krankheiten, Medikamenten, Symptomen und sozialen Auswirkungen im Text. Das ist anspruchsvoll, weil medizinische Sprache stark spezialisiert ist, je nach Krankenhaus oder Fachgebiet variiert und oft seltene Zustände beschreibt, die in keinem Datensatz häufig vorkommen. Bestehende maschinelle Lernmodelle können menschliche Leistung erreichen, benötigen dafür aber meist große, gut annotierte Korpora, deren Erstellung und Freigabe teuer ist und besonders unter strengen Datenschutzregeln schwierig sein kann. Few-Shot-Lernen, bei dem Modelle nur aus einer Handvoll gelabelter Beispiele lernen, bietet einen Weg um dieses Nadelöhr. Große Sprachmodelle sind hier besonders vielversprechend, weil sie Muster direkt aus Instruktionen und Beispielen im Prompt lernen können, ohne ihre internen Gewichte neu zu trainieren.

Bessere Anweisungen für Sprachmodelle entwerfen

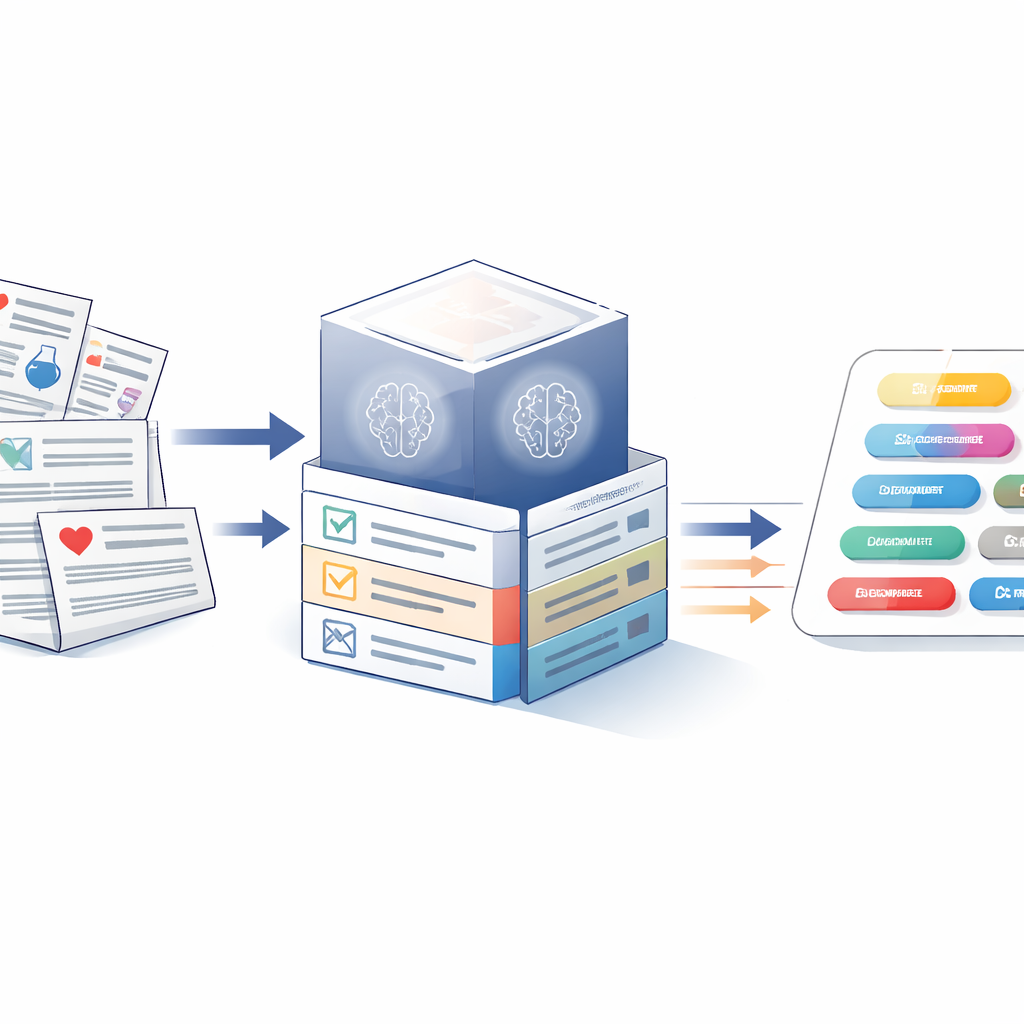

Der erste Teil der Arbeit entwirft ein hochstrukturiertes „statisches“ Prompt—einen wiederverwendbaren Block aus Anweisungen und Beispielen, der dem Modell für jeden zu kennzeichnenden Satz vorgelegt wird. Statt dem Modell einfach zu sagen, Entitäten zu markieren, ist das Prompt in sechs Elemente gegliedert: eine klare Aufgabenbeschreibung und Definitionen der Entitätstypen; eine kurze Beschreibung der Herkunft und Thematik des Datensatzes; häufige Beispielwörter, die für jede Entität typisch sind; optionales medizinisches Hintergrundwissen; zusammengefasste Rückmeldungen aus früheren Modellfehlern; und eine Handvoll vollständig annotierter Beispielsätze. Das Team testete dieses Framework mit drei großen Sprachmodellen—GPT-3.5, GPT-4 und LLaMA 3-70B—an fünf biomedizinischen Datensätzen, die klinische Aufzeichnungen, wissenschaftliche Abstracts und Reddit-Beiträge über Opioidgebrauch abdecken. Das sorgfältige Schichten dieser Komponenten erhöhte die F1-Werte (ein Maß, das Präzision und Recall ausbalanciert) um etwa 11–12 Prozentpunkte gegenüber einem einfachen Prompt, wobei GPT-4 die beste Gesamtleistung erzielte.

Dem Modell erlauben, unterwegs bessere Beispiele nachzuschlagen

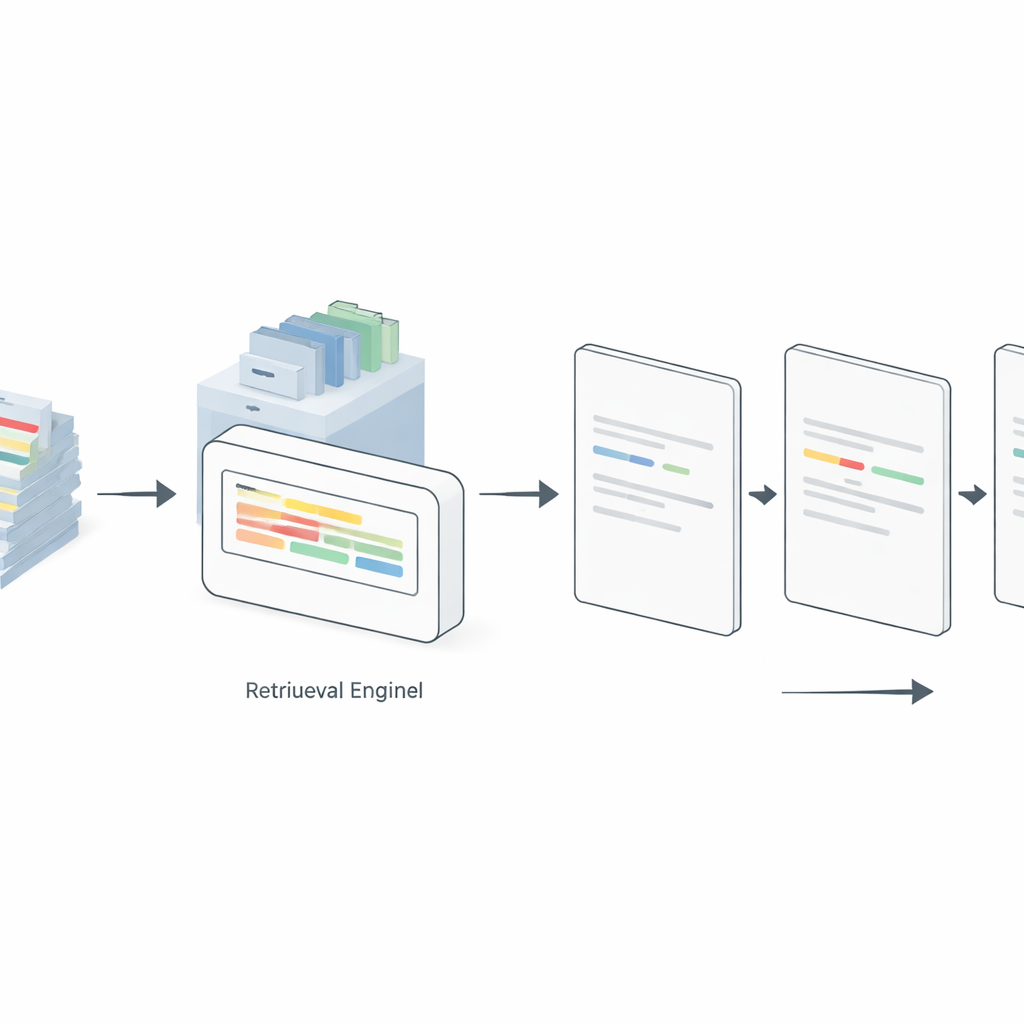

Statische Prompts zeigen jedoch stets dieselben Beispiele, selbst wenn diese schlecht zum neuen zu beschriftenden Satz passen. Um dem zu begegnen, führen die Autoren eine „dynamische“ Prompting-Strategie ein, die durch retrieval-augmented generation angetrieben wird. Hier indexiert eine separate Retrieval-Engine alle verfügbaren annotierten Beispiele. Für jeden neuen Eingangssatz durchsucht das System diesen Pool, findet die ähnlichsten gelabelten Sätze und fügt nur diese in das Prompt ein. Die Studie vergleicht mehrere Retrieval-Methoden, von einem einfachen Term-Frequenz-Schema (TF–IDF) bis zu neuronalen Einbettungsmodellen wie Sentence-BERT (SBERT), ColBERT und Dense Passage Retrieval. Über GPT-4, LLaMA 3 und ein offen verfügbares Modell namens GPT-OSS-120B hinweg übertraf die dynamische Auswahl relevanter Beispiele das statische Prompting in 5-, 10- und 20-Shot-Einstellungen konsequent. Überraschenderweise erreichte die einfache TF–IDF-Methode oft dasselbe Niveau oder übertraf komplexere Ansätze, besonders bei saubereren, standardisierteren Datensätzen, während SBERT auf lauterem Social-Media-Text glänzte.

Mehr erreichen mit weniger gelabelten Beispielen

Da die Annotation medizinischer Texte kostspielig ist, untersuchten die Autorinnen und Autoren auch, wie viele gelabelte Beispiele die Retrieval-Engine mindestens indexieren muss, um nützlich zu sein. Mit LLaMA 3-70B variierten sie den Retrieval-Pool von 50 Beispielen bis hin zum gesamten Trainingssatz. Die Leistung verbesserte sich im Allgemeinen mit wachsendem Pool, aber die Zugewinne flachten schnell ab: Pools von etwa 100–200 Beispielen erreichten nahezu dieselbe Genauigkeit wie die Indexierung aller verfügbaren Daten, oft innerhalb der statistischen Fehlermarge. In einigen Fällen schadeten extrem große Pools leicht der Leistung, vermutlich weil sie mehr irrelevante oder verwirrende Beispiele einbrachten und das Prompt verlängerten. Diese Erkenntnisse deuten darauf hin, dass in Kombination mit einem starken Sprachmodell und gut gestalteten Prompts bereits moderate Annotationsbemühungen eine robuste biomedizinische Entitätenerkennung ermöglichen—und die Methode damit für seltene Krankheiten, neue klinische Konzepte oder Einrichtungen mit begrenzten Ressourcen praktikabel macht.

Was das für die Praxis in der Medizin bedeutet

Insgesamt zeigt die Studie, dass große Sprachmodelle wichtige medizinische Konzepte aus Text zuverlässig erkennen können, selbst mit nur wenigen annotierten Beispielen, sofern sie durch strukturierte Prompts und ein Retrieval-System geleitet werden, das die relevantesten früheren Fälle hervorbringt. GPT-4 bietet die stärkste allgemeine Leistung, während offene und kleinere Modelle dennoch erheblich von derselben Prompt- und Retrieval-Strategie profitieren. Für Praktiker bedeutet das: Sie müssen nicht jedes Mal massive Datensätze erstellen, wenn ein neuer Entitätstyp oder ein neues Gesundheitsproblem auftritt; ein kompakter, sorgfältig kuratierter Beispielsatz plus intelligentes Prompting kann ausreichen. Während Gesundheitssysteme weiterhin Aufzeichnungen digitalisieren und Patientinnen und Patienten ihre Erfahrungen online teilen, könnten solche effizienten, anpassungsfähigen Werkzeuge es deutlich erleichtern, klinisch nützliche Erkenntnisse aus der weiten, unordentlichen Welt medizinischer Texte zu gewinnen.

Zitation: Ge, Y., Guo, Y., Das, S. et al. Improving few-shot named entity recognition for large language models using structured dynamic prompting with retrieval augmented generation. npj Artif. Intell. 2, 39 (2026). https://doi.org/10.1038/s44387-025-00062-2

Schlüsselwörter: biomedizinische Named-Entity-Recognition, Few-Shot-Lernen, große Sprachmodelle, retrieval-augmented generation, klinisches Text-Mining