Clear Sky Science · de

In ihren eigenen Worten: Fallstudien zur Sprache auf Smartphones von Jugendlichen vor suizidbezogenen Krankenhausaufenthalten

Warum die Texte Ihres Teenagers vielleicht mehr bedeuten, als Sie denken

Da Smartphones zu ständigen Begleitern werden, zeichnen sie beiläufig die alltäglichen Worte, Stimmungen und Sorgen junger Menschen auf. Diese Studie stellt eine drängende Frage: Kann die Sprache, die Jugendliche in den Wochen und Tagen vor einer psychischen Krise auf ihren Telefonen tippen, anzeigen, wann sie akut gefährdet sind, einen Suizidversuch zu unternehmen? Anhand realer Textmuster von Hochrisiko‑Jugendlichen untersuchen die Forschenden, ob Werkzeuge der künstlichen Intelligenz Kliniker dabei unterstützen können, kurzzeitige Warnzeichen zu erkennen — und wo diese Werkzeuge noch versagen.

Fünf Jugendliche durch einen gefährlichen Monat begleitet

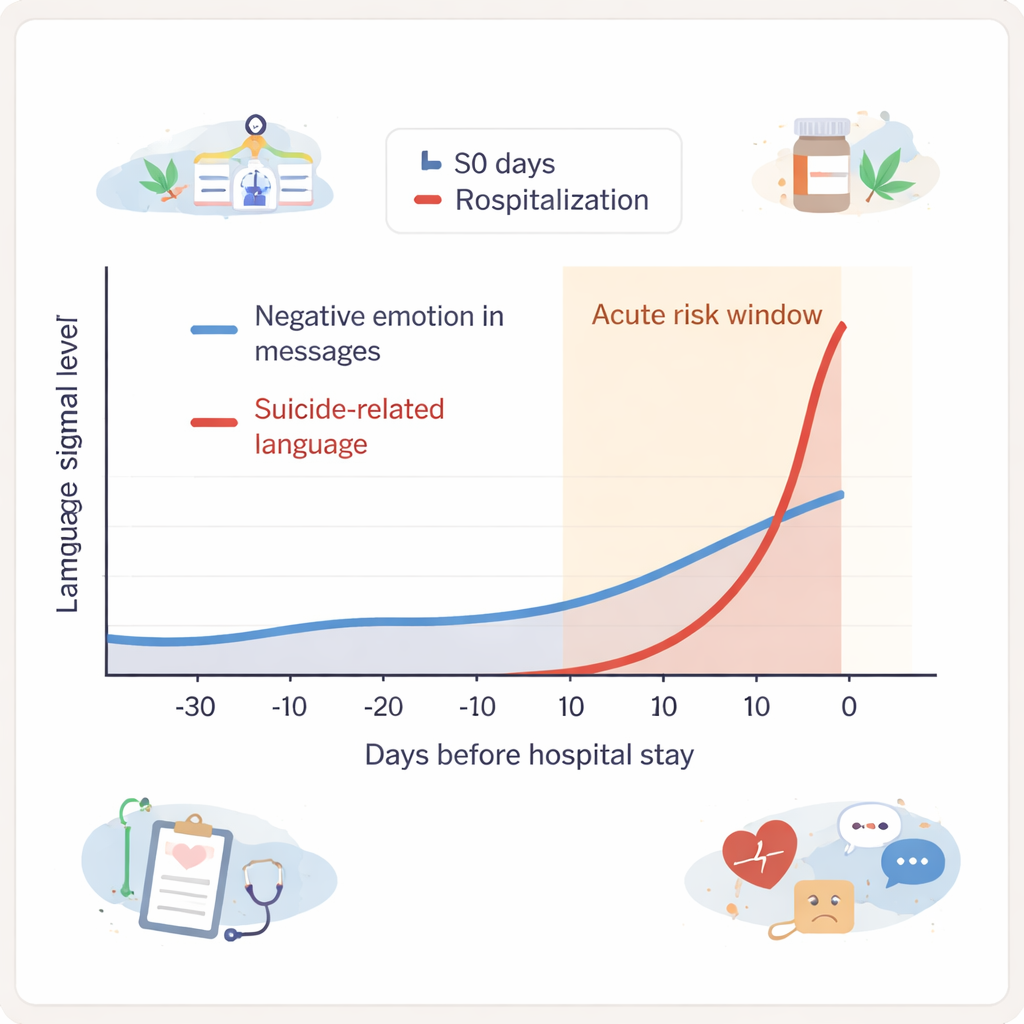

Die Studie konzentrierte sich auf fünf Jugendliche, die bereits als hochrisikobehaftet eingestuft wurden und später wegen suizidbezogener Vorfälle hospitalisiert wurden. Etwa sechs Monate lang zeichnete eine im Hintergrund laufende App auf ihren eigenen Handys alles auf, was sie über die Tastatur eintippten — Nachrichten, Suchanfragen, Notizen — wobei eingehende Nachrichten von anderen nicht erfasst wurden. Im Schnitt wurden über 21.000 ausgehende Texte pro Jugendlichem gesammelt und stark de‑identifiziert, um die Privatsphäre zu schützen. Die Forschenden zoomten dann auf die 30 Tage vor jeder Hospitalisierung: diese Periode wurde in eine 20‑tägige „Baseline“‑Phase und eine 10‑tägige „akute Risiko“‑Phase unmittelbar vor dem Klinikaufenthalt unterteilt.

Was die Worte vor der Krise offenbarten

Mit Hilfe der natürlichen Sprachverarbeitung (NLP) suchte das Team nach mehreren Signalarten in den getippten Texten. Ein Werkzeug durchsuchte die Texte nach suizidbezogener Sprache mithilfe eines jugendzentrierten Wörterbuchs, das nicht nur Standardphrasen, sondern auch Slang und Emojis erkannte. Ein anderes Tool, basierend auf modernen KI‑Modellen, schätzte ein, ob Nachrichten negative Emotionen ausdrückten. Eine dritte Methode gruppierte Nachrichten in breite Themenfelder wie Schule, Behandlung, Schlaf, Substanzgebrauch oder Tod. Bei vier der fünf Jugendlichen nahmen sowohl suizidbezogene Sprache als auch negative Emotionen in den zehn Tagen vor der Hospitalisierung im Vergleich zum individuellen Durchschnitt über die Studiendauer zu. Suizidbezogene Sprache stieg häufig in den letzten fünf Tagen stark an, während negative Emotionen über die letzten zehn Tage allmählicher zunahmen.

Signale des Risikos — und Signale von Leid

Die Muster waren vielversprechend, aber kompliziert. Dieselben Warnzeichen — suizidale Formulierungen und düstere Tonalität — traten auch außerhalb des unmittelbaren Krisenfensters auf. Das deutet darauf hin, dass diese Signale Zeiträume ernsthaften Leidens markieren können, aber nicht immer Momente, in denen ein Suizidversuch unmittelbar bevorsteht. Als Kliniker die Textverläufe direkt überprüften, stellten sie fest, dass Spitzen in suizidbezogener Sprache oft mit suizidalen Gedanken, tatsächlichen Versuchen oder dringender Hilfesuche zusammenfielen. Thematische Modelle erfassten nützliche Themen wie Substanzgebrauch und Behandlungsgespräche, die manchmal mit riskanten Momenten zusammenfielen.

Was Computer übersehen, das Menschen sehen

Die KI‑Werkzeuge verfehlten jedoch häufig Probleme, die Kliniker als zentrale Auslöser betrachteten, etwa Streit mit Freundinnen und Freunden oder der Familie, Mobbing, romantische Konflikte oder Gefühle von Zurückweisung. Solche Situationen spielten sich über viele kurze Nachrichten hinweg ab, und die Modelle behandelten meist jede einzelne Eingabe isoliert, ohne die größere Erzählung zu erfassen. Dadurch entgingen zwischenmenschliche Konflikte, Veränderungen in der Bewertung wichtiger Ereignisse durch die Jugendlichen oder subtile Verschiebungen vom Scherz über Suizid hin zu ernsthafter Verzweiflung oft den Algorithmen. Die Forschenden argumentieren, dass zukünftige Systeme mehr leisten müssen als das Lesen einzelner Nachrichten: Sie sollten Gespräche über die Zeit verbinden und idealerweise Text mit anderen passiven Daten wie Schlafmustern oder Bewegungsdaten kombinieren, um die Genauigkeit zu verbessern.

Ausblick: Potenzial mit wichtigen Grenzen

Diese Arbeit zeigt, dass Smartphone‑Sprache ein reiches, wenig belastendes Fenster in das Erleben von Jugendlichen zwischen Klinikbesuchen bieten kann. Automatisierte Methoden erkennen bereits offensichtliche Warnsignale — direkte suizidale Äußerungen und stark negative Emotionen — insbesondere in den Tagen unmittelbar vor einer Krise, ziemlich zuverlässig. Sie sind jedoch deutlich weniger in der Lage, den persönlichen, sozialen und situativen Kontext zu erfassen, den menschliche Kliniker zur Risikobewertung nutzen. Für Familien und Fachkräfte lautet die Botschaft zweigleisig: Digitale Sprachdaten könnten eines Tages helfen, gefährdeten Jugendlichen früher und zeitgerecht Unterstützung zukommen zu lassen, müssen dafür aber mit großer Sorgfalt, starken Datenschutzmaßnahmen und in Zusammenarbeit mit Klinikern entwickelt werden — nicht als Ersatz für diese.

Zitation: Treves, I.N., Bloom, P.A., Salem, S. et al. In their own words: case studies of adolescent smartphone language preceding suicide-related hospitalizations. NPP—Digit Psychiatry Neurosci 4, 5 (2026). https://doi.org/10.1038/s44277-026-00057-0

Schlüsselwörter: Suizidrisiko bei Jugendlichen, Smartphone‑Sprache, digitale Phänotypisierung, natürliche Sprachverarbeitung, Überwachung der psychischen Gesundheit