Clear Sky Science · de

Fairness-Analyse maschineller Lernvorhersagen von Aggression in der akutpsychiatrischen Versorgung

Warum das für echte Menschen wichtig ist

Krankenhäuser setzen zunehmend künstliche Intelligenz ein, um zu erkennen, welche Patientinnen und Patienten aggressiv werden könnten, in der Hoffnung, Schaden zu verhindern, ohne zu traumatisierenden Fixierungen greifen zu müssen. Wenn diese Vorhersagewerkzeuge jedoch unfair sind, können sie die bestehenden Ungleichheiten verschärfen, die bereits beeinflussen, wer als „gefährlich“ wahrgenommen wird. Diese Studie stellt eine drängende Frage: Behandelt eine Maschine, die mitentscheidet, wer in einer psychiatrischen Station als hochriskant gilt, alle Patientengruppen gleich?

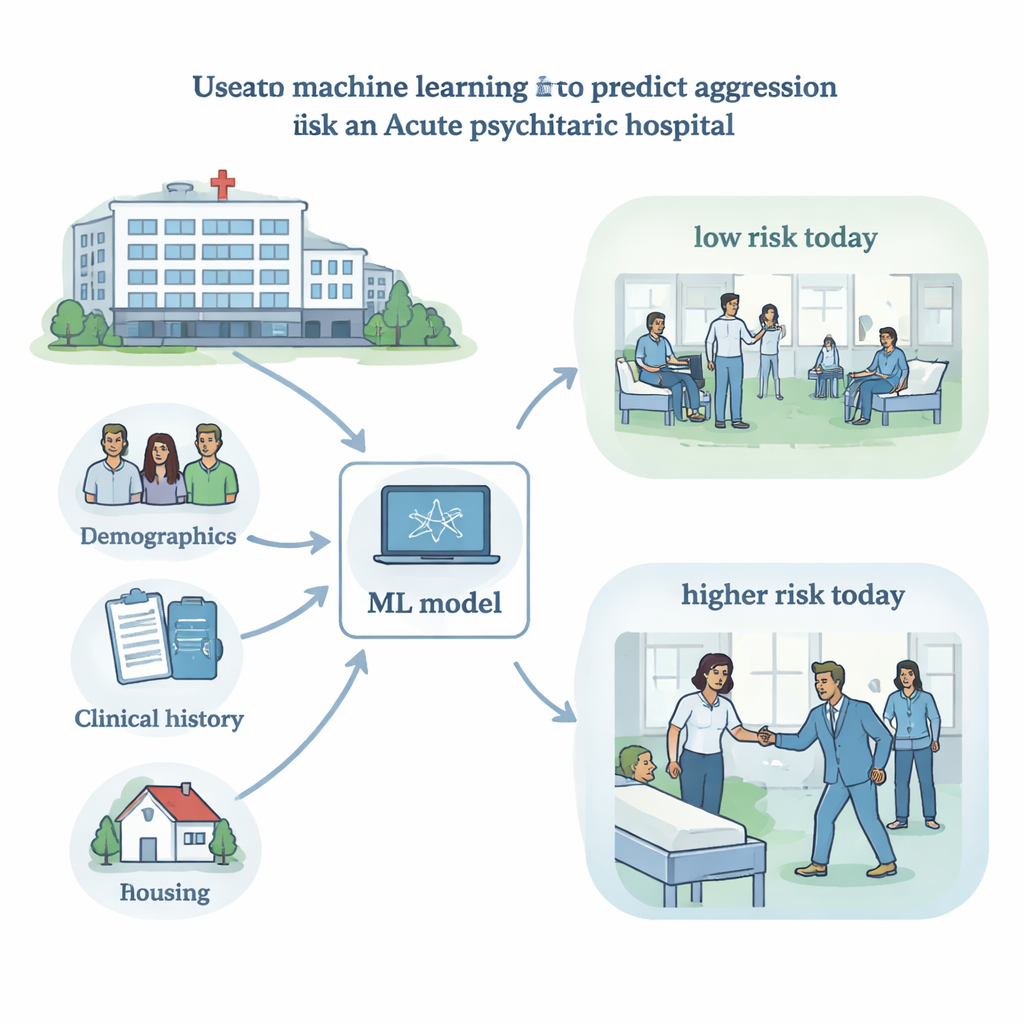

Krankenhausdaten zur Markierung kurzfristiger Risiken

Die Forschenden analysierten Aufzeichnungen von mehr als 17.000 Patientinnen und Patienten, die zwischen 2016 und 2022 auf Akutpsychiatrie-Stationen eines großen kanadischen psychiatrischen Krankenhauses behandelt wurden. Für bis zu drei Tage während eines Krankenhausaufenthalts erfasste das Personal eine standardisierte Bettenrand-Checkliste namens Dynamic Appraisal of Situational Aggression (DASA), die Verhaltensweisen wie Reizbarkeit oder verbale Drohungen bewertet, die auf unmittelbar bevorstehende Aggression hindeuten könnten. Das Team kombinierte diese Werte mit bei der Aufnahme erhobenen Informationen – etwa Diagnose, Alter, Geschlecht, Rasse oder ethnische Zugehörigkeit, Wohnsituation und wie die Person ins Krankenhaus gelangte – und trainierte ein maschinelles Lernmodell, das vorhersagte, ob die Patientin oder der Patient in den nächsten 24 Stunden an einem aggressiven Zwischenfall (einschließlich Einsatz von Fixierungen oder Einzelzimmerunterbringung) beteiligt sein würde.

Wie das Vorhersagewerkzeug insgesamt abschnitt

Das leistungsfähigste System verwendete eine verbreitete Methode des maschinellen Lernens, den Random Forest. Auf zurückbehaltenen Testdaten ordnete es riskantere Tage häufig richtig höher ein und erzielte eine Fläche unter der Kurve (AUC) von etwa 0,81, vergleichbar mit ähnlichen Instrumenten in der Psychiatrie. Aggressionen waren jedoch selten – es gab etwa 33 Tage ohne Vorfälle für jeden Tag mit einem Vorfall – sodass das Modell trotzdem viele tatsächliche Ereignisse verfehlte und einige Fehlalarme erzeugte. Wichtigkeitsmaße zeigten, dass kurzfristige klinische Faktoren, insbesondere DASA-Items wie Reizbarkeit und kürzlich erfolgte frühere Zwischenfälle, am stärksten zu den Vorhersagen beitrugen, nicht allein demografische Merkmale. Das bedeutet, dass das Modell klinisch bedeutsame Warnsignale erfasste, die reinen Leistungskennzahlen jedoch nicht offenbarten, ob es für alle gleichermaßen vertrauenswürdig war.

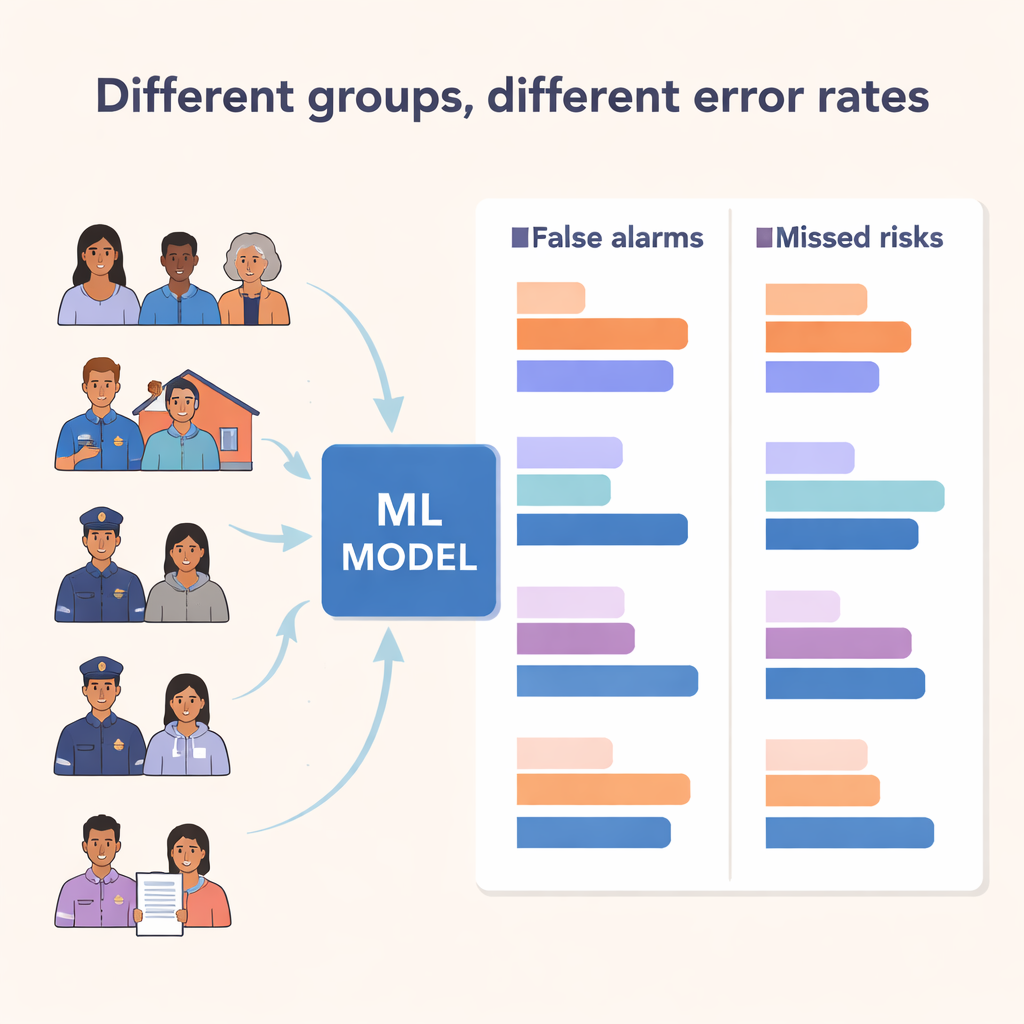

Ungleiche Fehlerquoten zwischen Gruppen

Der Kern der Studie war ein Fairness-Check. Das Team konzentrierte sich auf zwei Fehlertypen: False Positives, also Fälle, in denen das Modell ein Risiko meldet, es aber nicht zu einem Vorfall kommt, und True Positives, also korrekt vorhergesagte Vorfälle. Ein faires Modell sollte nach einem häufig verwendeten Standard namens „equalized odds“ ähnliche False‑Positive‑ und True‑Positive‑Raten über Gruppen hinweg aufweisen. Stattdessen fanden die Forschenden große Unterschiede. Fehlalarme (False Positives) waren höher bei Patientinnen und Patienten mit Herkunft aus dem Nahen Osten und bei Schwarzen Patientengruppen, bei Männern, bei Personen, die von der Polizei ins Krankenhaus gebracht wurden, sowie bei Obdachlosen oder Personen in betreutem Wohnen. Einige Gruppen – etwa Patientinnen und Patienten, die durch die Polizei eingeliefert wurden, oder Menschen mit instabiler Wohnsituation – wiesen sowohl höhere Erkennungsraten als auch höhere Fehlalarmraten auf, was darauf hindeutet, dass das Modell für diese Gruppen besonders sensibel eingestellt war. Andere, wie Schwarze Patientinnen und Patienten, erlebten eine beunruhigende Kombination: mehr Fehlalarme und eine schlechtere Fähigkeit, wahre Risiken korrekt zu identifizieren.

Wenn Identitäten sich überschneiden, werden Unterschiede größer

Weil die Erfahrungen von Menschen durch mehr als eine Eigenschaft gleichzeitig geprägt werden, untersuchten die Forschenden auch überlappende Identitäten, insbesondere die Kombination aus Rasse oder ethnischer Zugehörigkeit und Geschlecht. Hier zeigte sich die größte Warnung bei Männern aus dem Nahen Osten, die die höchste False‑Positive‑Rate aller Gruppen hatten, während Frauen aus dem Nahen Osten dies nicht taten. Schwarze und indigene Männer wiesen ebenfalls im Vergleich zu Frauen derselben Herkunft erhöhte Fehlalarmraten auf. Diese Muster spiegeln gut dokumentierte Ungleichheiten in der psychiatrischen Versorgung wider, etwa höhere Raten polizeilicher Interventionen, unfreiwilliger Aufnahmen und Fehldiagnosen bei bestimmten rassifizierten Gruppen und Männern. Das maschinelle Lernsystem hat diese Ungleichheiten nicht geschaffen, aber es lernte aus Daten, die davon durchdrungen waren – und lief Gefahr, sie in klinischen Entscheidungen zu verstärken.

Was das für die zukünftige KI in der Psychiatrie bedeutet

Die Autorinnen und Autoren plädieren dafür, Fairness‑Analysen als zentrale Sicherheitsprüfung zu behandeln, nicht als optionales Extra, bevor ein Vorhersagewerkzeug in die Praxis eingeführt wird. Sie verweisen darauf, dass technische „Debiasing“-Methoden – etwa das Anpassen von Trainingsdaten oder das Festlegen unterschiedlicher Alarmgrenzwerte für verschiedene Gruppen – helfen können, aber an ihre Grenzen stoßen, wenn die zugrunde liegenden Aufzeichnungen bereits ungleiche Behandlung und coercive Praktiken widerspiegeln. Letztlich ist die Frage, was ein „faires“ Modell ausmacht, nicht nur ein mathematisches Problem; sie ist eine soziale und ethische Frage, die Einbeziehung von Patientinnen und Patienten, Klinikpersonal und Gemeinschaften erfordert. Die Studie zeigt, dass maschinelles Lernen zwar helfen kann, das kurzfristige Aggressionsrisiko zu erkennen, aber zugleich strukturellen Rassismus, Sexismus und Wohnungsungleichheiten stillschweigend reproduzieren kann, sofern Fairness nicht sorgfältig gemessen, diskutiert und angegangen wird.

Zitation: Wang, Y., Sikstrom, L., Xiao, R. et al. Fairness analysis of machine learning predictions of aggression in acute psychiatric care. npj Mental Health Res 5, 16 (2026). https://doi.org/10.1038/s44184-026-00194-6

Schlüsselwörter: algorithmische Fairness, psychiatrische Aggression, maschinelles Lernen im Gesundheitswesen, gesundheitliche Ungleichheiten, Risiko‑Vorhersagemodelle