Clear Sky Science · de

Alle Augen, kein IMU: Fluglage nur aus Vision lernen

Sehen wie ein Insekt

Kleine Flugsysteme verlassen sich üblicherweise auf winzige Bewegungssensoren, um sich aufrecht zu halten — ein bisschen wie ein Innenohr für Maschinen. Insekten schaffen jedoch wendige Flüge mit deutlich einfacherer Hardware und stützen sich stark auf das, was sie sehen. Diese Studie zeigt, dass eine Drohne Ähnliches leisten kann: stabil fliegen allein mithilfe einer speziellen Kamera und einem kompakten künstlichen Gehirn, ganz ohne die üblichen Bewegungssensoren. Dieser Ansatz könnte künftige handflächengroße und insektenähnliche Drohnen leichter, günstiger und robuster machen.

Warum auf die üblichen Sensoren verzichten?

Die Lageregelung — also das Halten der Drohne in der richtigen Neigung zur Schwerkraft — wird normalerweise von einer Bordeinheit übernommen, die Beschleunigung und Rotation misst. Diese Trägheitssensoren funktionieren gut, bringen aber Gewicht, Stromverbrauch und einen einzelnen möglichen Ausfallpunkt mit sich. Im Gegensatz dazu besitzen viele fliegende Insekten keinen dedizierten Schwerkraftsensor und ziehen stattdessen Hinweise auf ihre Neigung daraus, wie sich die Welt über ihre Augen bewegt. Wenn Roboter diesen Trick nachahmen könnten, bräuchten sehr kleine Flieger möglicherweise nur noch Vision zum Sehen und Balancieren — was das Design vereinfacht und das Herunterskalieren in Richtung Insektenmaßstab erleichtert.

Eine Kamera, die nur Veränderungen sieht

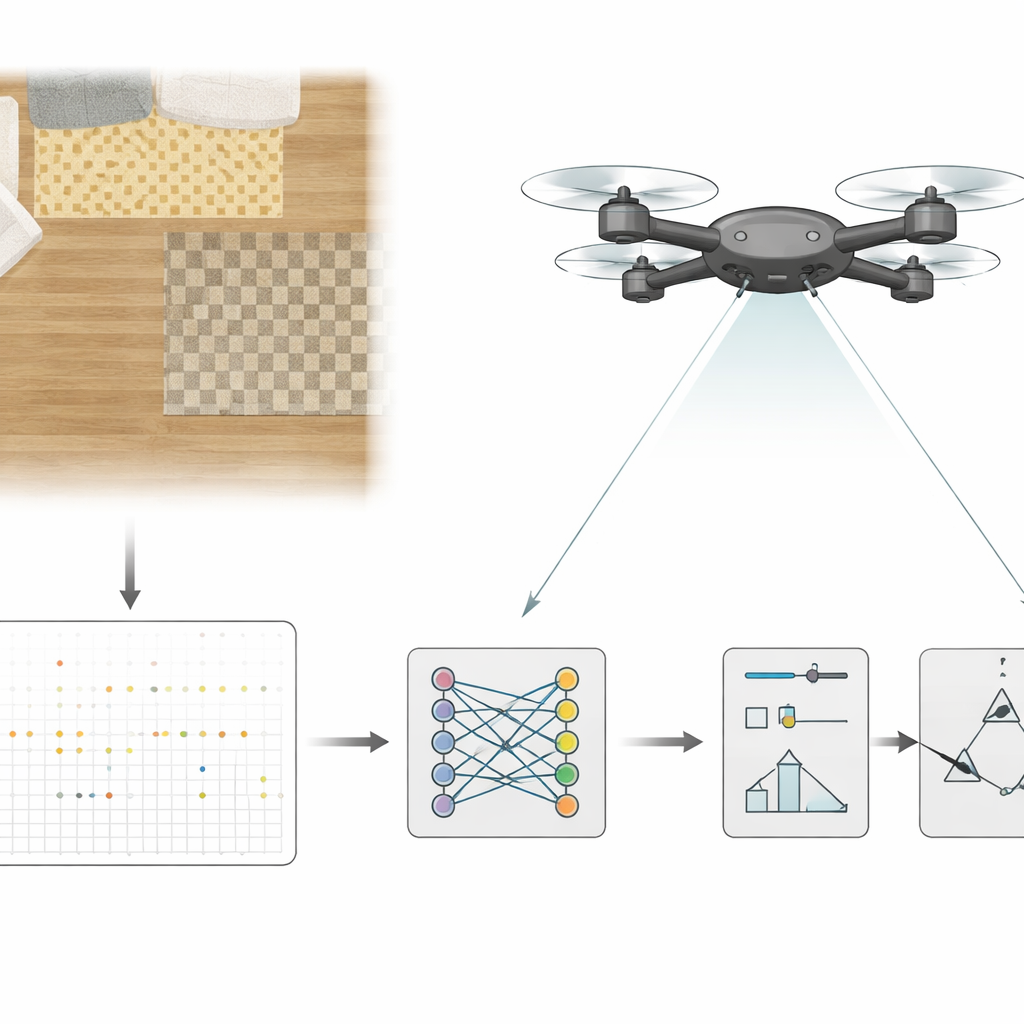

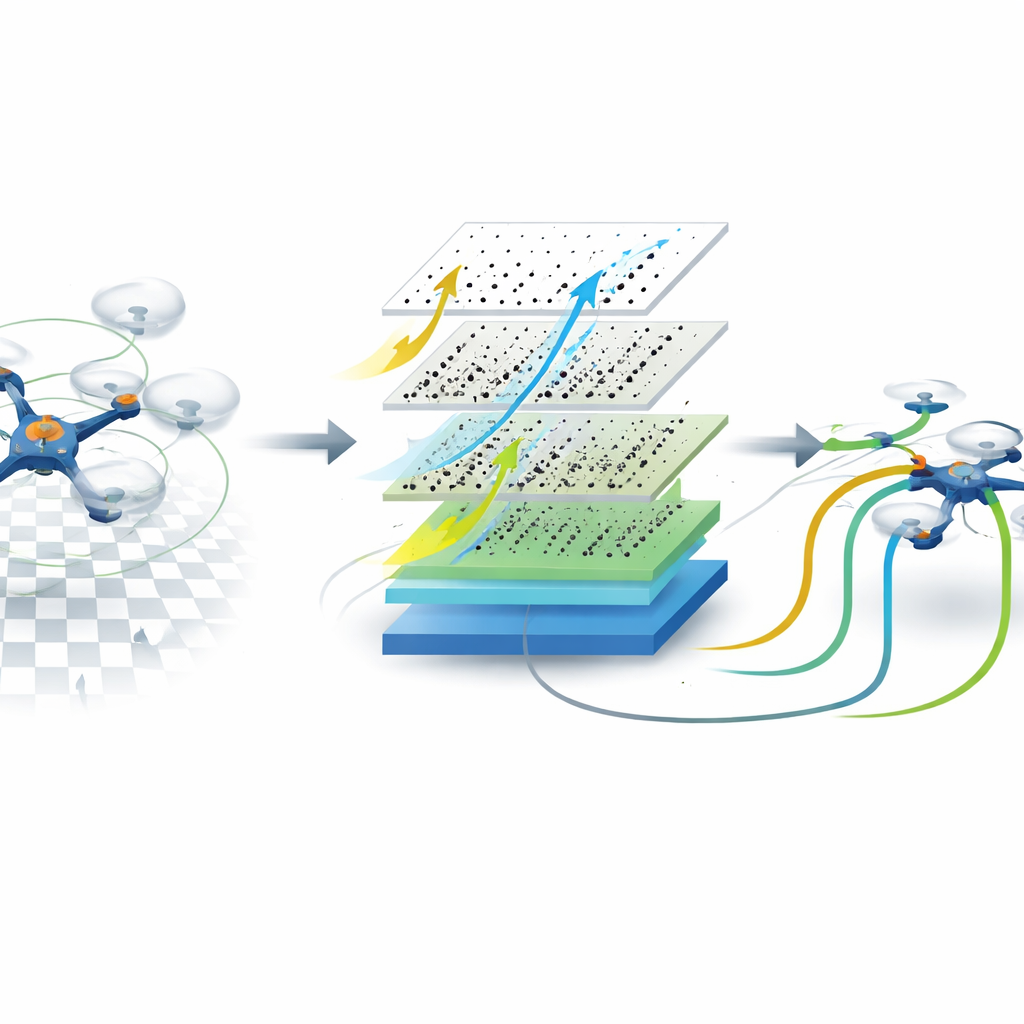

Statt einer herkömmlichen Videokamera verwenden die Forschenden eine ereignisbasierte Kamera, die von der Drohne nach unten gerichtet ist. Anstatt vollständige Bilder in festen Intervallen zu liefern, meldet dieser Sensor nur winzige Helligkeitsänderungen an jedem Pixel — und das extrem schnell. Der Ereignisstrom wird in kurze Abschnitte gebündelt, von jeweils nur fünf Tausendstelsekunden, und diese Schnipsel werden einem kleinen rekurrenten Faltungsnetzwerk zugeführt, das auf einem Bord‑Grafikchip läuft. Im Lauf der Zeit lernt das Netzwerk, Muster visueller Veränderungen in Schätzungen zur Neigung der Drohne und ihrer Rotationsgeschwindigkeit zu übersetzen und ersetzt so effektiv die traditionelle Trägheitseinheit in der Regelungsschleife.

Der Drohne beibringen, allein mit Vision zu balancieren

Um dieses künstliche Gehirn zu trainieren, flog das Team den Quadrotor zunächst in einer Halle, während weiterhin eine konventionelle Sensorik eingesetzt wurde. Während dieser Flüge zeichneten sie den Ereignisstrom der Kamera zusammen mit den Neigungs‑ und Rotationswerten auf, die der Standardcontroller schätzte. Anschließend trainierten sie das Netzwerk überwacht darauf, diese Werte allein aus den visuellen Daten nachzubilden. In späteren Tests kehrten sich die Rollen um: Die Drohne flog mit den Schätzungen des Netzwerks in der Regelungsschleife, während unabhängige Motion‑Capture‑Systeme oder Bordmessungen nur noch dazu dienten, die Performance zu bewerten. Das System hielt die Drohne schwebend und folgte pilotgeführten Bahnen für Minuten am Stück, wobei die meisten Neigungsfehler nur wenige Grad betrugen und die Rotationsfehler im moderaten Bereich lagen — ausreichend für stabilen Flug.

Ein Blick in die erlernte visuelle Fähigkeit

Die Forschenden untersuchten, was diese reine Sichtsteuerung am besten funktionieren lässt. Sie verglichen verschiedene Netzwerkarchitekturen, fügten zusätzliche Eingaben wie Motordrehzahlen oder Gyrosignale hinzu bzw. entfernten sie und variierten, wie viel des Kamerasichtfeldes genutzt wurde. Netze mit Gedächtnis — die visuelle Information über die Zeit integrieren können — waren entscheidend, um schnelle Rotation genau zu verfolgen, während gedächtnislose Varianten Schwierigkeiten hatten. Ein großes Sichtfeld, das am Bildrand fernere, horizon‑ähnliche Hinweise zeigt, führte in vertrauten Szenen zu den geringsten Rohfehlern. Überraschenderweise bewirkte jedoch die Beschränkung des Netzwerks auf den zentralen Bildbereich, wo solche statischen Hinweise fehlen, dass es sich stärker auf Bewegungsmuster statt auf Szenenerscheinung stützte. Zwar verringerte das die absolute Genauigkeit, verbesserte jedoch, wie geschmeidig das System sich an sehr unterschiedliche Umgebungen anpasste, was darauf hindeutet, dass ein internes Bewegungsverständnis erlernt wurde.

Auf dem Weg zu winzigen, vision‑zentrierten Flugsrobotern

Insgesamt zeigt die Arbeit, dass eine Drohne sich allein mithilfe dessen, was sie sieht, aufrecht und kontrollierbar halten kann, ganz ohne Trägheitssensor. Durch die Kombination einer Event‑Kamera mit einem kompakten neuronalen Netzwerk erreicht das System die Geschwindigkeit und Reaktionsfähigkeit, die für Echtzeitregelung nötig sind, während Hardwaregewicht und Komplexität reduziert werden. Für interessierte Leser lautet die Kernbotschaft: Zukünftige Schwärme winziger, insektenähnlicher Flugsroboter könnten mit nur einem schlauen Auge balancieren und navigieren — ähnlich wie Insekten — und so den Weg zu leichteren, energieeffizienteren Maschinen öffnen, die sicher unübersichtliche, unvorhersehbare Räume erkunden können.

Zitation: Hagenaars, J.J., Stroobants, S., Bohté, S.M. et al. All eyes, no IMU: learning flight attitude from vision alone. npj Robot 4, 21 (2026). https://doi.org/10.1038/s44182-026-00081-4

Schlüsselwörter: visionsbasierte Flugsteuerung, Event-Kamera Drohnen, bioinspirierte Robotik, neuronale Netzsteuerungen, Insektenmaßstab UAVs