Clear Sky Science · de

GenHand: generalisiertes kinematisches Retargeting menschlicher Greifbewegungen

Robotern beibringen, Dinge so zu halten wie wir

Vom Aufheben einer Kaffeetasse bis zum Drehen eines Schraubenziehers lassen unsere Hände den Umgang mit Gegenständen mühelos erscheinen. Roboter tun sich dagegen oft schwer, Alltagsgegenstände zuverlässig zu greifen — besonders wenn ihre Greifer überhaupt nicht wie eine menschliche Hand aussehen. Dieser Artikel stellt GenHand vor, ein System, das aus menschlichen Handbewegungen in gewöhnlichen Bildern lernt und diese in stabile, menschenähnliche Griffe für viele verschiedene Typen von Roboterhänden übersetzt.

Warum Roboterhände mehr brauchen als Nachahmerbewegungen

Viele heutige Teleoperations- und Imitationslern‑Systeme versuchen, die Pose einer menschlichen Hand direkt auf eine Roboterhand zu übertragen. Sie gleichen Fingertip‑Positionen und Gelenkwinkel so genau wie möglich an. Das funktioniert nur, wenn die Roboterhand der menschlichen Hand stark ähnelt und eine ähnliche Anzahl an Fingern und Gelenken hat. Sobald der Robotergreifer einfacher ist — zum Beispiel nur zwei flache Finger — kann die übernommene Pose keinen sicheren Griff mehr erzeugen. Solche Ansätze ignorieren außerdem weitgehend die Form des Objekts und wo fester Kontakt nötig ist, sodass die resultierenden Griffe abrutschen, das Gleichgewicht verlieren oder die Oberfläche nie richtig berühren können.

Hand und Objekt gemeinsam betrachten

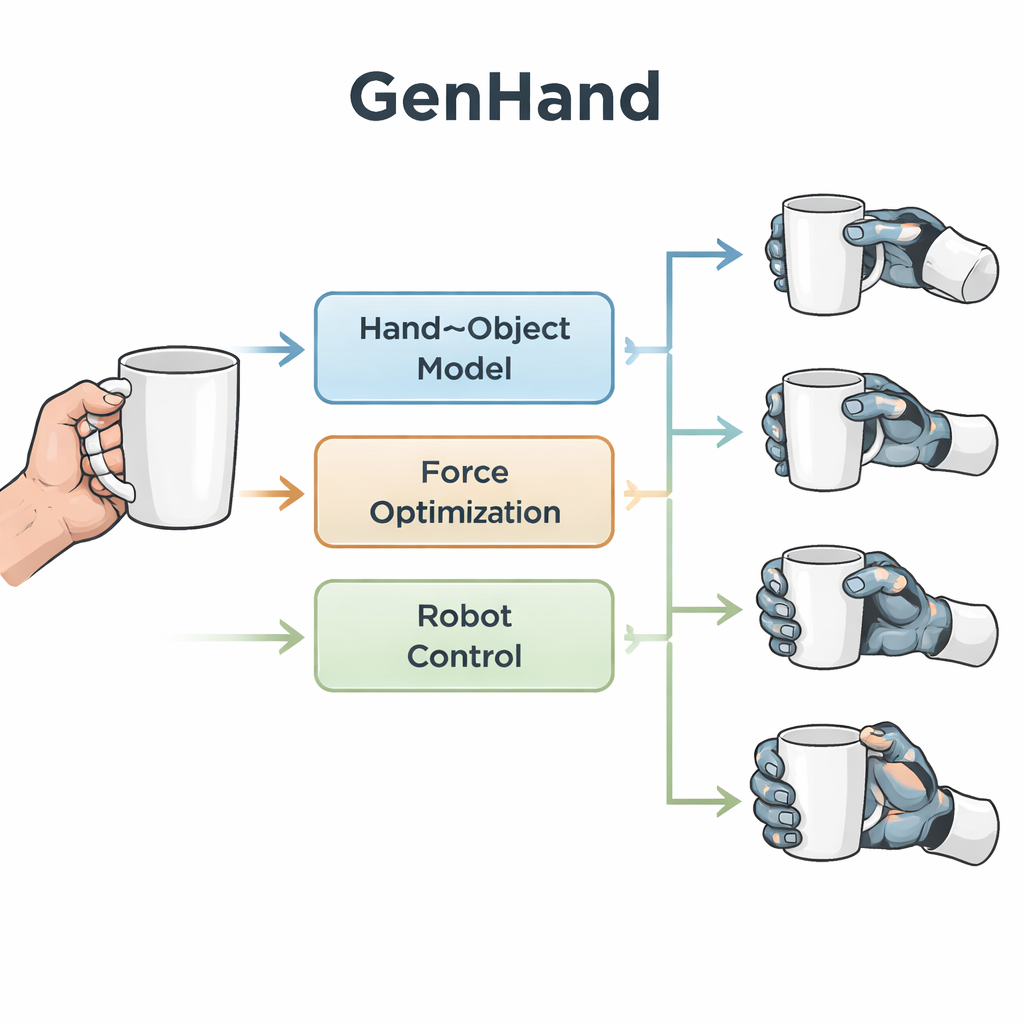

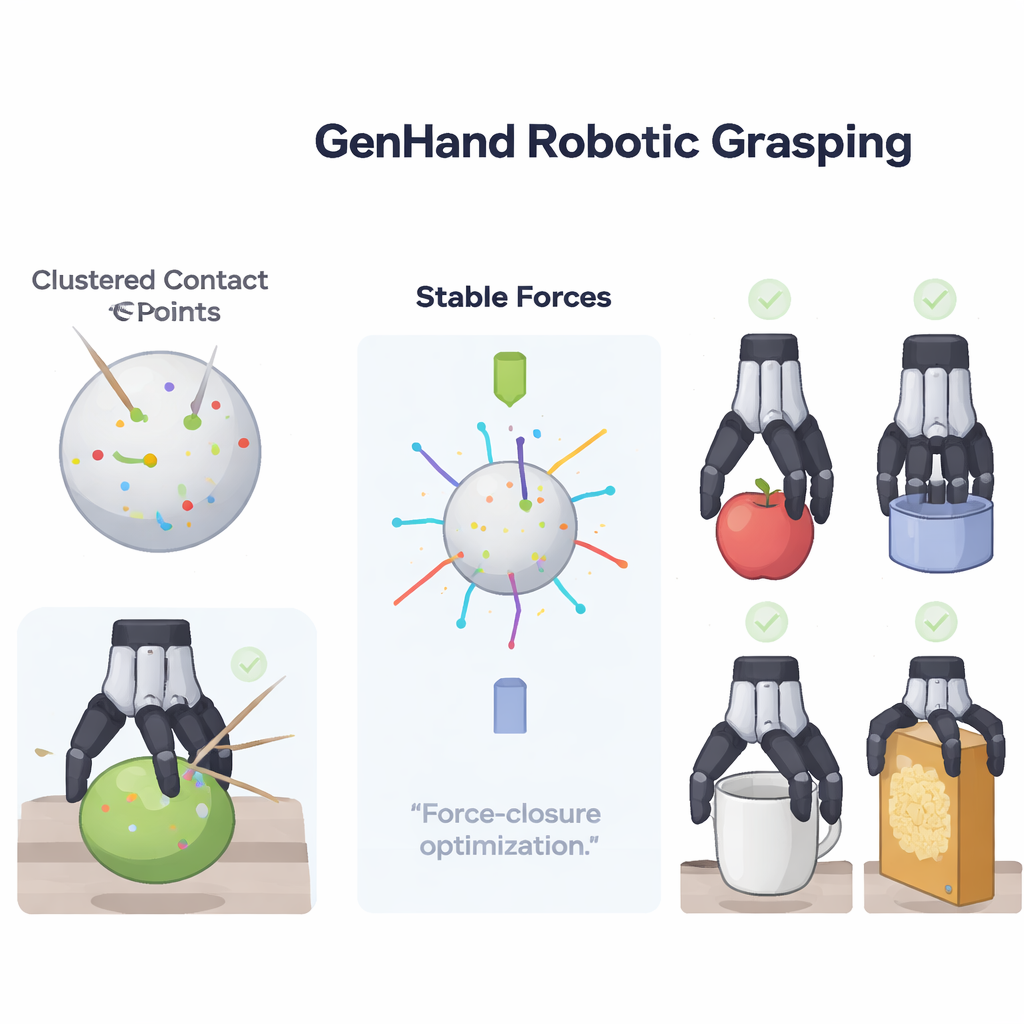

GenHand begegnet diesem Problem, indem es die Interaktion zwischen Hand und Objekt in den Mittelpunkt stellt, nicht nur die Handform. Aus einem normalen RGB-Bild rekonstruiert das System ein detailliertes 3D-Modell des Objekts und ein parametrisches 3D-Modell der menschlichen Hand. Ein neuronales Netzwerk schätzt die Handpose, und eine fortgeschrittene "signed distance"-Darstellung liefert die Objektoberfläche. Aus diesem Modellpaar bestimmt GenHand, wo die menschlichen Fingerspitzen tatsächlich Kontakt haben und in welche Richtungen sie auf das Objekt drücken. Anschließend gruppiert es diese Kontaktpunkte in eine kleine Menge bedeutungsvoller Regionen und Kraftrichtungen, die die wesentliche Struktur des menschlichen Griffs zusammenfassen und unnötige Details herausfiltern.

Den Griff für jeden Roboter neu erfinden

Sobald GenHand die wichtigen Kontaktregionen und ihre Stützwirkung für das Objekt erkannt hat, erstellt es eine neue Menge von "Kontaktankern", die zum jeweiligen Robotergreifer passen. Für einen einfachen Zwei‑Finger‑Greifer behält es möglicherweise nur zwei gegenüberliegende Kontaktregionen bei, wie ein Paar Daumen, das eine Schachtel zusammendrückt. Für geschicktere Hände mit drei, vier oder fünf Fingern kann es zusätzliche Anker zuweisen, um das reichhaltige Kontaktmuster des menschlichen Griffs besser nachzubilden. Ein mathematischer Optimierungsschritt sucht dann nach Kontaktpunkten auf der Objektoberfläche, die Kräfte und Momente in alle Richtungen ausbalancieren können — eine Eigenschaft, die als Kraftschluss (force closure) bekannt ist. Entscheidend ist, dass GenHand nahe an den ursprünglichen menschlichen Kontakten bleibt, dabei aber sicherstellt, dass der resultierende Griff in der realen Welt physikalisch stabil wäre.

Von stabilen Kontakten zu realen Roboterbewegungen

Mit den stabilen Kontaktankern findet eine zweite Optimierungsstufe tatsächliche Gelenkwinkel und Handgelenksbewegungen des Roboters, die diese Anker realisieren können, ohne Gelenkgrenzen zu verletzen oder Kollisionen mit dem Objekt zu verursachen. Dazu stimmt GenHand wiederholt mögliche Kontaktstellen des Roboters mit den gewünschten Ankern ab, passt die Pose an und prüft, ob Glieder in das Objekt eindringen. Dieser Prozess wird auf eine Reihe von Roboterhänden angewandt — vom einfachen Robotiq‑Zweifingergreifer bis zur hoch artikulierten Shadow‑Hand mit fünf Fingern — und in Physiksimulationen getestet. Im Vergleich zu einer führenden Baseline, die nur die Fingertip‑Geometrie nachahmt, erzielt GenHand deutlich geringere Kraftungleichgewichte, genauere Oberflächenkontakte und wesentlich höhere Erfolgsraten beim Heben und Halten von 20 Alltagsobjekten unter verschiedenen Reibungsbedingungen.

Wohin das alltägliche Roboter führen könnte

Für den Laien bedeutet das: GenHand vermittelt Robotern ein besseres Verständnis davon, "wie" man Dinge hält, nicht nur "wo" man die Finger platzieren sollte. Indem es aus echten menschlichen Griffen lernt und grundlegende Regeln physikalischer Stabilität durchsetzt, kann es dieselbe menschliche Demonstration auf sehr unterschiedliche Roboterhände übertragen und dennoch feste, verlässliche Griffe erzielen. Das macht teleoperierte Roboter leichter steuerbar, hilft Lernsystemen, anreichhaltigeren Trainingsdaten zu verwenden, und bringt uns näher an Haushalts‑ und Arbeitsroboter, die sicher dieselbe große Vielfalt an Gegenständen manipulieren können wie Menschen.

Zitation: Qi, L., Popoola, O., Imran, M.A. et al. GenHand: generalised human grasp kinematic retargeting. npj Robot 4, 19 (2026). https://doi.org/10.1038/s44182-026-00076-1

Schlüsselwörter: robotisches Greifen, Teleoperation, menschliche Demonstration, Roboterhände, Manipulation