Clear Sky Science · de

Modellprädiktive Spielsteuerung für personalisierte und zielgerichtete interaktive Assistenz

Roboter, die sich wie gute Trainingspartner anfühlen

Stellen Sie sich einen Trainingspartner oder Physiotherapeuten vor, der immer weiß, wann er Ihnen beim Heben helfen muss, wann er Sie ein wenig kämpfen lassen sollte und wie stark Sie als Nächstes zu bewegen planen. Dieses Papier zeigt, wie man Kontaktroboter – etwa Exoskelette in der Rehabilitation oder in Fabriken – mit einer ähnlichen Intuition ausstattet. Indem der Roboter mathematisch "vorausahnt", wie eine Person sich in der nächsten Sekunde bis zu zwei Sekunden bewegen will, kann er die Anstrengung flüssig teilen, Ermüdung verringern und auf subtile Weise beeinflussen, wie Menschen sich bewegen und lernen.

Warum das Teilen von Anstrengung mit Robotern schwierig ist

Wenn ein Roboter physisch mit einer Person verbunden ist – etwa um ein Gelenk zu bewegen oder schwere Lasten zu tragen – drückt und reagiert beides ständig aufeinander. Traditionelle Regler für Roboter ignorieren meist, was der Mensch plant; sie verfolgen nur Leistungsziele wie Genauigkeit oder Energieeinsparung. Das kann den Roboter entweder zu steif und herrisch oder zu passiv und wenig hilfreich machen. Echte menschliche Partner sind besser: Sie erfassen, wie sich der andere bewegt, passen sich seinen Fähigkeiten an und fördern unterschiedliche Verhaltensweisen, von Entspannung bis zu intensiver Anstrengung. Die Autorinnen und Autoren argumentieren, dass Roboter, um dieser Interaktion näher zu kommen, explizit modellieren müssen, wie der Mensch Bewegungen plant und wie viel Aufwand er bereit ist zu investieren.

Eine spieltheoretische Sicht auf Mensch–Roboter-Interaktion

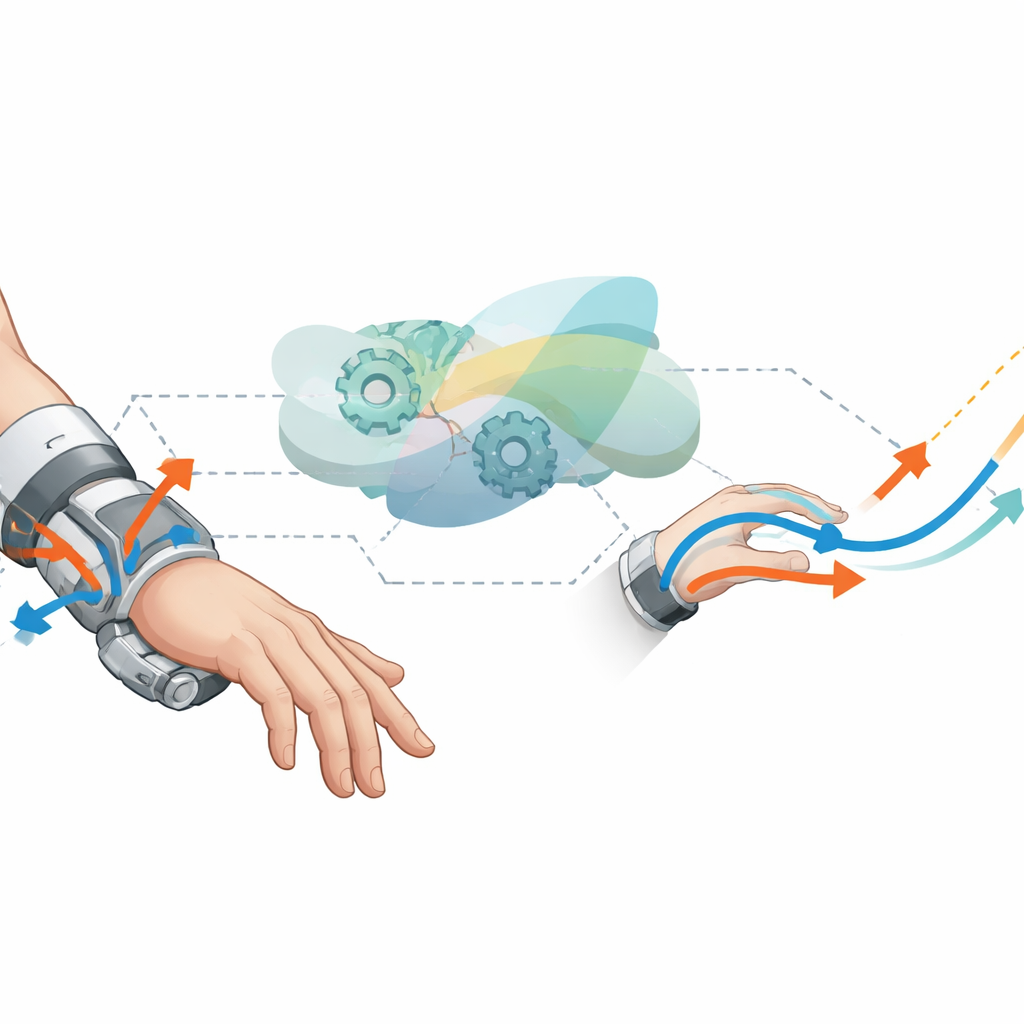

Die Forschenden bauen auf der Spieltheorie—der Mathematik strategischer Interaktionen—auf und behandeln Mensch und Roboter als zwei "Spieler", die dieselbe Aufgabe teilen. Jeder hat eigene Ziele: Der Mensch möchte die gewünschte Bewegung nachverfolgen und dabei möglichst wenig Aufwand betreiben, der Roboter möchte beim Verfolgen helfen und zugleich den Aufwand der Person reduzieren. Entscheidend ist, dass beide nur einen kurzen Zeitraum vorausblicken, ein endliches Planungsfenster von etwa einer bis zwei Sekunden, was dem natürlichen Bewegungsplanungsverhalten von Menschen entspricht. Innerhalb dieses Fensters leiten die Autoren eine kompakte Formel für ein Nash-Gleichgewicht ab: ein ausgewogenes Kraftmuster, bei dem weder Mensch noch Roboter ihr Ergebnis verbessern können, ohne dass der andere sich verändert. Dieses Gleichgewicht legt fest, wie stark jeder in jedem Moment drücken sollte.

Dem Roboter beibringen, menschliche Absichten zu lesen

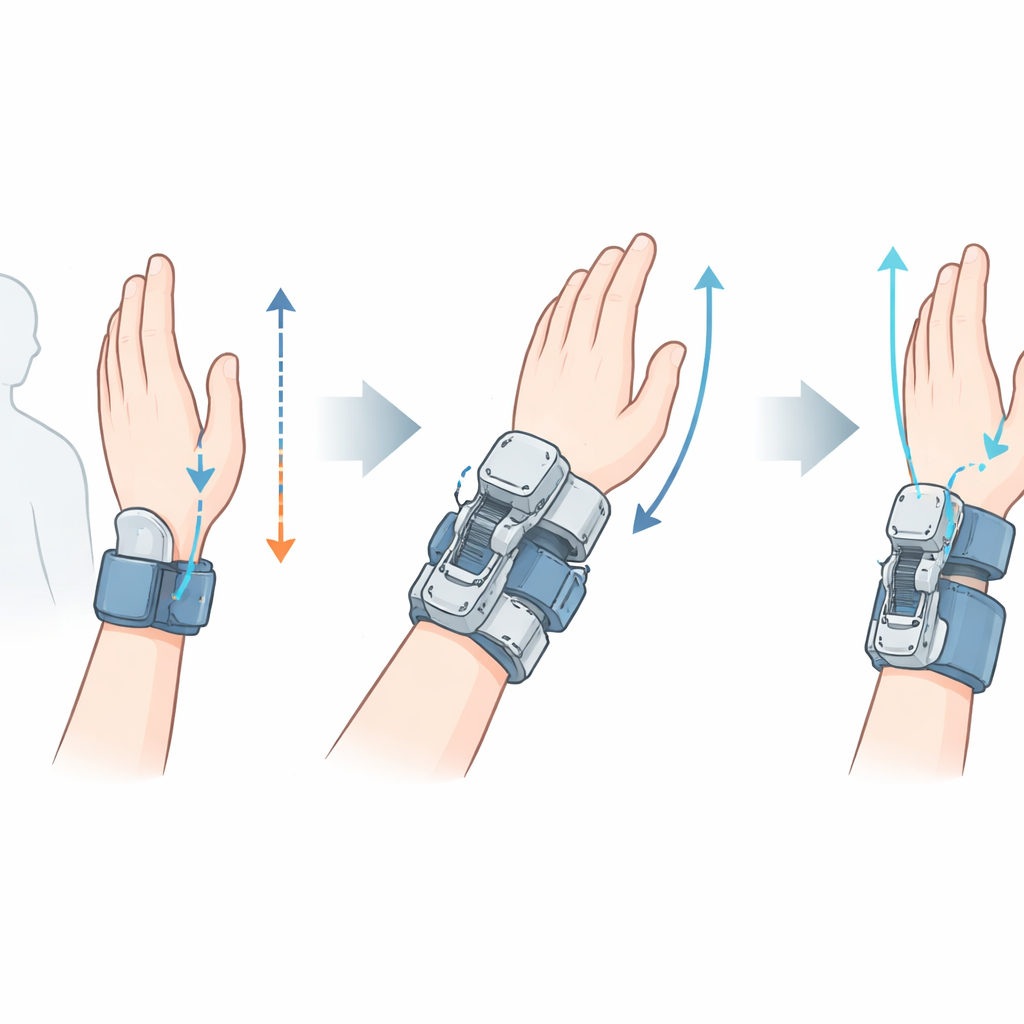

Damit der Roboter dieses "Bewegungsspiel" spielen kann, muss er zunächst ableiten, wie wichtig dem Menschen Genauigkeit im Vergleich zum Aufwand ist—eine versteckte Präferenz, die zwischen Personen und im Zeitverlauf variiert. Die Autoren lösen das mit einem inversen Spielansatz. Während sich die Person bewegt, messen Sensoren Gelenkwinkel und das von ihr erzeugte Drehmoment. Der Regler sucht dann wiederholt nach dem Satz menschlicher Präferenzen, der die jüngste Bewegungs- und Kraftgeschichte am besten erklären würde. Mit diesen Präferenzen prognostiziert er, wie der Mensch wahrscheinlich im nächsten kurzen Horizont handelt, und berechnet die optimale unterstützende Kraft des Roboters. Das alles läuft in Echtzeit auf einem Handgelenks-Exoskelett, das Versuchspersonen dabei hilft, mit der Hand einem sich bewegenden Ziel zu folgen.

Mensch und Roboter lernen zu koordinieren

Das Team testete ihren Regler mit dreißig gesunden Erwachsenen in drei Experimenten. Im ersten sollten die Personen zwischen aktivem Folgen des Ziels und passivem Verhalten wechseln. Der Regler passte seine interne Schätzung, wie sehr der Mensch auf Genauigkeit Wert legt, schnell an: Sie stieg während aktiver Phasen und fiel nahe Null, wenn die Personen entspannten. Im zweiten Experiment wechselten die Teilnehmenden zwischen Durchgängen mit und ohne Roboterunterstützung. Mit dem neuen Regler reduzierte der Roboter die Gelenkbelastung und die Muskelaktivität der Menschen bei gleichzeitig besserer Verfolgungsgenauigkeit. Über wiederholte Durchläufe hinweg stabilisierte sich für jede Person ein individuelles "Gleichgewicht" des Zusammenspiels, und die Korrelation zwischen Menschen- und Roboterkräften nahm zu—ein Hinweis auf wachsendes gegenseitiges Verständnis. Im dritten Experiment führten die Forschenden einen einzelnen Assistenzregler ein, einen Metaparameter, der verschiebt, wie stark der Roboter versucht, den Aufwand der Person zu minimieren. Das Drehen an diesem Regler veränderte glatt die von Menschen gewählte Anstrengung, ohne die Leistungsfähigkeit der Aufgabe zu verschlechtern.

Verhalten mit einem einzigen Drehknopf steuern

Der Assistenz-Metaparameter erlaubt Designerinnen und Designern, ein Spektrum an Interaktionsstilen mit einer einzigen Steuerung abzudecken: von nahezu keiner Hilfe über gleichmäßiges Teilen der Anstrengung bis hin zu nahezu vollständiger Unterstützung, bei der der Roboter führt und der Mensch entspannen kann. Bei mittleren Einstellungen koordinierten Menschen tendenziell am besten mit dem Roboter, wobei jeder etwa die Hälfte der Last trug. Das Muster der abgeleiteten menschlichen Präferenzen blieb für jede Person über verschiedene Assistenzstufen hinweg konsistent—außer wenn der Roboter fast alles übernahm; dann wurden die Verhaltensweisen einheitlicher, weil die Menschen sich größtenteils zurückzogen. Das zeigt, dass der Roboter individuelle Steuerungsstile erkennen und sie sanft beeinflussen kann, zum Beispiel indem er Nutzende in einer Trainingsphase zu mehr und in einer anderen zu weniger Beteiligung auffordert.

Was das für Rehabilitation und Arbeit bedeutet

Für Laien ist die Kernbotschaft: Dieser Regler lässt Roboter eher wie intelligente Partner als wie starre Maschinen agieren. Indem sie vorhersagen, wie wir beabsichtigen uns zu bewegen, und wie stark sie helfen, können Roboter unsere Anstrengung bei Bedarf reduzieren, uns zu mehr Einsatz ermutigen, wenn es nützlich ist, und Bewegungen genau und stabil halten. Das gleiche mathematische Rahmenwerk lässt sich für die Rehabilitation einstellen—indem man die Anstrengung schrittweise vom Roboter auf den Patienten verlagert—oder für kollaborative Fertigung, in der Menschen und Roboter Lasten sicher und effizient teilen. Im Kern zeigt die Studie, dass Menschen sich natürlicherweise an einen Roboter anpassen, der "dieselbe Spielregel" spielt, und eröffnet damit Möglichkeiten für personalisierte, zielgerichtete Formen interaktiver Assistenz.

Zitation: Hafs, A., Farr, A., Verdel, D. et al. Model predictive game control for personalized and targeted interactive assistance. Commun Eng 5, 57 (2026). https://doi.org/10.1038/s44172-026-00605-8

Schlüsselwörter: Mensch-Roboter-Interaktion, Exoskelett-Unterstützung, spieltheoretische Steuerung, motorische Rehabilitation, geteilte Steuerung