Clear Sky Science · de

Modalitäten mit KI verbinden: ein Überblick über KI‑Fortschritte in der multimodalen biomedizinischen Bildgebung

Mehr sehen als das Auge wahrnimmt

Die moderne Medizin stützt sich stark auf Bilder — von Röntgenaufnahmen und MRT‑Scans bis hin zu mikroskopischen Gewebeschnitten –, um zu verstehen, was im Körper vor sich geht. Dieser Review erklärt, wie künstliche Intelligenz (KI) viele verschiedene Arten medizinischer Bilder zu einem einzigen, reichhaltigeren Krankheitsbild verweben kann. Für den Laien ist die Attraktivität offensichtlich: Diese Fortschritte könnten frühere Krebserkennung, präzisere Diagnosen und Behandlungen bedeuten, die auf die einzelne Person statt auf den Durchschnittspatienten zugeschnitten sind.

Warum ein Bild nicht mehr ausreicht

Jede Bildgebungstechnik zeigt nur einen Teil der Geschichte. Radiologische Verfahren wie CT, MRT und Ultraschall offenbaren Form und Struktur von Organen, während nukleare Verfahren wie PET die Aktivität eines Tumors hervorheben. Unter dem Mikroskop sehen Pathologen die Anordnung der Zellen, und spektroskopische Methoden liefern chemische Fingerabdrücke von Geweben. Optische Verfahren wie die optische Kohärenztomographie erlauben das Hineinzoomen in feine Schichten von Auge oder Haut. Allein genommen können diese „Einzelansichten“ wichtige Hinweise übersehen. In Kombination hingegen können sie verknüpfen, wie ein Tumor aussieht, wie er sich verhält und welche Moleküle ihn antreiben, und Ärzten so ein vollständigeres Verständnis der Krankheit liefern.

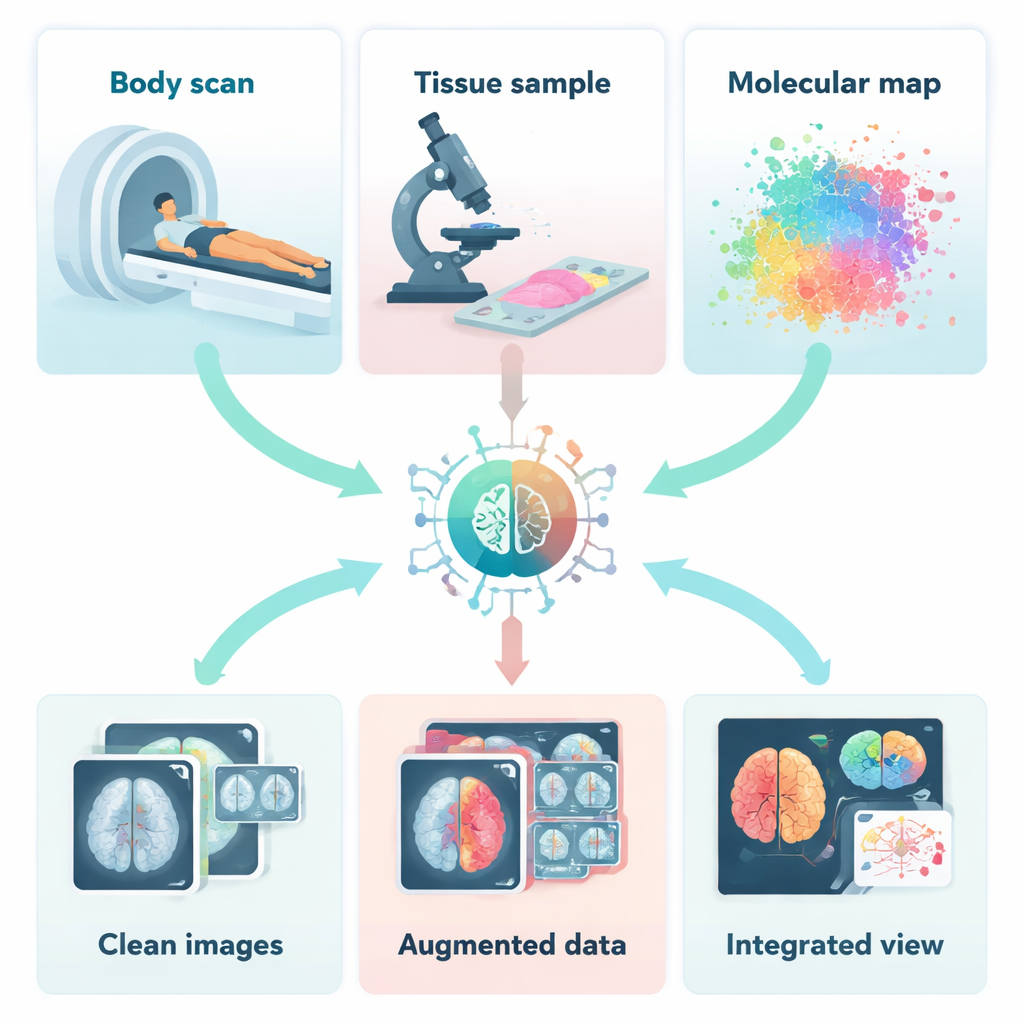

Wie KI medizinische Bilder säubert und ergänzt

Bevor unterschiedliche Bilder kombiniert werden können, müssen sie bereinigt, ausgerichtet und manchmal sogar neu erzeugt werden. Die Autorinnen und Autoren beschreiben, wie KI hilft, Rauschen und Bewegungsunschärfe aus Aufnahmen zu entfernen, Details aus Niedrigdosis‑CT‑ oder PET‑Bildern wiederherzustellen und Artefakte zu korrigieren, die sonst sowohl Ärzte als auch Computer verwirren würden. Deep‑Learning‑Systeme lernen anhand von Beispielen, wie ein sauberes Bild aussehen sollte, und stellen neue Scans entsprechend wieder her. Andere KI‑Modelle erzeugen realistische synthetische Bilder, um kleine Datensätze zu vergrößern oder fehlende Scan‑Typen zu ergänzen. Das ist besonders wertvoll bei seltenen Erkrankungen, für die es nur wenige echte Beispiele gibt, auf denen diagnostische Werkzeuge trainiert werden könnten.

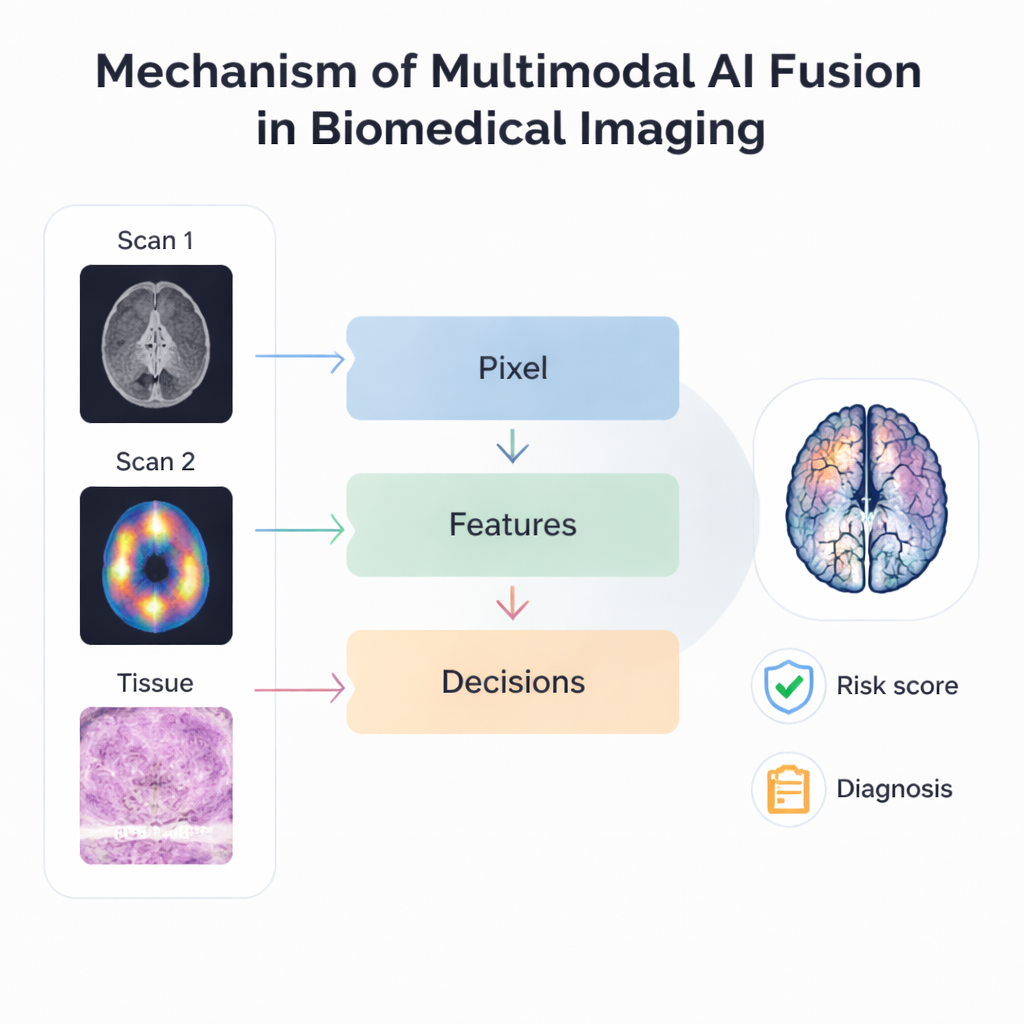

Verschiedene Blickwinkel zu einer einzigen Erzählung verschmelzen

Kern des Reviews ist, wie KI tatsächlich mehrere Bildquellen fusioniert. Auf der grundlegendsten Ebene legen pixelbasierte Methoden Scans wie MRT und PET übereinander, sodass Struktur und Aktivität in einem einzigen, schärferen Bild erscheinen. Fortschrittlichere Ansätze extrahieren aus jeder Modalität Schlüsselmuster oder „Features“ und kombinieren diese Muster statt der Rohbilder, was robuster gegenüber Unterschieden in Auflösung und Ausrichtung macht. Spätstufige oder „Entscheidungsniveau“-Fusion geht einen Schritt weiter, indem sie getrennte KI‑Modelle verschiedene Bilder analysieren lässt und deren Vorhersagen dann abstimmt oder mittelt. Hierarchische Systeme mischen mehrere dieser Ideen und schichten verschiedene Fusionsstufen, sodass sie alles von winzigen zellulären Details bis hin zu organweiten Veränderungen innerhalb eines Rahmens verarbeiten können.

Von besseren Bildern zu besserer Versorgung

Diese Fusions‑Techniken werden bereits in vielen klinischen Szenarien erprobt. Die Kombination mehrerer MRT‑Sequenzen verbessert die Segmentierung von Hirntumoren, während das Zusammenführen von Mammographie, Ultraschall und MRT die Erkennung von Brustkrebs und die Risikoprognose erhöht. Die Verknüpfung digitaler Pathologie‑Slides mit radiologischen Bildern hilft, Tumor‑Genetik und Überleben der Patienten vorherzusagen, ohne zusätzliche Tests durchführen zu müssen. KI unterstützt außerdem „datengetriebene Bildgebung“, bei der subtile Muster in Scans mit Genaktivität oder Patientenergebnissen korreliert werden, was genauere Prognosen und bessere Therapieauswahl verspricht. Neue Foundation‑Modelle und multimodale große Sprachmodelle zielen darauf ab, Aufgaben und Bildtypen zu verallgemeinern und sogar Bilder mit schriftlichen klinischen Notizen zu verbinden, mit dem Ziel, universelle Werkzeuge zu schaffen, die sich an viele Krankheiten und Kliniken anpassen lassen.

Vertrauen, Fairness und der weitere Weg

Trotz der Begeisterung betonen die Autorinnen und Autoren, dass wichtige Herausforderungen bleiben. Medizinische Bilder variieren stark zwischen Krankenhäusern, Geräten und Patientengruppen, was KI anfällig oder voreingenommen machen kann, wenn dem nicht sorgfältig begegnet wird. Viele leistungsfähige Modelle verhalten sich wie Black‑Boxes, sodass es für Kliniker schwer ist nachzuvollziehen, warum eine bestimmte Entscheidung getroffen wurde. Der Review diskutiert Bemühungen, hervorzuheben, welche Regionen eines Bildes Vorhersagen am stärksten beeinflussen, und fairere, transparenterere Systeme zu entwerfen. Er verweist außerdem auf ethische Fragen bezüglich Privatsphäre, Datenaustausch und den hohen Rechenanforderungen großer Modelle. Mit Blick nach vorn sehen die Autorinnen und Autoren spezialisierte KI‑„Agenten“ vor, die Bildgebung, Wearables und Gesundheitsdaten kontinuierlich überwachen, Klinikern in Echtzeit assistieren und bei der Koordination langfristiger Versorgung helfen. Für Patientinnen und Patienten ist das Fazit, dass die Kombination vieler Bildarten mit KI schnellere Antworten, stärker personalisierte Behandlungen und letztlich bessere Ergebnisse bedeuten könnte — vorausgesetzt, diese Technologien werden verantwortungsvoll entwickelt und eingesetzt.

Zitation: Doan, L.M.T., Shahhosseini, K., Verma, S. et al. Bridging modalities with AI: a review of AI advances in multimodal biomedical imaging. Commun Eng 5, 30 (2026). https://doi.org/10.1038/s44172-026-00602-x

Schlüsselwörter: multimodale biomedizinische Bildgebung, medizinische KI, Bildfusion, Radiologie und Pathologie, Präzisionsmedizin