Clear Sky Science · de

Synthetisch durch Röntgen gesteuertes Tracking und Kontrolle winziger medizinischer Geräte

Kleinere Instrumente, sicherere Eingriffe

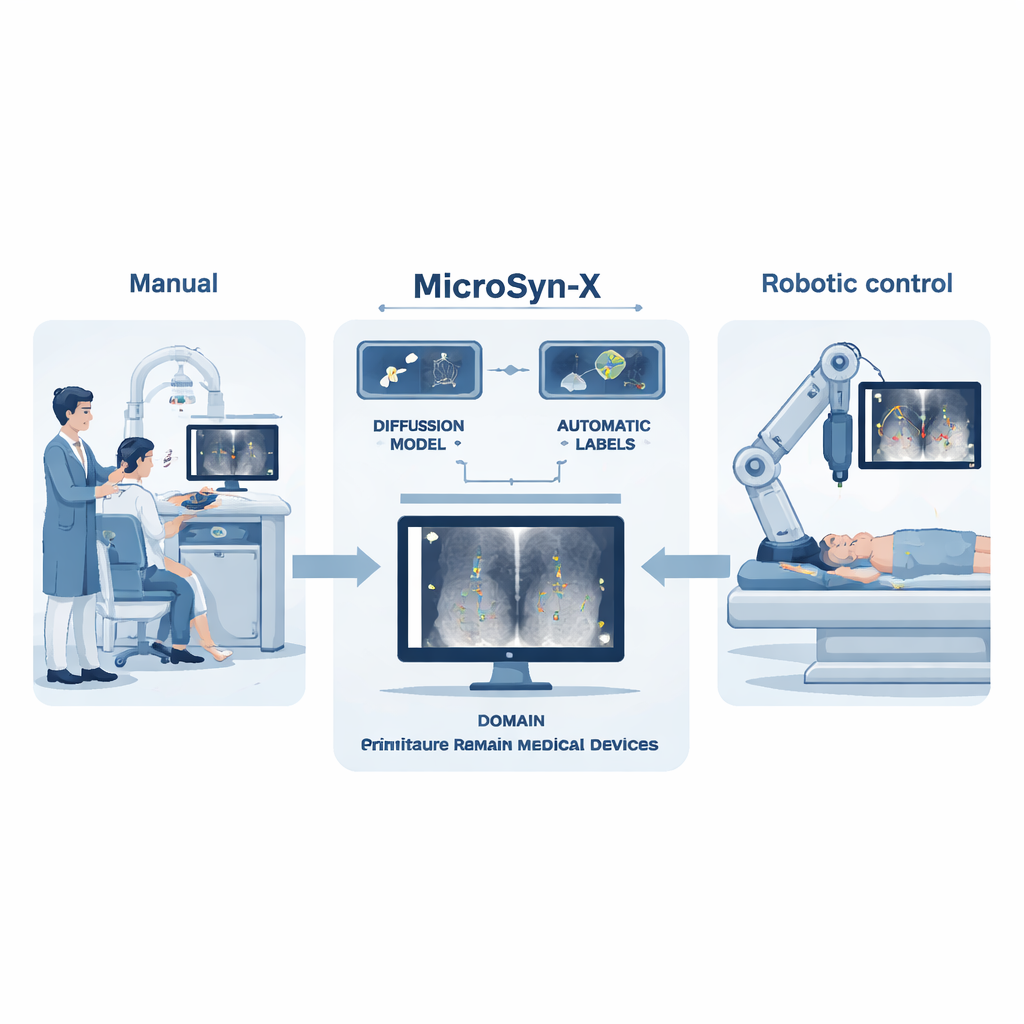

Chirurgen beginnen, winzige, kabellose medizinische Instrumente einzusetzen, die durch Blutgefäße und andere enge Passagen kriechen können, um Medikamente zu verabreichen, verstopfte Arterien zu öffnen oder Vitalwerte tief im Körper zu messen. Diese Miniaturgeräte versprechen schonendere Eingriffe und schnellere Erholungszeiten – aber nur, wenn Ärzte sie in Echtzeit sicher sehen und steuern können. Dieses Paper stellt MicroSyn‑X vor, eine neue Methode, Computer darin zu trainieren, diese winzigen Geräte in Röntgenaufnahmen zu verfolgen, und ebnet so den Weg für präzisere und weniger invasive Operationen.

Das Problem unsichtbarer Helfer

Das heutige Arbeitstier der chirurgischen Bildgebung ist die Röntgenfluoroskopie, die bewegte Schatten von Knochen, Gefäßen und Instrumenten auf einem Bildschirm zeigt. Miniaturgeräte sind jedoch so klein und schwach, dass sie im verrauschten Hintergrund oft untergehen. Sie können von Knochen, Metallwerkzeugen oder Kontrastmitteln verdeckt werden, und weiche oder flüssige Roboter ändern während der Bewegung ständig ihre Form. Menschliche Bediener müssen den Bildschirm aufmerksam beobachten und Magneten oder Katheter manuell anpassen – ein langsamer und ermüdender Prozess, der Fehler begünstigt. Computer Vision – Software, die selbst „sehen“ kann – könnte helfen, benötigt aber gewöhnlich riesige Sammlungen sorgfältig annotierter Bilder. Für diese neuen Geräte existieren solche Datensätze kaum, weil ihre Erstellung teuer, zeitaufwändig und durch den Patientenschutz eingeschränkt ist.

Computern beibringen mit falschen, aber glaubwürdigen Röntgenaufnahmen

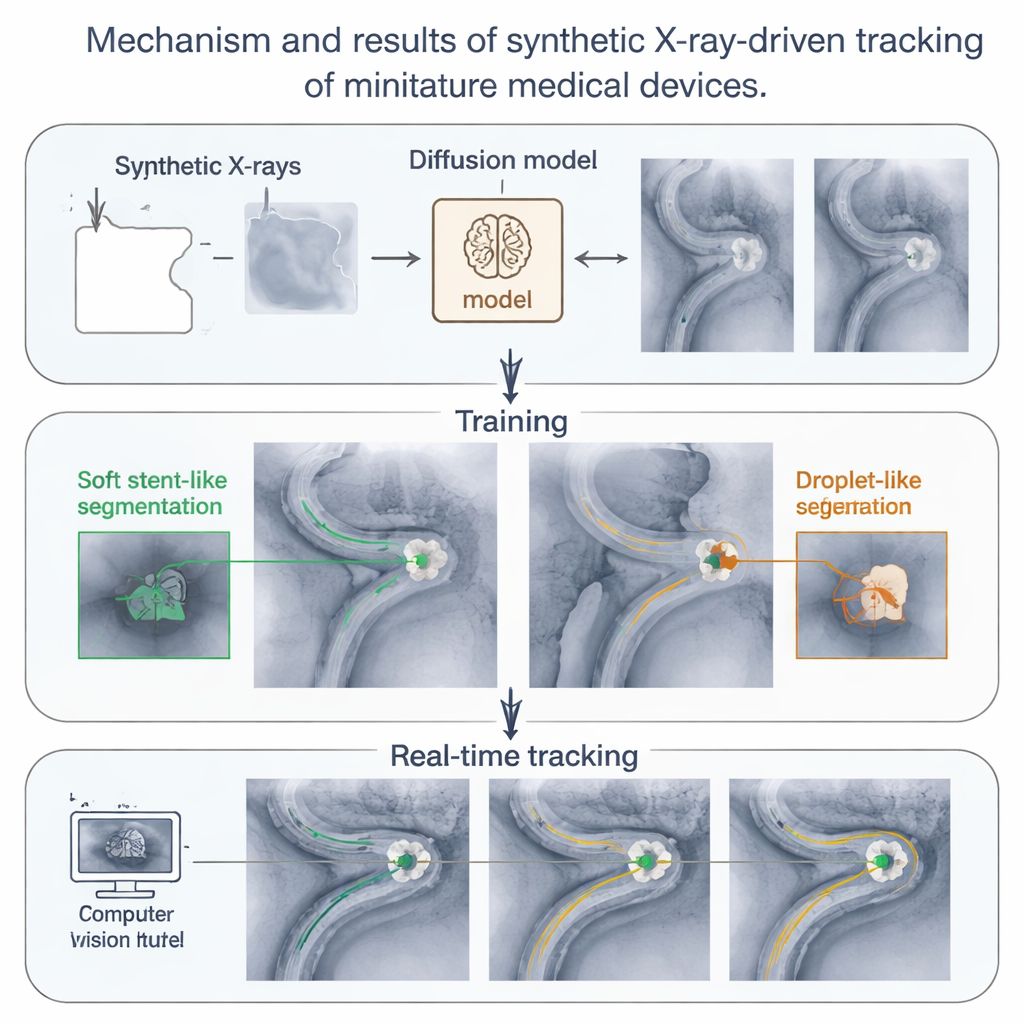

MicroSyn‑X löst dieses Datenproblem, indem es seine eigenen hochrealistischen Röntgenbilder erzeugt – komplett mit integrierten Labels, die einem Lernalgorithmus genau angeben, wo sich jedes Gerät befindet. Zuerst verwendet das System ein modernes Bildgenerierungsmodell namens Diffusionsmodell, um lebensechte Röntgenhintergründe von Organen, Knochen und chirurgischen Werkzeugen zu erstellen, gesteuert durch einfache Prompts und grobe Masken, die Gewebe, Metall und flüssigkeitsgefüllte Kanäle umreißen. Dann werden Bilder der Miniaturgeräte – entweder einmal auf neutralem Hintergrund fotografiert oder für flüssige Tropfen mathematisch erzeugt – digital in diese Szenen eingefügt, sodass sie so aussehen, als befänden sie sich wirklich im Körper. Weil der Computer exakt weiß, wo jedes Gerät platziert wurde, generiert er automatisch präzise Umrisse und Begrenzungsrahmen und erspart so mühsame manuelle Beschriftung.

Für die reale Welt üben mit kontrolliertem Chaos

Eine zentrale Neuerung von MicroSyn‑X ist die „Domain Randomization“, eine gezielte Einspeisung von Vielfalt in die synthetischen Bilder. Das System verändert automatisch Organformen, Gerätepositionen, Helligkeit, Rauschpegel und sogar, wie stark die Geräte von Knochen oder Werkzeugen verdeckt werden. Es erzeugt außerdem viele verschiedene Formen für flüssige Roboter, die sich dehnen, in Schwärme aufspalten und wieder zusammenfinden können. Indem der Lernalgorithmus mit tausenden leicht unterschiedlichen Situationen konfrontiert wird – viele davon selten oder in echten Patienten schwer zu erfassen – lernen die Modelle, sich auf die wesentlichen visuellen Hinweise der Geräte zu konzentrieren statt auf oberflächliche Muster. Tests zeigen, dass Modelle, die ausschließlich mit diesen synthetischen Bildern trainiert wurden, Modelle, die mit echten Röntgenaufnahmen trainiert wurden, erreichen oder übertreffen können, insbesondere in schwierigen Fällen mit niedrigem Kontrast, hohem Rauschen oder starker Verdeckung.

Vom Computerschirm zum Roboter im Operationssaal

Die Forschenden gehen über Softwaredemonstrationen hinaus und koppeln MicroSyn‑X direkt an ein robotisches System. Ein Roboterarm hält einen starken Magneten nahe am Gewebe, während ein C‑Arm‑Fluoroskop Röntgenaufnahmen erstellt. Das mit MicroSyn‑X trainierte Vision‑Modell erkennt weiche, stentförmige Roboter und flüssige Tropfen in jedem Bild, und ein Tracking‑Algorithmus verknüpft diese Detektionen zu glatten Bahnen, selbst wenn die Geräte kurz hinter Knochen verschwinden. Mit diesem Feedback steuert der Roboter die Geräte durch gewundene künstliche Gefäße, echte tierische Organe außerhalb des Körpers und lebende Arterien bei Kaninchen und Ratten. Das System lenkt erfolgreich mehrere Geräte gleichzeitig, verfolgt sie durch Verzweigungen und überwacht Schwärme flüssiger Tropfen, die sich unter magnetischer Steuerung teilen und wieder zusammenschließen – alles in Echtzeit unter anspruchsvollen Bildgebungsbedingungen.

Auf dem Weg zu intelligenterer, weniger invasiver Versorgung

Kurz gesagt zeigt diese Arbeit, dass Computer lernen können, winzige chirurgische Instrumente sicher im Körper zu verfolgen, indem sie an großen Bibliotheken sorgfältig gestalteter „falscher“ Röntgenaufnahmen üben statt an knappen realen Daten. MicroSyn‑X macht synthetische Bildgebung zu einer praktischen Triebfeder für Robotik: Es erstellt realistische Trainingsdaten, lehrt Vision‑Modelle und speist deren Ausgaben in ein magnetisches Navigationssystem, das bereits in lebenden Tieren funktioniert hat. Wenn sich diese Methoden weiterentwickeln und in komplexeren Fällen erprobt werden, könnten sie Chirurgen helfen, empfindliche Eingriffe mit größerer Genauigkeit und weniger Belastung durchzuführen und uns einer Zukunft näherbringen, in der Flotten winziger Roboter still und von innen heraus Behandlungen verbessern.

Zitation: Wang, C., Kang, W., Sun, M. et al. Synthetic X‑ray‑driven tracking and control of miniature medical devices. Nat Mach Intell 8, 276–291 (2026). https://doi.org/10.1038/s42256-026-01190-3

Schlüsselwörter: winzige medizinische Geräte, Röntgenbildgebung, synthetische Daten, medizinische Robotik, Computer Vision