Clear Sky Science · de

Simulationsbasierte Inferenz für präzise Neutrinophysik durch neuronale Monte‑Carlo‑Feinabstimmung

Feinabstimmung der Augen von Neutrino‑Teleskopen

Zukünftige Neutrino‑Experimente zielen darauf ab, große Fragen über das Universum zu beantworten, etwa wie die winzigen Neutrinos nach Masse geordnet sind und wie Sterne explodieren. Dafür müssen ihre riesigen Detektoren Energie mit herausragender Präzision messen — weit über das hinaus, was einfache Lehrbuchformeln leisten. Dieses Papier zeigt, wie moderne Methoden des maschinellen Lernens helfen können, die komplexen Simulationen abzustimmen und zu validieren, die das Geschehen im Detektor mit den Lichtblitzen verbinden, die wir tatsächlich aufzeichnen.

Warum das Verständnis der Detektorantwort so schwierig ist

In Experimenten wie dem Jiangmen Underground Neutrino Observatory (JUNO) in China wechselwirken Neutrinos in einem großen Tank mit einer Flüssigkeit, die Licht erzeugt, wenn Teilchen hindurchgehen. Dieses Licht wird von Tausenden Photomultipliern als winzige elektrische Impulse gesammelt und als „Photoelektronen“ gezählt. Die Herausforderung besteht darin, diese Zählimpulse wieder in die ursprüngliche Teilchenenergie zurückzurechnen. In der Realität ist diese Beziehung kein geradliniger Zusammenhang: Sie hängt von der Geometrie des Detektors, dem Verhalten der Flüssigkeit und mehreren verflochtenen physikalischen Effekten ab. Traditionelle Ansätze verließen sich darauf, Simulationsparameter per Hand so lange zu justieren, bis die simulierten Spektren grob zu den Kalibrierdaten passten — eine Methode, die für moderne, hochpräzise Experimente unhandlich wird.

Neuronalen Netzen beibringen, den Simulator zu emulieren

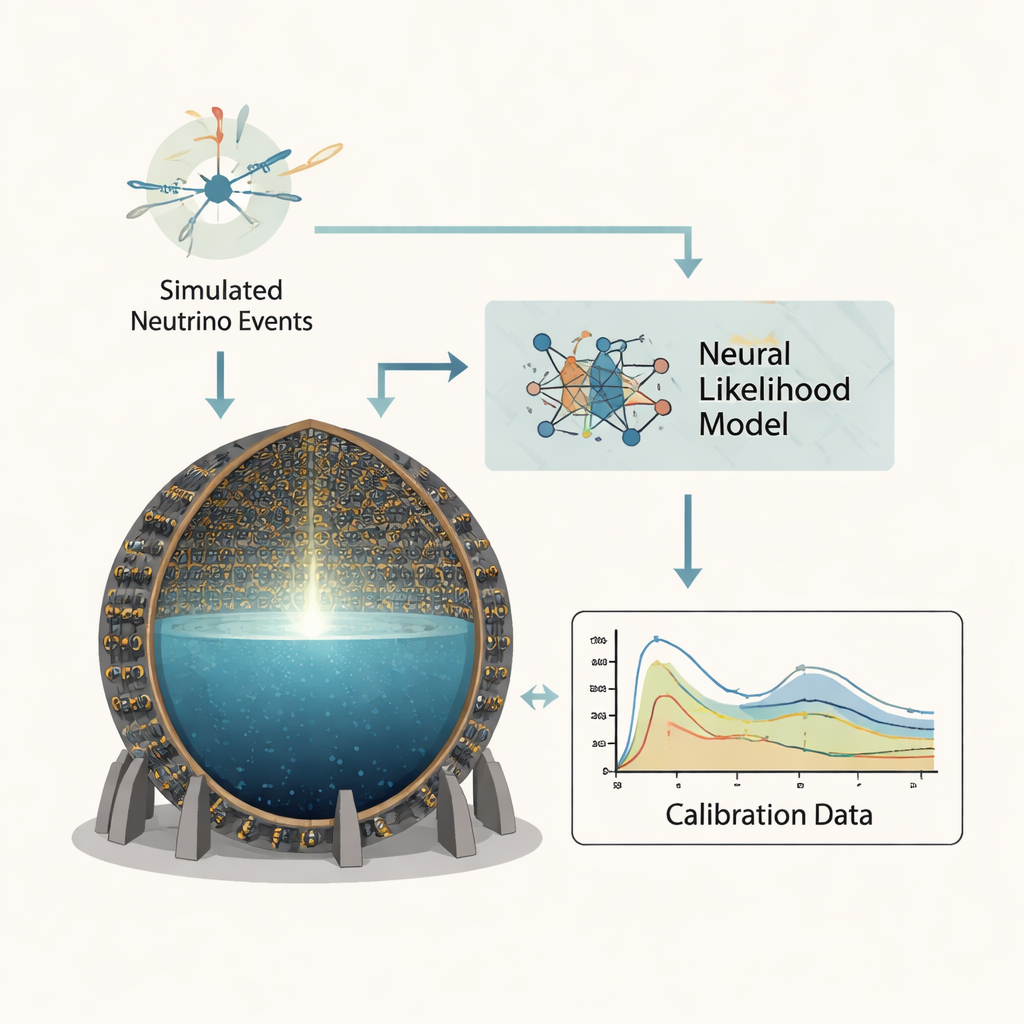

Die Autoren verfolgen eine Strategie, die als simulationsbasierte Inferenz bekannt ist: Statt zu versuchen, eine exakte mathematische Formel für die Detektorantwort aufzuschreiben, überlassen sie die Hauptarbeit Simulationen und neuronalen Netzen. Sie konzentrieren sich auf drei Schlüsselparameter, die steuern, wie JUNO wahre Energie in detektiertes Licht umwandelt: ein Koeffizient, der beschreibt, wie die Lichtproduktion bei hoher Ionisationsdichte „gequench“ wird, eine Gesamtlichtausbeute, die die durchschnittliche Helligkeit setzt, und ein Faktor, der die Menge an Cherenkov‑Licht kontrolliert. Mit JUNOs offizieller Monte‑Carlo‑Software erzeugen sie etwa eine Milliarde simulierter Kalibrierereignisse von fünf radioaktiven Quellen, die im Detektorzentrum platziert sind; jedes Ereignis wird durch eine einzige Zahl zusammengefasst: das gesamte gesammelte Licht. Das bildet das Trainingsfundament für neuronale Netze, die lernen, wie wahrscheinlich ein gegebenes LichtsSignal für jede Wahl der drei Parameter ist.

Zwei komplementäre maschinelle Lern‑Linsen

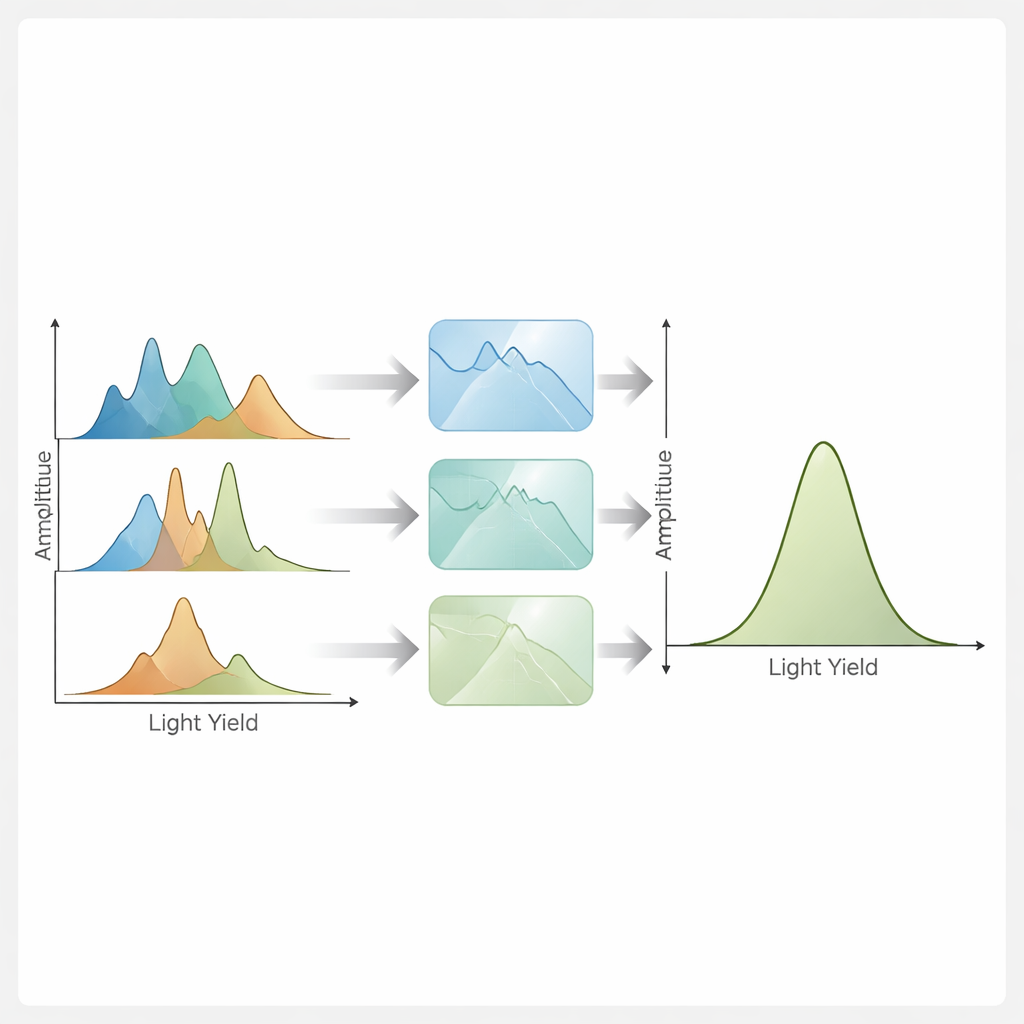

Das Team entwickelt zwei komplementäre neuronale „Likelihood‑Schätzer“, die die Wahrscheinlichkeit approximieren, ein gegebenes LichtsSignal für spezifische Detektor‑Einstellungen zu beobachten. Der erste, Transformer Encoder Density Estimator genannt, verwendet eine Transformer‑Architektur — dieselbe Modellfamilie, die viele Sprachwerkzeuge antreibt — um direkt ein fein gestuftes Histogramm des Lichtspektrums für jede Kombination von Parametern und Quelle vorherzusagen. Das unterstützt natürlich traditionelle binned statistische Analysen. Der zweite, Normalizing Flows Density Estimator genannt, nutzt eine Kette invertierbarer Transformationen, um die komplizierten, mehrgipfeligen Spektren in eine einfache glockenförmige Verteilung zu überführen. Weil diese Transformationen mathematisch kontrolliert sind, kann die Methode die exakte Wahrscheinlichkeit für jedes ungebinnte Ereignis auswerten und damit Analysen ermöglichen, die die vollständigen Informationsinhalte der Daten nutzen.

Überprüfung von Genauigkeit, Präzision und Robustheit

Um zu belegen, dass diese neuronalen Werkzeuge vertrauenswürdig sind, unterziehen die Autoren sie strengen Tests. Zunächst prüfen sie, ob die Modelle die simulierten Spektren über Tausende von Kombinationen der drei Parameter reproduzieren können, und verwenden dazu mehrere statistische Distanzen, die vorhergesagte und „wahre“ Verteilungen vergleichen. Beide Methoden verfolgen scharfe Peaks und subtile spektrale Merkmale außerordentlich gut, mit Abweichungen auf dem Niveau von wenigen Teilen pro tausend. Danach setzen sie die gelernten Likelihoods in etablierte statistische Werkzeuge ein — Bayesian Nested Sampling, Markov‑Chain‑Monte‑Carlo und klassische Minimierung — um die ursprünglichen Simulationsparameter aus Mock‑Datensätzen zurückzugewinnen. Über einen weiten Bereich von Parameterwerten und Ereignisstatistiken sind die zurückgewonnenen Parameter unverzerrt und ihre angegebenen Unsicherheiten stimmen mit der tatsächlichen Streuung der Ergebnisse überein. Die Unsicherheiten schrumpfen mit mehr Daten genau so, wie es einfache Zählstatistik vorhersagt, und die Methoden erfassen zuverlässig starke Korrelationen zwischen den Parametern.

Von Monaten Rechenzeit zu Sekunden

Ein bemerkenswertes Ergebnis ist die erhebliche Beschleunigung der Berechnungen. Vollständige Detektorsimulationen mit ausreichend vielen Ereignissen, um jeden Parameterpunkt zu charakterisieren, können auf einem konventionellen Prozessor viele Stunden pro Einstellung benötigen. Einmal trainiert, kann das Transformer‑Modell jedoch ein vorhergesagtes Spektrum in wenigen Millisekunden erzeugen, und das Normalizing‑Flow‑Modell kann Wahrscheinlichkeiten für Zehntausende von Ereignissen in deutlich unter einem Zehntel einer Sekunde auswerten. Das macht es realistisch, große Parameteräume zu durchsuchen und systematische Unsicherheiten zu quantifizieren, die sonst prohibitiven Aufwand erfordern würden, und ebnet so den Weg zu detaillierteren und verlässlicheren Detektorkalibrierungen.

Was das für zukünftige Neutrino‑Experimente bedeutet

Für Nicht‑Spezialisten ist die Kernaussage, dass diese Arbeit komplexe, langsame Detektorsimulationen in schnelle, genaue Ersatzmodelle verwandelt, ohne die physikalische Aussagekraft zu opfern. Die drei abgestimmten Parameter entsprechen weiterhin direkt realen Eigenschaften des Detektors und seiner Flüssigkeit, sodass die Ergebnisse für Physiker interpretierbar bleiben. Die Studie zeigt, dass beide neuronalen Ansätze diese Parameter mit extrem geringen Verzerrungen und Fehlern bestimmen können, die hauptsächlich durch die verfügbare Datenmenge begrenzt sind. Während kommende Experimente wie JUNO, DUNE und Hyper‑Kamiokande auf Unter‑Prozent‑Präzision in Neutrinomessungen zusteuern, werden Methoden dieser Art unerlässlich sein, um sicherzustellen, dass unsere Rückschlüsse auf das Universum nicht durch ungenügend verstandene Detektoren limitiert werden.

Zitation: Gavrikov, A., Serafini, A., Dolzhikov, D. et al. Simulation-based inference for precision neutrino physics through neural Monte Carlo tuning. Commun Phys 9, 63 (2026). https://doi.org/10.1038/s42005-026-02499-6

Schlüsselwörter: Neutrinodetektoren, Maschinelles Lernen, Monte‑Carlo‑Feinabstimmung, Normalizing Flows, simulationsbasierte Inferenz