Clear Sky Science · de

Linguistische Tonhöhe wird hierarchisch im rechten ventralen Strom kodiert

Wie Ihr Gehirn Fragen und Aussagen hört

Wenn jemand „Gehst du?“ im Gegensatz zu „Du gehst.“ sagt, hören Sie sofort das eine als Frage und das andere als Aussage – selbst wenn die Wörter identisch sind. Was sich ändert, ist die Melodie der Stimme, insbesondere das Steigen und Fallen der Tonhöhe. Diese Studie zeigt, wie das Gehirn diese Tonhöhenmuster in klare, bedeutungsvolle Kategorien wie „Frage“ oder „Aussage“ übersetzt und dass dieser Prozess in einer präzisen Reihenfolge auf der rechten Gehirnhälfte abläuft.

Die Stimm-Melodie, die Bedeutung trägt

Gesprochene Sprache besteht aus mehr als Konsonanten und Vokalen. Eine zentrale Komponente ist die Grundfrequenz der Stimme, oft f0 genannt, die wir als Tonhöhe wahrnehmen. Die Höhe von f0 hilft uns, Sprecher zu unterscheiden (etwa männliche gegenüber weiblichen Stimmen), während die Art, wie f0 innerhalb eines Satzes steigt oder fällt, den Satztyp signalisiert. Ein finales Ansteigen der Tonhöhe markiert häufig eine Ja‑/Nein‑Frage; ein finales Fallen kennzeichnet eine Aussage. In dieser Studie hörten Versuchspersonen kurze französische Wörter, deren Tonverläufe entlang eines Kontinuums von eindeutig „aussageähnlich“ bis eindeutig „fragenähnlich“ morphiert worden waren, während ihre Hirnaktivität mit Magnetenzephalographie (MEG) gemessen wurde – einer Technik, die schnell wechselnde Hirnsignale verfolgt.

Von rohem Klang zu stabilen Kategorien

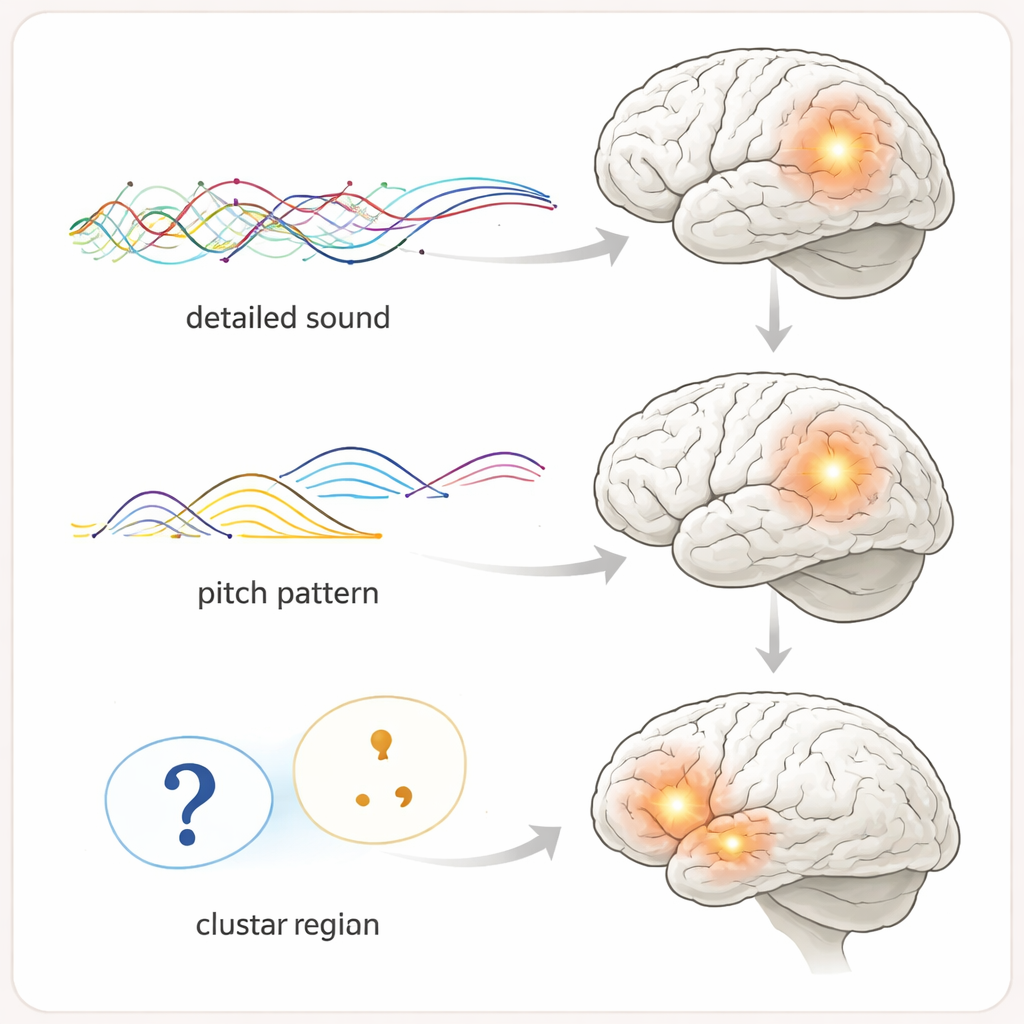

Die Forschenden fragten, ob das Gehirn diese Tonhöhenhinweise als rohe akustische Details behandelt oder als stabile, höherstufige Kategorien. Verhaltensmäßig reagierten die Menschen, als würden sie zwei eindeutig getrennte Satztypen hören: Sie bezeichneten die Laute zuverlässig als Frage oder Aussage und ignorierten weitgehend Unterschiede in der exakten Tonform und in der Sprecherstimme. Im Gehirn enthielten frühe Aktivitätsmuster noch reichhaltige Informationen sowohl darüber, wer sprach, als auch darüber, wie sich die Tonhöhe veränderte. Mit fortschreitender Zeit wurden die späteren Aktivitätsmuster jedoch weniger empfindlich gegenüber diesen Oberflächendetails und spiegelten stattdessen nur noch den Satztyp wider – entsprechend der „Alles‑oder‑Nichts“-Weise, wie Menschen die Laute letztlich beurteilten.

Ein rechtsseitiger Pfad für linguistische Tonhöhe

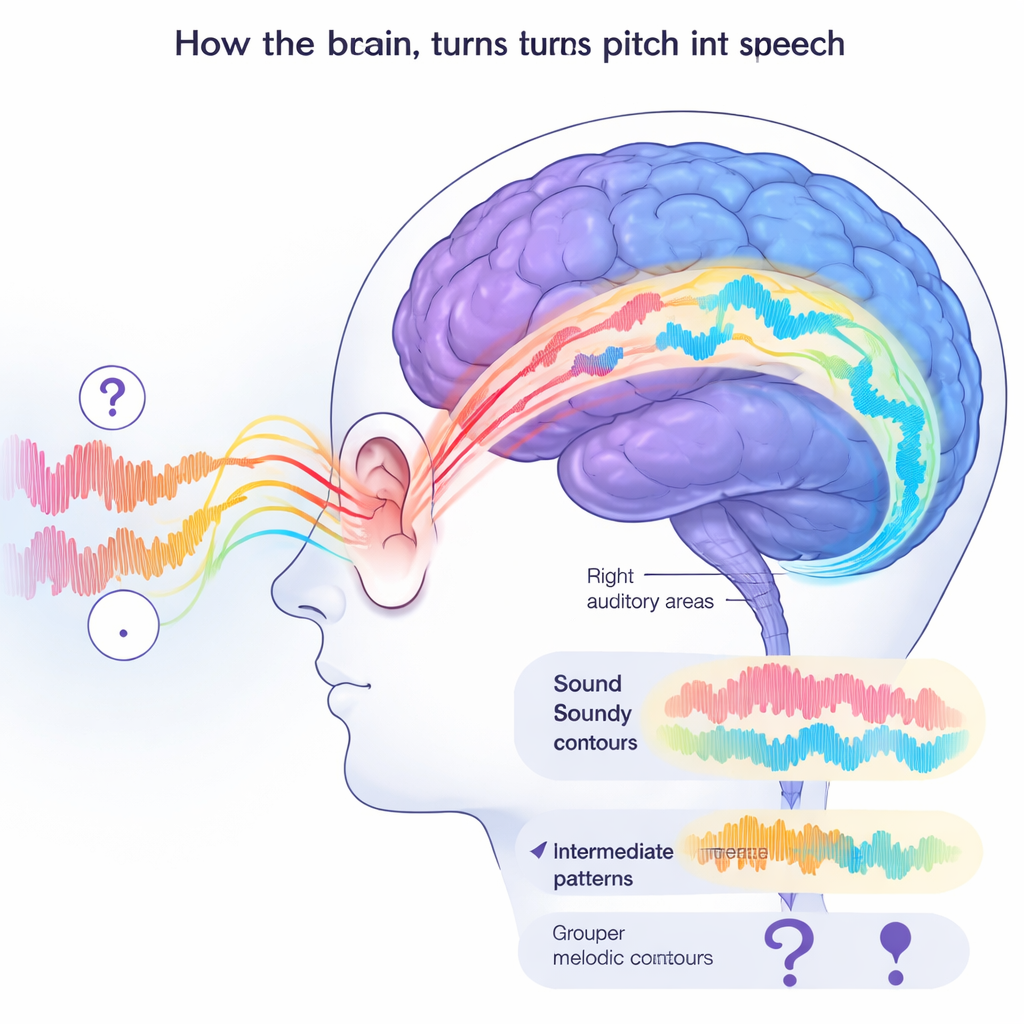

Um nachzuverfolgen, wo diese verschiedenen Stadien entstehen, rekonstruierten die Forschenden die Aktivität im Gehirn. Sie fanden, dass frühe Darstellungen der Tonhöhe in rechten auditorischen Regionen nahe dem Ohr liegen, die sowohl Tonhöhenhöhe als auch den detaillierten Konturverlauf getreu nachverfolgen. Etwas später und weiter vorne entlang des rechten superioren temporalen Gyrus trägt das Gehirn eine stärker gestraffte Repräsentation, in der Informationen über die typische Tonhöhe des Sprechers ausgeklammert sind, während das generelle Steigen‑oder‑Fallen‑Muster erhalten bleibt. Am weitesten entlang dieses Pfades, in noch anterioren rechten temporalen Regionen, reflektiert die Hirnaktivität nur noch die abstrakte Kategorie – „das klingt wie eine Frage“ versus „das klingt wie eine Aussage“ – unabhängig davon, welcher Sprecher sie produziert hat. Eine entsprechende Region auf der linken Seite, tief in frontalen und insulären Arealen, trägt diese abstrakten Kategorien ebenfalls und ist eng mit dem Akt der Entscheidungsfindung verknüpft.

Verknüpfung von Hirnmustern mit Entscheidungen

Die Studie ging weiter, indem sie untersuchte, wie die „Form“ dieser Hirnrepräsentationen mit dem tatsächlichen Verhalten der Personen zusammenhängt. Mit mathematischen Werkzeugen, die Muster von Gehirnantworten über verschiedene Laute hinweg vergleichen, zeigten die Autorinnen und Autoren, dass nur die anteriore rechte temporale Region alle fragenähnlichen Laute klar zusammenfasste und sie von aussageähnlichen Lauten trennte – unabhängig vom Sprecher. Personen, deren Gehirne diese Trennung sauber vornahmen, waren in der Aufgabe besser: Sie kategorisierten genauer und zeigten schärfere Übergänge zwischen „Frage“- und „Aussage“-Antworten. In links fronto‑insulären Arealen korrelierte die Stärke dieser abstrakten Tonkategorien mit der Geschwindigkeit, mit der das Gehirn ausreichend Belege zur Entscheidungsfindung akkumulieren konnte, geschätzt durch ein Entscheidungsmodell, das sowohl Tempo als auch Genauigkeit berücksichtigt.

Teamarbeit über Hemisphären hinweg

Die Forschenden untersuchten zudem, wie diese Hirnareale zeitlich miteinander kommunizieren. Sie fanden eine schnelle, hochfrequente Kommunikation, die spät in jedem Durchgang von der rechten anterioren Temporalregion zur links fronto‑insulären Region floss, als würde ein fertiges „Satztyp“-Signal an eine Entscheidungszentrale weitergegeben. Langsamere rhythmische Koordination von der links fronto‑insulären Region zu einer für Bewegungsplanung auf der rechten Seite beteiligten Region deutete darauf hin, dass entscheidungsrelevante Informationen an Systeme weitergereicht wurden, die helfen, die Knopfdrücke vorzubereiten, mit denen Antworten gemeldet wurden. Zusammen zeigen diese Interaktionen, dass das Verstehen der Sprachmelodie nicht auf eine einzelne Rinde beschränkt ist, sondern aus einer dynamischen Konversation zwischen rechtsseitigen Tonhöhenprozessoren und linksseitigen Entscheidungsnetzwerken entsteht.

Warum das für das Hören im Alltag wichtig ist

Für Nicht‑Fachleute ist die zentrale Botschaft einfach: Ihr Gehirn nutzt einen rechtshemisphärischen Pfad, um die unordentlichen Details der Tonhöhe in der Sprache – wer spricht, wie genau die Stimme schwankt – herauszufiltern und zu sauberen, verlässlichen Kategorien wie „Frage“ und „Aussage“ zu gelangen. Diese abstrakten Tonrepräsentationen sind keine bloßen theoretischen Konstrukte; ihre Klarheit sagt voraus, wie gut und wie schnell Sie Satztypen unterscheiden können. Die Arbeit legt nahe, dass subtile Probleme in diesem Pfad beeinflussen können, wie Menschen Tonfall interpretieren, und liefert eine Blaupause dafür, wie die Verarbeitung von Tonhöhe in natürlicheren Gesprächen, in verschiedenen Sprachen und bei klinischen Zuständen, die die Sprachwahrnehmung verändern, untersucht werden kann.

Zitation: Oderbolz, C., Orpella, J. & Meyer, M. Linguistic pitch is hierarchically encoded in the right ventral stream. Commun Biol 9, 267 (2026). https://doi.org/10.1038/s42003-026-09545-7

Schlüsselwörter: Sprachwahrnehmung, Tonhöhe, Prosodie, auditorischer Kortex, Gehirnnetzwerke