Clear Sky Science · de

Anatomiegeleitete visuelle Prompt-Anpassung für multimodales Verständnis von Brustkrebs

Intelligentere Vorsorge für einen verbreiteten Krebs

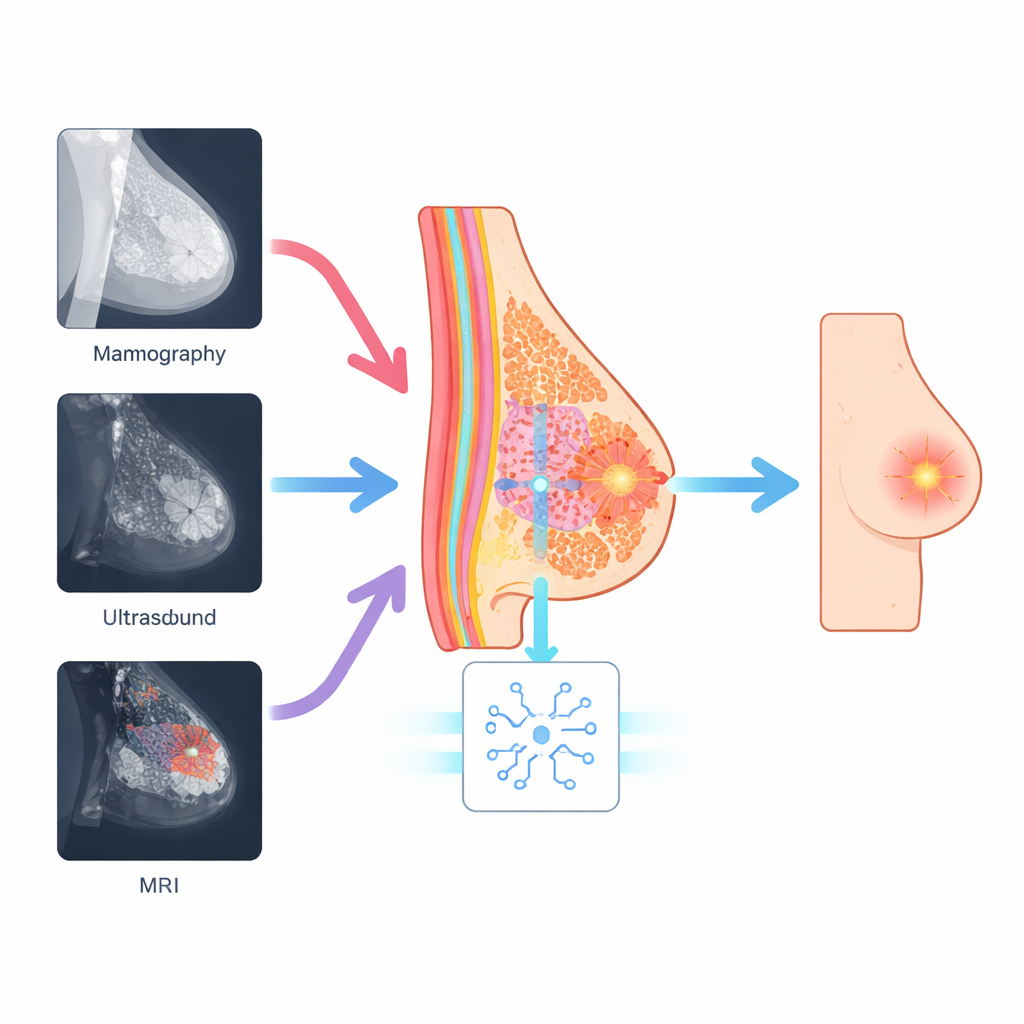

Brustkrebs zählt zu den häufigsten krebsbedingten Todesursachen bei Frauen, und Ärztinnen sowie Ärzte stützen sich zunehmend auf Computerprogramme, die komplexe medizinische Bilder unterstützen sollen. Mammographie, Ultraschall und MRT zeigen die Brust jedoch auf sehr unterschiedliche Weise, weshalb aktuelle KI‑Systeme Schwierigkeiten haben, über Geräte und Kliniken hinweg zuverlässig zu bleiben. Diese Studie stellt einen neuen KI‑Ansatz vor, der nicht nur Helligkeitsmuster in Bildern lernt, sondern die zugrunde liegende Brustanatomie berücksichtigt — was zu präziseren und beständigeren Erkennungen auffälliger Bereiche führt.

Warum verschiedene Aufnahmen Computer verwirren

Mammographie, Ultraschall und MRT beruhen auf unterschiedlichen physikalischen Prinzipien, um in die Brust zu schauen. Ein Tumor, der auf einem Ultraschallbild als heller Punkt erscheint, kann auf einer Mammographie als kaum sichtbarer Schatten oder im MRT als leuchtende Fläche erscheinen. Viele moderne KI‑Modelle, darunter leistungsfähige Vision Transformer und Vision‑Language‑Modelle, lernen hauptsächlich anhand des allgemeinen Bilderscheinungsbilds. Dabei übersehen sie oft winzige, aber wichtige Details wie Mikrokalzifikationen oder unregelmäßige Ränder, und ihre Leistung kann stark nachlassen, wenn sie von einem Gerätetyp oder einer Klinik auf eine andere übertragen werden. Diese Diskrepanz zwischen Trainingsbedingungen und klinischem Alltag begrenzt das Vertrauen, das Ärztinnen und Ärzte in solche Werkzeuge setzen können.

Die Brust selbst als Orientierungsrahmen nutzen

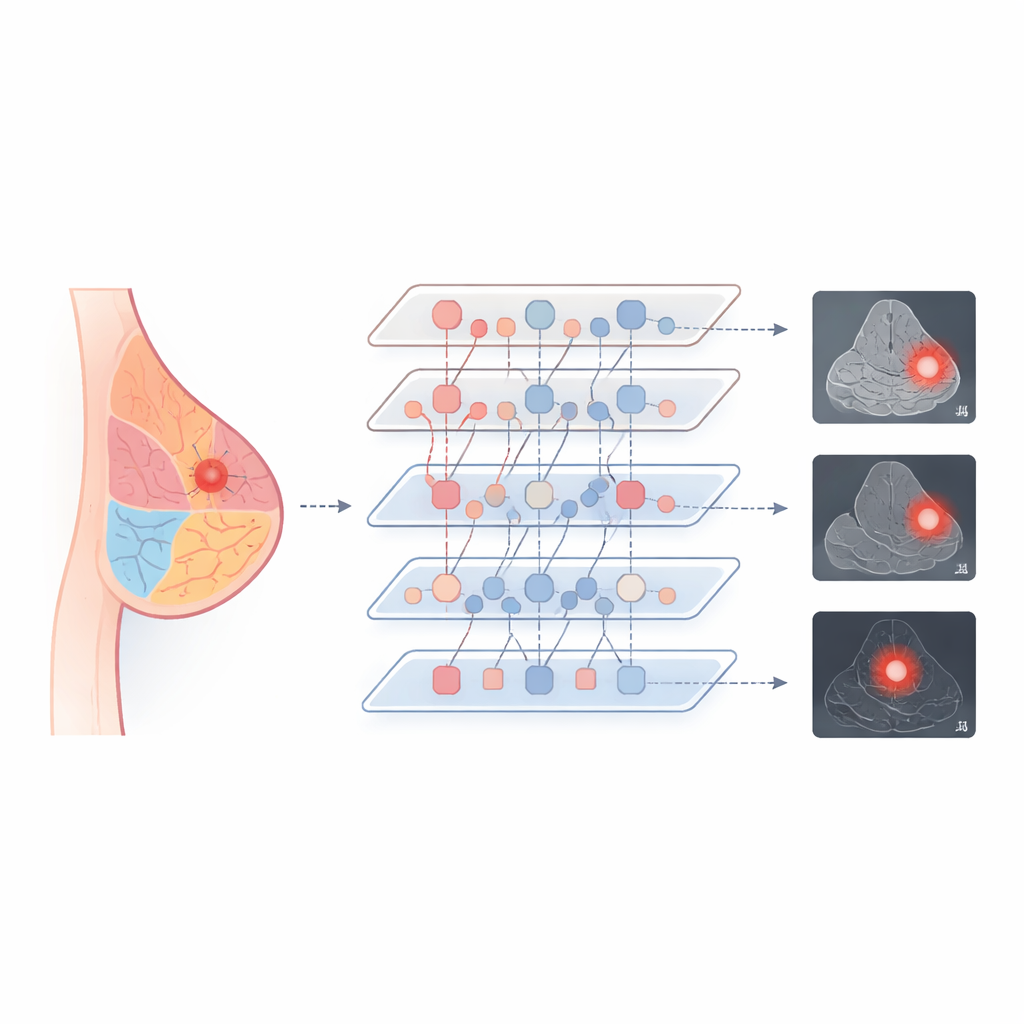

Die Forschenden argumentieren, dass die zugrunde liegende Biologie der Brust zwischen den Aufnahmen gleich bleibt, auch wenn die Bilder unterschiedlich aussehen. Jedes Bild enthält weiterhin Drüsengewebe, Fett und duktale Strukturen, die in einer erkennbaren Anordnung vorkommen. Ihre Methode, Anatomy‑Guided Visual Prompt Tuning (A‑VPT), integriert diese grundlegende Landkarte der Brust direkt in das KI‑Modell. Anstatt Millionen interner Gewichte anzupassen, fügt das System einen kleinen Satz zusätzlicher „Prompt“-Signale hinzu, die dem Netzwerk mitteilen, welche Gewebeareale es betrachtet. Diese Prompts werden aus groben anatomischen Karten oder gelernten Gewebehinweisen erzeugt und schichtweise in einen eingefrorenen, vortrainierten Transformer eingespeist. Effektiv wird das Modell laufend daran erinnert, wo Duktusstrukturen, Drüsen und Fett liegen, sodass es auffällige Bereiche im richtigen Kontext beurteilen kann.

Ein System lehren, viele Bildsprachen zu sprechen

Um das Modell über Bildgebungsarten hinweg funktionieren zu lassen, entwarf das Team ein Trainingsschema, das die KI zwingt, ähnliche Gewebe ähnlich zu behandeln, unabhängig davon, wie sie aufgenommen wurden. Sie bringen die internen «Fingerabdrücke» von Fett‑, Drüsen‑ und Duktusregionen aus Mammographie, Ultraschall und MRT in Einklang, indem sie diese in einem gemeinsamen Raum zusammenführen. Soweit Textbefunde vorliegen, verknüpft das System diese Gewebemuster zusätzlich mit kurzen Beschreibungsphrasen und verbindet visuelle Merkmale mit medizinischer Sprache. Während der Verarbeitung lassen spezielle Interaktionsmodule Anatomie‑Prompts und Bildmerkmale bidirektional Informationen austauschen, mit einem Gate‑Schritt, der steuert, wie stark die Anatomie jede Schicht beeinflusst. Diese Kombination hilft dem Modell, sich auf die relevanten Strukturen zu konzentrieren und dabei stabil sowie effizient zu bleiben.

Bessere Genauigkeit mit geringem Aufwand

Die Autorinnen und Autoren testeten A‑VPT an drei bekannten Brustbildgebungsdatensätzen, die alle drei Modalitäten abdecken. Im Vergleich zu klassischen tiefen Netzwerken und mehreren gängigen Fine‑Tuning‑Methoden großer Modelle erzielte ihre Methode die höchsten Werte sowohl bei der Einordnung von Läsionen als gutartig oder bösartig als auch beim Abgrenzen ihrer Konturen. Besonders überzeugend war die Leistung beim Transfer von Wissen zwischen Modalitäten — etwa beim Training an Mammographien und der Auswertung an Ultraschallbildern — ein Bereich, in dem ältere Methoden oft schwächeln. Auffällig ist, dass A‑VPT diese Ergebnisse erreichte, indem weniger als 2 % der Modellparameter aktualisiert wurden, was den Rechenaufwand verringert und die Einsatzmöglichkeiten in echten Kliniken erleichtert. Visualisierungen der „Blick‑Ziele“ des Modells zeigten eine Konzentration auf realistische Drüsen‑ und peritumorale Bereiche, was darauf hindeutet, dass seine Entscheidungen mit dem Denken von Radiologinnen und Radiologen übereinstimmen.

Was das für Patientinnen, Patienten und Kliniken bedeutet

Einfach gesagt zeigt diese Arbeit, dass das Vermitteln grundlegender Anatomiekenntnisse an KI‑Systeme sie sowohl klüger als auch besser nachvollziehbar machen kann. Indem A‑VPT seine Schlussfolgerungen an der realen Struktur der Brust verankert, gelingt ihm das Aufspüren und Umreißen von Tumoren über verschiedene Bildgebungsverfahren hinweg besser — mit weniger Anpassungen und transparenterem Verhalten. Wenn die Methode weiter validiert wird, könnte diese Strategie konsistentere Screening‑ und Diagnoseprozesse in unterschiedlichen Einrichtungen unterstützen, von großen medizinischen Zentren bis zu kleineren Kliniken, und sich auf andere Organe wie Lunge oder Leber übertragen lassen. Letztlich könnte anatomie‑bewusste KI ein wichtiger Partner bei frühzeitigerer und verlässlicherer Krebsdetektion werden.

Zitation: Zhao, S., Meng, Q., He, Y. et al. Anatomy-guided visual prompt tuning for cross-modal breast cancer understanding. npj Digit. Med. 9, 240 (2026). https://doi.org/10.1038/s41746-026-02417-8

Schlüsselwörter: Brustkrebsbildgebung, medizinische KI, Vision Transformer, cross-modales Lernen, anatomiegeleitete Prompts