Clear Sky Science · de

Unabhängige und kollaborative Leistung großer Sprachmodelle und von Fachkräften im Gesundheitswesen bei Diagnose und Triage

Warum das für Ihren nächsten Arztbesuch wichtig ist

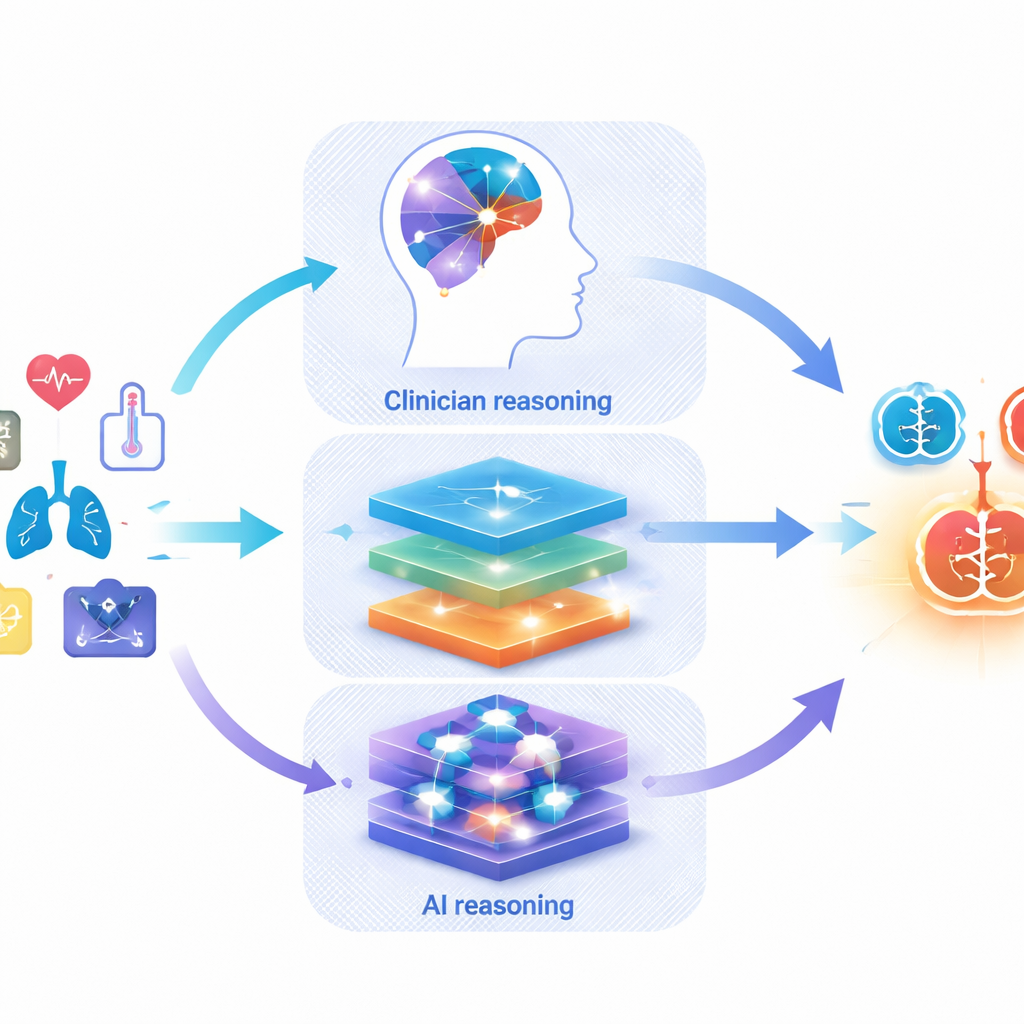

Wenn Sie Ihre Symptome in einen Online-Chatbot eingeben oder eine KI-App fragen, was Ihnen fehlen könnte, nutzen Sie dieselbe Technologie, die Ärzte inzwischen in Krankenhäusern testen: große Sprachmodelle, oder LLMs. Diese Studie stellt eine einfache, aber entscheidende Frage: Wie gut diagnostizieren diese Werkzeuge tatsächlich Krankheiten und beurteilen die Dringlichkeit eines Falls im Vergleich zu echten Gesundheitsfachkräften – und was passiert, wenn beide zusammenarbeiten?

Wie die Forschenden das große Ganze betrachtet haben

Die Autorinnen und Autoren haben nicht einen einzelnen Chatbot in einer Klinik getestet. Stattdessen kombinierten sie Erkenntnisse aus 50 einzelnen Studien, die zwischen 2020 und 2025 weltweit durchgeführt wurden. Diese Studien deckten viele Fachgebiete ab, von Augenkrankheiten und Gehirnscans bis hin zur Notfallversorgung. In jeder Studie erhielten Ärztinnen und Ärzte sowie ein oder mehrere LLMs dieselben Beschreibungen realer oder sorgfältig gestalteter Patientenfälle. Die LLMs sollten mögliche Diagnosen vorschlagen oder entscheiden, wie schnell ein Patient behandelt werden müsse, während die Ärztinnen und Ärzte dasselbe taten. In einigen Studien zeigten die Forschenden den Ärzten zudem die Vorschläge der KI, um zu prüfen, ob das ihre Leistung verbesserte.

Wie gut sind KI-Systeme allein?

Über alle Studien hinweg konnten die KI-Tools oft die richtige Diagnose irgendwo auf ihrer Liste platzieren, lagen aber meist hinter den Ärztinnen und Ärzten zurück, wenn nur eine einzige Antwort gewertet wurde. Wurde nur die erste Vermutung gezählt, waren LLMs im Durchschnitt etwa 11 % weniger genau als Gesundheitsfachkräfte. Mit zunehmender Länge der erlaubten Kandidatenliste wurde dieser Abstand kleiner und verschwand schließlich — sobald bis zu zehn mögliche Diagnosen erlaubt waren, waren die KI-Systeme mindestens ebenso wahrscheinlich wie Ärztinnen und Ärzte, die richtige zu nennen. Bei Triage-Entscheidungen — also der Einschätzung, wie dringend ein Fall ist und welches Versorgungsniveau nötig ist — schnitten KI und Menschen insgesamt ähnlich ab. Die Ergebnisse variierten jedoch stark zwischen einzelnen Modellen und Versuchsaufbauten, was darauf hindeutet, dass manche Werkzeuge deutlich verlässlicher sind als andere.

Was passiert, wenn Ärztinnen und Ärzte KI als Teammitglied nutzen?

Neun Studien untersuchten die Zusammenarbeit direkt: Ärztinnen und Ärzte arbeiteten zuerst allein und wiederholten die Aufgabe anschließend mit Unterstützung eines LLM. Die Ergebnisse waren hier ermutigend. Mit KI-Unterstützung waren die Ärztinnen und Ärzte insgesamt genauer, insbesondere wenn sie mehrere mögliche Diagnosen angeben durften. So verbesserte sich beispielsweise bei kurzen Kandidatenlisten die Treffergenauigkeit mit Hilfe eines LLM je nach Anzahl der berücksichtigten Optionen um rund 10–40 %. Das legt nahe, dass KI besonders nützlich als Brainstorming-Partner ist, der die Bandbreite möglicher Diagnosen erweitert und Kliniker dazu anregt, weniger offensichtliche Erkrankungen in Betracht zu ziehen, während der menschliche Experte weiterhin die endgültige Entscheidung trifft.

Warum die heutigen Ergebnisse besser aussehen können als die Realität

Auch wenn die Zahlen vielversprechend klingen, warnen die Autorinnen und Autoren, dass die meisten vorhandenen Studien weit von ideal entfernt sind. Viele Studien basierten auf aufgeräumten, lehrbuchähnlichen Falldarstellungen oder auf seltenen Fällen, die zu Lehrzwecken ausgewählt wurden, und nicht auf den unordentlichen, unvollständigen Geschichten, die Patienten in echten Kliniken vortragen. Nur eine Handvoll Studien nutzte Echtzeitpatienten. Angaben dazu, wie Fälle ausgewählt wurden, wie die KI-Tools konfiguriert waren und wie Antworten bewertet wurden, fehlten oft. Visuelle Informationen wie Scans oder Hautfotos wurden seltener verwendet, und wenn nur Bilder getestet wurden, übertrafen erfahrene Kliniker die KI deutlich. Die Forschenden heben außerdem hervor, dass sich unerfahrene und erfahrene Kliniker unterschiedlich auf KI-Ratschläge einstellen können und dass Fragen wie Datenschutz, versteckte Verzerrungen und übermäßiges Vertrauen in maschinelle Vorschläge im Alltag weitgehend ungeprüft bleiben.

Was das für Patientinnen und Patienten und die Zukunft der Versorgung bedeutet

Insgesamt legt die Studie nahe, dass aktuelle Chatbots und LLMs nicht bereit sind, Ihre Ärztin oder Ihren Arzt zu ersetzen, aber sie könnten bald wertvolle Assistenten werden. Klug eingesetzt können sie helfen, breitere Diagnoselisten zu erzeugen und genauere Entscheidungen zu unterstützen, insbesondere wenn Ärztinnen und Ärzte die Kontrolle behalten und die KI als Zweitmeinung statt als finales Urteil betrachten. Bevor diese Werkzeuge jedoch in die Routineversorgung integriert werden, fordern die Autorinnen und Autoren besser konzipierte, praxisnahe Studien, klarere Berichtsstandards und robuste Schutzmaßnahmen in Bezug auf Sicherheit, Fairness und Datenschutz. Für Patientinnen und Patienten bedeutet das: KI kann Ihrem Behandlungsteam künftig helfen, weiter zu denken und schneller zu handeln, aber jedes vertrauenswürdige System muss genauso sorgfältig geprüft werden wie ein neues Arzneimittel oder ein medizinisches Gerät.

Zitation: Chen, M., Wu, Y., Ma, J. et al. Independent and collaborative performance of large language models and healthcare professionals in diagnosis and triage. npj Digit. Med. 9, 222 (2026). https://doi.org/10.1038/s41746-026-02409-8

Schlüsselwörter: KI bei medizinischer Diagnose, klinische Triage, große Sprachmodelle, Arzt-KI-Zusammenarbeit, digitale Gesundheitssicherheit