Clear Sky Science · de

Mensch–Großes Sprachmodell-Zusammenarbeit in der klinischen Medizin: eine systematische Übersichtsarbeit und Metaanalyse

Warum das für die alltägliche Gesundheitsversorgung wichtig ist

Ärztinnen und Ärzte greifen zunehmend auf leistungsfähige KI‑Chatbots zurück, sogenannte große Sprachmodelle, um bei komplexen Fällen nachzudenken, Notizen zu verfassen und medizinische Tests zu interpretieren. Diese Studie stellt eine einfache, aber entscheidende Frage: Profitieren Patienten tatsächlich, wenn Ärztinnen und Ärzte mit diesen Werkzeugen zusammenarbeiten? Durch die Zusammenführung der besten verfügbaren Studien zeigen die Autorinnen und Autoren, dass die Antwort komplizierter ist als der Hype vermuten lässt – manchmal hilft die Zusammenarbeit, manchmal bewirkt sie wenig, und in einigen Situationen kann sie sogar hinderlich sein.

Was die Forschenden untersucht haben

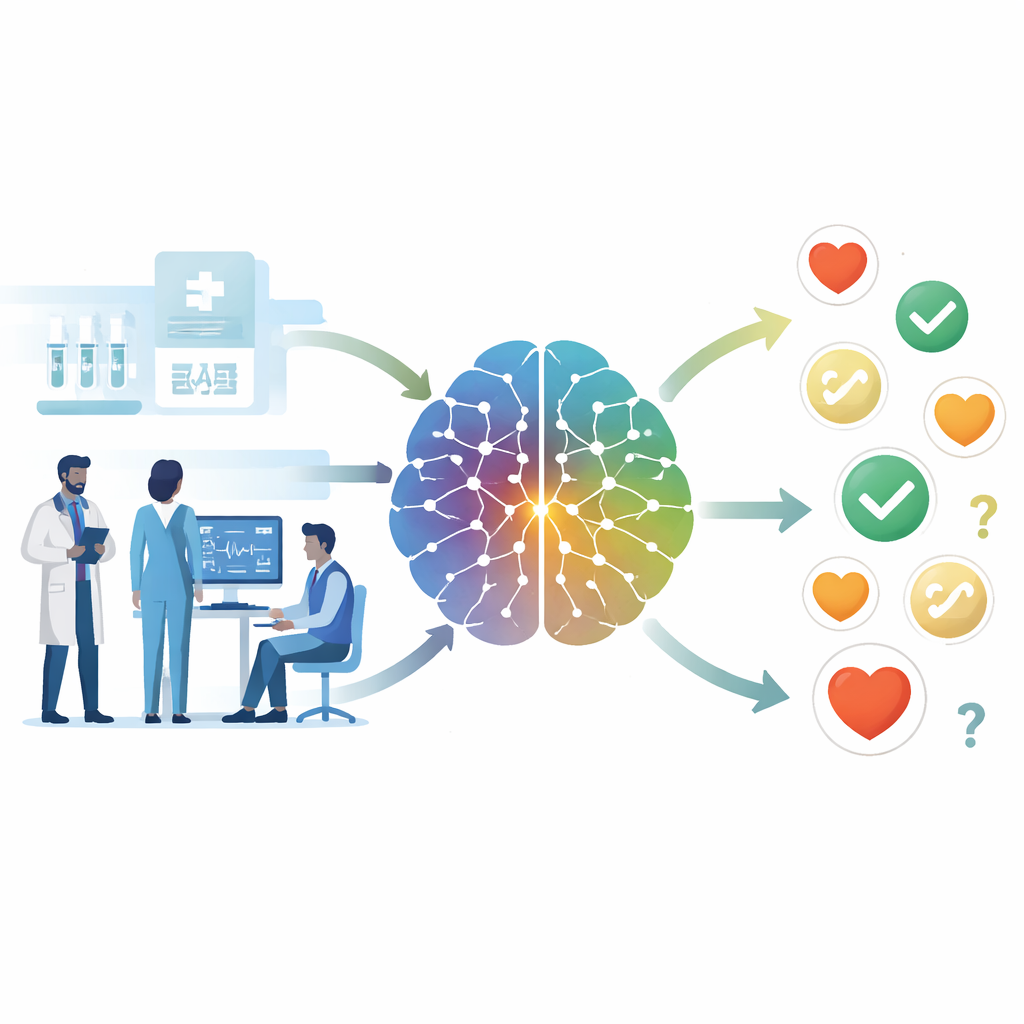

Das Team durchsuchte systematisch die wichtigen medizinischen Datenbanken nach Studien, in denen Klinikpersonal entweder mit oder ohne Unterstützung eines KI‑Systems auf Basis großer Sprachmodelle wie GPT‑4 arbeitete. Aufnahmefähig war eine Studie nur, wenn ein „Arzt plus KI“-Arbeitsablauf direkt mit der üblichen Versorgung durch Ärztinnen und Ärzte allein verglichen wurde und manchmal zusätzlich mit der KI allein. Die klinischen Aufgaben reichten über eine Bandbreite realer Probleme: die Einschätzung, was bei kritisch kranken Patientinnen und Patienten vorliegen könnte, die Interpretation von Hirnbildern, das Schreiben und Lesen von Klinikberichten sowie Entscheidungen zur Behandlung von Brustschmerzen und anderen häufigen Beschwerden. Insgesamt bildeten 10 peer‑reviewte Studien das Rückgrat der Analyse; einige zusätzliche Preprints wurden nur herangezogen, um die Robustheit der Schlussfolgerungen zu prüfen.

Wie gut die Arzt–KI‑Teams abschnitten

Über diese Studien hinweg zeigte die Kombination aus Ärztinnen/Ärzten und KI in einigen Messgrößen zur Diagnose‑ und Therapiequalität kleine, aber erkennbare Verbesserungen. In zwei randomisierten Studien, die detaillierte Bewertungssysteme für Fallentscheidungen verwendeten, erzielten die Arzt–KI‑Teams etwa fünf Prozentpunkte höhere Werte als Ärztinnen und Ärzte allein. Einfach ausgedrückt: Wenn Ärztinnen und Ärzte allein etwa 100 wichtige Entscheidungen trafen, könnte das Hinzuziehen der KI etwa fünf dieser Entscheidungen davor bewahren, falsch zu sein. Die Autorinnen und Autoren betonen jedoch, dass die zugrundeliegenden Daten dünn sind: Nur ein paar Studien lieferten diese Schätzungen, und die Bandbreite plausibler Ergebnisse in der realen Welt ist so groß, dass sie keinen Nutzen — oder in anderen Umgebungen sogar Schaden — einschließen kann.

Geschwindigkeit, Dokumentation und versteckte Fehler

Viele hoffen, dass KI Ärztinnen und Ärzten Zeit freischaufelt. Hier war die Evidenz ernüchternd. Als die Forschenden drei Studien zusammenführten, die die Dauer von Aufgaben maßen, fanden sie im Grunde keine Zeitersparnis insgesamt. In einigen simulierten Übungen waren Ärztinnen und Ärzte mit KI etwas schneller; in einer Studie in einer realen Klinik war die Nettowirkung auf die Besuchsdauer nahezu null, obwohl einige Untergruppen moderate Vorteile sahen. Die Dokumentation ergab eine ähnliche „gemischte“ Bilanz. KI‑Unterstützung machte Notizen oft klarer und strukturierter und half Nicht‑Spezialisten, technische Befunde aus der Augenheilkunde besser zu verstehen. Prüften Forschende jedoch die Fakten, stellten sie fest, dass etwa jede dritte KI‑unterstützte Notiz weiterhin Fehler enthielt. Diese Diskrepanz — besser aussehende Aufzeichnungen, die dennoch falsch sein können — wirft eindeutige Sicherheitsbedenken auf.

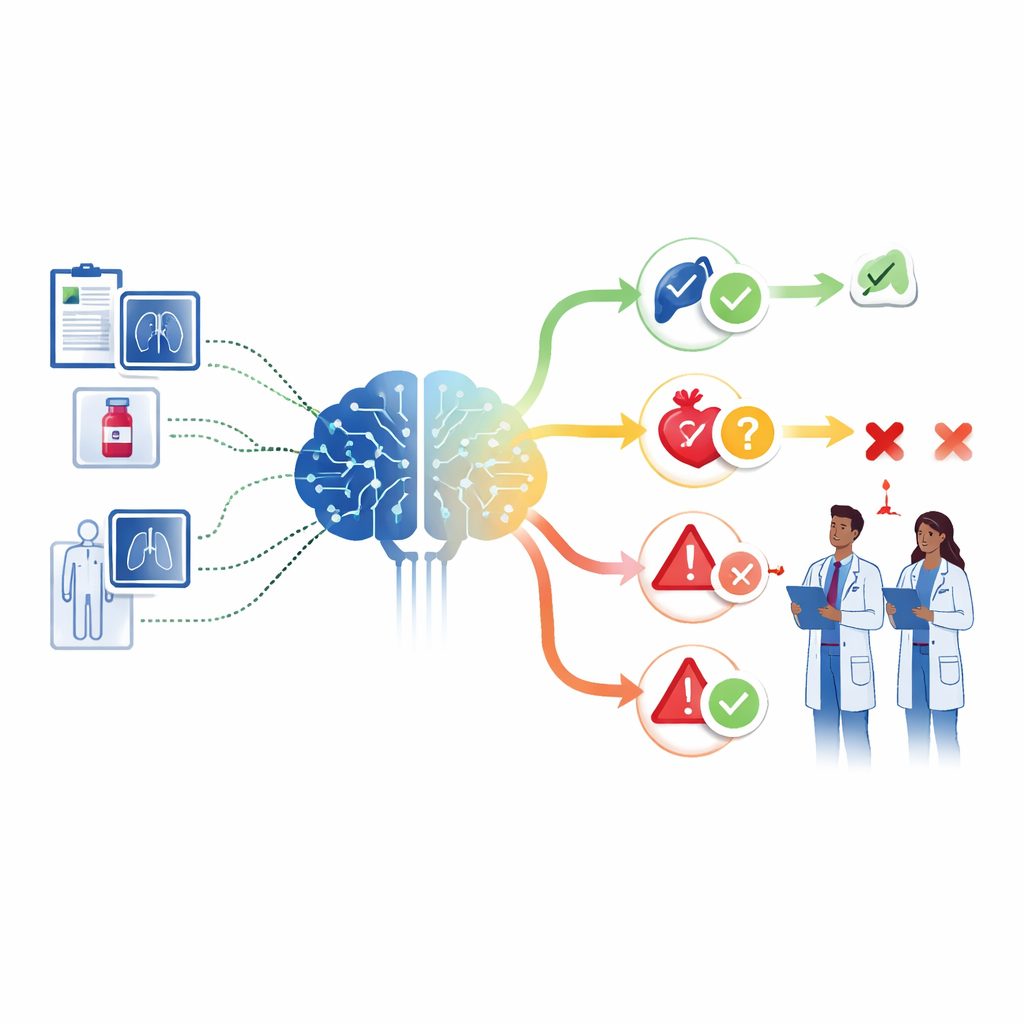

Wenn die Zusammenarbeit nicht besser ist als die Maschine

Eine auffällige Erkenntnis stammt aus Studien, die auch die KI allein testeten. In einer Studie mit kritisch kranken Patientinnen und Patienten schnitt die KI allein ungefähr so gut ab wie das Arzt–KI‑Team und besser als viele Einzelärztinnen und -ärzte. In einer anderen Studie waren KI‑generierte Befundberichte klar schlechter als die von menschlichen Expertinnen und Experten erstellten Berichte, unabhängig davon, ob die KI als Assistentin eingesetzt wurde. Zusammengenommen decken diese Ergebnisse das auf, was die Autorinnen und Autoren als „Kollaborationsparadoxon“ bezeichnen: Die bloße Einbindung eines Menschen in den Prozess garantiert kein besseres Ergebnis gegenüber einer starken KI, und in einigen Situationen kann die Partnerschaft die Stärken beider verwässern. Faktoren wie die Art der Präsentation von Empfehlungen, das Ausmaß des Vertrauens oder Misstrauens der Ärztinnen und Ärzte sowie wie das Werkzeug in den täglichen Arbeitsablauf eingebettet ist, beeinflussen, ob die Zusammenarbeit nützt oder schadet.

Was das für die Zukunft von Arzt–KI‑Teams bedeutet

Insgesamt zeichnet die Übersichtsarbeit ein Bild von vorsichtigem Potenzial statt einer bereits erreichten Revolution. Arzt–KI‑Teams können bestimmte Entscheidungswerte moderat verbessern und medizinische Texte lesbarer machen, sie sparen jedoch nicht verlässlich Zeit und produzieren weiterhin eine beunruhigende Anzahl faktischer Fehler. Die Autorinnen und Autoren plädieren dafür, dass Gesundheitssysteme diese Werkzeuge schrittweise einführen sollten, mit starken Schutzmaßnahmen, die darauf abzielen, Fehler zu erkennen statt nur die Effizienz zu steigern. Sie fordern zudem größere, reale klinische Studien, die KI‑Assistenz in viel frequentierten Krankenhäusern und Kliniken testen, nicht nur in kontrollierten Fallsimulationen. Bis solche Belege vorliegen, ist der sicherste Weg, große Sprachmodelle als mächtige, aber fehlbare Assistenten zu behandeln — und Arbeitsabläufe so zu gestalten, dass Klinikerinnen und Kliniker als kritische Prüferinnen und Prüfer und Torwächter fungieren, nicht als passive Akzeptierende von KI‑Empfehlungen.

Zitation: Wang, G., Zhang, K., Jiang, J. et al. Human–large language model collaboration in clinical medicine: a systematic review and meta-analysis. npj Digit. Med. 9, 195 (2026). https://doi.org/10.1038/s41746-026-02382-2

Schlüsselwörter: Mensch–KI-Zusammenarbeit, klinische Entscheidungsunterstützung, große Sprachmodelle, Diagnosegenauigkeit, medizinische Dokumentation