Clear Sky Science · de

DARE-FUSE: domänenabgestimmtes, evidenzgesteuertes Lernen für gemeinsame MRT-Segmentierung und -Klassifikation von Hirntumoren

Warum klügere Gehirnscans wichtig sind

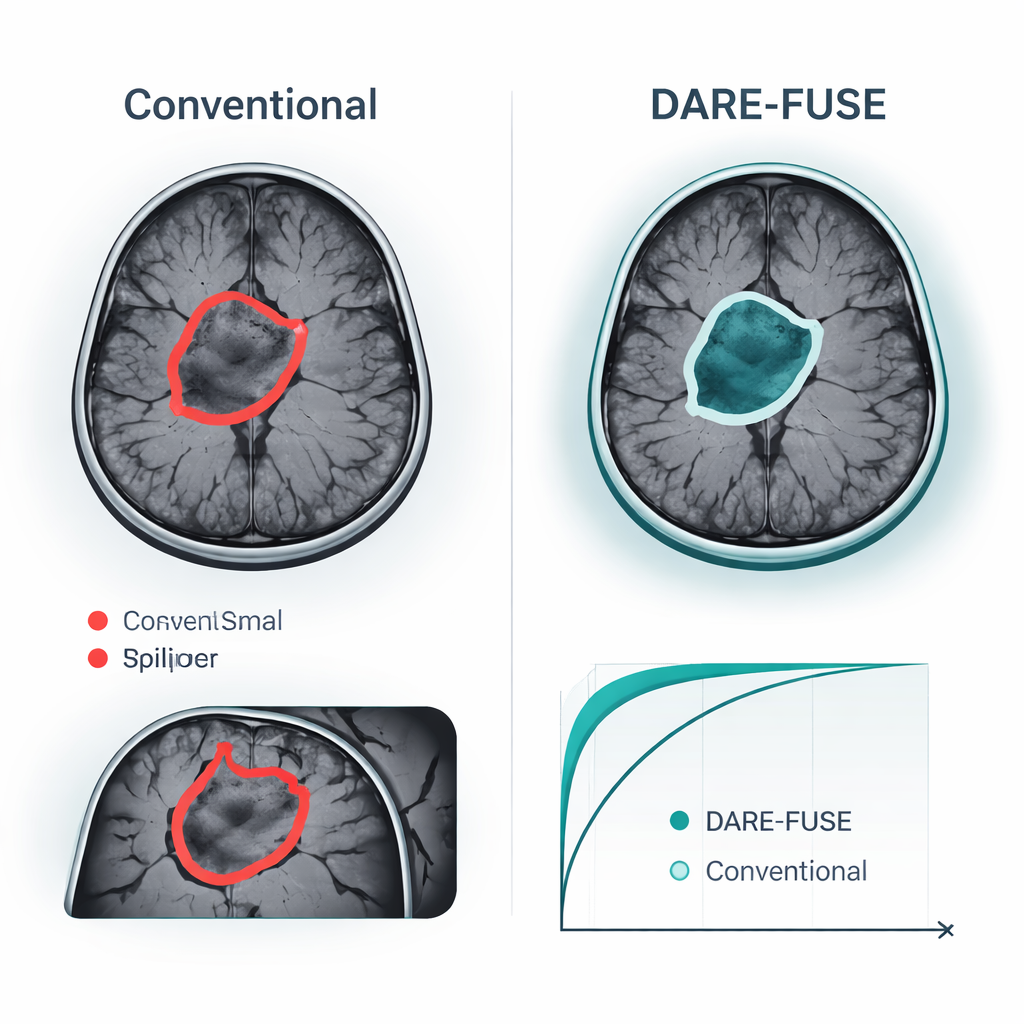

Hirntumoren gehören zu den am meisten gefürchteten Diagnosen in der Medizin, und die Magnetresonanztomographie (MRT) ist das wichtigste Werkzeug, mit dem Ärztinnen und Ärzte erkennen, wo ein Tumor beginnt und endet. Trotzdem tun sich selbst erfahrene Radiologinnen und Radiologen schwer, einen Tumor präzise zu umreißen und seine Veränderung über die Zeit einzuschätzen, besonders wenn die Ränder in angeschwollenes Hirngewebe übergehen. Dieses Paper stellt DARE-FUSE vor, ein neues KI-System, das Gehirn-MRTs zuverlässiger liest, schärfere Tumorgrenzen zieht und klarere Erklärungen seiner Entscheidungen liefert, um Chirurgen, Onkologen und Patientinnen und Patienten zu unterstützen.

Verschwommene Ränder und überlastete Kliniken

In echten Krankenhäusern sind Hirn-MRTs unordentlich. Tumoren gehen oft in die angrenzende Schwellung über, Metallimplantate können das Bild verzerren, und unterschiedliche Kliniken verwenden leicht verschiedene Scan-Einstellungen. Radiologinnen und Radiologen müssen manuell Hunderte von Bildern durchblättern, den Tumor Schicht für Schicht markieren und dann beurteilen, wie er sich verhält. Diese Arbeit ist zeitaufwändig, ermüdend und anfällig für Meinungsverschiedenheiten zwischen Expertinnen und Experten. Bestehende KI-Tools können helfen, Tumoren zu umreißen oder Scans als „Tumor“ oder „kein Tumor“ zu kennzeichnen, aber die meisten Systeme behandeln diese Aufgaben getrennt, und viele versagen, wenn die Bilder aus neuen Zentren stammen oder feine, unregelmäßige Wucherungen an den Rändern enthalten.

Ein einheitlicher KI-Assistent für Tumorkarten und -kennzeichnungen

DARE-FUSE nimmt mehrere dieser Hürden gleichzeitig in Angriff. Es ist als eine einzige Pipeline aufgebaut, die sowohl den Tumor auf jeder MRT-Schicht nachzeichnet (Segmentierung) als auch ganze Bilder in diagnostische Gruppen einordnet (Klassifikation). Im Kern stehen zwei kooperierende „Sichten“: ein Netzwerk, das auf Detailformen und -grenzen abgestimmt ist, und ein anderes, das auf globale Muster fokussiert ist, die verschiedene Tumortypen unterscheiden. Ein spezielles Anpassungsmodul hält diese Sichten über Krankenhäuser und Scanner hinweg in Einklang, sodass Merkmale, die aus einem Datensatz gelernt wurden, die Leistung auf einem anderen nicht beeinträchtigen. Das System schätzt zudem seine eigene Unsicherheit ein und markiert so Bereiche, in denen es sich über den genauen Tumorrand weniger sicher ist — ein wesentliches Merkmal für einen sicheren klinischen Einsatz.

Nutzen von Hinweisen aus Heatmaps und „tumorfrei“ rekonstruierten Bildern

Statt sich auf ein einzelnes Signal zu verlassen, lernt DARE-FUSE aus mehreren Evidenzarten. Ein Zweig erzeugt Heatmaps, die zeigen, welche Hirnbereiche die Klassifikationsentscheidung der KI am stärksten stützen. Ein anderer Zweig verwendet ein generatives Modell, um sich vorzustellen, wie derselbe Scan aussehen würde, wenn der Tumor entfernt wäre, und vergleicht dann diese „tumorfrei“-Version mit dem Original. Die Unterschiede zwischen beiden heben subtile strukturelle Veränderungen und Kanten hervor, die in einer Standard-Heatmap möglicherweise nicht stark sichtbar wären. Ein Fusionsmodul kombiniert diese Hinweise dann zu einer kontinuierlichen „Tumor-Prior“-Karte: Regionen, in denen mehrere Quellen übereinstimmen, werden als Kern des Tumors behandelt, während unsicherere Bereiche vorsichtiger ergänzt und bei hoher Modellunsicherheit abgeschwächt werden. Dieser gemischte Prior leitet die endgültige Kontur und hilft, sowohl übersehene Tumorherde als auch falsche Inseln im gesunden Gewebe zu vermeiden.

Nachgewiesene Verbesserungen an öffentlichen Hirntumor-Datensätzen

Die Autorinnen und Autoren getesteten DARE-FUSE an sechs großen, multizentrischen Hirntumor-Challenges (der BraTS-Reihe) und vier öffentlichen MRT-Sammlungen, die für die Bild-level-Klassifikation verwendet werden. In allen BraTS-Editionen erreichte das System mindestens die Leistung der besten aktuellen Deep-Learning-Modelle oder übertraf sie, mit etwas höherer Überlappung zwischen den vorhergesagten Tumormasken und Expertenscribbles sowie durchweg geringeren Fehlern bei der gemessenen Tumoroberfläche. Diese Verbesserungen zeigten sich besonders in schwierigen Fällen: kleine Tumoren, kontrastarme Ränder und komplexe, unregelmäßige Formen. In Klassifikationsaufgaben — etwa der Entscheidung, ob ein Scan ein Gliom, Meningiom, Hypophysentumor oder keinen Tumor zeigt — übertraf DARE-FUSE ebenfalls starke Transformer- und schwach überwachungsbasierte Baselines in Genauigkeit und in einer standardisierten Diskriminierungsmetrik (AUC). Wichtig ist, dass das System bei künstlich reduzierten detaillierten Annotationen nur langsam an Leistung verlor und seinen Vorsprung gegenüber semi-supervised und schwach überwachten Konkurrenten beibehielt.

Was das für Patientinnen und Patienten bedeuten könnte

Für Patientinnen, Patienten und Klinikpersonal besteht das Hauptversprechen von DARE-FUSE weniger in einem spektakulären neuen Algorithmus als in verlässlicherer, interpretierbarer Bildunterstützung. In der Praxis könnte das System einen Tumorumriss vorschlagen, Regionen markieren, in denen es weniger sicher ist, und Heatmaps anzeigen, die erklären, welche Bildbereiche seine Klassifikation antreiben. Ärztinnen und Ärzte könnten gering unsichere Regionen als Ausgangskontur akzeptieren und ihre Aufmerksamkeit auf die markierten Bereiche richten, statt alles von Grund auf neu zu zeichnen. Genauere und konsistentere Messungen von Tumorvolumen und -form könnten die Behandlungsplanung, die Bestrahlungszielsetzung und das Monitoring des Therapieansprechens verbessern. Während die Autorinnen und Autoren betonen, dass ihr Tool ein Assistent und kein Ersatz für fachliche Urteilsbildung ist, deuten ihre Ergebnisse auf KI-Systeme hin, die Tumoren klarer sehen und ihr Konfidenzniveau in einer für Klinikerinnen und Kliniker handhabbaren Form kommunizieren können.

Zitation: Liu, Y., Sun, C., Niu, Y. et al. DARE-FUSE: domain aligned evidence guided learning for joint brain tumor MRI segmentation and classification. npj Digit. Med. 9, 178 (2026). https://doi.org/10.1038/s41746-026-02365-3

Schlüsselwörter: Hirntumor-MRT, Segmentierung medizinischer Bilder, Tiefes Lernen in der Radiologie, klinische Entscheidungsunterstützung, unsicherheitsbewusste KI