Clear Sky Science · de

Regulatorische Wissenschaft für Medizinprodukte skalieren mit großen Sprachmodellen

Warum das für Patienten und Ärztinnen wichtig ist

Die moderne Medizin füllt sich schnell mit „intelligenten“ Geräten, die Künstliche Intelligenz nutzen, um Bilder zu lesen, Vitalwerte zu überwachen und Ärztinnen bei Entscheidungen zu unterstützen. Allein in den Vereinigten Staaten wurden bereits mehr als tausend solcher Werkzeuge von der Food and Drug Administration (FDA) zugelassen oder freigegeben. Jedes Gerät hinterlässt eine Papierspur aus komplexen Entscheidungen und Sicherheitsaufzeichnungen. Heute wird ein Großteil dieser Informationen noch manuell gesichtet, was langsam, teuer und bald nicht mehr aktuell ist. Dieser Beitrag untersucht, ob große Sprachmodelle—die gleiche Art von KI, die fortschrittliche Chatbots antreibt—verlässlich solche Dokumente in großem Maßstab lesen und in nutzbare Daten verwandeln können, damit Aufsichtsbehörden, Forschende und die Öffentlichkeit besser verstehen, wie gut diese Geräte konstruiert sind und wie sicher sie arbeiten.

Das Problem zu vieler komplexer Dokumente

Jedes KI-gestützte Medizinprodukt wird von umfangreichen Entscheidungszusammenfassungen, Sicherheitsberichten und Rückrufmeldungen begleitet. Diese Dokumente sind lang, in dichtem Fachjargon verfasst und enthalten oft Tabellen, Bilder und uneinheitliche Formatierungen. Frühere Untersuchungen haben gezeigt, dass das Beantworten grundlegender Fragen—wie etwa wie ein Gerät vor der Zulassung getestet wurde oder was genau schiefgelaufen ist, wenn es ausfiel—Teams von Experten erforderte, die Hunderte von PDFs Zeile für Zeile lesen. Einfache Suchwerkzeuge und Mustererkennung finden offensichtliche Details wie ID-Nummern, tun sich jedoch schwer mit tiefergehenden Fragen, die Urteil erfordern, etwa ob eine Studie mehrere Krankenhäuser einschloss oder ob ein Gerät tatsächlich zu Verletzungen oder Todesfällen beigetragen hat. Mit der Explosion der Anzahl KI-fähiger Geräte ist dieses manuelle Vorgehen nicht mehr zu bewältigen.

Eine KI‑Pipeline, die wie ein Experte liest

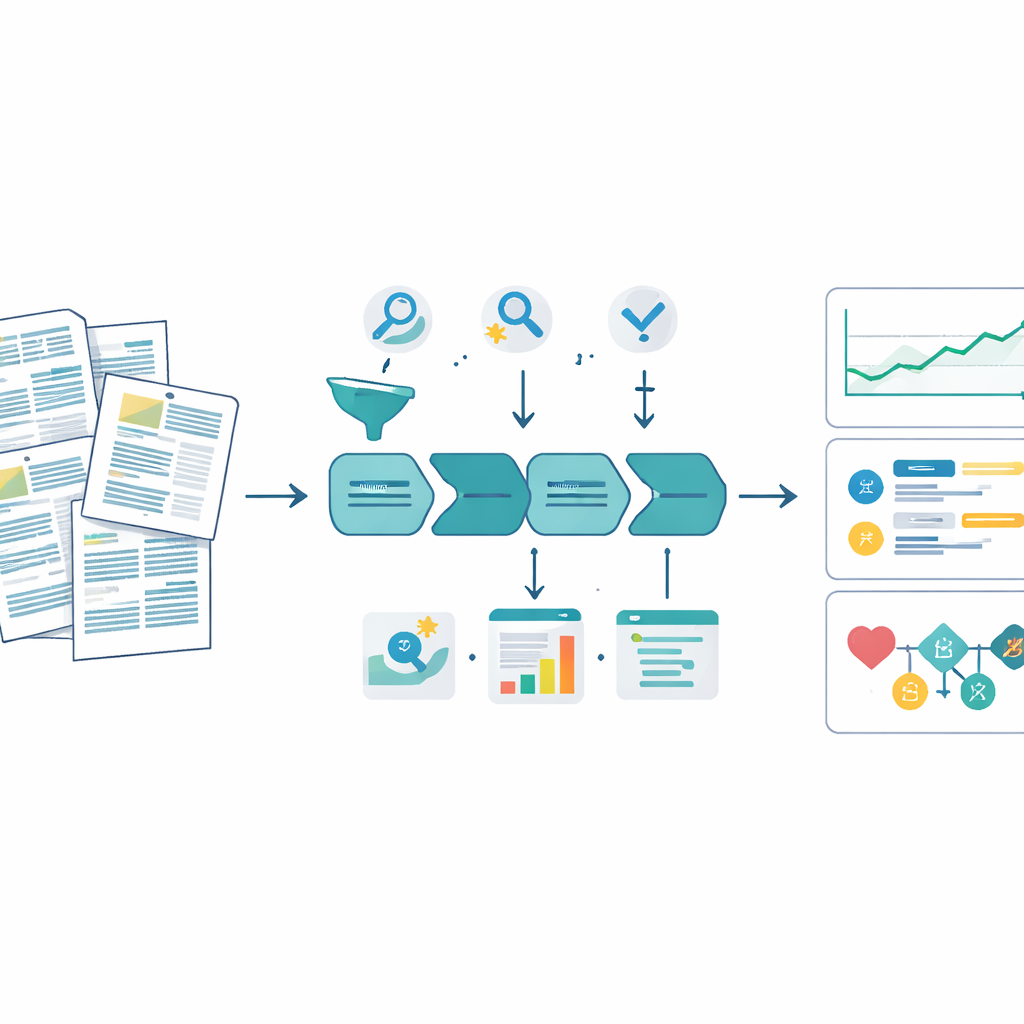

Die Autorinnen und Autoren entwickelten eine allgemeine Pipeline, die auf einem hochmodernen großen Sprachmodell basiert, um diese Herausforderung anzugehen. Zunächst sammelten sie alle öffentlich verfügbaren FDA-Entscheidungszusammenfassungen und Sicherheitsberichte für 1.247 KI- oder Machine-Learning-Geräte sowie 1.852 zugehörige Meldungen über unerwünschte Ereignisse bis Mitte 2025, bereinigten die PDFs und setzten bei Bedarf optische Zeichenerkennung ein. Statt das Modell zu bitten, breit gefasste Fragen auf einmal zu beantworten, zerlegten sie die Arbeit in kleinere, klar definierte Teilaufgaben. Für jeden Dokumententyp erhielt das Modell detaillierte Anweisungen, die in offiziellen FDA-Richtlinien verankert waren, sowie Beispiele dafür, wie Menschen Informationen kennzeichnen würden. Das Modell sollte Schritt für Schritt erläutern und seine Antworten in einem strikten, strukturierten Format ausgeben, wodurch freier Text in klare Felder wie „Anzahl der Studienzentren“, „Art des Sicherheitsereignisses“ oder „Art der Geräteänderung“ überführt wurde.

Überprüfung der Genauigkeit bei realen regulatorischen Fragen

Um zu prüfen, ob diesem System vertraut werden kann, führte das Team drei Fallstudien durch, in denen frühere Forschende bereits monatelang manuell geprüft hatten. Zuerst untersuchten sie erneut, wie Geräte vor der Zulassung getestet werden, indem sie fragten, ob Studien prospektiv durchgeführt wurden (Daten wurden fortlaufend erhoben) und ob mehrere Krankenhäuser beteiligt waren. Beim Vergleich der Modellausgaben mit Expertenkennzeichnungen lagen die Übereinstimmungsraten häufig über 80 bis 90 Prozent und damit im Bereich der Übereinstimmung zwischen menschlichen Annotatoren. Zweitens nutzten sie das Modell, um Sicherheitsberichte über Fehlfunktionen, Verletzungen oder Todesfälle neu zu kennzeichnen und zu klassifizieren, was genau schiefgelaufen war. Als menschliche Gutachter die ursprünglichen Codes des Herstellers mit denen des Modells verglichen—ohne zu wissen, welche Quelle welche war—zogen sie in der großen Mehrheit der Fälle die Modellvorschläge vor, besonders bei sensiblen Kategorien wie Tod versus Fehlfunktion. Drittens verknüpften die Forschenden Details aus Zulassungsdokumenten mit späteren Sicherheitsberichten, um zu untersuchen, welche frühen Entscheidungen—etwa die Wahl eines Vorgängermodells mit früheren Rückrufen oder größere Hardwareänderungen—statistisch mit einem höheren Risiko zukünftiger Probleme verbunden waren.

Was die Ergebnisse über Sicherheit und Aufsicht offenbaren

Nach der Validierung ermöglichte die Pipeline dem Team, diese Analysen von Dutzenden auf die gesamte bekannte Population KI-fähiger medizinischer Geräte auszuweiten. Sie fanden beispielsweise, dass prospektive klinische Bewertungen über drei Jahrzehnte hinweg relativ selten geblieben sind und bei etwa einem von zehn Geräten liegen, während Erwähnungen von Multi‑Site-Tests deutlich zugenommen haben. In den Sicherheitsberichten deckte das Modell Muster auf, bei denen die im Text beschriebene Problemart nicht mit dem an die FDA übermittelten Code übereinstimmte—etwa Fälle, in denen Hardwarefehler als Bildqualitätsprobleme kodiert wurden. Bei der Verknüpfung von Zulassungsmerkmalen mit späteren Sicherheitsereignissen zeigten Geräte, deren Vorgänger bereits Rückrufe oder unerwünschte Ereignisse hatten, deutlich höhere Gefahrenraten für neue Meldungen, während Geräte mit klinischer Absicherung tendenziell ein geringeres Risiko aufwiesen. Diese Ergebnisse sind explorativ, veranschaulichen jedoch die Fragestellungen, die nun routinemäßig statt nur in Einzelfallprojekten beantwortet werden können.

Grenzen, Schutzmaßnahmen und der weitere Weg

Die Autorinnen und Autoren betonen, dass ihr Ansatz nicht fehlerfrei ist und das fachliche Urteil nicht ersetzen sollte. Eine Genauigkeit von rund 80 Prozent mag für die Analyse großer Trends ausreichend sein, aber nicht für Entscheidungen zu einem einzelnen Gerät oder Patienten. Die Leistung kann je nach Gerätetyp und Jahr variieren, und die Qualität der zugrunde liegenden FDA-Dokumente und Sicherheitsdatenbanken bleibt ein wesentlicher Engpass. Dennoch zeigt diese Studie, dass sorgfältig gestaltete Sprachmodellsysteme Berge unstrukturierter regulatorischer Texte innerhalb von Tagen statt Jahren in strukturierte, prüfbare Daten verwandeln können. Für Laien lautet die Quintessenz: Dieselben KI-Technologien, die Verbraucher‑Chatbots antreiben, können auch Aufsichtsbehörden und Forschenden helfen, nachzuverfolgen, wie KI-Medizinprodukte entwickelt, getestet und überwacht werden—was potenziell zu schnellerer Entdeckung von Problemen und besseren Grundlagen für sicherere Regeln und Produkte führen kann.

Zitation: Li, H., He, X., Subbaswamy, A. et al. Scaling medical device regulatory science using large language models. npj Digit. Med. 9, 221 (2026). https://doi.org/10.1038/s41746-026-02353-7

Schlüsselwörter: KI-Medizinprodukte, regulatorische Wissenschaft, große Sprachmodelle, FDA-Sicherheitsberichte, Aufsicht über Gesundheitstechnologie