Clear Sky Science · de

Multimodale Fusion von Pathologie- und Radiologie-Foundation-Modellen für die WHO-2021-Gliom-Subtypisierung

Zwei Sichtweisen auf Gehirntumoren zusammenführen

Wenn bei einer Person ein Gehirntumor diagnostiziert wird, müssen Ärztinnen und Ärzte nicht nur wissen, dass ein Tumor vorhanden ist, sondern um welchen genauen Typ es sich handelt. Verschiedene Tumortypen sprechen sehr unterschiedlich auf Operationen, Strahlentherapie und Medikamente an. Heute erfordert diese detaillierte „Subtypisierung“ meist genetische Tests, die langsam, teuer und nicht überall verfügbar sein können. Diese Studie untersucht, ob ein intelligentes Computersystem, das sowohl Hirnscans als auch mikroskopische Bilder von Tumorgewebe auswertet, zuverlässig diese Subtypen ableiten kann — und damit den Zugang zu präzisen Therapien beschleunigen und verbreitern könnte.

Warum der Tumortyp wichtig ist

Diffuse Gliome bei Erwachsenen gehören zu den tödlichsten Hirnkrebsen, sehen auf Standardscans und unter dem Mikroskop jedoch oft ähnlich aus. Moderne Leitlinien teilen sie in drei genetische Subtypen ein, die sich stark in ihrer Aggressivität und der zu erwartenden Überlebensdauer unterscheiden. Der derzeitige Goldstandard zur Unterscheidung dieser Subtypen beruht auf molekularen Tests der Tumor-DNA. Diese Tests benötigen zusätzliches Gewebe, spezialisierte Labore und Wartezeiten von Tagen bis Wochen. Die Autorinnen und Autoren fragen, ob routinemäßig erhobene Magnetresonanztomographien (MRT) und digitale Pathologie-Färbungen kombiniert genug Informationen liefern könnten, um Teile dieser genetischen Untersuchung zu ersetzen.

Maschinen beibringen, Scans und Schnitte zu lesen

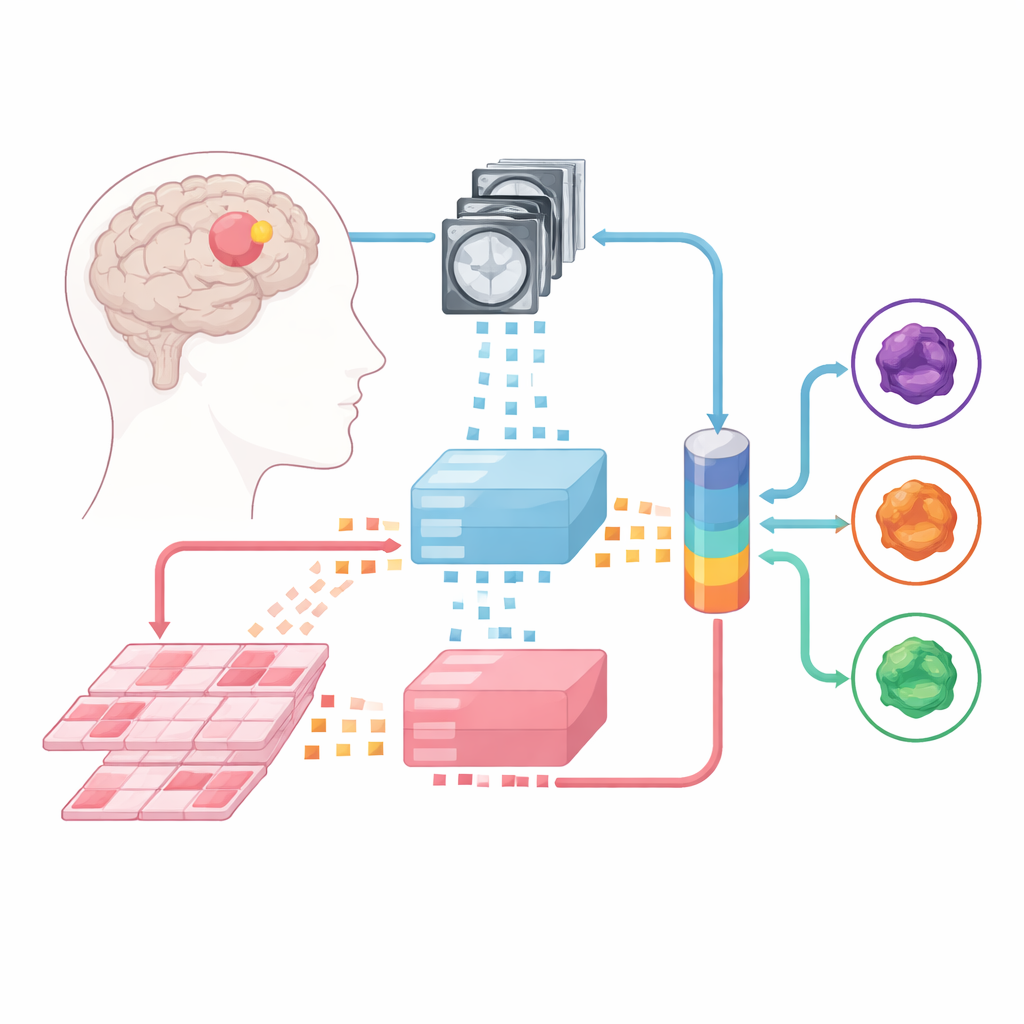

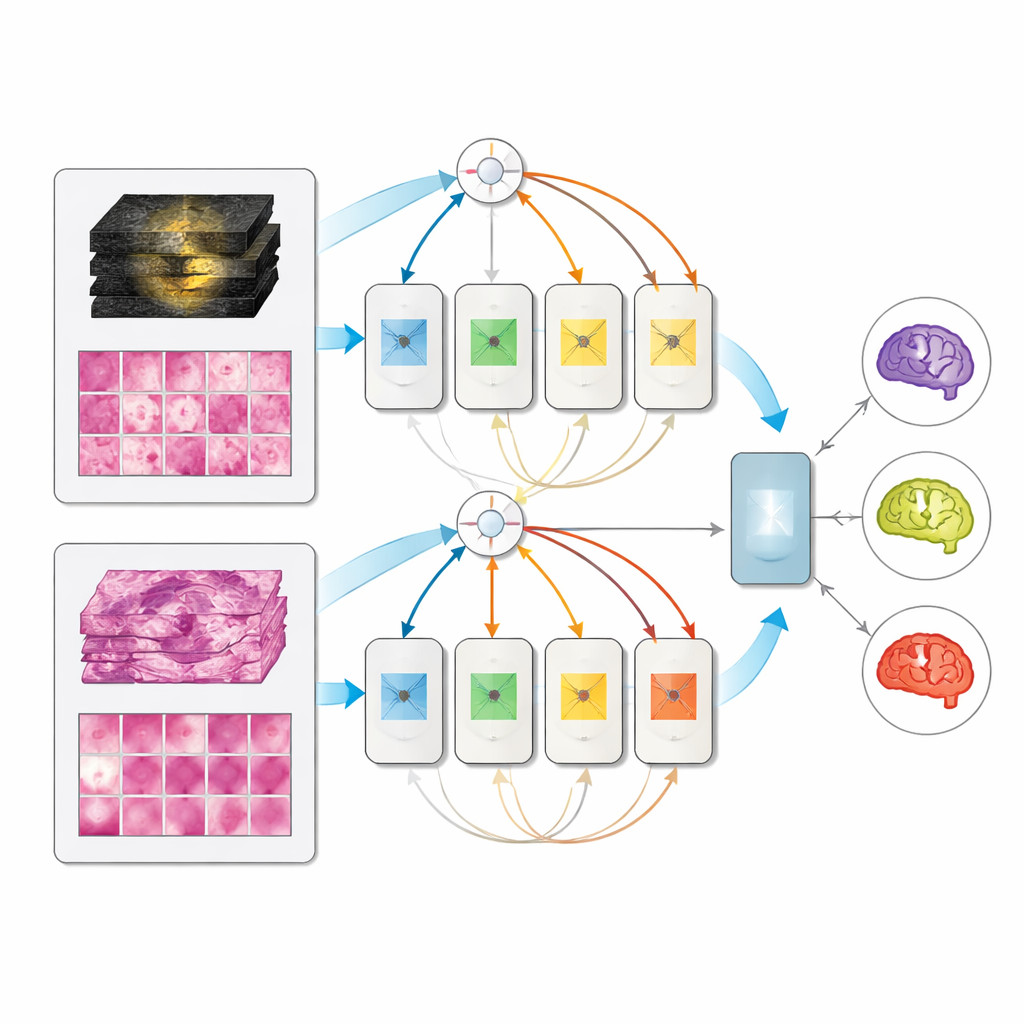

Das Team baute auf großen „Foundation-Modellen“ auf — leistungsfähigen Bildanalysatoren, die zuvor an enormen Sammlungen medizinischer Bilder trainiert wurden. Ein Modell verarbeitet multiparametrische MRTs, ein anderes hochauflösende Pathologie-Schnitte aus Tumorgewebe. Jeder Fall wird in kleine Bildausschnitte zerlegt, die die Foundation-Modelle in numerische Fingerabdrücke umwandeln. Auf diesen festen „Expert“-Repräsentationen trainierten die Forschenden drei Arten von Fusionsmodellen, die lernen, Informationen aus MRT und Pathologie zu kombinieren: ein Late-Fusion-Design, ein Early-Fusion-Design und eine flexiblere Mixture-of-Experts-Architektur, die dynamisch entscheiden kann, wie stark auf jede Quelle vertraut werden soll.

Modalitäten mischen, ohne Patienten abzugleichen

Ein praktisches Hindernis für multimodale Methoden ist, dass Krankenhäuser selten große Datensätze haben, in denen für jede Patientin/jeden Patienten sowohl MRT- als auch Pathologie-Bilder sauber gepaart vorliegen. Statt auf perfekt gematchte Daten zu bauen, stellten die Autoren separate Sammlungen zusammen: Hunderte MRT-Fälle aus mehreren Zentren und Hunderte Pathologie-Fälle aus einer anderen Quelle, plus eine kleinere Menge von 171 Patientinnen/Patienten aus einem öffentlichen Krebsprojekt, die beides hatten. Beim Training kombinierten sie oft eine MRT einer Person mit einem Pathologie-Schnitt einer anderen, solange die Tumore zum selben Subtyp gehörten. Erstaunlicherweise funktionierten Modelle, die auf solchen „unpaarigen“ Daten trainiert wurden, genauso gut wie solche, die mit echten Patientenpaaren trainiert wurden, und deutlich besser als eine einfache Mittelung zweier einzelmodaler Modelle.

Ein einzelnes Modell, das sich an Verfügbarkeit anpasst

Auf dem aussortierten Datensatz der 171 vollständig charakterisierten Patientinnen und Patienten übertrafen alle multimodalen Modelle ihre einzelnen Eingabemodelle, und das Mixture-of-Experts-Design erzielte die besten Ergebnisse und sehr hohe Werte bei der Unterscheidung der drei Subtypen. Bemerkenswert ist, dass das multimodale Modell bei Testzeitpunkten, an denen nur MRT oder nur Pathologie vorlag, nicht zusammenbrach; es erreichte annähernd die Leistung dedizierter Einzelmodalitäts-Modelle. Das bedeutet, dass eine Klinik ein einheitliches System einsetzen könnte, das mit den verfügbaren Informationen arbeitet — nur Prä-OP-Scans, nur postoperatives Gewebe oder beides zusammen — anstatt für jedes Szenario separate Werkzeuge zu betreiben.

Erkennen, was das Modell sieht

Um Vertrauen in die Entscheidungen des Systems zu schaffen, untersuchten die Forschenden, wohin das Modell „blickt“ und welche Bildmerkmale am wichtigsten sind. Aufmerksamkeitskarten zeigten, dass das gemeinsame Modell seinen Fokus breiter über Tumor und Umgebung verteilt — sowohl in MRTs als auch in Gewebeschnitten — und dass eine diffusere Aufmerksamkeit tendenziell mit korrekten Vorhersagen zusammenfiel. Eine tiefere Analyse der gelernten Merkmale offenbarte Muster, die bekannten medizinischen Hinweisen entsprechen: MRT-Merkmale, die kontrastverstärkte Tumorkerne und verzerrte Liquorräume hervorheben, halfen, aggressivere Tumoren zu separieren, während Gewebemerkmale, die klassische Zellformen und Texturen erfassen, halfen, spezifische Gliom-Subtypen zu erkennen. Es traten auch interessante Lücken zutage: Das Modell kodierte einige lehrbuchmäßige Hinweise auf die aggressivsten Tumoren nicht stark, was die Idee stützt, dass es diese Gruppe oft als „Standard“ behandelt, sofern keine starken Hinweise auf einen günstigeren Subtyp vorliegen.

Was das für Patientinnen und Patienten bedeuten könnte

Kurz gesagt zeigt diese Arbeit, dass ein KI-System, das Hirnscans und mikroskopische Bilder kombiniert, Gehirntumoren genauer klassifizieren kann als Systeme, die nur einen Bildtyp betrachten, und dass es selbst dann trainiert werden kann, wenn die beiden Bildtypen nicht von denselben Patientinnen und Patienten stammen. Wenn solche Werkzeuge in größeren und diverseren Gruppen weiter validiert werden, könnten sie Ärztinnen und Ärzten helfen, den Tumor-Subtyp früher und weiter verbreitet abzuschätzen — besonders dort, wo genetische Tests limitiert sind. Sie ersetzen zwar nicht molekulare Tests, können aber als schnelle, kostengünstige Wegweiser dienen, die Chirurginnen, Chirurgen und Onkologinnen/Onkologen auf die wahrscheinlichste Diagnose und den geeigneten Behandlungsweg hinweisen.

Zitation: Saueressig, C., Scholz, D., Raffler, P. et al. Multimodal fusion of pathology and radiology foundation models for WHO 2021 glioma subtyping. npj Precis. Onc. 10, 118 (2026). https://doi.org/10.1038/s41698-026-01366-5

Schlüsselwörter: Gliom-Subtypisierung, multimodale Bildgebung, künstliche Intelligenz, MRT und Pathologie, Gehirntumor-Diagnose