Clear Sky Science · de

Verallgemeinerung der automatischen Tumorsegmentierung in histopathologischen Ganzglasbildern über mehrere Krebsarten hinweg

Warum das für die Krebsversorgung wichtig ist

Die Krebsdiagnose beruht weiterhin auf Expertinnen und Experten, die gefärbte Gewebeschnitte unter dem Mikroskop prüfen — eine zeitaufwändige Aufgabe, die durch steigende Fallzahlen und einen Mangel an Pathologen erschwert wird. In dieser Studie wird eine einfache, aber gewichtige Frage gestellt: Kann ein einziges künstliches Intelligenzsystem verlässlich krebsverdächtige Bereiche in digitalen Mikroskopbildern vieler verschiedener Tumortypen erkennen, anstatt für jede Krebsart ein eigenes Werkzeug zu entwickeln? Falls ja, könnte das die Arbeitsbelastung verringern, Diagnosen beschleunigen und fortgeschrittene Analysen auch für seltenere Krebsarten ermöglichen, bei denen Daten knapp sind.

Von Glasobjektträgern zu digitalen Helfern

Moderne Krankenhäuser scannen zunehmend Objektträger, um riesige, hochauflösende „Ganzglasbilder“ von Tumoren zu erzeugen. Der erste entscheidende Schritt für jede computerbasierte Analyse besteht darin, tumoriges Gewebe von allem anderen zu trennen — normalen Zellen, Fett, leerem Glas und Artefakten. Bisher wurden die meisten automatisierten Werkzeuge nur für jeweils einen Tumortyp trainiert, was ihre Einsatzmöglichkeiten einschränkt. Das Team hinter dieser Arbeit wollte ein einzelnes, universelles Modell entwickeln, das Tumorregionen über mehrere verbreitete Krebsarten hinweg auf H&E‑gefärbten Schnitten erkennt. Ihr Ziel war ein allgemeines Werkzeug, das sich in viele diagnostische Abläufe einfügen lässt, ohne jedes Mal neu entworfen werden zu müssen.

Ein Modell trainieren, das viele Krebsarten sieht

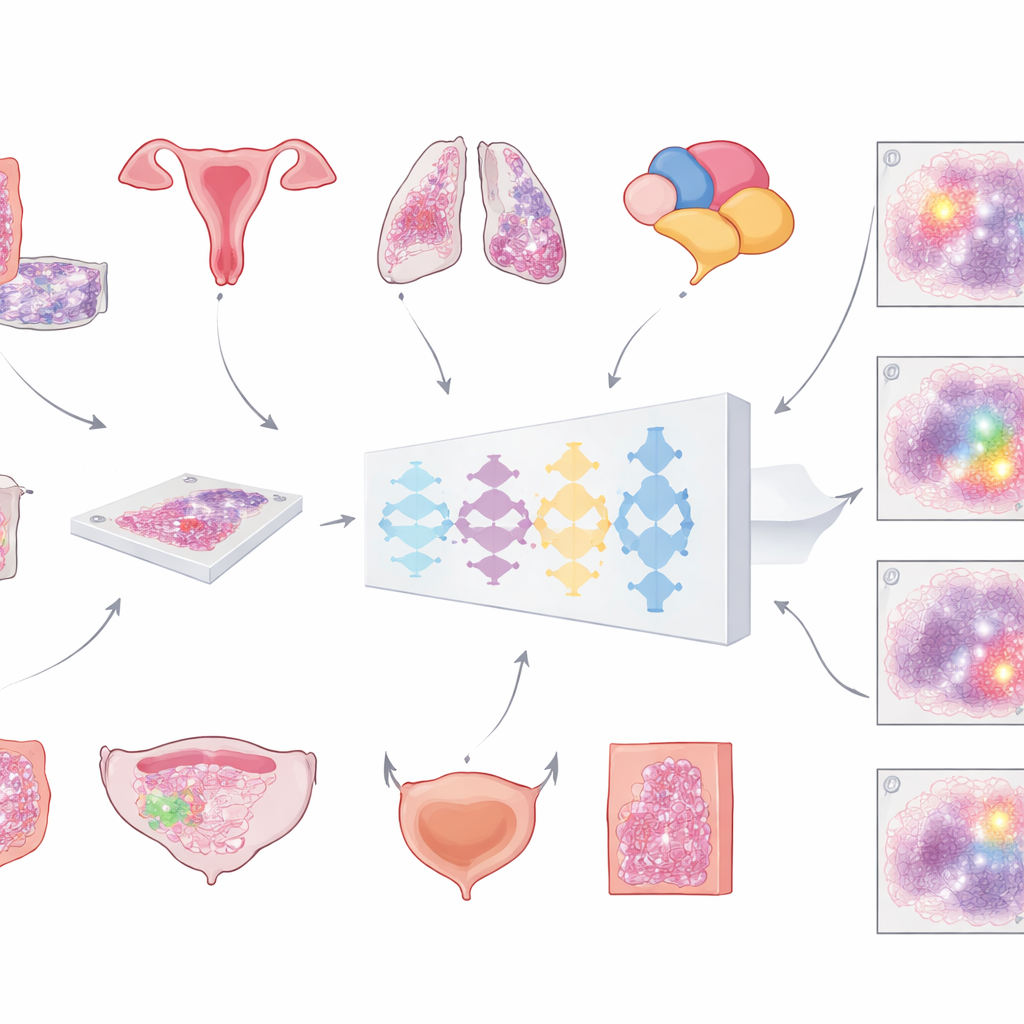

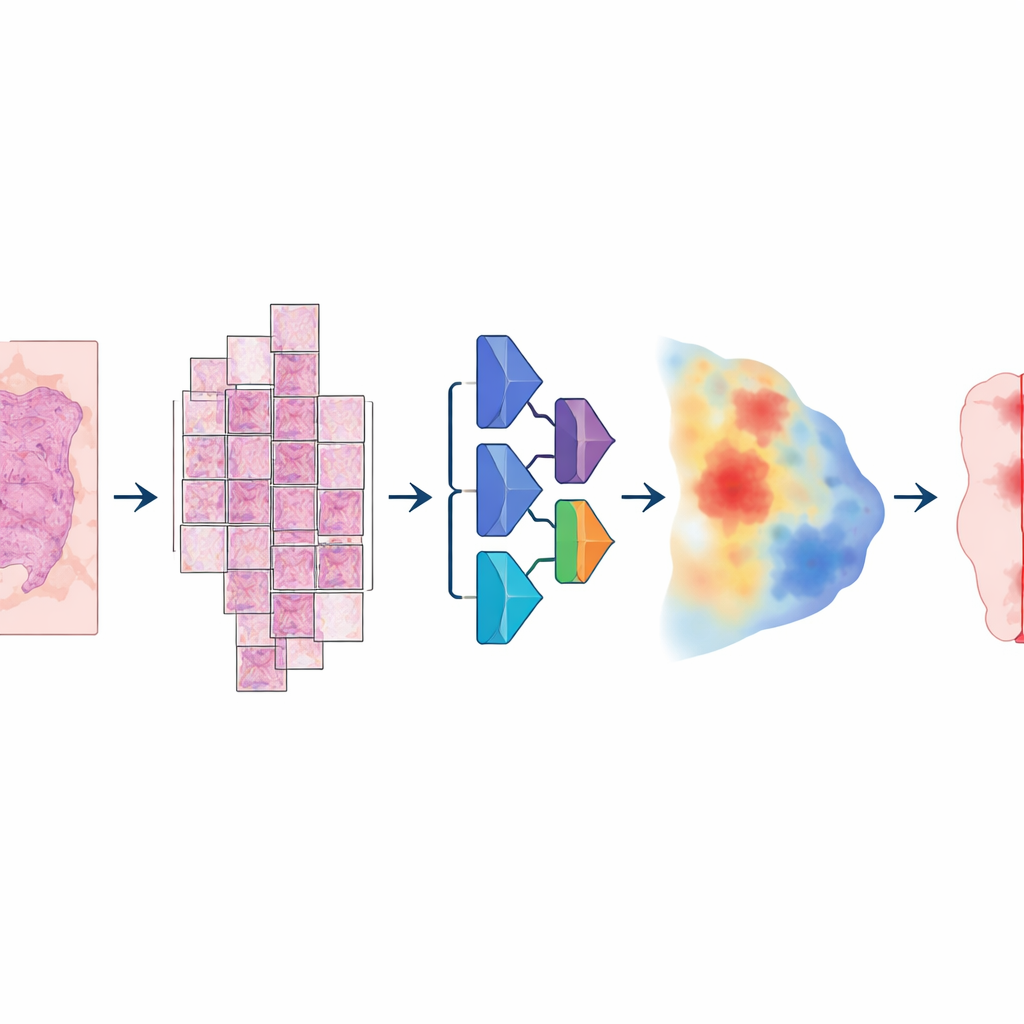

Für den Aufbau des Modells stellten die Forschenden eine ungewöhnlich große und vielfältige Sammlung digitaler Schnitte zusammen: mehr als 20.000 Ganzglasbilder von über 4.000 Patientinnen und Patienten mit kolorektalen, endometrialen, Lungen‑ und Prostatakarzinomen. Alle Proben stammten aus standardmäßig formalinfixiertem, paraffineingebettetem Gewebe und wurden mit zwei verschiedenen hochauflösenden Scannern digitalisiert. Ein Pathologe zog auf jedem Schnitt sorgfältig die Tumorareale nach und lieferte damit die „Ground Truth“, von der das System lernen konnte. Das Modell folgte einer mehrstufigen Pipeline: Jedes riesige Bild wurde in große überlappende Kacheln zerlegt, durch ein tiefes neuronales Netz geschickt, das für jeden Pixel die Tumorwahrscheinlichkeit schätzte, und anschließend zu einer glatten Karte wieder zusammengesetzt, die schließlich in eine saubere Tumor‑gegen‑Nicht‑Tumor‑Maske umgewandelt wurde.

Das System auf die Probe stellen

Entscheidend war, dass das Team nicht beim Trainingserfolg stehen blieb. Dasselbe Modell wurde an mehr als 3.000 zusätzlichen Patientinnen und Patienten aus sechs Krebsarten getestet — darunter Brust‑ und Blasenkrebs, die im Training nie verwendet worden waren — sowie an Schnitten aus mehreren Krankenhäusern und Scannern. Die Genauigkeit wurde hauptsächlich mit einem standardisierten Überlappungsmaß (dem Dice‑Koeffizienten) bewertet, das 100 % erreicht, wenn die Computer‑Tumorumrandung perfekt mit der des Pathologen übereinstimmt. Bei großen, intakten Tumorproben in kolorektalen, endometrialen, Lungen‑, Prostata‑ und Brusttumoren überstieg die mittlere Überlappung 80 % und lag häufig sogar über 90 %. In großen externen Sammlungen aus The Cancer Genome Atlas, die Proben aus vielen Laboren und Scannern weltweit enthalten, blieb die Leistung ebenfalls über 80 %, was darauf hindeutet, dass das Modell gut über seine Heimatinstitution hinaus generalisiert.

Worauf es schwächer reagiert und wie es sich einordnet

Die größte Schwäche zeigte sich bei frühen Blasenkrebsen, die mittels eines Verfahrens entnommen werden, das sehr kleine, fragmentierte Gewebestücke ergibt. In diesen Fällen verfehlte das Modell häufig die Markierung jeglichen Tumors, besonders wenn der Tumorbereich sehr klein war. Wenn es jedoch Tumor erkannte, war die Überlappung mit den Pathologenkonturen hoch, und einfache Anpassungen der finalen Schwellenwerte verbesserten die Ergebnisse — ein Hinweis darauf, dass das zugrundeliegende Netzwerk das Muster erkannte, die Nachbearbeitung aber zu strikt war. Die Forschenden entwickelten außerdem vier „Spezialisten“-Modelle, die jeweils auf einen einzelnen Tumortyp trainiert waren, und stellten fest, dass keines davon den allgemeinen Ansatz in seinem eigenen Bereich nennenswert übertraf. Im Gegensatz dazu versagten diese Spezialmodelle weitgehend, wenn sie auf andere Krebsarten angewendet wurden, während das allgemeine Modell robust blieb. Verglichen mit einem populären, allgemeineren medizinischen Segmentierungswerkzeug, das Anwenderhinweise benötigt, schnitt das neue Modell in der Regel gleich gut oder besser ab und blieb dabei vollautomatisch.

Was das für Patientinnen, Patienten und Ärztinnen und Ärzte bedeutet

Für Nicht‑Expertinnen und Nicht‑Experten lautet die wichtigste Erkenntnis: Ein gut konzipiertes KI‑System kann zuverlässig krebsverdächtiges Gewebe in digitalen Schnitten über mehrere bedeutende Tumortypen hinweg hervorheben, ohne für jede Erkrankung oder jeden Scanner maßgeschneiderte Versionen zu benötigen. Es ersetzt nicht den Pathologen, kann aber wahrscheinliche Tumorregionen vorab markieren, konsistente Messungen unterstützen und Spezialisten entlasten, sodass diese sich auf die schwierigsten Fälle konzentrieren können. Die aktuelle Version verpasst noch einige sehr kleine oder frühe Tumoren — insbesondere fragmentierte Blasenproben und vermutlich andere biopsieartige Gewebe —, weshalb sie noch nicht geeignet ist, die schwächsten Krebsnachweise zu erfassen. Dennoch zeigt die Studie, dass eine breit angelegte „Pan‑Cancer“-Tumorsegmentierung unter realen Bedingungen machbar ist und als robuster erster Schritt für künftige automatisierte Werkzeuge dienen kann, die Tumorgraduierung bewerten, Therapieansprechen vorhersagen oder gezielte Therapien steuern.

Zitation: Skrede, OJ., Pradhan, M., Isaksen, M.X. et al. Generalisation of automatic tumour segmentation in histopathological whole-slide images across multiple cancer types. npj Precis. Onc. 10, 107 (2026). https://doi.org/10.1038/s41698-026-01311-6

Schlüsselwörter: digitale Pathologie, Deep Learning, Tumorsegmentierung, Ganzglasbildgebung, Pan‑Cancer‑Modell