Clear Sky Science · de

Ein Ensemble aus Vision- und Swin-Transformern mit LLM-basierten Erklärungen zur Diagnose von Zuckerrohrblattkrankheiten

Warum das Erkennen kranker Zuckerrohrblätter wichtig ist

Zuckerrohr ist eine Schlüsselkultur für Zucker, Biokraftstoffe und viele ländliche Existenzen, doch seine Blätter sind anfällig für eine Reihe von Krankheiten, die Erträge unbemerkt schmälern. Landwirte verlassen sich meist auf Sichtprüfungen, die langsam, inkonsistent und schwer auf große Flächen übertragbar sind. Diese Arbeit untersucht, wie moderne künstliche Intelligenz Blattfotos automatisch auswerten kann, um mehrere Zuckerrohrkrankheiten mit hoher Genauigkeit zu erkennen, und anschließend ein Sprachmodell nutzt, um diese Vorhersagen in leicht verständliche Ratschläge für Landwirte zu übersetzen.

Wie Blattfotos zu Daten werden

Die Forschenden bauten ihr System auf einer offenen Zuckerrohrblatt-Bildsammlung von Kaggle auf, die nahezu zwanzigtausend Farbfotos enthält. Jedes Bild gehört zu einer von sechs Kategorien: gesund oder einer von fünf verbreiteten Krankheiten, darunter Bakterielle Blattflecken, Mosaik, Red Rot, Rost und Gelbblattkrankheit. Die Fotos wurden unter realen Feldbedingungen aufgenommen und enthalten daher wechselnde Beleuchtung, Schatten und unruhige Hintergründe. Zur Datenvorbereitung entfernte das Team Duplikate und beschädigte Bilder und teilte dann den Datensatz in Trainings-, Validierungs- und Testmengen auf, wobei die gleiche Verteilung der Krankheitsarten in jeder Menge erhalten blieb. Während des Trainings wurden nur die Trainingsbilder mit Rotation, Spiegelung und Zoom augmentiert, um verschiedene Kamerawinkel und Abstände zu simulieren — so wurde das System robuster, ohne die Testleistung künstlich aufzublähen.

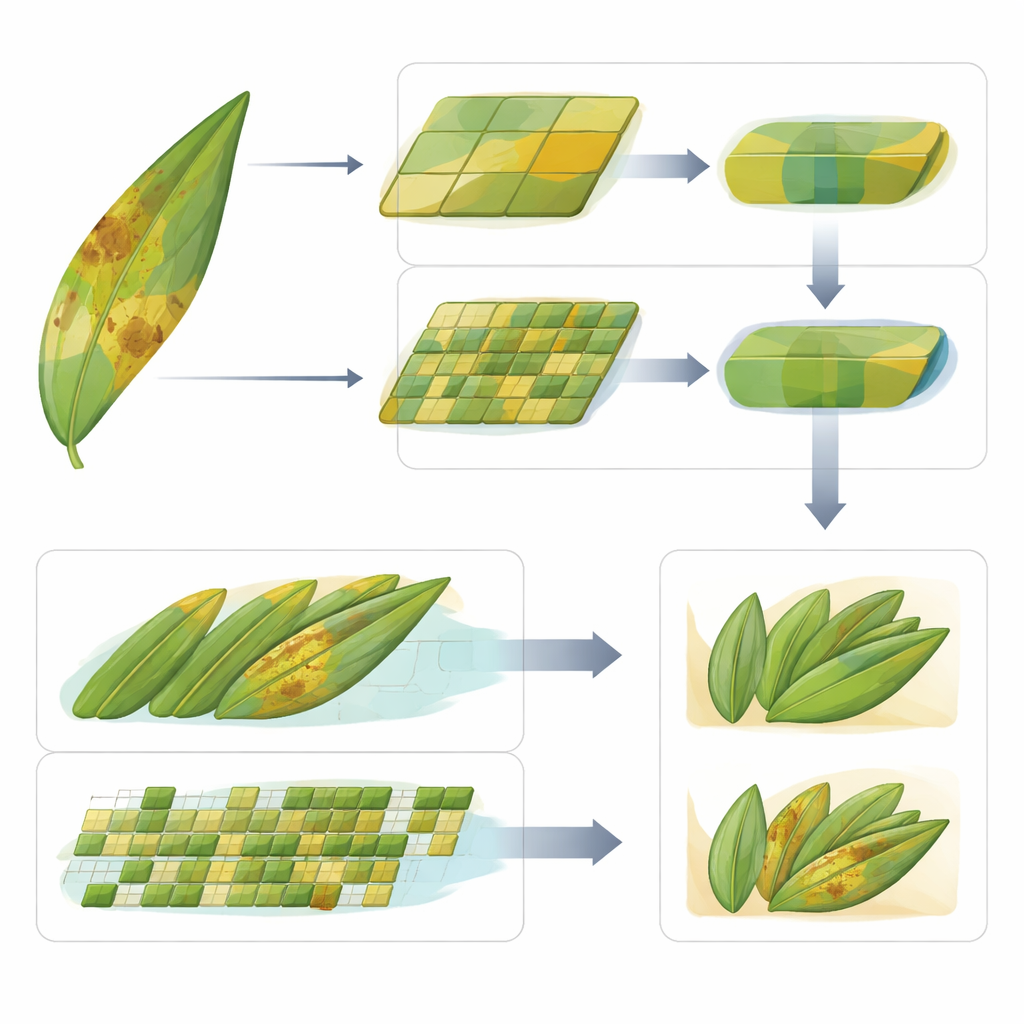

Zwei komplementäre Betrachtungsweisen eines Blattes

Kern der Studie ist ein „Ensemble“, das zwei fortgeschrittene Visionsmodelle kombiniert, die als Transformer bekannt sind. Eines, der Vision Transformer (ViT), betrachtet jedes Bild als eine Menge von Patches und lernt Muster über das gesamte Blatt hinweg. Diese globale Sicht eignet sich gut für Krankheiten, die sich als großflächige, diffuse Verfärbungen zeigen. Das andere, der Swin Transformer, arbeitet mit kleineren überlappenden Fenstern, die über das Bild wandern und ein geschichtetes Verständnis feiner Texturen und kleiner Flecken aufbauen. Dieser lokale Fokus hilft bei Krankheiten, die als winzige Läsionen, Streifen oder Sprenkel erscheinen. ViT ist per Konstruktion empfindlich gegenüber breiten Farbänderungen, während Swin auf kleine, gruppierte Details achtet — zwei Seiten davon, wie sich echte Blattkrankheiten im Feld zeigen.

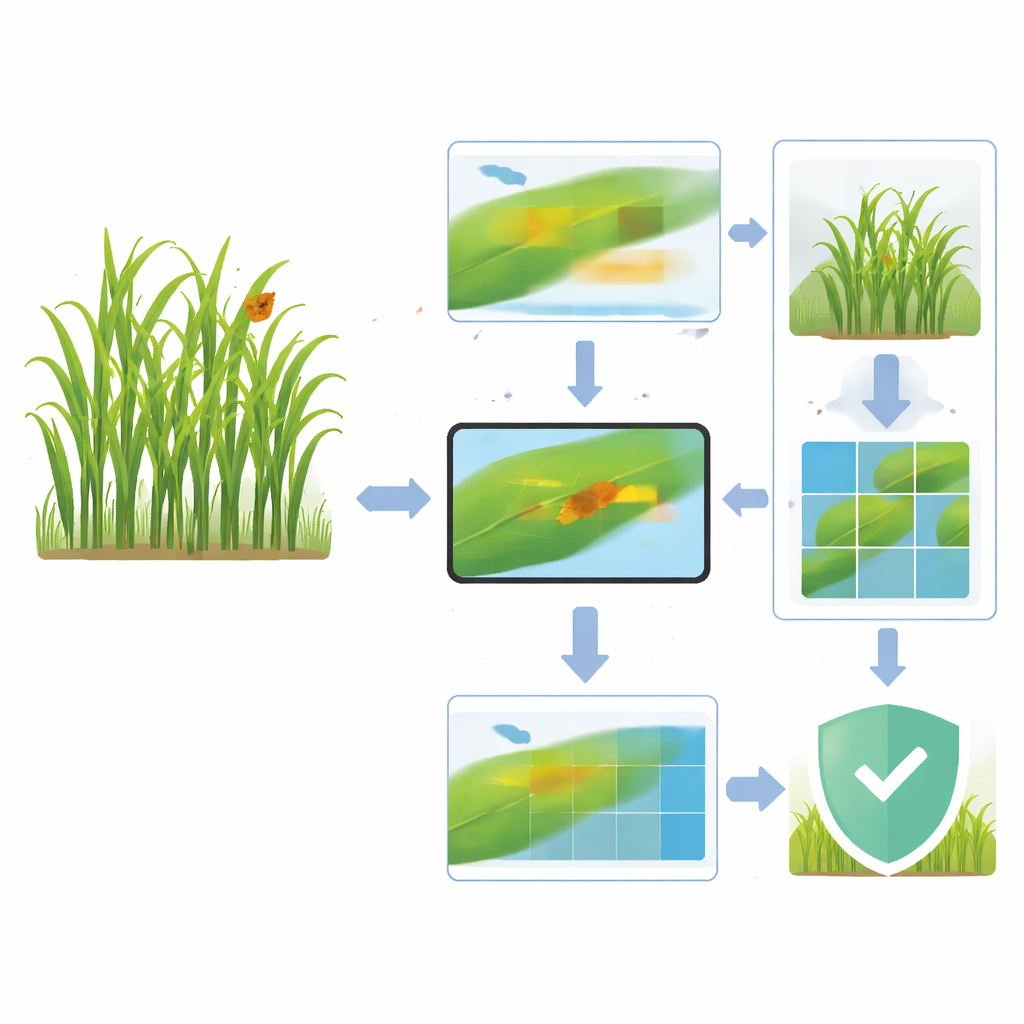

Wie die beiden Modelle zusammenwirken

Statt ein kompliziertes neues Netzwerk zu bauen, kombinieren die Autoren ViT und Swin auf eine einfache und transparente Weise. Jedes Modell analysiert zunächst dasselbe Bild und liefert eigene Wahrscheinlichkeitswerte für die sechs Klassen. Diese Werte werden dann ohne zusätzliche lernbare Gewichte gemittelt, und die höchste kombinierte Wahrscheinlichkeit bestimmt die finale Diagnose. Diese Mittelungsstrategie balanciert die Stärken der einzelnen Modelle aus und vermeidet Überanpassung an einen Datensatz, der zwar relativ groß ist, aber dennoch eine bestimmte Auswahl an Regionen und Bedingungen widerspiegelt. Experimente zeigen, dass das Ersetzen von Swin durch ein traditionelles Faltungsnetz wichtige lokale Details verliert, und dass alleiniger Einsatz von ViT subtile Hinweise übersieht — ein Beleg dafür, dass der Nutzen aus der echten Synergie von globaler und lokaler Aufmerksamkeit entsteht und nicht nur aus dem Hinzufügen weiterer Modelle.

Wie gut das System in der Praxis funktioniert

Auf der zurückgehaltenen Testmenge von fast dreitausend Bildern erreicht das Ensemble eine Genauigkeit von etwa 97 Prozent, mit ähnlich hohen Werten für Präzision, Rückruf und F1-Score über alle sechs Klassen. Es übertrifft starke Faltungs-Baselines wie ResNet, EfficientNet, MobileNet und DenseNet sowie die einzelnen ViT- und Swin-Modelle. Die Konfusionsmatrix zeigt, dass die meisten Fehler zwischen visuell ähnlichen Krankheiten auftreten, etwa Gelbblatt und Mosaik, doch die Fehlklassifikationsraten bleiben insgesamt gering. Die ROC-Kurven für jede Klasse sind nahezu perfekt, was darauf hindeutet, dass das Ensemble sehr sicher und konsistent darin ist, gesunde von kranken Blättern und die verschiedenen Krankheitsarten zu unterscheiden.

Vorhersagen in praxisgerechte Empfehlungen übersetzen

Um über rohe Labels hinauszugehen, koppeln die Autoren ihr Bildensemble an ein online gehostetes großes Sprachmodell (LLM). Sobald ein Blattfoto klassifiziert ist, wird der vorhergesagte Krankheitsname an das LLM gesendet, das eine kurze Erklärung zu typischen Symptomen und allgemeine Managementvorschläge zurückliefert, die sich an Landwirte und Agrarberater richten. Eine Weboberfläche auf der Hugging Face-Plattform ermöglicht es Nutzern, ein Blattbild hochzuladen, die vorhergesagte Krankheit zu sehen und die KI-erzeugten Hinweise innerhalb weniger Sekunden zu lesen. Die Autoren betonen, dass diese Empfehlungen beratenden Charakter haben und mit Agronomie-Expertinnen und -Experten abgeglichen werden sollten, da LLMs manchmal übermäßig selbstsichere oder unvollständige Ratschläge erzeugen können. Dennoch macht diese Sprachschicht das System für Nicht-Fachleute zugänglicher.

Was das für künftige Smart-Farming-Werkzeuge bedeutet

Kurz gesagt zeigt die Studie, dass die Kombination zweier „Sehweisen“ desselben Blattes — eine, die den Wald sieht, und eine, die die Bäume sieht — einen sehr verlässlichen digitalen Kundschafter für Zuckerrohrkrankheiten ergeben kann. Das Ensemble aus ViT- und Swin-Transformern erfasst sowohl breite als auch feinkörnige Symptome, während das angekoppelte Sprachmodell technische Vorhersagen in nutzerfreundliche Hinweise übersetzt. Obwohl die Modelle noch in weiteren Regionen, bei unterschiedlichen Lichtverhältnissen und auf verschiedenen Geräten getestet werden müssen und die Spracheausgaben fachlicher Prüfung bedürfen, deutet diese Arbeit auf praktikable Telefon- oder Tablet-Werkzeuge hin, die Landwirten helfen könnten, Probleme früh zu erkennen, Unsicherheiten zu reduzieren und den gezielteren Einsatz von Behandlungen im Zuckerrohranbau und schließlich auch bei vielen anderen Kulturen zu unterstützen.

Zitation: Saritha, M., Rasane, K. An ensemble of vision and swin transformers with LLM-based explanations for sugarcane leaf disease diagnosis. Sci Rep 16, 10707 (2026). https://doi.org/10.1038/s41598-026-45453-w

Schlüsselwörter: Erkennung von Zuckerrohrkrankheiten, Transformer-Visionsmodelle, präzise Landwirtschaft, Pflanzenblattbildgebung, KI-Entscheidungsunterstützung