Clear Sky Science · de

Domänenunabhängige, schwach überwachte Segmentierung chirurgischer Instrumente

Warum klügere Ansichten chirurgischer Werkzeuge wichtig sind

Moderne Chirurgen arbeiten zunehmend mit Kameras, Mikroskopen und fortschrittlichen Scannern. Um Roboter zu steuern, 3D-Ansichten zu registrieren oder Werkzeuge in bestimmten Bildern auszublenden, müssen Computer in jedem Bild zuverlässig jedes chirurgische Instrument finden — eine Aufgabe, die als Segmentierung bezeichnet wird. Heute erfordert das meist Tausende mühsamer, pixelgenauer Annotationen von medizinischen Expertinnen und Experten — und selbst dann versagen Systeme oft, wenn sich das Aufnahme-Setup oder der Eingriff ändert. Diese Studie stellt eine Methode vor, mit der leistungsfähige Vision-Modelle Instrumente über sehr verschiedene Arten medizinischer Bilder hinweg entdecken können, ohne dass zuvor detaillierte Umrisse jedes Werkzeugs gezeichnet werden müssen.

Die Herausforderung, Werkzeuge in vielen Bildtypen zu finden

Chirurginnen und Chirurgen nutzen eine große Bandbreite an Bildgebungssystemen: Farbvideos von laparoskopischen Kameras im Bauchraum, Mikroskopansichten des Auges bei der Katarakt-Operation und querschnittliche Aufnahmen wie optische Kohärenztomographie (OCT) oder Ultraschall. In jedem dieser Fälle sehen chirurgische Instrumente sehr unterschiedlich aus — glänzende Metallstäbe in Farbaufnahmen, dünne helle Linien oder Mondsicheln in OCT oder körnige Flecken im Ultraschall. Bestehende Deep-Learning-Methoden können sehr gut funktionieren, aber nur nach Training an großen, sorgfältig beschrifteten Datensätzen aus einem spezifischen Setting. Wenn sich das Aufnahmegerät, die Anatomie oder der Instrumententyp ändert, sinkt die Leistung oft stark, und neue Annotationen zu sammeln ist langsam, teuer und durch Datenschutz- sowie Expertenressourcen begrenzt.

Eine neue Idee: Instrumente als fehlplatzierte Objekte behandeln

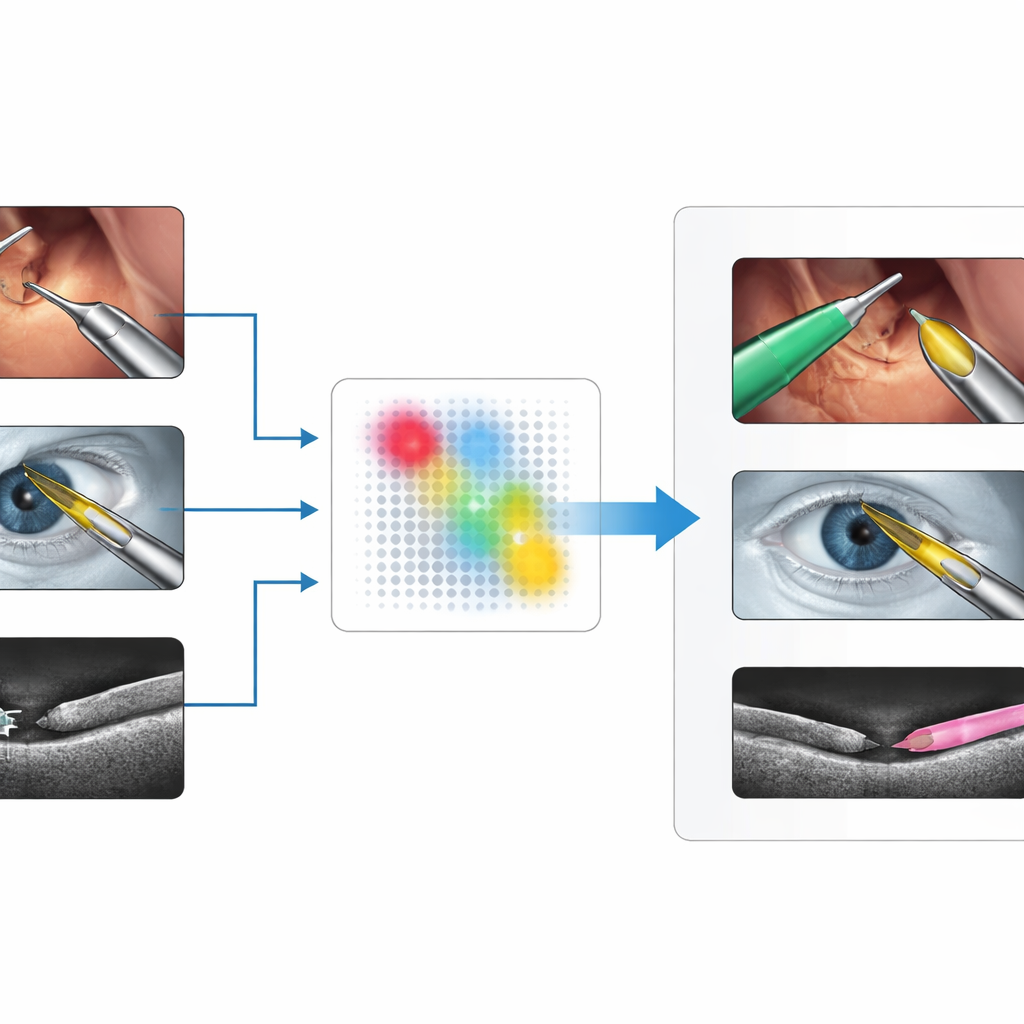

Die Autoren schlagen eine Methode vor, die sie SAM4SIS nennen und die das Problem umdreht. Statt dem System genau beizubringen, wie jedes Instrument aussieht, zeigen sie ihm zunächst Bilder ohne Werkzeuge, sodass es lernt, wie „normales“ Gewebe aussieht. Sie nutzen einen Anomalie-Detektor namens PatchCore, um ein Gedächtnis dieser normalen Muster aufzubauen. Kommt ein neues Bild, hebt PatchCore jene Regionen hervor, deren Erscheinungsbild nicht in dieses Gedächtnis passt — Bereiche, die wahrscheinlich chirurgische Instrumente enthalten. Dieser Schritt benötigt nur einfache Bild- oder Szeneninformationen darüber, ob ein Werkzeug vorhanden ist, nicht aber pixelgenaue Konturen, wodurch die Einrichtung deutlich einfacher wird.

Von groben Hinweisen zu präzisen Umrissen

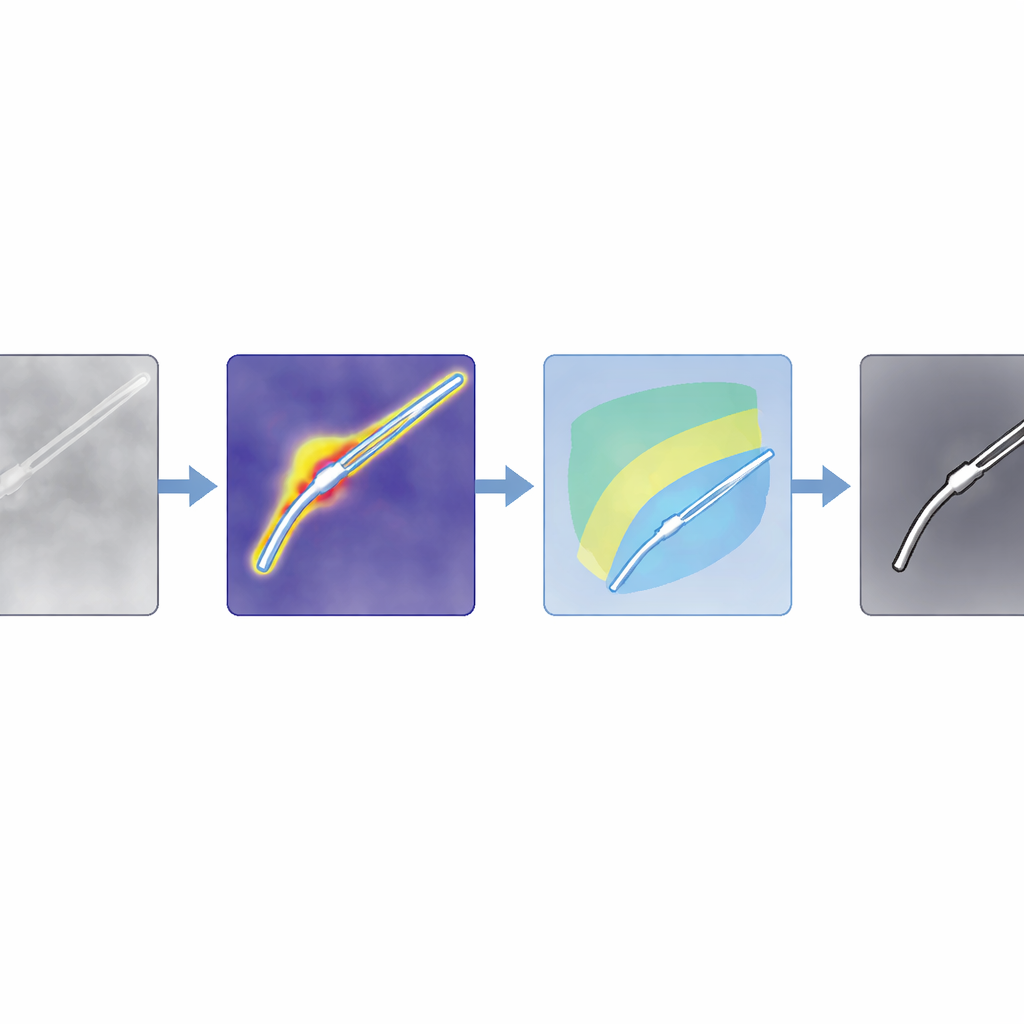

Anomaliemappen sind grob, daher kombiniert das Team sie mit einem leistungsfähigen Foundation-Modell, dem Segment Anything Model 2 (SAM2), das scharfe Umrisse zeichnen kann, wenn man ihm einen Punkt innerhalb des interessierenden Objekts vorgibt. Der entscheidende Kniff ist es, diese Punkte automatisch aus der Anomaliekarte auszuwählen, anstatt einen Menschen klicken zu lassen. Die Autoren entwerfen Filter, die für gewöhnliche Farbaufnahmen und für intensitätsbasierte Scans wie OCT zugeschnitten sind; sie verstärken Regionen, die wahrscheinlich Instrumente enthalten, und unterdrücken Schatten sowie helle Artefakte. Anschließend bewerten sie potenzielle Werkzeugregionen und wählen die stärksten Punkte als Prompts für SAM2. Da SAM2 mehrere Kandidatenmasken zurückgibt, führen die Autoren eine neue Bewertungsregel ein, SAM4SIS, die misst, wie gut jeder Kandidat zur anomaliebasierten Karte passt, und die am besten passende Maske auswählt.

Funktioniert über viele Operationen und Scanner hinweg

Die Forschenden testen ihren Ansatz auf drei anspruchsvollen Datensätzen: abdominale Robotik-Operationsvideos (EndoVis2017), Mikroskopbilder von Katarakt-Operationen (CaDIS) und querschnittliche OCT-Aufnahmen von Schweineaugen mit winzigen Instrumenten (PASO-SIS). Diese decken sehr unterschiedliche Perspektiven, Farben und Rauschmuster ab. Ohne das große Segmentierungsmodell jemals neu zu trainieren oder neue Masken zu zeichnen, erreicht SAM4SIS Randgenauigkeiten zwischen etwa 53 % und 73 %, was mit textbasierten Prompting-Methoden konkurriert oder sie übertrifft und an einige überwachte Systeme heranreicht. Es schlägt sich besonders gut dort, wo traditionelle Methoden schwächeln, etwa bei OCT- und Ultraschalldaten, und benötigt weniger als eine Minute Einrichtungszeit. Das Team zeigt zudem, dass dieselbe Idee andere Fremdkörper hervorheben kann, etwa Wattebäusche in Hirn-Ultraschallaufnahmen, was nahelegt, dass das Konzept nicht auf Instrumente beschränkt ist.

Was das für die zukünftige smarte Chirurgie bedeutet

Die Kernbotschaft für Leserinnen und Leser ist, dass Computer nun lernen können, „alles Neue zu segmentieren“ in chirurgischen Szenen, indem sie zuerst verstehen, wie normales Gewebe aussieht, und dann ungewohnte Formen als mögliche Instrumente markieren, die anschließend durch ein universelles Vision-Modell verfeinert werden. Dieser Ansatz erspart aufwändige Annotationen, passt sich verschiedenen Bildgebungstechnologien an und lässt sich mit minimaler Vorbereitung in chirurgische Workflows integrieren. Während sorgfältig trainierte, spezialisierte Modelle bei reichlich gelabelten Daten weiterhin überlegen sind, bietet SAM4SIS eine praktikable Alternative für neue Eingriffe, seltene Bildgebungsszenarien oder Frühphasenforschung und bringt robuste, automatisierte Instrumentenerkennung näher an die klinische Praxis.

Zitation: Peter, R., Pham, D.X.V., Matten, P. et al. Domain-agnostic weakly supervised surgical instrument segmentation. Sci Rep 16, 9337 (2026). https://doi.org/10.1038/s41598-026-43054-1

Schlüsselwörter: Segmentierung chirurgischer Instrumente, KI für medizinische Bildgebung, Anomalieerkennung, Foundation-Vision-Modelle, robotische Chirurgie