Clear Sky Science · de

Entwicklung und Bewertung eines mehrstufigen Transfer-Learning-Rahmens für robuste medizinische Bildanalyse

Warum intelligenteres Bildlesen wichtig ist

Die moderne Medizin stützt sich stark auf Bilder – von Mammographien bis zu Brustkorb-Röntgenaufnahmen – um Krankheiten früh zu erkennen und Behandlungen zu steuern. Computern das Lesen dieser Bilder so genau wie menschlichen Expertinnen und Experten beizubringen, erfordert jedoch meist riesige, sorgfältig annotierte Datensätze, die viele Krankenhäuser einfach nicht haben. Diese Studie stellt eine neue Methode zur Ausbildung von KI-Systemen vor, die vorhandene Bilder besser nutzt, darunter kostengünstige Laboraufnahmen von Krebszellen, um die Leistung bei klinischen Scans zu verbessern und gleichzeitig Datenschutz- und Datenanforderungen zu reduzieren.

Von Alltagsfotos zu Krankenhausaufnahmen

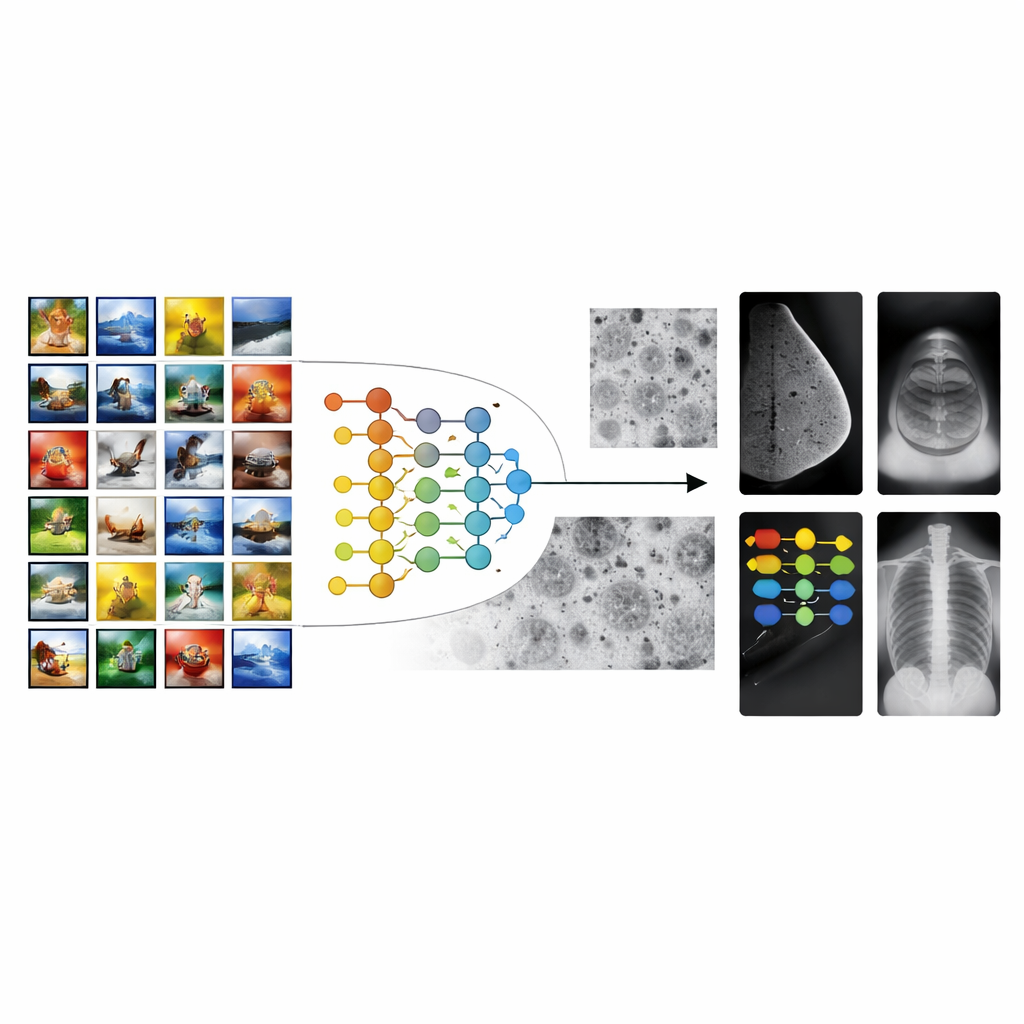

Die meisten medizinischen Bild-KI-Systeme beginnen mit Modellen, die auf Millionen von Alltagsfotos trainiert wurden, etwa von Tieren, Gegenständen und Landschaften. Diese Strategie, bekannt als Transfer-Learning, verschafft Algorithmen einen „Vorsprung“ beim Erkennen von Formen und Texturen. Zwischen Urlaubsfotos und medizinischen Aufnahmen besteht jedoch eine große Kluft. Die in einer Mammographie oder einem Röntgenbild relevanten Muster – winzige Punkte, schwache Schatten oder subtile Gewebetexturen – ähneln nichts den Objekten in gewöhnlichen Bildern. Daher kann konventionelles Transfer-Learning ins Stocken geraten, sodass Werkzeuge im Labor gut abschneiden, aber Schwierigkeiten haben, über verschiedene Krankenhäuser, Geräte oder Patientengruppen hinweg zuverlässig zu funktionieren.

Eine Brücke bauen mit Zellbildern

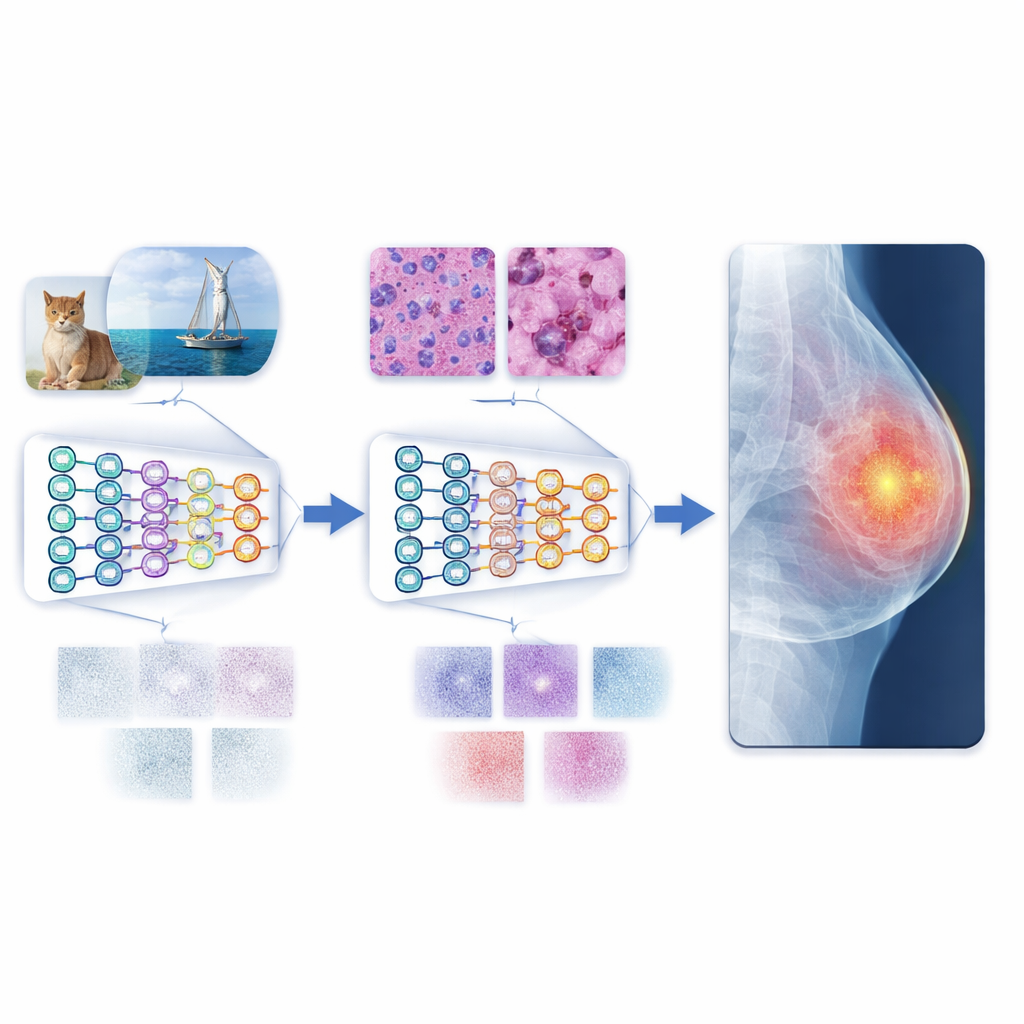

Die Autorinnen und Autoren schlagen einen mehrstufigen Transfer-Learning-Rahmen (MSTL) vor, der einen wichtigen Zwischenschritt zwischen allgemeinen Bildern und klinischen Scans hinzufügt. Nach dem ersten Training an einer großen Sammlung natürlicher Bilder wird das Modell auf mikroskopischen Aufnahmen von im Labor kultivierten Krebszelllinien feinabgestimmt. Diese Zellbilder teilen viele visuelle Merkmale mit medizinischen Scans: dichte, überlagerte Strukturen; feinkörnige Texturen; und subtile Helligkeitsunterschiede. Sie sind außerdem relativ günstig herzustellen, lassen sich in großer Zahl erzeugen und umgehen die Datenschutzprobleme, die mit Patientendaten verbunden sind. Indem sich das Modell zuerst an diese Welt der Zellbilder anpasst, lernt es Merkmale, die für Krankheitssignale relevanter sind, bevor es jemals eine Mammographie, Ultraschallaufnahme oder ein Röntgenbild sieht.

Testen über verschiedene Scan-Typen hinweg

Um diese Strategie zu bewerten, trainierten die Forschenden sowohl traditionelle konvolutionale neuronale Netze als auch neuere Vision Transformers für drei gängige Bildgebungsaufgaben: Brustkrebs-Erkennung in Mammographien, Analyse von Brustläsionen im Ultraschall und Pneumonie-Erkennung in Brust-Röntgenaufnahmen. Sie verglichen drei Trainingsmodi: Training von Grund auf, konventionelles Transfer-Learning aus natürlichen Bildern und die neue mehrstufige Methode mit Krebszellbildern als Brücke. Der mehrstufige Ansatz erzielte durchweg die besten Ergebnisse und brachte die Genauigkeit bei den getesteten Datensätzen oft nahe an Perfektion. Vision Transformers, die langreichweitige Muster über das gesamte Bild erfassen können, übertrafen in nahezu allen Szenarien die standardmäßigen konvolutionalen Netze, besonders in Kombination mit dem mehrstufigen Training.

Messung, wie gut Wissen übertragbar ist

Über einfache Genauigkeitswerte hinaus untersuchte das Team, wie leicht die in einer Phase gelernten Merkmale in die nächste übertragbar sind. Sie verwendeten drei Transferierbarkeitsmaße, die widerspiegeln, wie kompatibel die gelernten Bildmuster mit neuen Aufgaben sind. Besonders bei Mammographien und Brustkorb-Röntgenaufnahmen korrelierten diese Maße eng mit der tatsächlichen Leistung, insbesondere für das stärkste Modell, einen Basis-Vision-Transformer (ViTB-16). Diese enge Beziehung legt nahe, dass die zwischenliegende Zellbild-Phase mehr leistet als nur bessere Kennzahlen; sie erzeugt Repräsentationen, die medizinischen Bildern wirklich besser „entsprechen“. Zusätzliche Experimente zeigten, dass eine Halbierung der Zellbildmenge die Leistung verschlechterte und dass der Ersatz durch andere medizinische Modalitäten (wie Endoskopie- oder Augenbilder) weniger effektiv war, was den besonderen Wert von Krebszelllinien als Brücke unterstreicht.

Auf dem Weg zu verlässlicheren automatisierten Diagnosen

Anschaulich zeigt die Studie, dass das Anlernen eines KI-Systems mit im Labor gezüchteten Zellbildern vor klinischen Scans es zu einem geschickteren und verlässlicheren „Leser“ medizinischer Bilder macht. Dieser mehrstufige Weg verringert die Diskrepanz zwischen bunten Alltagsfotos und den gedämpften, komplexen Mustern klinischer Bilder und ermöglicht dem Modell, besser zu generalisieren, selbst wenn nur begrenzte Mengen annotierter medizinischer Daten verfügbar sind. In Kombination mit modernen Vision Transformers liefert der Ansatz Spitzenleistungen auf mehreren Benchmark-Datensätzen. Zwar sind vielfältigere Daten und umfassendere Tests weiterhin nötig, doch weist der Rahmen auf skalierbare, datenschutzfreundliche Werkzeuge hin, die Ärztinnen und Ärzte weltweit bei der genaueren und konsistenteren Diagnosestellung unterstützen könnten.

Zitation: Ayana, G., Park, Sy., Jeong, K.C. et al. Development and evaluation of a multistage transfer learning framework for robust medical image analysis. Sci Rep 16, 8873 (2026). https://doi.org/10.1038/s41598-026-42157-z

Schlüsselwörter: medizinische Bildanalyse, Transfer-Learning, Deep Learning, Vision Transformers, Krebszellbildgebung