Clear Sky Science · de

Entwurf und Implementierung eines Deep-Learning-Frameworks zur automatisierten Kulturklassifikation und Gesundheitsdiagnose in der Präzisionslandwirtschaft

Klügere Felder für eine hungrige Welt

Um eine wachsende Weltbevölkerung zu ernähren, muss von jedem Feld mehr Nahrung gewonnen werden, während weniger Wasser, Dünger und Arbeitskraft verschwendet werden. Trotzdem verbringen Landwirtinnen und Landwirte noch immer unzählige Stunden damit, ihre Flächen abzugehen und Blätter sowie Boden mit dem bloßen Auge zu prüfen. Dieses Papier stellt eine automatisierte Methode vor, um Feldbestände mit fliegenden Drohnen, umkreisenden Satelliten und eingebetteten Sensoren zu überwachen – alle verbunden mit einem Deep-Learning-System, das Probleme früh erkennt und schnelle Gegenmaßnahmen vorschlägt.

Den Himmel und den Boden zusammenbringen

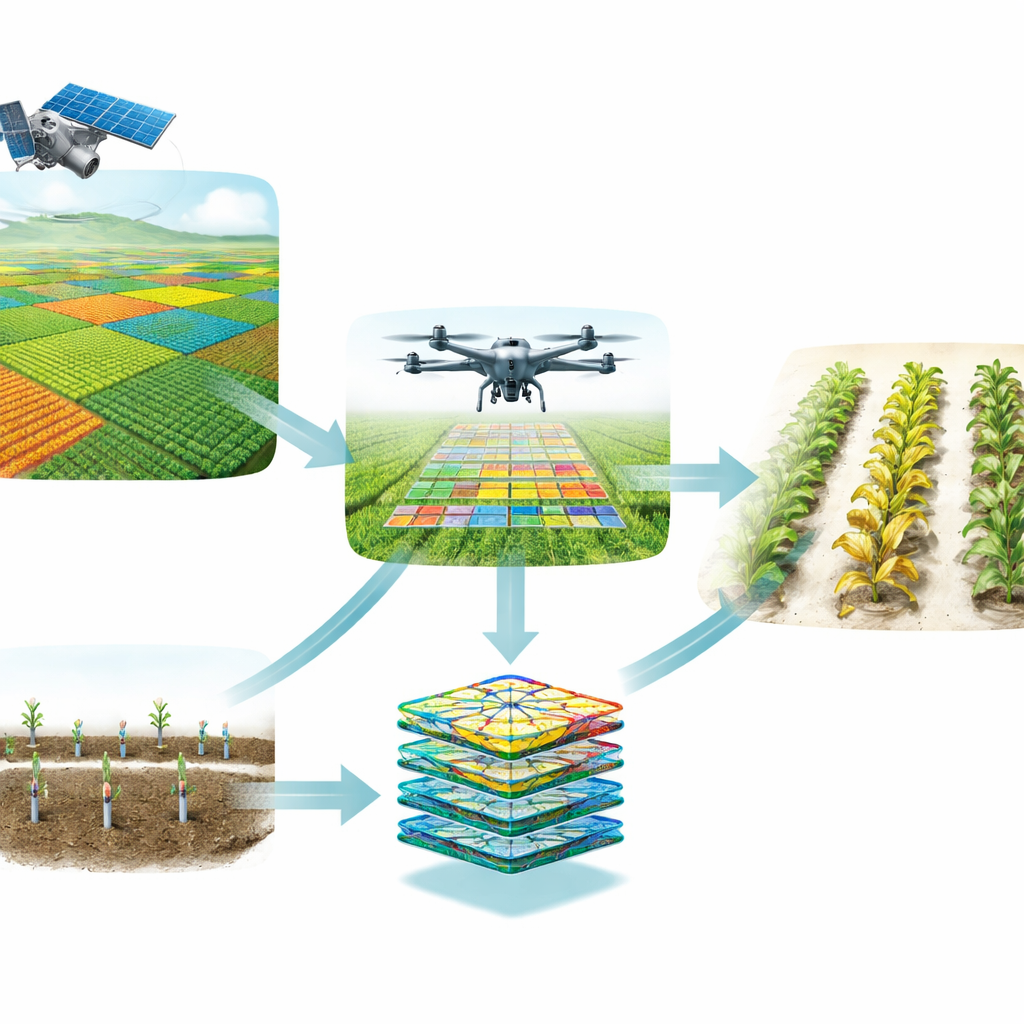

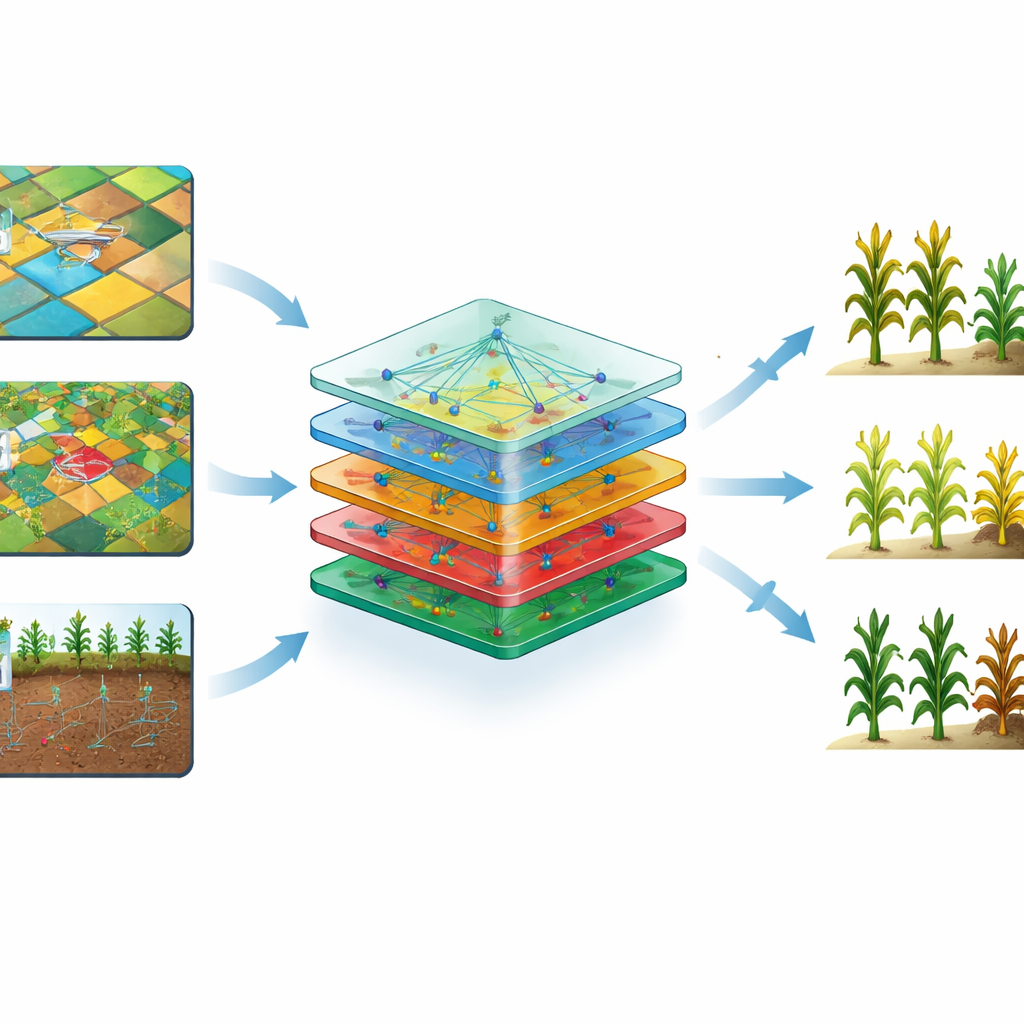

Die meisten Hightech-Werkzeuge für die Landwirtschaft betrachten nur ein Puzzleteil: Nahaufnahmen von Blättern oder rohe Messwerte von Bodensonden. Die Autoren argumentieren, dass diese „in Silos“ arbeitende Sichtweise wichtige Hinweise übersieht. Ihr Framework vereint stattdessen drei Blickwinkel. Aus dem All zeigen Satellitenbilder großräumige Muster, etwa welche Feldbereiche Stress aufweisen. Aus der Luft erfassen Drohnen detaillierte Farb- und nahinfrarote Ansichten einzelner Pflanzen. Im Boden messen internetverbundene Sensoren Feuchte, Nährstoffe, Temperatur und andere Bedingungen. Durch die zeitliche und räumliche Angleichung dieser Datenquellen kann das System verbinden, was an den Blättern sichtbar ist, mit dem, was im Boden und in der Umgebung vor sich geht.

Wie der digitale Pflanzenarzt lernt

Im Kern des Frameworks steht ein Deep-Learning-Modell, das darauf trainiert ist, Kulturarten und Gesundheitszustände zu erkennen. Zunächst werden alle eingehenden Daten bereinigt und standardisiert: bewölkte Satellitenaufnahmen werden normalisiert, Drohnenbilder in Größe und Beleuchtung angepasst, und Lücken in Wetteraufzeichnungen werden ergänzt. Das System erhöht außerdem die Bilddaten durch Rotationen und Spiegelungen, damit das Modell Kamerawinkel ignoriert und sich auf echte Pflanzenmerkmale konzentriert. Anschließend extrahiert ein spezialisiertes Bildanalyse-Netzwerk, bekannt als Faltungsneuronales Netzwerk, Muster wie Blattstruktur, Farbveränderungen und Befallformen, während zusätzliche Schichten die numerischen Sensormesswerte verarbeiten. Ein „Attention“-Mechanismus hilft dem Modell, sich auf die informativsten Regionen zu konzentrieren – etwa einen Fleck mit gesprenkelten Blättern – und dabei Boden oder Himmel als Hintergrund auszublenden.

Von Rohdaten zu Echtzeitentscheidungen

Ist das Modell einmal trainiert, funktioniert es wie ein ständig verfügbarer Pflanzenarzt. Mehrere Datenquellen werden in das System gestreamt und zu einer einzigen internen Repräsentation verschmolzen. Die attention-gesteuerten Schichten vergleichen das Gesehene mit Tausenden früherer Beispiele, dann entscheidet der abschließende Klassifikationsblock, ob eine Pflanze gesund ist oder Anzeichen von Krankheit, Schädlingsbefall oder Stress zeigt. Anstatt ein Feld nur als gut oder schlecht zu kennzeichnen, verknüpft das Framework seine visuelle Diagnose mit aktuellen Bodenfeuchte- und Nährstoffwerten. Diese Kombination ermöglicht priorisierte Warnungen: Ein Krankheitsmuster in Verbindung mit hoher Luftfeuchte könnte beispielsweise eine dringende Warnung auslösen und zu sofortiger, zielgerichteter Behandlung führen, statt zu flächendeckendem Einsatz über den gesamten Betrieb.

Das System auf die Probe stellen

Um zu prüfen, ob dieser Ansatz über die Theorie hinaus funktioniert, trainierten und evaluierten die Autoren ihr Framework an einem öffentlichen Präzisionslandwirtschafts-Datensatz, der Satellitenbilder, Drohnenfotos und Bodensensormessungen für wichtige Nutzpflanzen enthält: Mais, Kartoffel und Weizen. Sie teilten die Daten in Trainings-, Validierungs- und Testmengen, um Overfitting zu vermeiden, und verglichen ihr Modell mit standardmäßigen Deep-Learning- und traditionellen maschinellen Lernverfahren. Ihr multimodales System erreichte durchweg über 90 Prozent Genauigkeit bei der Identifikation von Kulturtyp und Gesundheitszustand und lieferte zudem schnellere Vorhersagen als die Basismodelle. Wichtig ist, dass das System auch dann hohe Genauigkeit bewahren konnte, wenn eine Datenquelle gestört war – etwa Drohnenbilder durch Schatten beeinträchtigt – indem es stärker auf Boden- und Satelliteninformationen zugriff.

Was das für Landwirtinnen und Landwirte bedeutet

Das Fazit der Studie lautet: Die Kombination von Himmels- bis Bodensichten ermöglicht es Rechnern, den Pflanzenzustand zuverlässiger zu beurteilen als menschliche Aufseher oder Einzel-Sensoren allein. Für Landwirtinnen und Landwirte kann das frühere Warnungen vor Krankheitsausbrüchen, präzisere Nutzung von Wasser und Pflanzenschutzmitteln, niedrigere Arbeitskosten und letztlich höhere Erträge bei geringerem Umweltfußabdruck bedeuten. Während das derzeitige System noch auf gute Konnektivität angewiesen ist, um Daten in die Cloud zu senden, könnten künftige Versionen direkt auf Drohnen oder Edge-Geräten im Feld laufen. Auf großer Skala umgesetzt könnten solche smarten, vieläugigen Wächter des Ackerlands zu einem Grundpfeiler wirklich nachhaltiger, datengetriebener Landwirtschaft werden.

Zitation: Pal, A.K., Patro, B.D.K. & Chaube, S. Design and implementation of a deep learning framework for automated crop classification and health diagnosis in precision agriculture. Sci Rep 16, 11436 (2026). https://doi.org/10.1038/s41598-026-42151-5

Schlüsselwörter: präzisionslandwirtschaft, Erkennung von Pflanzenkrankheiten, Deep Learning, Drohnen- und Satellitenbildgebung, intensive Landwirtschaft