Clear Sky Science · de

GWKNN: ein verbessertes k-nearest-neighbor-Algorithmus mit G-Metrik-Rekonstruktion und Grey Wolf Optimizer

Intelligentere Mustererkennung für die heutige Datenflut

Von medizinischen Scans bis hin zu Banktransaktionen erzeugt das moderne Leben Ozeane von Daten. Ein großer Teil dieser Informationen muss automatisch in Kategorien eingeteilt werden: gesund oder krank, betrügerisch oder normal, Spam oder echt. Ein klassisches Arbeitspferd für solche Aufgaben ist der k-nearest-neighbors-(KNN-)Algorithmus, der einen neuen Fall anhand der ähnlichsten bisherigen Beispiele kennzeichnet. Wenn Datensätze jedoch größer, komplexer und unausgewogener werden, gerät diese einfache Idee an ihre Grenzen. Die Arbeit stellt GWKNN vor, eine überarbeitete Version von KNN, die Entfernungen zwischen Punkten intelligenter nutzt und seltene, aber wichtige Fälle fairer behandelt.

Warum einfache Ähnlichkeit nicht ausreicht

Konventionelles KNN geht davon aus, dass alle Merkmale eines Datenpunkts gleichermaßen beitragen, und misst Ähnlichkeit mit einer standardmäßigen euklidischen Distanz. Das kann gut funktionieren, wenn Daten niedrigdimensional und klar getrennt sind, doch reale Daten sind oft hochdimensional, verrauscht und eine Mischung unterschiedlicher Informationsarten. In solchen Fällen kann die übliche Distanz irreführend sein und dazu führen, dass der Algorithmus ungeeignete Nachbarn auswählt. Gleichzeitig sind viele Datensätze unausgewogen: Häufige Kategorien dominieren, während seltene, aber entscheidende Kategorien, wie frühe Krankheitsstadien, unterrepräsentiert sind. Wenn KNN unter nahegelegenen Beispielen abstimmt, neigt die Mehrheitsklasse dazu, diese Minderheitsfälle zu überdecken, was zu verzerrten und manchmal gefährlichen Entscheidungen führt.

Dem Algorithmus ein besseres Distanzverständnis beibringen

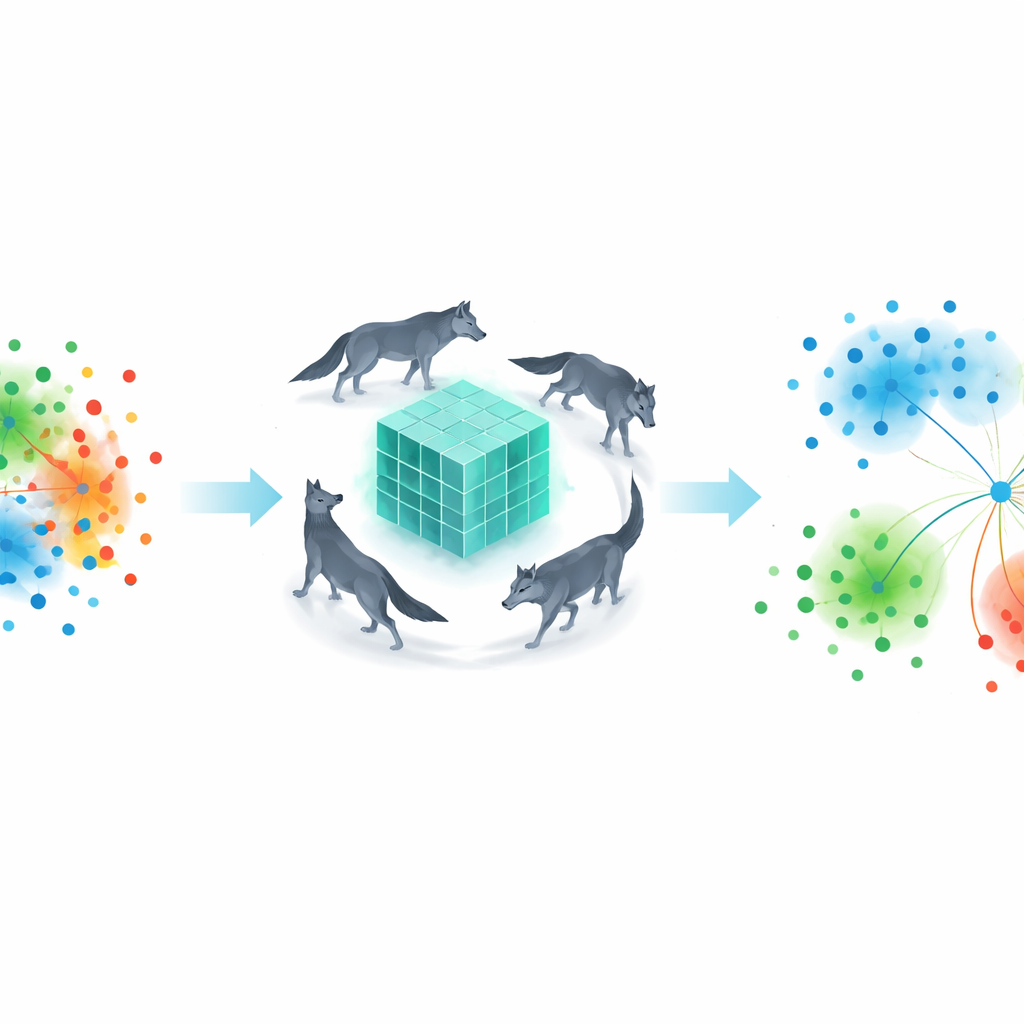

Die erste wesentliche Neuerung in GWKNN ist eine gelernte Distanzmessung. Anstatt an der üblichen euklidischen Regel festzuhalten, lässt das Verfahren den Algorithmus entdecken, wie weit Datenpunkte in einer Weise voneinander entfernt sein sollten, die die Kategorien am besten trennt. Sie kodieren dies als flexible „G-Metrik“, die den Raum so umgestaltet, dass informative Merkmale stärker und redundante Merkmale weniger Gewicht erhalten. Zur Abstimmung dieser Metrik orientiert sich die Methode an der Jagdverhaltens der Grauwölfe. Ein Schwarmintelligenz-Verfahren, der Grey Wolf Optimizer, erkundet viele mögliche Arten, den Datenraum zu dehnen und zu stauchen, und behält jene Varianten bei, die die Klassifikationsfehler reduzieren und gleichzeitig mathematische Stabilität gewährleisten. Über viele Iterationen konvergieren die virtuellen „Wölfe“ auf eine Distanzregel, die ähnliche Punkte zuverlässiger zusammenklumpen lässt, selbst in hochdimensionalen, verwickelten Datensätzen.

Seltenen Fällen eine lautere Stimme geben

Die zweite Verbesserung zielt auf Abstimmungs-Bias ab. Standard-KNN zählt einfach, wie viele der k Nachbarn zu jeder Klasse gehören, und wählt die Mehrheit. GWKNN gewichtet stattdessen jede Stimme nach der Häufigkeit dieser Klasse in den Trainingsdaten insgesamt. Klassen, die seltener auftreten, erhalten stärkere Gewichte; sehr häufige Klassen bekommen schwächere. Ein kleiner Glättungsterm verhindert, dass extrem seltene Kategorien die Entscheidung überwältigen. Auf diese Weise werden Minderheitssignale nicht automatisch übertönt, wenn ein neuer Datenpunkt sich in der Nähe einiger weniger Beispiele der Minderheitsklasse und vieler Beispiele der Mehrheitsklasse befindet. Das Schema ist einfach zu berechnen, hat aber eine starke Wirkung: Es führt dazu, dass der Klassifikator mehr Aufmerksamkeit auf seltene, aber bedeutende Muster richtet und so Fairness und Recall für Minderheitsklassen verbessert.

Das neue Verfahren auf die Probe stellen

Um zu prüfen, ob GWKNN in der Praxis wirklich hilft, haben die Autoren es an 12 Benchmark-Datensätzen aus dem bekannten UCI-Repository bewertet. Diese Sammlungen decken Finanzdaten, medizinische Messungen, Handschrift, Pflanzensamen und mehrere hochdimensionale Krebs- und Genexpressionsdatensätze ab, mit sowohl Zwei-Klassen- als auch Mehrklassenproblemen. Sie verglichen vier Versionen von KNN: die einfache Basisversion, eine Version nur mit der neuen Distanzmetrik, eine Version nur mit den neuen Abstimmungsgewichten und das vollständige GWKNN, das beide Ideen kombiniert. Außerdem traten sie gegen sieben weit verbreitete Klassifikatoren an, darunter Support Vector Machines, Entscheidungsbäume, Random Forests, logistische Regression, Naive Bayes und ein neuronales Netzwerk. Über wiederholte Trainings-/Testaufteilungen verfolgten sie nicht nur die durchschnittliche Genauigkeit, sondern auch, wie stark die Ergebnisse schwankten.

Ergebnisse: genauer und konsistenter

Die kombinierte GWKNN-Variante schnitt bei den meisten Datensätzen am besten oder gleichauf am besten ab, insbesondere bei solchen mit vielen Merkmalen und ungleichen Klassengrößen. Bei vergleichsweise einfachen Aufgaben lieferten alle Methoden gute Ergebnisse und die Verbesserungen waren moderat, doch GWKNN verbesserte tendenziell leicht die Genauigkeit und verringerte die Variabilität. Bei schwierigeren Genexpressionsdatensätzen mit Tausenden von Merkmalen waren die Vorteile deutlicher: Die gelernte Distanzmetrik half dem Algorithmus, sinnvollere Nachbarschaften zu bilden, und das gewichtete Abstimmen verbesserte die Erkennung unterrepräsentierter Klassen. Statistische Tests über alle Datensätze bestätigten, dass die Rangplätze von GWKNN signifikant besser waren als die des standardmäßigen KNN und einiger klassischer Modelle, was darauf hindeutet, dass seine Verbesserungen keine bloßen Zufallsschwankungen, sondern robust über verschiedene Datenbedingungen sind.

Was das für alltägliche Datenentscheidungen bedeutet

Für Nicht-Spezialisten lautet die Quintessenz: GWKNN verfeinert eine sehr intuitive Idee – „schau dir ähnliche frühere Fälle an“ –, um besser zur unordentlichen Realität moderner Daten zu passen. Indem es lernt, Ähnlichkeit datengetrieben zu messen, und den Einfluss seltener Kategorien bei der Abstimmung stärkt, zielt die Methode darauf ab, sowohl genauer als auch gerechter zu sein. Diese zusätzliche Raffinesse bringt zwar höhere Rechenkosten mit sich, vor allem bei sehr großen und hochdimensionalen Datensätzen, doch GWKNN zeigt großes Potenzial für Aufgaben, bei denen die korrekte Klassifikation von Minderheitsfällen wirklich zählt, etwa Früherkennung von Krankheiten oder Betrugserkennung. Die Arbeit veranschaulicht, wie klassische Algorithmen mit Einsichten aus Optimierung und Fairness aufgerüstet werden können, um mit dem Umfang und der Komplexität heutiger Informationen Schritt zu halten.

Zitation: Guo, Z., Liu, G., Liu, W. et al. GWKNN: an enhanced k-nearest neighbor algorithm with G metric reconstruction and Grey Wolf Optimizer. Sci Rep 16, 8857 (2026). https://doi.org/10.1038/s41598-026-41851-2

Schlüsselwörter: k-nächste Nachbarn, Distanzmetrikenlernen, Klassenungleichgewicht, Schwarmintelligenz, Datenklassifikation