Clear Sky Science · de

Ein erklärbares Vision-Transformer-Modell mit Transferlernen für die genaue Klassifizierung von Bohnenblattkrankheiten

Warum kranke Bohnenblätter uns alle betreffen

Bohnen sind für Hunderte Millionen Menschen, insbesondere in Entwicklungsländern, ein Grundnahrungsmittel und liefern bezahlbares Eiweiß und Ballaststoffe. Doch zwei verbreitete Blattkrankheiten – Angular Leaf Spot und Bohnenrost – können Felder unbemerkt an Ertrag verlieren lassen und so sowohl die Ernährungssicherheit als auch die Einkommen der Bäuerinnen und Bauern gefährden. Diese Studie untersucht, wie eine neue Form künstlicher Intelligenz diese Krankheiten frühzeitig erkennen und den Landwirten vor allem zeigen kann, was sie sieht, sodass ein mysteriöses Blackbox-System zu einem nachvollziehbaren und vertrauenswürdigen Werkzeug wird.

Verborgene Gefahren auf alltäglichen Blättern

Bohnenpflanzen stehen ständig unter dem Druck pilzlicher Erreger, die ihre Blätter narben, die Photosynthese reduzieren und zu geringeren, qualitativ minderen Ernten führen. Traditionell gehen Expertinnen und Experten über die Felder, um nach Schäden zu suchen, doch das ist langsam, subjektiv und auf großen Flächen kaum praktikabel. Viele moderne KI-Systeme, die Pflanzenfotos analysieren, können zwar sehr genau sein, bleiben für Nutzer aber undurchsichtig: Sie liefern eine Krankheitsbezeichnung ohne Erklärung. Für Landwirte, die weitreichende Entscheidungen über Spritzmittel, Neupflanzungen oder Ernte treffen müssen, ist blindes Vertrauen in einen stummen Algorithmus ein riskantes Unterfangen.

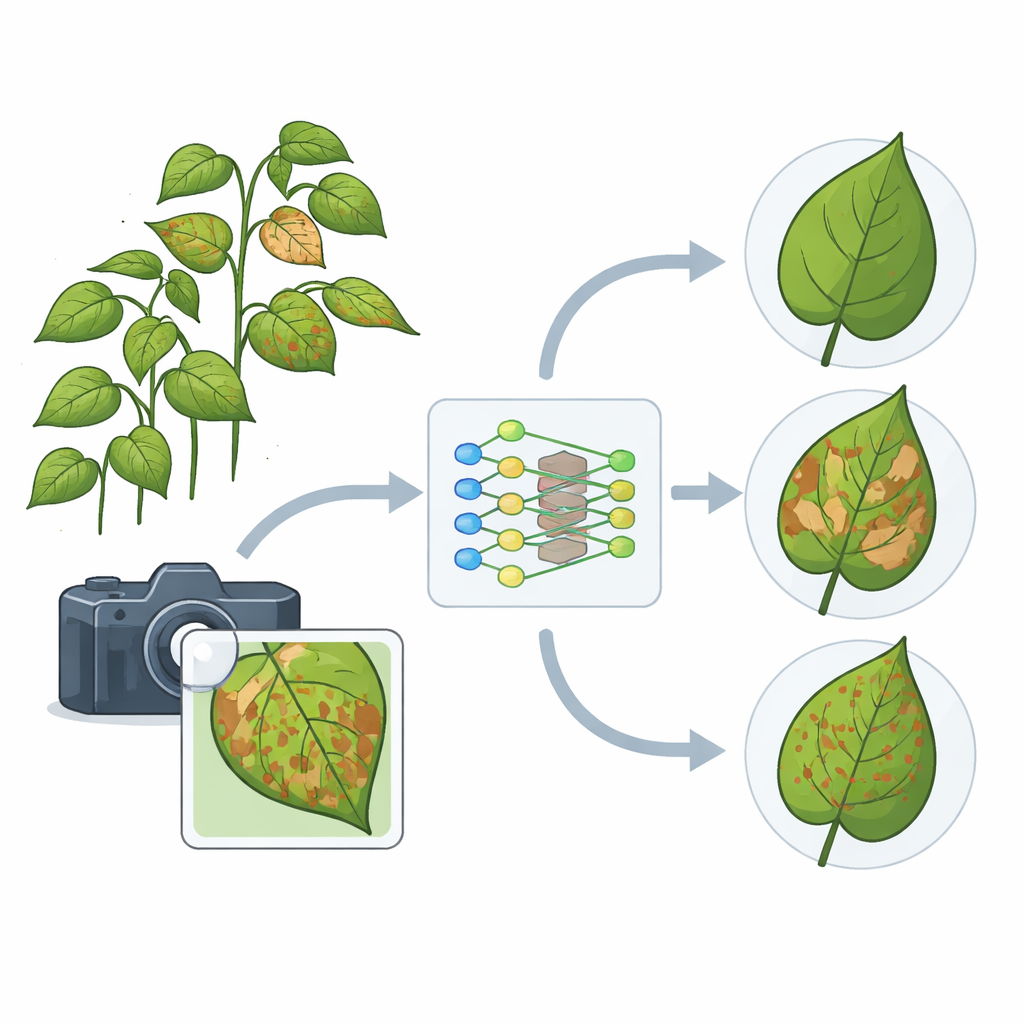

Eine klügere Methode, Blattbilder zu lesen

Die Forschenden schlagen ein automatisiertes Diagnosesystem vor, das auf einem „Vision Transformer“ basiert, einer vergleichsweise neuen Familie von Bildmodellen, die die Computer Vision verändert hat. Anstatt ein Bild mit kleinen verschiebenden Filtern zu scannen, zerlegt dieses Modell ein Blattfoto in viele kleine Patches und lernt gleichzeitig, wie diese Patches zueinander in Beziehung stehen. Diese globale Sicht hilft, subtile, verstreute Krankheitssignale zu erkennen, die ältere Methoden übersehen könnten. Um dem üblichen Bedarf an enormen Trainingsdaten zu begegnen, beginnen die Autorinnen und Autoren mit einem Modell, das bereits auf Millionen allgemeiner Bilder vortrainiert wurde, und feintunen dann die letzten Schichten auf Bohnenblättern—eine Strategie, die als Transferlernen bekannt ist.

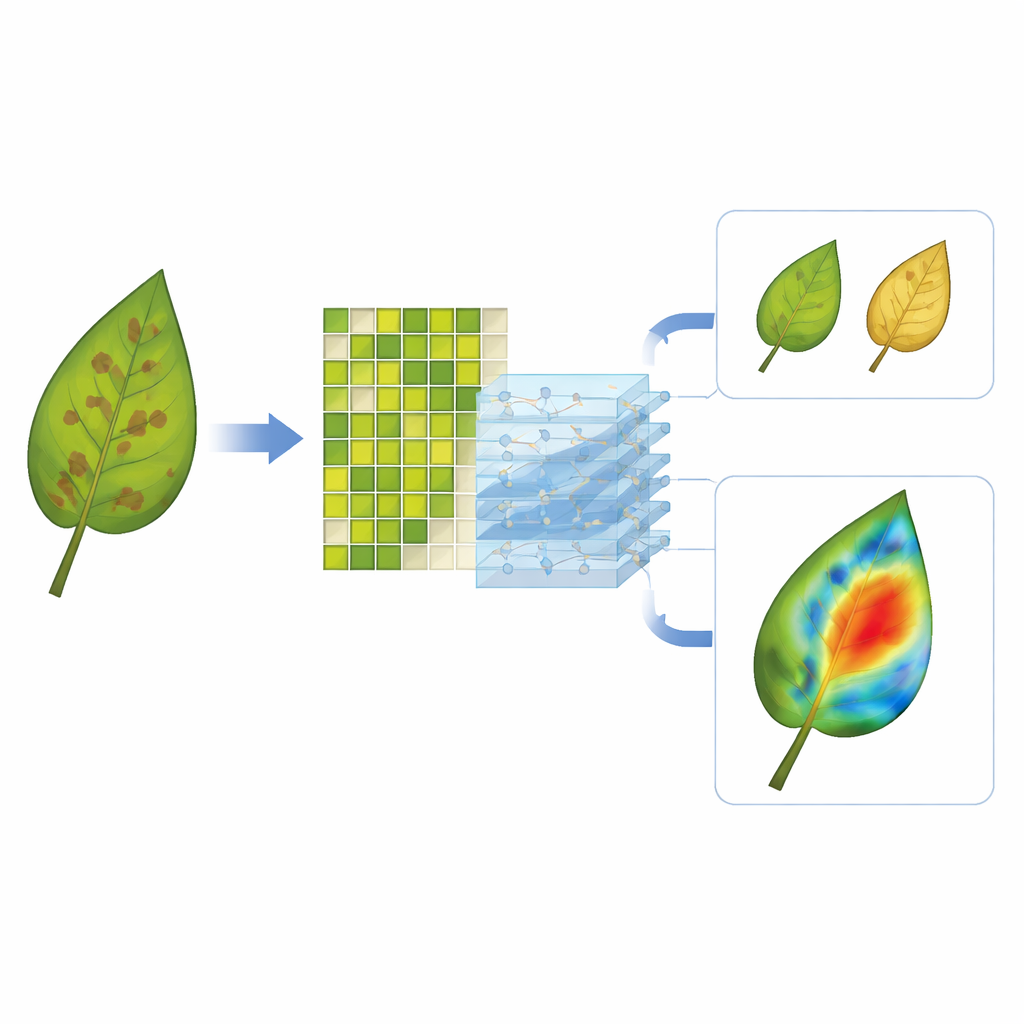

Die Blackbox in eine Glassbox verwandeln

Was dieses System besonders macht, ist nicht nur seine Fähigkeit, Blätter als gesund, Angular Leaf Spot oder Bohnenrost zu klassifizieren, sondern auch, wie transparent es seine Entscheidungen darstellt. Die Autorinnen und Autoren integrieren eine Erklärbarkeitsmethode namens GradCAM++, die die internen Signale des Modells in eine Heatmap über das Originalfoto übersetzt. Helle Regionen auf dem Blatt entsprechen den Flecken und Pusteln, die die Entscheidung am stärksten beeinflusst haben. Bei kranken Blättern richtet sich die Aufmerksamkeit des Modells auf die charakteristischen Läsionen; bei gesunden Blättern verteilt sich die Aufmerksamkeit breit, anstatt sich an zufälligen Hintergrundtexturen festzuhängen. Das schafft eine visuelle Rückkopplungsschleife, mit der Agronominnen, Agronomen und Landwirtinnen verifizieren können, dass das Modell auf echte Symptome achtet und nicht auf Erde, Finger oder Kameraartefakte.

Das System auf die Probe stellen

Um die Leistung zu bewerten, nutzt das Team einen öffentlichen „I-Bean“-Datensatz, der ursprünglich in ugandischen Feldern erhoben und von Pflanzenexpertinnen und -experten etikettiert wurde. Sie vergrößern den Trainingsanteil erheblich, indem sie Bilder drehen, spiegeln und farblich verschieben, um verschiedene Kamerawinkel und Lichtverhältnisse zu simulieren. Nach dem Feintuning des Modells auf diesem angereicherten Datensatz und dem Fixieren des Kernmerkmal-Extraktors bewerten sie es an einem unberührten Testset. Das System erreicht etwa 97,5 Prozent Genauigkeit, mit ähnlich hohen Werten für Präzision, Recall und dem kombinierten F1-Maß. Verwechslungen zwischen den drei Blattzuständen sind selten, was darauf hindeutet, dass das Modell gesunde Pflanzen zuverlässig von den einzelnen Krankheitstypen trennt, selbst wenn die visuellen Unterschiede subtil sind.

Schritte zu klügerer, gerechterer Landwirtschaft

Trotz der starken Leistung steht der Ansatz noch vor Hürden. Vision Transformer sind rechenintensiv, weshalb sie schwer in Echtzeit auf kostengünstigen Smartphones oder Drohnen laufen, ohne weitere Optimierung. Der Datensatz, obwohl augmentiert, repräsentiert nur drei Krankheitszustände und einen begrenzten Bereich extremer Lichtverhältnisse. Die Autorinnen und Autoren skizzieren zukünftige Richtungen wie das Komprimieren des Modells, damit es auf Edge-Geräten läuft, die Erweiterung auf weitere Krankheiten und Stresssymptome sowie die Erforschung leichterer Transformer-Varianten. Werden diese Herausforderungen gemeistert, könnte daraus ein tragbarer, vertrauenswürdiger Assistent entstehen, der Landwirtinnen und Landwirten weltweit hilft, Krankheiten früh zu erkennen, Erträge zu retten und Ressourcen klüger zu verwalten—wobei er stets zeigen kann, warum er zu einem bestimmten Ergebnis gekommen ist.

Zitation: Potharaju, S., Singh, A., Singh, D. et al. An explainable vision transformer model with transfer learning for accurate bean leaf disease classification. Sci Rep 16, 10402 (2026). https://doi.org/10.1038/s41598-026-41723-9

Schlüsselwörter: Bohnenblattkrankheit, Pflanzenkrankheitserkennung, Vision Transformer, erklärbare KI, präzise Landwirtschaft