Clear Sky Science · de

Ein optimiertes, echtzeitfähiges qualitatives HOG-basiertes Visual-Servoing-System für autonome Rollstühle

Intelligentere Fahrten für diejenigen, die sie am meisten brauchen

Für viele Menschen, die auf elektrisch angetriebene Rollstühle angewiesen sind, kann das Manövrieren durch belebte Flure oder unebene Bürgersteige ermüdend, stressig oder ohne Hilfe sogar unmöglich sein. Dieser Artikel stellt eine neue Methode vor, mit der ein Rollstuhl seine Umgebung über eine kleine Kamera „sieht“ und sich in Echtzeit glatt und sicher steuern kann — selbst mit preiswerter Hardware. Durch eine sorgfältige Neugestaltung der Art und Weise, wie visuelle Informationen verarbeitet und in Bewegung umgesetzt werden, zeigt die Autorin/der Autor, dass intelligente Rollstuhl-Navigation auf einem winzigen, energiearmen Computer laufen kann und dabei dennoch Komfort und Kontrolle für die Fahrenden erhält.

Warum herkömmliche Rollstühle im Alltag Schwierigkeiten haben

Traditionelle elektrische Rollstühle werden meist direkt über einen Joystick gesteuert oder verlassen sich auf einfache Kontaktsensoren, um Hindernisse zu vermeiden. Diese Ansätze versagen oft in vollen, sich verändernden Umgebungen wie Krankenhausfluren, Einkaufszentren oder städtischen Gehwegen. Nutzende berichten, dass ihnen vor allem eine gleichmäßige, vorhersehbare Bewegung und Zuverlässigkeit unter verschiedenen Lichtverhältnissen wichtig sind, nicht rohe Geschwindigkeit. Gleichzeitig benötigen viele hochentwickelte Robotikmethoden mit Kameras und komplexer Mathematik leistungsstarke Rechner, die für alltägliche Rollstühle zu teuer und sperrig sind. Diese Lücke — zwischen dem, was Anwender brauchen, und dem, was kostengünstige Hardware leisten kann — will die Studie schließen.

Dem Rollstuhl beibringen, Muster statt Punkte zu lesen

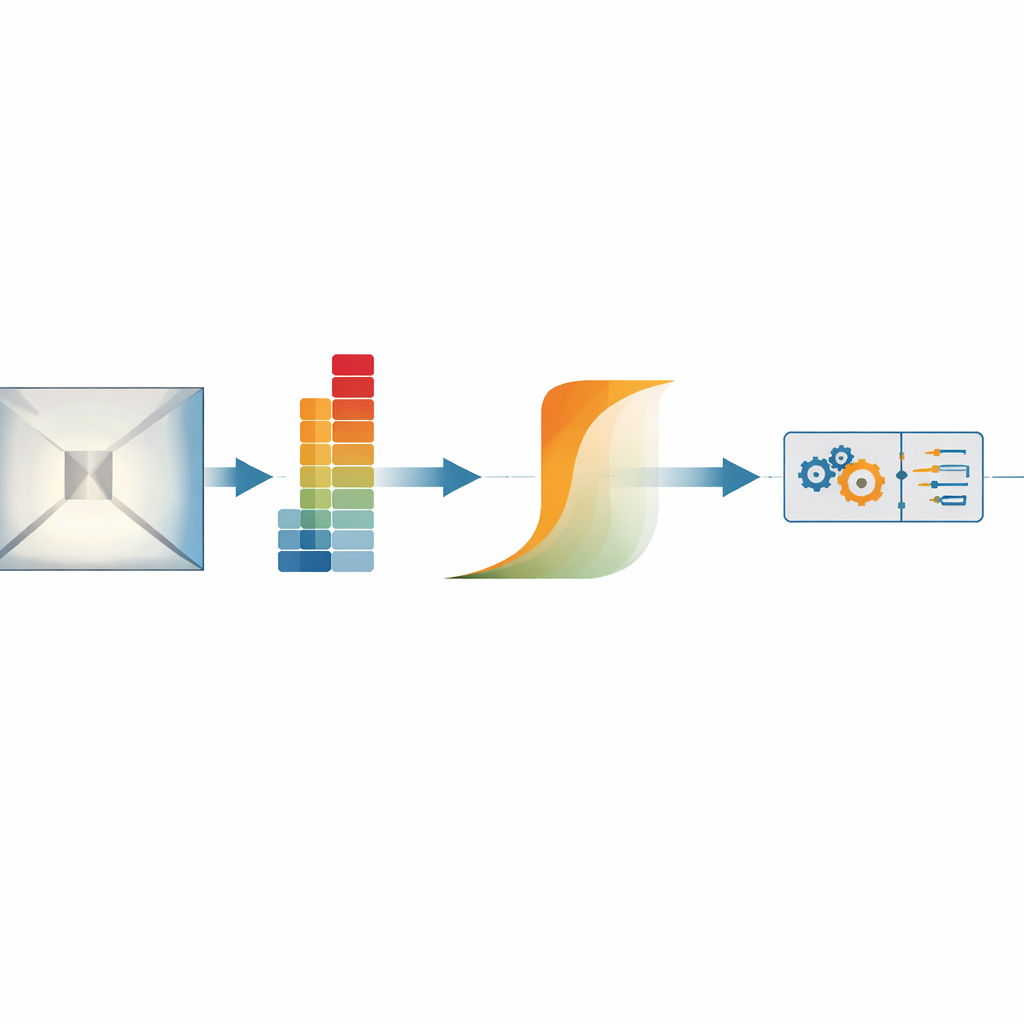

Das System verwendet eine am Rollstuhl montierte Kamera, die die Szene vor ihm beobachtet und sie nicht als einzelne Punkte oder Landmarken darstellt, sondern als Muster von Kanten und Linien, bekannt als Gradientenhistogramme. Einfach gesagt betrachtet es, wie sich die Helligkeit im Bild verändert, und verdichtet das zu einem kompakten Fingerabdruck der Szene. Diese Art der Musterbeschreibung ist von Natur aus tolerant gegenüber wechselnden Lichtverhältnissen und teilweisen Verdeckungen, zum Beispiel wenn eine vorbeigehende Person kurz das Kamerabild überdeckt. Der Rollstuhl vergleicht das aktuelle Muster mit einem „Ziel“-Muster, das einer gewünschten Ansicht entspricht — etwa dem Anblick eines geraden Flurs oder einer Landmarke am Ende eines Weges — und passt dann seine Bewegung an, um die beiden Muster stärker anzugleichen.

Spielraum zulassen für sicherere Steuerung

Anstatt auf eine perfekte Übereinstimmung zwischen der aktuellen und der Zielansicht zu bestehen, führt die Methode eine flexible „Vertrauenszone“ ein. Wenn die Kamerasicht des Rollstuhls nahe genug am Ziel ist, lässt das Steuerungssystem bewusst nach, um nervöse Hin‑ und Herkorrekturen zu vermeiden. Dies wird durch eine mathematische Aktivierungsfunktion erreicht, die die Lenkreaktion je nach Größe des visuellen Fehlers allmählich hoch- oder runterfährt, anstatt bei jedem Fehler einfach stärker zu reagieren. Dadurch kann der Rollstuhl teilweise Verdeckungen und visuelle Unsicherheit ohne ruckartige Bewegungen handhaben und behält in Aufgaben wie dem Folgen von Fluren oder dem Anfahren einer Reihe visueller Ziele gleichmäßige Bahnen bei.

Fortgeschrittene Bildverarbeitung auf einem winzigen Computer möglich machen

Eine große Herausforderung ist, dass diese reichen visuellen Fingerabdrücke in der Regel teuer zu berechnen sind. Die Autorin/der Autor begegnet dem, indem die Berechnungen so umgeschrieben werden, dass sie effiziente, „alles auf einmal“-Operationen statt langsamer verschachtelter Schleifen nutzen, unnötige Genauigkeit reduziert und die Speicherorganisation sorgfältig gestaltet wird. Auf einem Raspberry Pi — einem kreditkartenkleinen Computer, der häufig in Hobbyprojekten verwendet wird — steigert die verbesserte Software die Verarbeitungsgeschwindigkeit von unbrauchbaren Werten (etwa ein Bild alle 12 Sekunden) auf etwa fünfeinhalb Bilder pro Sekunde. Die Motoren des Rollstuhls erhalten Befehle in einer deutlich schnelleren, gleichmäßigen Frequenz, sodass sich die Räder sanft bewegen, während Kamera und Vision-System im Hintergrund aktualisiert werden. Zusätzliche Sicherheitslagen, einschließlich mechanischer Bremsen und eines Watchdogs, der den Stuhl stoppt, falls Befehle ausbleiben, sind integriert, um den praktischen assistiven Einsatz abzusichern.

Von der Labortheorie zur alltäglichen Hilfe

Durch Experimente in Fluren, auf Gehwegen und in kontrollierten Videotests lenkt das System den Rollstuhl konsistent von einem visuellen Ziel zum nächsten, wobei es die Lenkungsänderungen schrittweise verringert, je näher es dem jeweiligen Ziel kommt. Der kamerabasierte Musterabgleichsfehler nimmt konstant ab, was bestätigt, dass sich der Stuhl visuell ausrichtet, ohne dabei wichtige Merkmale aus den Augen zu verlieren. Einfach gesagt zeigt die Studie, dass ein kleiner, erschwinglicher Computer und eine einfache Kamera ausreichen, um einem elektrischen Rollstuhl einen stabilen, kameragesteuerten „Autopiloten" zu geben, der Komfort und Sicherheit respektiert. Das öffnet die Tür für zugänglichere, kamerabasierte Navigationshilfen für Menschen mit eingeschränkter Mobilität und legt das Fundament für künftige Erweiterungen wie reichere 3D-Wahrnehmung und noch sanftere Hindernisvermeidung.

Zitation: Hafez, A.H.A. An optimized real-time qualitative HOG-based visual servoing system for autonomous wheelchair. Sci Rep 16, 8688 (2026). https://doi.org/10.1038/s41598-026-41566-4

Schlüsselwörter: autonomer Rollstuhl, assistive Robotik, Computer Vision, visuelle Navigation, Echtzeitsteuerung