Clear Sky Science · de

Vorhersage, Syntax und semantische Verankerung im Gehirn und in großen Sprachmodellen

Wie Ihr Gehirn das nächste Wort errät

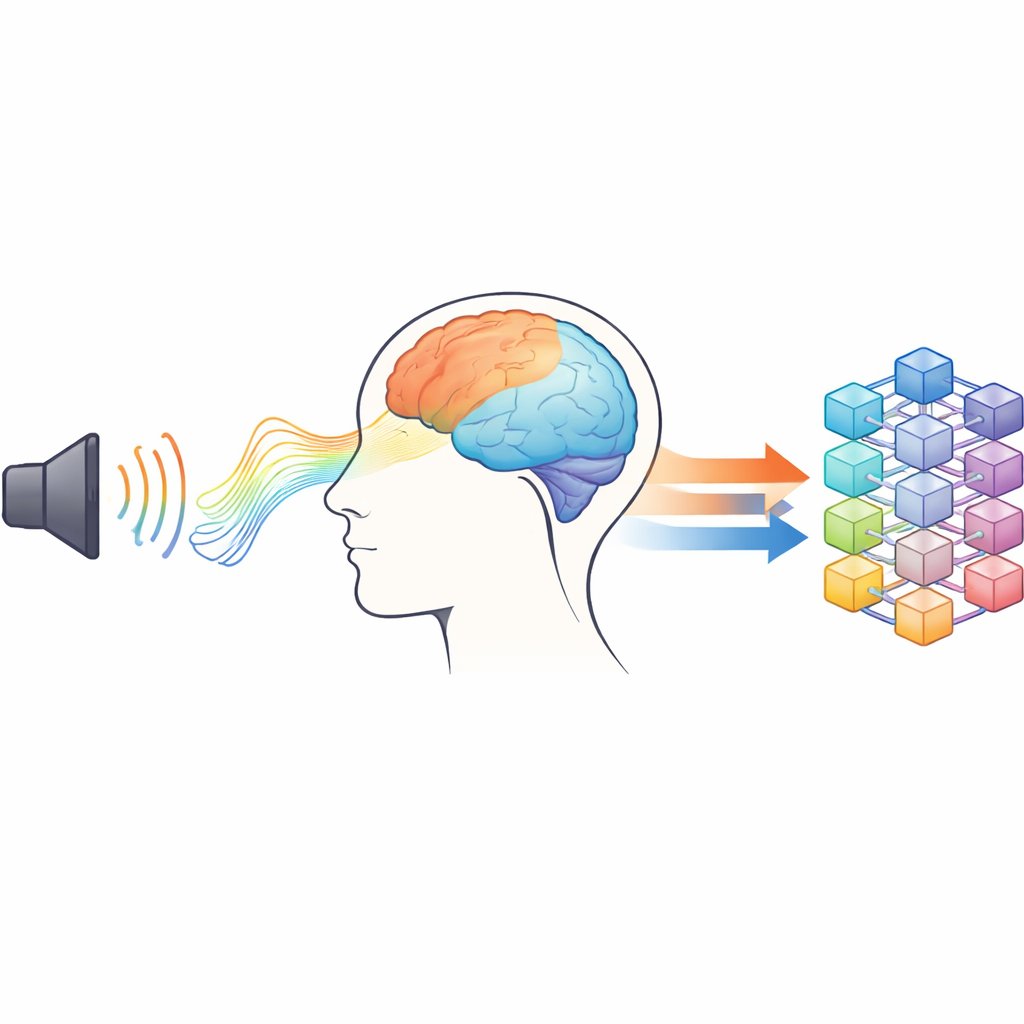

Wenn Sie einer Geschichte zuhören, wirkt das Mitverfolgen oft mühelos – doch unter der Oberfläche rät Ihr Gehirn ständig, was als Nächstes kommt. Gleichzeitig sagen moderne KI-Systeme wie große Sprachmodelle (LLMs) ebenfalls kommende Wörter voraus, um flüssigen Text zu erzeugen. Diese Studie verbindet beide Welten, indem sie untersucht, wie das menschliche Gehirn in Echtzeit Wörter antizipiert und wie diese Prozesse denen eines fortgeschrittenen KI-Modells entsprechen.

Einer Geschichte im Labor lauschen

Um natürliches Sprachverständnis zu untersuchen, gingen die Forschenden über künstliche Wortlisten oder kurze, isolierte Sätze hinaus. Stattdessen hörten 29 junge erwachsene Freiwillige etwa 50 Minuten eines deutschen Science-Fiction-Hörbuchs, während ihre Gehirnaktivität aufgezeichnet wurde. Gleichzeitig wurden zwei komplementäre Techniken eingesetzt: Elektroenzephalographie (EEG), die winzige Spannungsänderungen an der Kopfhaut misst, und Magnetenzephalographie (MEG), die die von Hirnaktivität erzeugten Magnetfelder detektiert. Gemeinsam können diese Methoden die Reaktionen des Gehirns auf jedes Wort mit Millisekundenpräzision verfolgen, während die Probanden einer durchgehenden Handlung folgen.

Unterschiedliche Wortarten verfolgen

Das Hörbuch wurde automatisch in einzelne Wörter zerlegt und nach grammatischem Typ gekennzeichnet: Substantive (wie „Planet“), Verben (wie „laufen“), Adjektive (wie „dunkel“) und Eigennamen. Für jedes Wort in der Geschichte schnitten die Wissenschaftlerinnen und Wissenschaftler ein kurzes Zeitfenster der EEG- und MEG-Signale vor und nach dem Wort heraus und mittelten diese Abschnitte innerhalb jeder Wortklasse. Das offenbarte verlässliche elektrische und magnetische „Signaturen“ für die verschiedenen Worttypen, einschließlich bekannter Komponenten, die mit Bedeutung und Satzstruktur verknüpft sind. Wichtig war, dass die Aktivität für Substantive sich bereits vor dem eigentlichen Wortbeginn aufzubauen begann, was darauf hindeutet, dass das Gehirn in diesem Kontext besonders auf diese Art von Wörtern vorbereitet war.

Wo Bedeutung auf Bewegung trifft

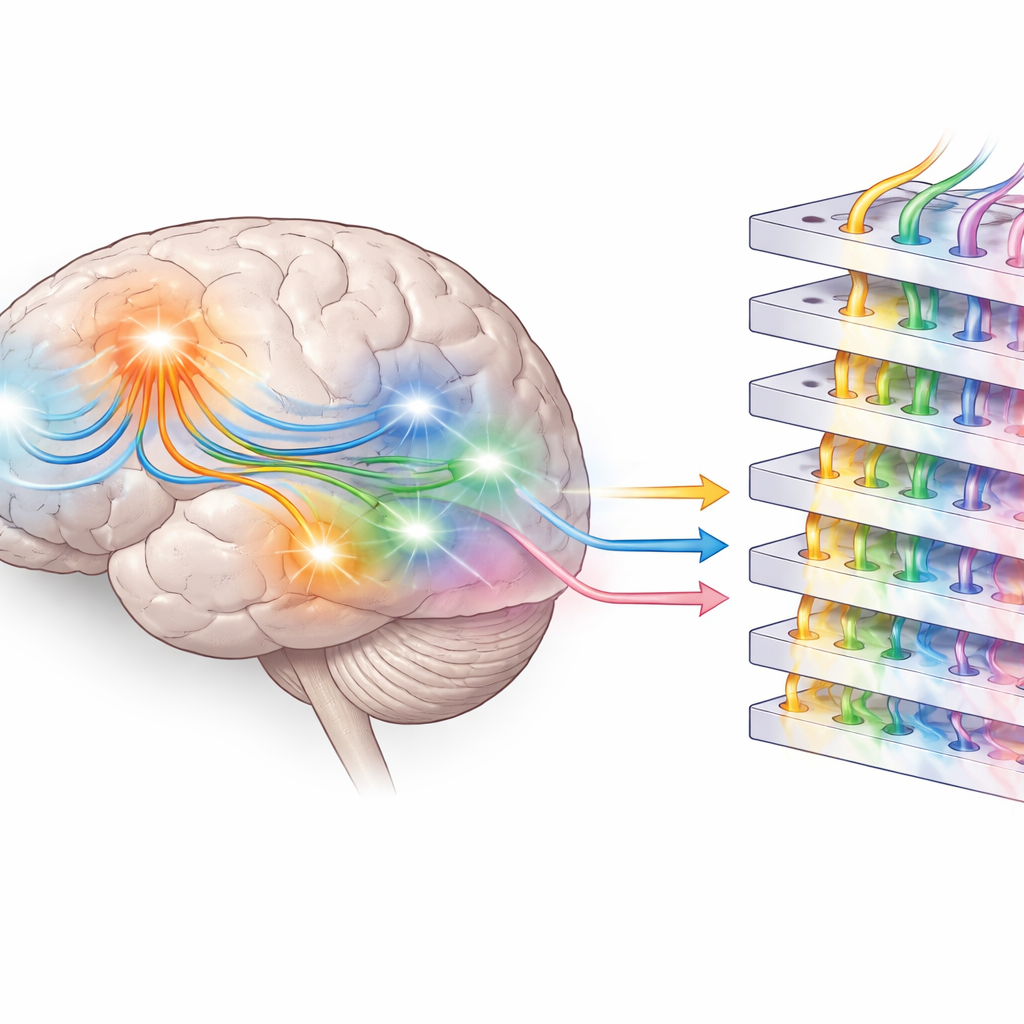

Um zu sehen, wo im Gehirn diese Signale entstehen, verwendeten die Forschenden Computermodelle, um die wahrscheinlichen Quellen der MEG- und EEG-Muster im Inneren des Kopfes abzuschätzen. Substantive aktivierten nicht nur klassische Sprachregionen in den Temporallappen; sie bezogen auch Bereiche ein, die mit Teilen des sensomotorischen Systems vereinbar sind, nahe Regionen, die an Bewegung und leiblicher Empfindung beteiligt sind. Verben zeigten dagegen ein anderes und eingeschränkteres Muster. Das stützt die Idee einer „verkörperten“ Sprache, nach der das Verstehen eines Wortes – insbesondere eines konkreten Substantivs – teilweise Netzwerke reaktiviert, die mit Wahrnehmung und Handlung verbunden sind, und damit Bedeutung in vergangenen sensorischen Erfahrungen verankert statt nur in abstrakten Regeln.

Vergleich von Gehirnen und großen Sprachmodellen

Das Team wandte sich anschließend dem Sprachmodell Llama 3.2 von Meta zu, um einen rechnerischen Referenzpunkt zu bieten. Zuerst testeten sie „semantische Vorhersage“, indem sie dem Modell den vorangegangenen Kontext aus dem Hörbuch fütterten und fragten, wie wahrscheinlich es das tatsächlich folgende Wort einschätzte. Substantive erwiesen sich als am einfachsten für das Modell vorherzusagen, was mit ihrer zentralen Rolle beim Aufbau der Geschichte übereinstimmt. Danach untersuchten die Forschenden „syntaktische Vorhersage“, indem sie die internen Aktivierungen bzw. Einbettungen innerhalb von Llama analysierten. Selbst ohne zusätzliche Anpassung gruppierten verborgene Schichten des Modells Wörter auf natürliche Weise nach der grammatischen Klasse des folgenden Wortes, und ein einfaches Probe-Netzwerk konnte oft vorhersagen, welche Wortklasse als Nächstes kommt. Über die Schichten hinweg wurde die interne Struktur für Eigennamen und Substantive deutlicher und spiegelte damit die zunehmende Differenzierung der Rollen wider, wie sie auch in den Aktivitätsmustern des Gehirns zu sehen ist.

Zwei Arten der Bereitschaft für Wörter

Insgesamt deuten die Befunde darauf hin, dass das Gehirn sich auf kommende Sprache mindestens auf zwei Ebenen vorbereitet. In temporalen Regionen scheint die Aktivität vor Wortbeginn eine Art grammatische oder „syntaktische“ Bereitschaft widerzuspiegeln – Wissen darüber, wo bestimmte Wortarten typischerweise im Satz auftreten. In eher frontalen und sensomotorischen Regionen scheinen die Bereitschaftsmuster reichere „semantische“ Erwartungen zu transportieren, die an Bedeutung und Erfahrung gebunden sind, insbesondere für Substantive und Namen. Große Sprachmodelle, die nur darauf trainiert sind, das nächste Wort vorherzusagen, entwickeln eigene geschichtete interne Strukturen, die diese Unterscheidungen teilweise nachbilden, aber ihnen fehlt die direkte Verankerung in der physischen Welt. Durch die Kombination hochaufgelöster Hirnaufzeichnungen mit Analysen modernster KI trägt diese Arbeit dazu bei, zu klären, wie Menschen Wörter beim alltäglichen Zuhören antizipieren und wie weit heutige Maschinen gekommen sind, dieses zentrale Merkmal des menschlichen Sprachverständnisses zu approximieren.

Zitation: Kölbl, N., Rampp, S., Kaltenhäuser, M. et al. Prediction, syntax and semantic grounding in the brain and large language models. Sci Rep 16, 8728 (2026). https://doi.org/10.1038/s41598-026-41532-0

Schlüsselwörter: Sprachvorhersage, Gehirn und KI, große Sprachmodelle, semantische Verankerung, EEG MEG Sprache