Clear Sky Science · de

Stochastischer Poisson‑eingebetteter Datenschutzrahmen für föderiertes Lernen mit sicherer homomorpher Verschlüsselung in der medizinischen KI

Medizinische Geheimnisse schützen, während Maschinen lernen

Krankenhäuser sammeln riesige Mengen an Röntgenbildern, die Ärztinnen und Ärzten helfen könnten, Krankheiten wie COVID‑19 früher und genauer zu erkennen. Diese Bilder sind jedoch auch hochgradig persönlich, und strenge Datenschutzvorschriften erschweren es, Daten an einem zentralen Ort zu bündeln, um leistungsfähige KI‑Werkzeuge zu trainieren. Diese Studie zeigt einen Weg, wie Krankenhäuser bei einem gemeinsamen Röntgendiagnosesystem zusammenarbeiten können, ohne jemals ihre Rohbilder preiszugeben — mit dem Ziel, Patientendaten abzuschirmen und dennoch erstklassige Genauigkeit zu erzielen.

Warum das Teilen medizinischer Daten so schwierig ist

Moderne KI gedeiht mit großen, vielfältigen Datensätzen, doch Krankenhäuser speichern Bilder typischerweise lokal und sind zögerlich — oder rechtlich daran gehindert —, sie an einen zentralen Server zu senden. Traditionelle Ansätze, die alle Daten in einer zentralen Datenbank sammeln, bergen das Risiko von Lecks und Cyberangriffen, untergraben das öffentliche Vertrauen und können Vorschriften verletzen. Selbst neuere Methoden, bei denen Krankenhäuser in einem Verfahren namens „federated learning“ gemeinsam ein Modell trainieren, sind nicht völlig sicher: Clevere Angreifer können manchmal aus Modellupdates rückschließen, wie Patient:innen‑Bilder aussahen. Gleichzeitig sind medizinische Daten oft unausgewogen und unordentlich, wobei einige Einrichtungen deutlich mehr Fälle einer bestimmten Krankheit haben als andere, was das Training destabilisieren und die Zuverlässigkeit verringern kann.

Ein kooperatives Netzwerk, das niemals Roh‑Röntgenbilder teilt

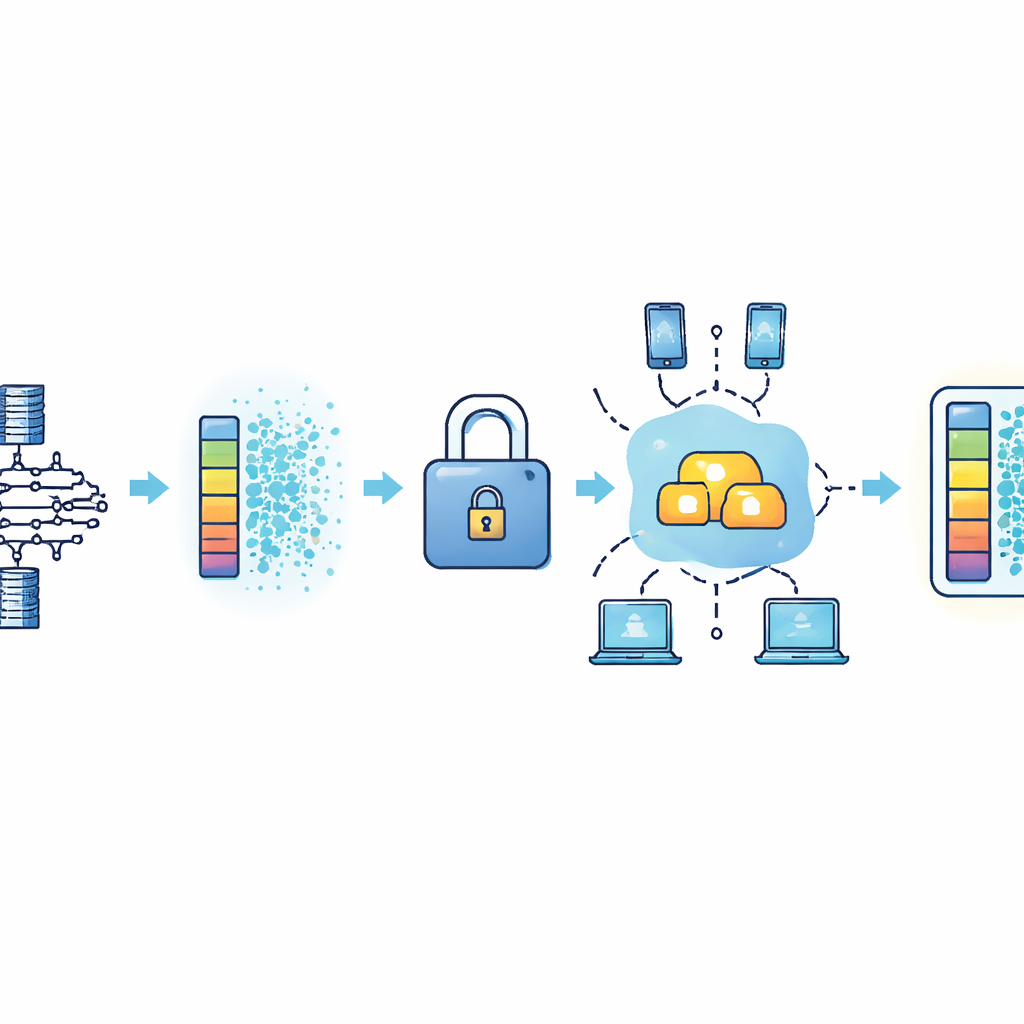

Die Autoren entwerfen einen föderierten Lernrahmen, der auf einem starken Bilderkennungsmodell namens ResNet‑50 basiert, um COVID‑19 von normalen Brust‑Röntgenaufnahmen zu unterscheiden. Jedes Krankenhaus trainiert eine eigene Kopie dieses Modells auf seinen lokalen Bildern und lässt alle Röntgenaufnahmen vor Ort. Statt Bilder zu versenden, übermitteln die Kliniken nur numerische Updates, die beschreiben, wie sich ihr lokales Modell ändern sollte. Ein zentraler Server mittelt diese Updates zu einem verbesserten globalen Modell und sendet das verfeinerte Modell dann an alle Teilnehmenden zurück. Durch Wiederholung dieses Zyklus profitiert das geteilte Modell von der kombinierten Erfahrung aller Beteiligten, ohne einzelne Scans preiszugeben.

Digitale „Störgeräusche“ und verschlossene Boxen für zusätzlichen Datenschutz

Um Angreifer daran zu hindern, Patient:innen‑Bilder aus Modellupdates zu rekonstruieren, legt der Rahmen zwei Datenschutztechniken über das föderierte Lernen. Zunächst fügt jedes Krankenhaus seinen Modellupdates sorgfältig kalibriertes Zufallsrauschen hinzu — ähnlich wie man einem Radiosignal Rauschen beimischt, damit einzelne Stimmen schwerer zu identifizieren sind, während die Gesamtbotschaft erhalten bleibt. Zweitens werden die Updates, bevor sie über das Netzwerk gehen, mit einer Methode verschlüsselt, die dem Server erlaubt, sie zusammenzuaddieren, während sie verschlossen bleiben — vergleichbar mit dem Zusammenzählen von Werten in versiegelten Umschlägen. Nur ein vertrauenswürdiger Schlüsselinhaber kann das kombinierte Ergebnis entsiegeln; der zentrale Server sieht niemals das Update eines einzelnen Krankenhauses unverschlüsselt. Zusammen sollen diese Schritte Versuche, Patientendaten rückzuentwickeln, vereiteln und zugleich die Nützlichkeit des geteilten Modells bewahren.

Das System auf die Probe stellen

Das Team bewertet seinen Rahmen an einem ausgeglichenen Satz von COVID‑19‑ und normalen Brust‑Röntgenbildern und simuliert mehrere Krankenhäuser als getrennte Trainingsstätten. Sie vergleichen drei Konfigurationen: klassisches zentrales Training mit allen gesammelten Daten, standardmäßiges föderiertes Lernen ohne zusätzliche Schutzmaßnahmen und ihren datenschutzverbesserten Ansatz. Trotz des hinzugefügten Rauschens und der Verschlüsselung erreicht das geschützte System erstaunlich hohe Werte — etwa 99,6 % Genauigkeit bei ähnlich starken Präzisions‑, Recall‑ und F1‑Werten — und entspricht damit oder übertrifft sowohl die zentrale als auch die ungeschützte föderierte Version. Messungen der Kommunikationsrunden, des Trainingsverlusts und der Rechenzeit zeigen, dass die Genauigkeit stetig steigt, wenn die Standorte zusammenarbeiten, während die zusätzliche Zeitkosten durch Verschlüsselung moderat bleiben. Ablations‑Experimente, bei denen Teile des Systems ein- und ausgeschaltet werden, bestätigen, dass die gewählten Rauschlevel und die Kombination aus Verschlüsselung und Kompression starken Datenschutz mit nur geringen Leistungs‑Trade‑offs bieten.

Was das für die zukünftige Versorgung bedeutet

Für Nicht‑Expert:innen ist die Kernbotschaft, dass diese Arbeit ein praktisches Rezept vorführt, wie man KI aus den Röntgenbildern vieler Krankenhäuser trainieren kann, ohne jemals Rohbilder offenzulegen oder Datenschutzgesetze zu schwächen. Durch die Kombination eines leistungsfähigen Bildmodells mit digitalem „Rauschen“ und verschlüsselter Aggregation zeigt der Rahmen, dass Krankenhäuser gemeinsam genaue Diagnosetools entwickeln können, während Patientendaten vor Ort bleiben und neugierigen Blicken entzogen sind. Obwohl an einem vergleichsweise kleinen Datensatz getestet und auf COVID‑19‑Röntgenbilder fokussiert, könnten dieselben Ideen auf andere Krankheiten, Bildmodalitäten und sogar andere sensible Bereiche wie Finanzen ausgeweitet werden. Kurz gesagt deutet die Studie auf eine Zukunft hin, in der leistungsstarke KI und starker medizinischer Datenschutz sich gegenseitig stärken statt sich zu widersprechen.

Zitation: Gomathi, R., Saranya, K., Mahaboob John, Y.M. et al. Stochastic Poisson-embedded privacy framework for federated learning with secure homomorphic encryption in medical AI. Sci Rep 16, 10931 (2026). https://doi.org/10.1038/s41598-026-41469-4

Schlüsselwörter: federated learning, medical imaging, data privacy, homomorphic encryption, X-ray diagnosis