Clear Sky Science · de

Innovative Erzeugungs-Informations-Funktion für aufeinanderfolgende Lebensdauersysteme in der Gesundheitsforschung

Warum das für reale Systeme wichtig ist

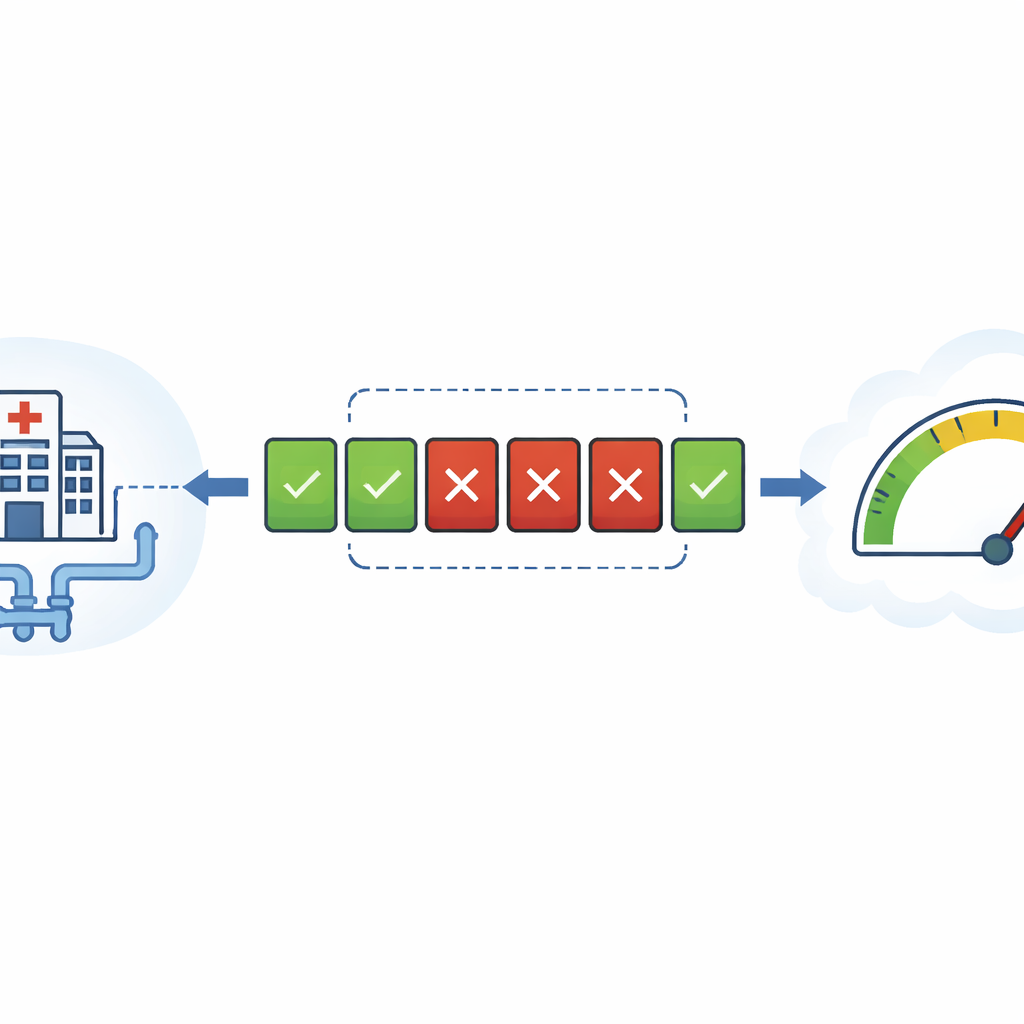

Die moderne Gesellschaft ist auf Systeme angewiesen, die weiterarbeiten müssen, auch wenn einzelne Teile ausfallen: Überwachungsleitungen in Krankenhäusern, Ölpipelines, Datenkabel oder Stromverbindungen. Viele dieser Systeme werden als „aufeinanderfolgende Systeme" entworfen, bei denen das gesamte Netzwerk als ausgefallen gilt, sobald eine Kette benachbarter Teile ausfällt. Dieser Artikel entwickelt neue mathematische Werkzeuge, um zu messen, wie unsicher oder anfällig solche Systeme sind, und zeigt, wie sich diese Werkzeuge in praktische statistische Tests überführen lassen — inklusive eines konkreten Beispiels mit Daten zu bösartigen Tumoren aus saudischen Krankenhäusern.

Wie Unsicherheit mit Information gemessen wird

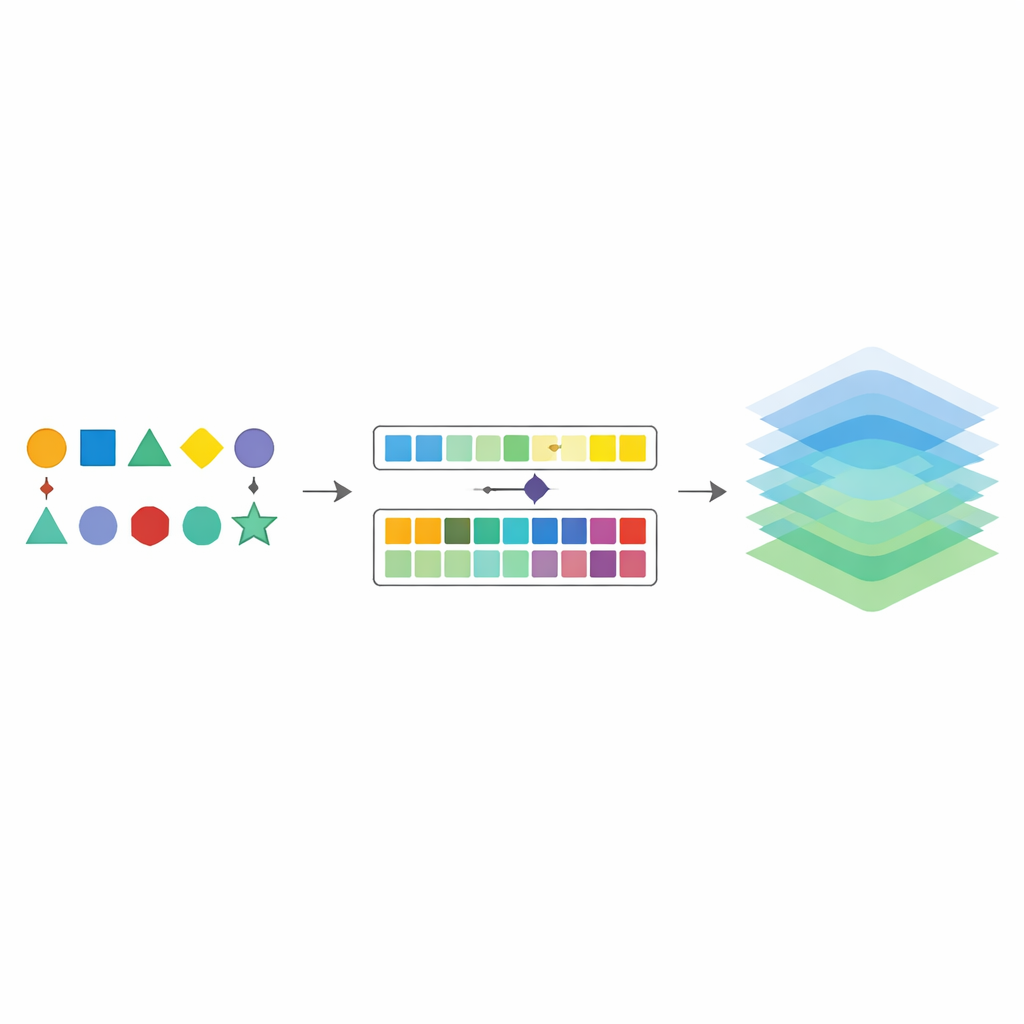

Kern der Arbeit ist das Konzept der Entropie, ein Begriff aus der Informationstheorie zur Quantifizierung von Unsicherheit. Die klassische Shannon-Entropie misst, wie unvorhersehbar eine einzelne Größe ist. Darauf aufbauend führten die Forscher Erzeugungs-Informations-Funktionen ein, eine flexible Familie von Maßen, die durch einen Einstellparameter gesteuert wird. Für bestimmte Parameterwerte liefert diese Familie bekannte Größen zurück: das Negative der Shannon-Entropie und eine verwandte, energienahe Größe namens Extropie. Das Papier untersucht, wie sich diese reichhaltige Familie nicht nur für einzelne Komponenten, sondern für ganze technische Systeme verhält, deren Lebensdauer vom Zusammenspiel vieler Teile abhängt.

Von Einzelteilen zu verketteten Komponenten

Viele praktische Entwürfe lassen sich als „consecutive l-out-of-m“-Systeme beschreiben: Man stelle sich eine Reihe von m identischen Komponenten vor, die funktioniert, solange nie l Ausfälle hintereinander auftreten. Diese Struktur umfasst klassische Extreme wie reine Reihen- und Parallelsysteme und tritt in Technologien von Vakuumsystemen über Ölpipelines und Mikrowellen-Relais bis zu Parksteuerungen auf. Das Papier leitet neue Formeln her, die den Informationsgehalt der Systemlebensdauer direkt in Bezug auf das Verhalten der Einzelteile ausdrücken. Eine zentrale Einsicht ist, dass sich durch eine geschickte Transformation der Komponentenlebensdauern in äquivalente Daten, die sich wie Stichproben aus einer einfachen Uniformverteilung verhalten, die komplexe systemweite Größe als handlicheres Integral über das Einheitsintervall schreiben lässt.

Designs vergleichen und Risiken begrenzen

Exakte Formeln für systemweite Informationsmaße können schnell unhandlich werden, wenn viele Komponenten beteiligt sind oder deren Lebensdauern komplizierten Verteilungen folgen. Um dem zu begegnen, entwickelt der Autor scharfe obere und untere Schranken, die den wahren Wert „einklappen“. Diese Schranken hängen von einfachen Zusammenfassungen des Komponentenverhaltens ab, etwa davon, wo die Dichte am höchsten ist (ihr Modus) oder wie breit die Lebensdauern gestreut sind. Das Papier formuliert außerdem Regeln für stochastische Vergleiche: Unter weiten Bedingungen hat ein auf Komponentenebene variableres oder ausfallfreudigeres Design auch ein größeres Informationsmaß für das aufeinanderfolgende System, was auf höhere Gesamtunsicherheit hinweist. Diese Ergebnisse erlauben Ingenieurinnen und Statistikern, alternative Entwürfe zu vergleichen, ohne alle mathematischen Details lösen zu müssen.

Einblick in den Mechanismus und Charakterisierung von Verteilungen

Das Informationsmaß für ein aufeinanderfolgendes System erweist sich als stark genug, um die zugrunde liegende Lebensdauerverteilung „zu charakterisieren“. Vereinfacht gesagt: Wenn zwei unterschiedliche Komponentmodelle für jede erlaubte Konfiguration des aufeinanderfolgenden Systems identisches Informationsverhalten liefern, dann müssen sie im Grunde dieselbe Verteilung sein, allenfalls verschoben oder skaliert. Das Papier beweist mehrere solche Charakterisierungssätze, darunter einen auffälligen für die Gleichverteilung: Die Art und Weise, wie Information in bestimmten aufeinanderfolgenden Systemen akkumuliert, identifiziert eindeutig, ob die Daten wirklich uniform sind oder nicht. Das legt das theoretische Fundament für neue Goodness-of-Fit-Tests.

Theorie in Schätzer und Tests überführen

Um die Ideen an realen Daten anwendbar zu machen, stellt der Autor zwei nichtparametrische Schätzer für das systemweite Informationsmaß vor. Diese Schätzer arbeiten direkt mit geordneten Stichprobenwerten und nähern die zugrunde liegende Verteilung durch Differenzen benachbarter Datenpunkte innerhalb eines gleitenden Fensters an. Umfangreiche Computersimulationen zeigen, dass beide Schätzer mit zunehmender Stichprobengröße genauer werden; die zweite — etwas verfeinerte — Variante weist jedoch insgesamt geringeren Bias und Fehler auf. Darauf aufbauend schlägt das Papier einen neuen Test zur Überprüfung der Uniformität vor, eine Fragestellung, die häufig in Simulation, Qualitätskontrolle und sozialwissenschaftlicher Modellierung auftaucht. Im Vergleich zu klassischen Tests wie Kolmogorov–Smirnov, Anderson–Darling und Cramér–von Mises zeigt der neue Test unter vielen Alternativen konkurrenzfähige oder überlegene Teststärke, besonders wenn die wahre Verteilung stärker gestreut ist als die Uniformverteilung.

Echte Gesundheitsdaten und praktische Wirkung

Die Methodik wird an Daten zu bösartigen Tumoren aus Saudi-Arabien angewendet, wobei zunächst das Exponentialmodell als geeignete Anpassung überprüft wird. Mit den vorgeschlagenen Schätzern bewertet der Autor die Informationsstruktur hypothetischer aufeinanderfolgender Systeme, die auf diesem Modell basieren, und wendet anschließend den neuen Uniformitätstest auf transformierte Tumordaten aus einer anderen Region und Patientengruppe an. Die Ergebnisse stützen die theoretischen Aussagen: Der verfeinerte Schätzer ist stabiler und der Test verhält sich wie vorhergesagt. Für eine fachfremde Leserin bleibt die Kernbotschaft: Wir verfügen nun über eine nuanciertere, informationsbasierte Perspektive zur Beurteilung der Robustheit verketteter Komponentensysteme und über praktikable Werkzeuge, um diese Perspektive in der Datenanalyse zu nutzen. Diese Instrumente können bessere Entwürfe und verlässlichere statistische Entscheidungen in Bereichen von Ingenieurwesen bis Gesundheitsforschung unterstützen.

Zitation: Mohamed, M.S. Innovative generating-information function for consecutive lifetime systems in health research. Sci Rep 16, 9097 (2026). https://doi.org/10.1038/s41598-026-41369-7

Schlüsselwörter: Systemzuverlässigkeit, Informationstheorie, Entropie, Uniformitätstest, Datenanalyse im Gesundheitswesen