Clear Sky Science · de

Ein neuartiges leichtgewichtiges Hybrid‑CNN–ViT zur Klassifikation von Maisblattkrankheiten

Landwirten helfen, kranke Maispflanzen früher zu erkennen

Mais versorgt Menschen, Tiere und treibt sogar Fahrzeuge an. Doch verborgene Infektionen in seinen Blättern können Erträge und Lebensgrundlagen unbemerkt schmälern. Diese Studie stellt ein intelligentes, leichtgewichtiges Computer‑Vision‑System vor, das Pflanzenkrankheiten automatisch erkennt — selbst in unordentlichen Feldaufnahmen aus der Praxis. Indem zwei verschiedene Arten künstlicher Intelligenz kombiniert und für kostengünstige Geräte angepasst werden, zeigen die Forschenden, wie Landwirte eines Tages Telefone, Drohnen oder einfache Kameras nutzen könnten, um den Gesundheitszustand der Kulturpflanzen schnell und zuverlässig zu überwachen.

Warum Maiskrankheiten schwer zu erfassen sind

Auf echten Feldern posieren Maispflanzen nur selten ordentlich für die Kamera. Blätter überlappen, das Licht ändert sich, und Boden oder Töpfe sorgen für unruhige Hintergründe. Expertinnen und Experten, die über Felder gehen, können frühe, subtile Symptome übersehen, und ihre Zeit ist begrenzt. Viele derzeitige bildbasierte Werkzeuge sind auf idealisierte Fotos mit einem einzelnen Blatt vor neutralem Hintergrund trainiert — ganz anders als das Blattgewirr, das eine Drohne oder feste Kamera tatsächlich sieht. Diese Diskrepanz bedeutet, dass heutige Algorithmen oft Probleme bekommen, sobald sie das Labor verlassen, besonders wenn sie zudem auf bescheidene Hardware wie Smartphones oder kleine Edge‑Geräte laufen sollen.

Zwei Arten, wie Maschinen „sehen“, und warum sie sich ergänzen

Moderne Bild‑Erkennungssysteme setzen meist entweder auf Convolutional Neural Networks oder auf die neuere Familie der Vision Transformer. Faltungsnetze sind stark darin, feine Details wie Kanten und Flecken in lokalen Bildbereichen zu erfassen, weshalb sie gut geeignet sind, lokale Krankheitsanzeichen zu finden. Transformer dagegen erfassen besser das große Ganze — also wie Muster über weit auseinanderliegende Bildregionen zueinander in Beziehung stehen — benötigen aber typischerweise riesige Trainingsdaten und leistungsfähige Rechner. Für sich genommen haben beide Ansätze Nachteile: Faltungen können langfristigen Kontext übersehen, während Transformer für den Alltag auf dem Feld zu rechenintensiv und datenhungrig sein können.

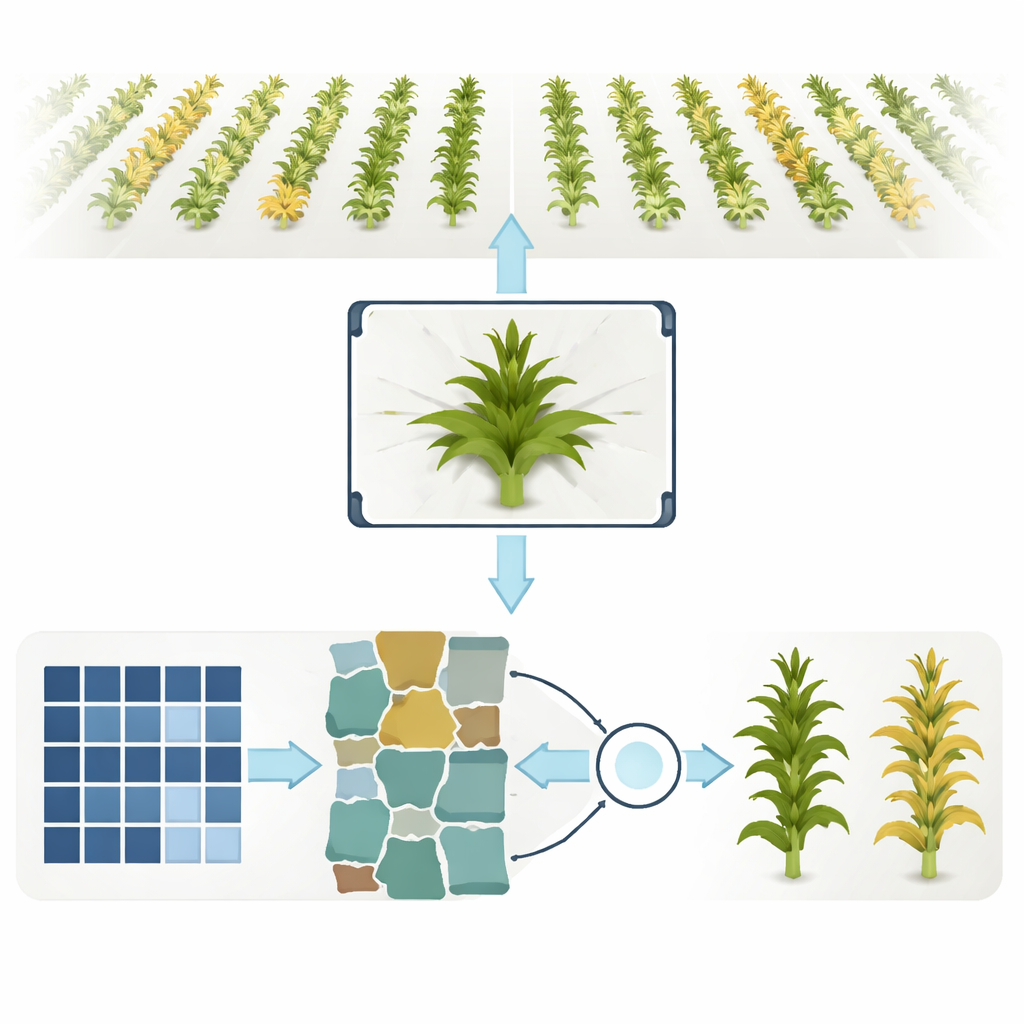

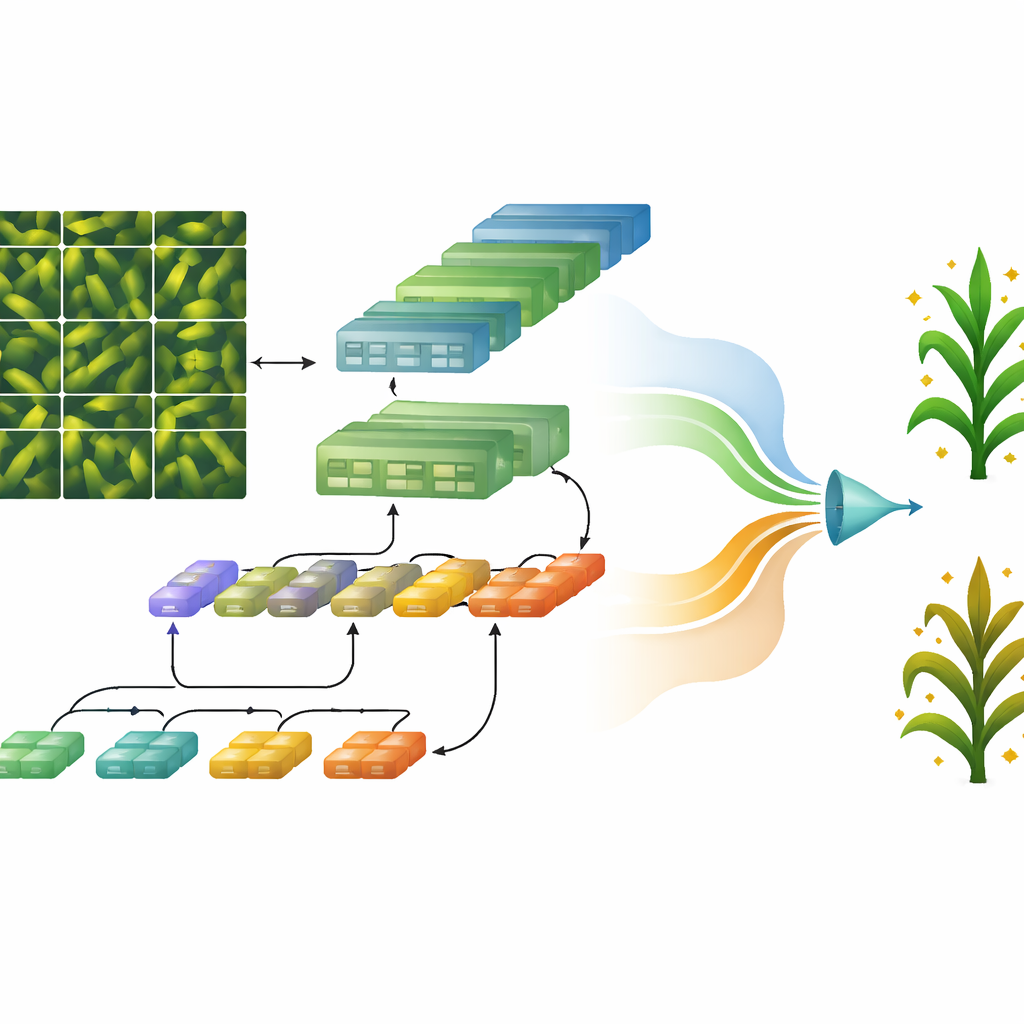

Ein leichtgewichtiges „Expertenteam“-Modell

Die Forschenden entwarfen ein Hybridmodell namens MXiT, das diese beiden Sichtweisen gezielt kombiniert. Eingehende Pflanzenbilder werden zunächst in sich überlappende Patches zerlegt, sodass feine Texturen erhalten bleiben. Ein Pfad im Netzwerk nutzt Faltungs‑Layer, um sich auf lokale Texturen und Blattdetails zu konzentrieren; ein anderer Pfad verwendet einen schlanken Aufmerksamkeitsmechanismus, der von Transformern inspiriert ist, um die globale Struktur über die gesamte Pflanzenkrone zu erfassen. Eine einfache Steuerungseinheit entscheidet dann für jedes Bild, wie stark dem „Lokal‑Detail‑Experten“ gegenüber dem „Global‑Kontext‑Experten“ vertraut werden soll und mischt deren Ausgaben zu einer einzigen Vorhersage, ob die Pflanze gesund oder krank ist. Wichtig ist, dass die Aufmerksamkeitskomponente reduziert und optimiert wurde, sodass das Gesamtsystem wenige Parameter und vergleichsweise geringe Rechenleistung benötigt — ideal für tragbare Geräte.

Tests mit realistischen und Benchmark‑Datensätzen

Um zu prüfen, wie gut das Modell außerhalb idealer Bedingungen funktioniert, nutzte das Team einen anspruchsvollen Datensatz von Top‑Down‑Maisaufnahmen namens PlantScanner. Jeder Frame zeigt eine ganze Pflanze von oben, mit mehreren sich überlappenden Blättern und natürlicher Formvariation. Eine Pflanze ist als „infiziert“ gekennzeichnet, wenn irgendein Blatt Symptome eines Pilzes namens Ustilago maydis zeigt. Dasselbe Modell wurde außerdem auf einer bekannten Benchmark‑Sammlung von Maisblattfotos, PlantVillage, bewertet, die mehrere verschiedene Krankheitstypen sowie gesunde Blätter enthält. In beiden Datensätzen wurde MXiT von Grund auf trainiert und mit etablierten leichtgewichtigen und transformerbasierten Modellen wie MobileViT, PiT, EdgeNeXt und DeiT verglichen.

Nahezu perfekte Genauigkeit bei geringerem Rechenaufwand

Auf dem anspruchsvollen PlantScanner‑Datensatz erreichte MXiT etwa 99,9 % Genauigkeit und benötigte dabei weniger Modellparameter und geringere Rechenkosten als die Konkurrenz. Es konvergierte schnell während des Trainings und zeigte ein stabiles Verhalten, im Gegensatz zu einigen Alternativen, deren Genauigkeit schwankte oder trotz größerer Modelle zurückblieb. Auf dem PlantVillage‑Benchmark erzielte das Hybridmodell erneut erstklassige Genauigkeit bei der kleinsten Modellgröße unter den besten Systemen. Visualisierungen dazu, wo verschiedene Modelle im Bild „hinsehen“, zeigten, dass MXiT konsequent biologisch sinnvolle Regionen — gestresstes Blattgewebe und Pflanzenzentren — fokussierte, während andere Modelle oft Aufmerksamkeit auf Boden oder Hintergrund verschwendeten. Das deutet darauf hin, dass das Hybrid‑Design nicht nur genau, sondern auch besser interpretierbar ist.

Was das für die Zukunft der Pflanzenpflege bedeutet

Für Nicht‑Spezialisten ist die Kernbotschaft einfach: Indem zwei sich ergänzende Vision‑Systeme zusammenarbeiten und die Aufgabe effizient teilen, kann MXiT Maisblattkrankheiten in realistischen Feldbildern mit nahezu perfekter Zuverlässigkeit erkennen, ohne einen Supercomputer zu benötigen. Ein derartig kompakter, genauer Ansatz könnte praktische Werkzeuge antreiben, die auf Drohnen, Traktoren oder Smartphones laufen und Landwirten frühzeitig Warnungen geben, bevor sich Probleme ausbreiten. Während die vorliegende Arbeit darauf fokussiert, ob eine Pflanze gesund oder krank ist, ließe sich derselbe Ansatz erweitern, um den Schweregrad einer Infektion zu schätzen — ein möglicher Schritt hin zu intelligenterem, präziserem und weniger chemieintensivem Pflanzenschutz in den kommenden Jahren.

Zitation: Mehdipour, S., Mirroshandel, S.A. & Tabatabaei, S.A. A novel lightweight hybrid CNN–ViT for maize leaf disease classification. Sci Rep 16, 10468 (2026). https://doi.org/10.1038/s41598-026-41190-2

Schlüsselwörter: Erkennung von Maisblattkrankheiten, hybrider CNN‑Transformer, Pflanzenphänotypisierung, präzise Landwirtschaft, leichtgewichtiges Deep Learning