Clear Sky Science · de

TumorSageNet CNN-Hybridarchitektur ermöglicht genaue Erkennung von Krankheiten an Mangoblättern

Warum das Erkennen kranker Blätter wichtig ist

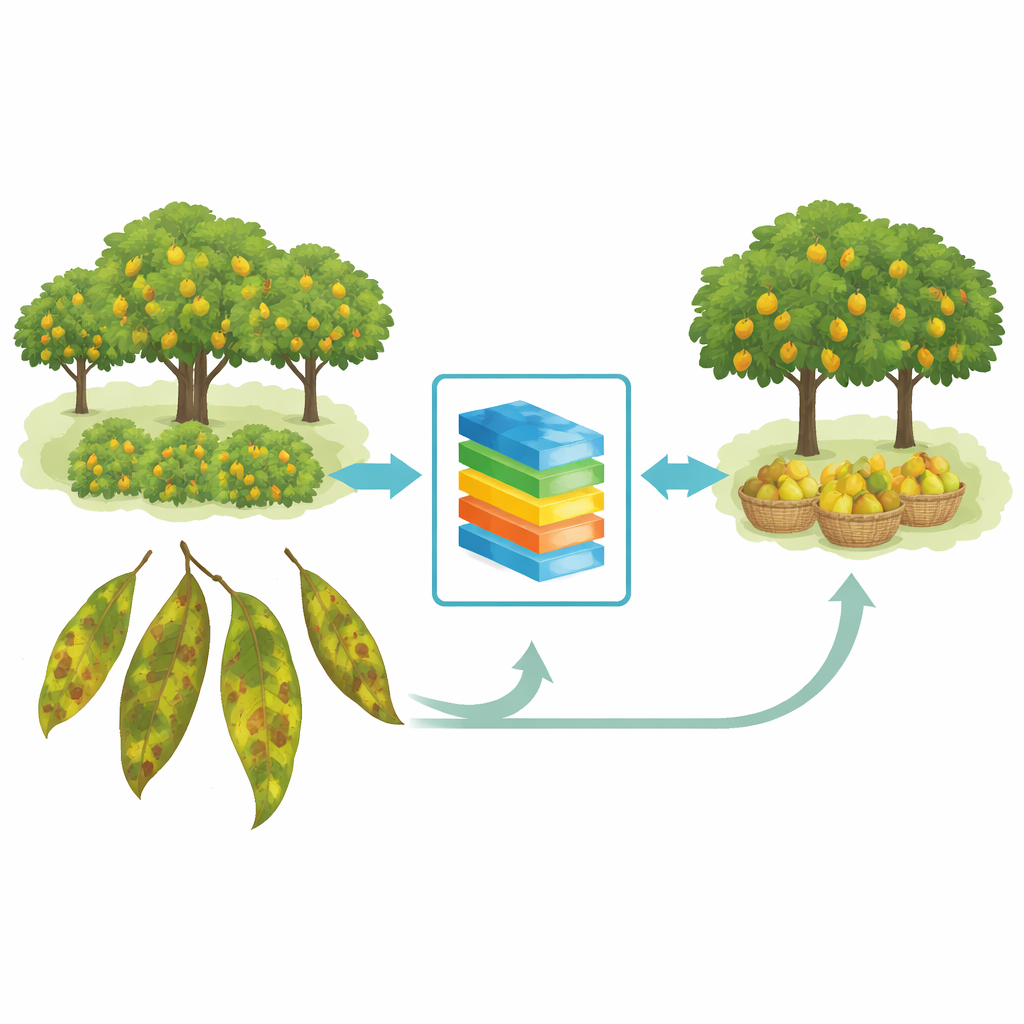

Mangos sind in vielen Regionen – etwa in Bangladesch – ein Grundnahrungsmittel und eine Einkommensquelle für Millionen von Landwirtinnen und Landwirten. Kleine Flecken auf Mangoblättern können jedoch Krankheitssymptome ankündigen, die Erträge schleichend reduzieren und die Ernährungssicherheit gefährden. Dieser Artikel untersucht, wie moderne künstliche Intelligenz gewöhnliche Fotos von Mangoblättern in ein Frühwarnsystem verwandeln kann, das Landwirtinnen und Landwirten hilft, ihre Plantagen zu schützen, bevor Schäden unumkehrbar werden.

Von Feldfotos zur intelligenten Diagnose

Die Forschenden konzentrierten sich auf eine einfache, aber wirkungsvolle Idee: Wenn eine Person ein Blatt ansehen und Krankheiten erkennen kann, lässt sich ein Computer so trainieren, dass er dasselbe tut — nur schneller, konsistenter und in großem Maßstab. Sie sammelten 800 hochauflösende Bilder von Mangoblättern aus Obstgärten in der Region Rajshahi in Bangladesch, die sechs häufige Probleme wie Anthracnose, Trockentod (Die Back) und Mehltau sowie gesunde Blätter abdeckten. Expertinnen und Experten kennzeichneten jedes Bild sorgfältig, damit die Computermodelle verlässliche Beispiele dafür haben, wie sich die einzelnen Zustände darstellen. Die Bilder wurden anschließend skaliert und in Trainings-, Validierungs- und Testmengen aufgeteilt, um reale Einsatzbedingungen zu simulieren, bei denen ein Modell Blätter korrekt klassifizieren muss, die es zuvor noch nie gesehen hat.

Jedes Pixel optimal nutzen

Unter realen Feldbedingungen ist alles unordentlich: Blätter zeigen in ungewöhnlichen Winkeln, stehen unter hartem Sonnenlicht oder tiefem Schatten und vor unordentlichen Hintergründen. Um die Modelle auf diese Komplexität vorzubereiten, verwendete das Team Datenaugmentation, bei der durch Spiegeln, Drehen und Zoomen künstlich Varianz erzeugt wird, sodass das System sich nicht auf enge visuelle Hinweise verlässt. Außerdem wandelten sie jedes Bild in mehrere unterschiedliche Farbdarstellungen um, die subtile Unterschiede in Helligkeit und Pigmentierung hervorheben. Das hilft, blasse Flecken, dunkle Stellen oder puderartige Beläge sichtbar zu machen, die im Originalfoto schwach erscheinen, aber für die Früherkennung entscheidend sind.

Entwicklung eines neuen intelligenten Sehmodells

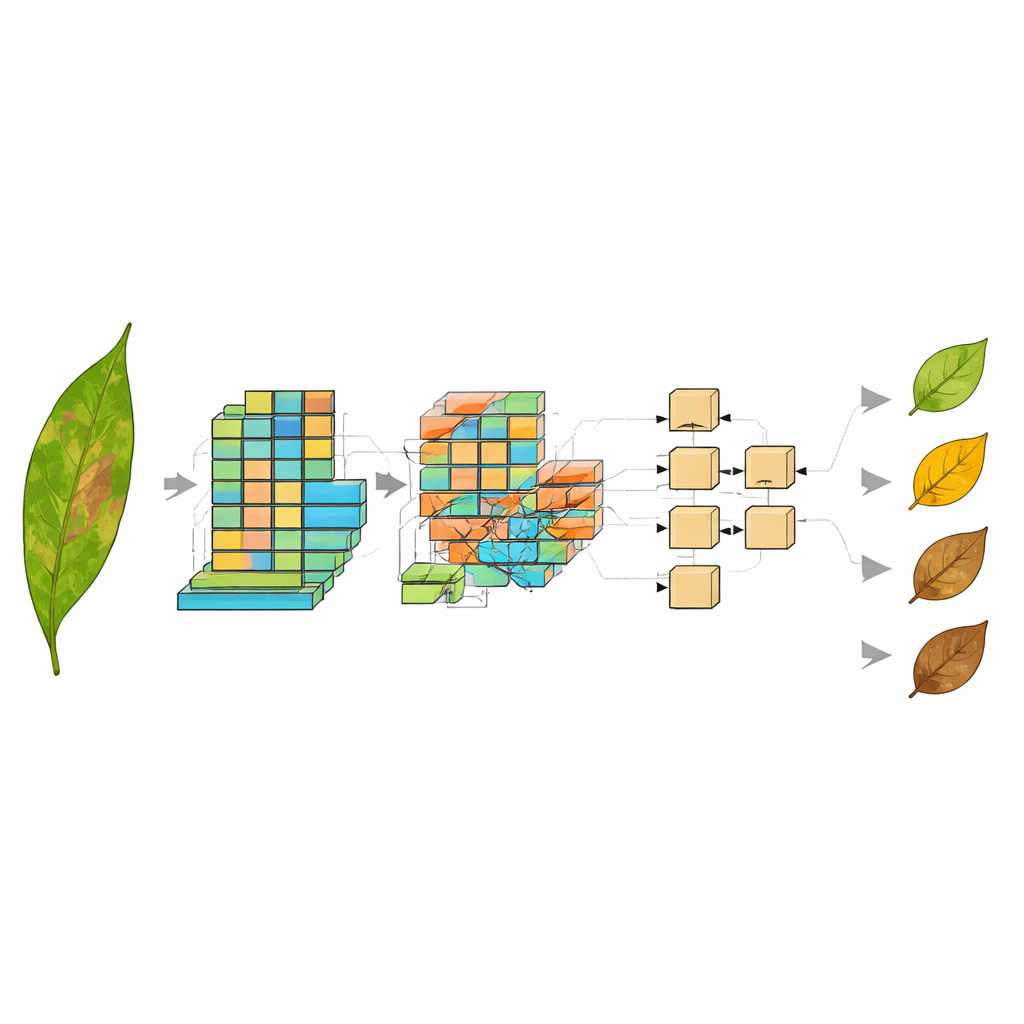

Auf dieser sorgfältig vorbereiteten Bildsammlung bauten die Autorinnen und Autoren zwei Haupttypen von Computermodellen auf. Das erste ist ein maßgeschneidertes Convolutional Neural Network – ein geschichtetes Mustererkennungssystem, das speziell auf die Formen und Texturen von Mangoblättern abgestimmt ist. Das zweite ist ein elaborierteres Hybridmodell namens TumorSageNet: Es beginnt mit einem leistungsstarken, vortrainierten Bildnetz (EfficientNet-B7), fügt spezielle Attention-Layer hinzu, die sich auf die aussagekräftigsten Bereiche eines Blatts konzentrieren, und leitet diese Muster anschließend durch eine sequenzlesende Schicht (bekannt als LSTM), die lernt, wie unterschiedliche Blattpartien zueinander in Beziehung stehen. Beide Modelle wurden mit bekannten Bildnetzwerken wie AlexNet und VGG sowie mit einfacheren Ansätzen wie K-Nearest Neighbors verglichen.

Einblick in das "Denken" der KI

Allein auf hohe Genauigkeit zu setzen reicht nicht aus, wenn Landwirtinnen und Agronominnen dem System nicht vertrauen können. Um diese Blackbox zu öffnen, nutzten die Forschenden eine Technik namens Grad-CAM, die eine farbige Heatmap über das Eingabebild legt, um zu zeigen, wohin das Modell seine Aufmerksamkeit richtet. Wenn das System ein Blatt etwa als von Anthracnose befallen einstuft, hebt die Heatmap das dunkle, abgestorbene Gewebe hervor, das auch menschliche Fachleute als wichtig erachten. Diese visuelle Übereinstimmung zwischen menschlicher Beurteilung und maschineller Fokussierung hilft zu verifizieren, dass das Modell auf echte Krankheitssymptome reagiert und nicht auf zufällige Hintergrunddetails; sie kann zudem gezielteres Spritzen oder Beschneiden auf Plantagen unterstützen.

Was die Ergebnisse für Landwirtinnen und Landwirte bedeuten

Bei den Testbildern erreichte das maßgeschneiderte Netzwerk perfekte Werte für Genauigkeit, Präzision, Rückruf (Recall) und F1-Score, und das hybride TumorSageNet-Modell schnitt fast genauso gut ab. Auch wenn diese Ergebnisse beeindruckend sind, räumen die Autorinnen und Autoren ein, dass der Datensatz noch überschaubar ist und aus einer einzigen Region stammt; breitere Tests sind nötig, bevor man von universeller Zuverlässigkeit sprechen kann. Trotzdem zeigt die Studie, dass mit gut durchdachten Modellen, sorgfältiger Bildaufbereitung und klaren visuellen Erklärungen KI zu einem praktischen Partner bei der Pflanzenüberwachung werden kann. Konkreter gesprochen deutet diese Arbeit auf telefonbasierte Werkzeuge hin, mit denen Landwirtinnen und Landwirte ein Foto eines verdächtigen Blatts machen und eine sofortige, verständliche Einschätzung erhalten können – was Ernten retten, Einkommen stabilisieren und den Druck auf die globale Lebensmittelversorgung verringern kann.

Zitation: Ghosh, H., Rahat, I.S., Hossain, M.Z. et al. TumorSageNet CNN hybrid architecture enables accurate detection of mango leaf pathologies. Sci Rep 16, 11033 (2026). https://doi.org/10.1038/s41598-026-40944-2

Schlüsselwörter: Krankheit an Mangoblättern, Pflanzenschaderkennung, Deep Learning, präzise Landwirtschaft, Computer Vision