Clear Sky Science · de

Menschliche versus künstliche Intelligenz bei der Diagnose in der oralen Pathologie: eine vergleichende Studie von ChatGPT, Grok und MANUS

Warum das für Ihren nächsten Zahnarzttermin wichtig ist

Wenn ein Zahnarzt eine verdächtige Stelle im Mund entdeckt, fällt das endgültige Urteil darüber, ob sie harmlos oder gefährlich ist, meist durch einen Spezialisten, der Gewebe im Mikroskop untersucht. Diese Arbeit ist sorgfältig, zeitaufwendig, und in vielen Teilen der Welt gibt es nicht genügend Expertinnen und Experten. Diese Studie stellt eine aktuelle Frage: Können moderne Systeme der künstlichen Intelligenz diese mikroskopischen Bilder von Mundgewebe mit einer Genauigkeit lesen, die nahe an der von menschlichen Spezialisten liegt, und so Diagnosen schneller, konsistenter und breiter verfügbar machen?

Was die Forschenden testen wollten

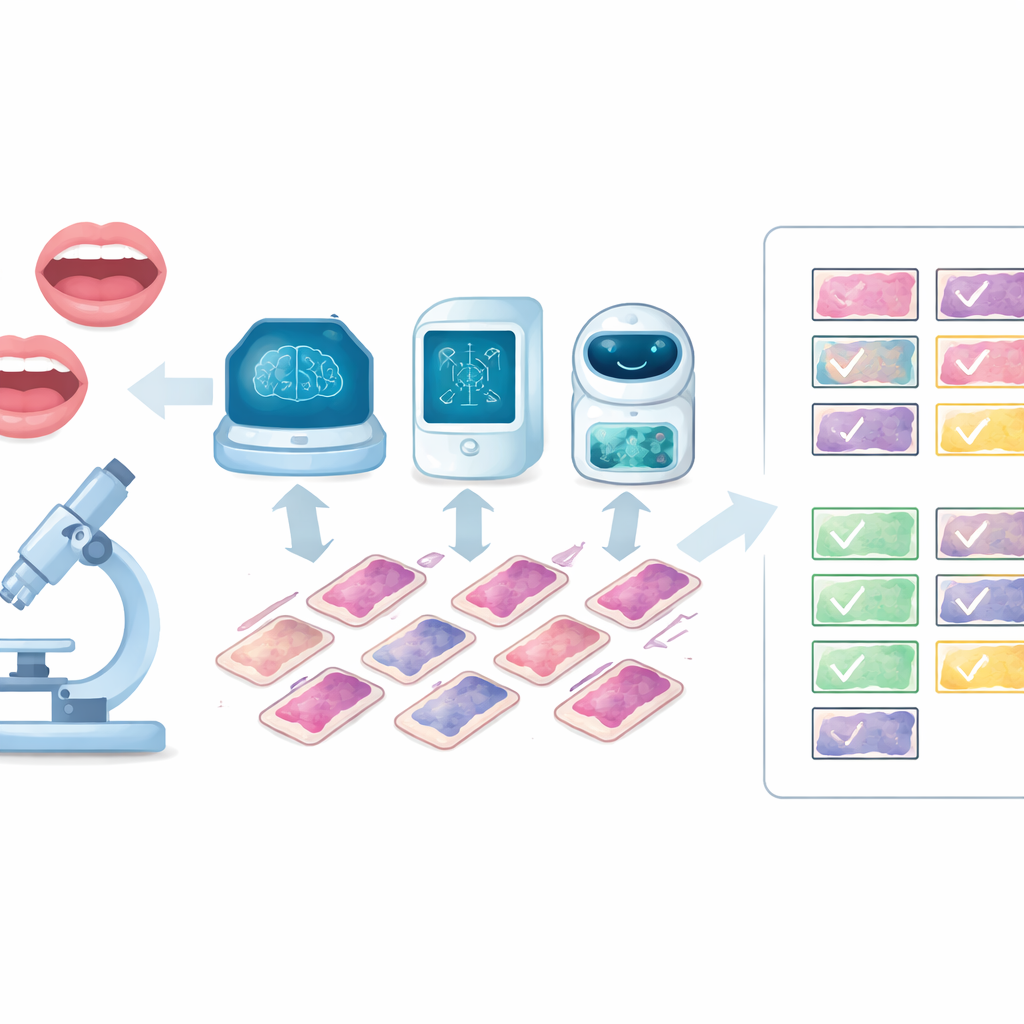

Das Team konzentrierte sich auf drei fortgeschrittene Computerprogramme, die sowohl Bilder als auch Sprache verarbeiten können: ChatGPT, Grok und ein medizinisches System namens MANUS. Anstelle von echten Patientendaten nutzten sie 100 klare, hochwertige Mikroskopaufnahmen aus einem Standardlehrbuch für Erkrankungen der Mundhöhle. Jedes Bild zeigte eine andere Problemart, von frühen präkanzerösen Veränderungen bis zu Tumoren, Zysten und reaktiven Wucherungen. Zwei erfahrene orale Pathologen einigten sich zunächst auf die korrekte Diagnose für jede Präparation und schufen so einen belastbaren menschlichen Standard, an dem die Maschinen gemessen werden konnten.

Wie der direkte Vergleich ablief

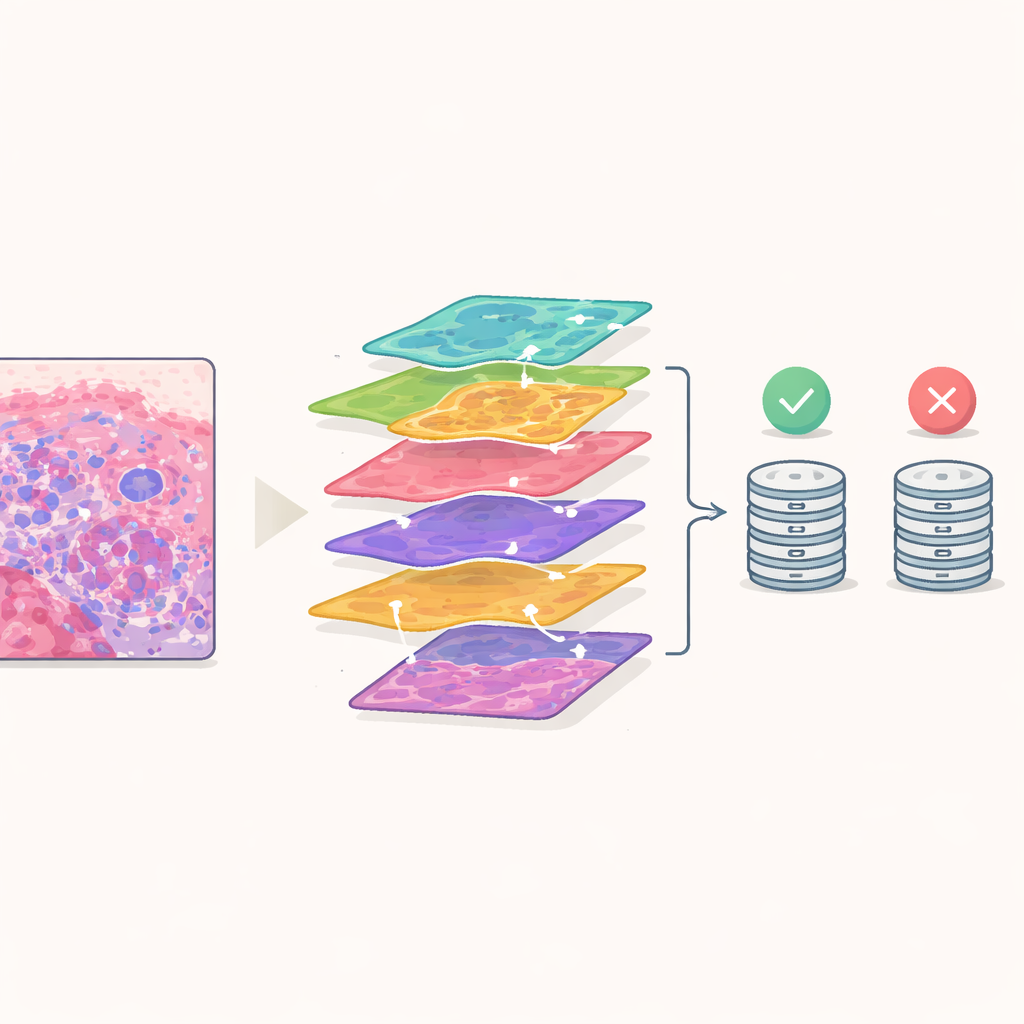

Jede der 100 Präparate wurde allen drei KI‑Systemen mit derselben kurzen Fallbeschreibung und demselben digitalen Bild gezeigt. Die Modelle sollten die eine wahrscheinlichste Diagnose benennen, so wie ein Spezialist es in einem Befund tun würde. Um zu prüfen, ob die Systeme über die Zeit stabile Antworten liefern, wiederholten die Forschenden den gesamten Prozess zwei Wochen später mit denselben Bildern und Instruktionen. Parallel dazu lasen die beiden menschlichen Pathologen die Präparate unabhängig voneinander, ohne die KI‑Ergebnisse zu sehen, und diskutierten dann etwaige Differenzen, bis sie sich auf eine endgültige Entscheidung einigten. Diese Expertenentscheidungen wurden als bestmögliche Referenz behandelt.

Wie gut Maschinen und Menschen abgeschnitten haben

Alle drei KI‑Werkzeuge schnitten bemerkenswert gut ab. In der zweiten Testrunde erkannte Grok 97 von 100 Fällen korrekt, MANUS 96 und ChatGPT 94. Das Duo menschlicher Spezialisten lag leicht vorn und klassifizierte 98 Präparate richtig. ChatGPT fiel besonders dadurch auf, dass es in beiden Runden nahezu identische Antworten gab und damit eine sehr hohe innere Konsistenz zeigte; MANUS und Grok zeigten ebenfalls solide und stabile Leistungen. Beim Vergleich der Systeme untereinander stimmten sie in der überwiegenden Mehrheit der Fälle überein, was darauf hindeutet, dass unterschiedliche KI‑Architekturen bei identischen hochwertigen Bildern zu sehr ähnlichen Einschätzungen kommen können.

Wie eng KI mit dem Expertendenken übereinstimmte

Die korrekte Antwort zu treffen ist nur ein Teil der Frage; wichtig ist auch, ob die Computer den Denkmustern der Menschen folgen. Hier zeigte MANUS die engste Übereinstimmung mit den Entscheidungen der Pathologen, selbst wenn es die rohe Genauigkeit von Grok nicht übertraf. Grok, obwohl insgesamt etwas treffsicherer, traf in einigen der schwierigen Fälle andere Entscheidungen als die Expertinnen und Experten. Die meisten Fehler aller drei Systeme traten bei Präparaten auf, die selbst für geübte Augen visuell verwirrend waren, etwa wenn Gewebeveränderungen überlappten oder zwischen zwei Bedingungen grenzten. Dennoch gab es keine großen Leistungsunterschiede zwischen den Modellen, und alle drei zeigten eine vom Autorenteam als moderat bis substanziell beschriebene Übereinstimmung mit den Menschen.

Was das für die zukünftige Versorgung bedeuten könnte

Die Studie legt nahe, dass heutige multimodale KI‑Systeme bereits als verlässliche Helfer bei der mikroskopischen Diagnostik oraler Erkrankungen dienen könnten. Sie ersetzen keine Pathologen, die nach wie vor die beste Gesamtergebnisgenauigkeit besitzen und unverzichtbares klinisches Urteilsvermögen liefern, aber sie könnten als schnelle Zweitleser fungieren, die Ausbildung neuer Spezialisten unterstützen oder in Regionen mit begrenztem Zugang zu zahnmedizinischer Pathologie expertengleiche Hilfe bieten. Da die Forschung sorgfältig ausgewählte Lehrbuchbilder statt unordentlicher Real‑World‑Proben nutzte, betonen die Autoren, dass weitere Tests an größeren, vielfältigeren klinischen Sammlungen und unter Einbeziehung zusätzlicher Patienteninformationen nötig sind. Bestätigen diese weiteren Prüfungen das frühe Potenzial, könnte KI die Diagnose von Mundkrankheiten für Patientinnen und Patienten weltweit genauer, konsistenter und zugänglicher machen.

Zitation: Alshammari, A.F., Madfa, A.A. & Anazi, B.A. Human versus artificial intelligence in oral pathology diagnosis: a comparative study of ChatGPT, Grok, and MANUS. Sci Rep 16, 11057 (2026). https://doi.org/10.1038/s41598-026-40792-0

Schlüsselwörter: orale Pathologie, digitale Pathologie, künstliche Intelligenz, große Sprachmodelle, histopathologische Diagnose