Clear Sky Science · de

Bewertung von KI-Sprachmodellen bei der Beantwortung schwangerschaftsbezogener Fragen durch Fachärzte für Geburtskunde

Warum das für werdende Eltern wichtig ist

Eine Schwangerschaft ist voller Fragen, und viele Menschen wenden sich inzwischen an Online-Werkzeuge und Chatbots, um schnell Antworten zu bekommen. Diese Studie stellte eine einfache, aber wichtige Frage: Wie gut sind die heute verbreiteten künstlichen Intelligenz-(KI-)Chatbots darin, bei typischen Schwangerschaftsfragen klare, genaue und beruhigende Informationen zu liefern, denen Ärzte vertrauen würden?

Vergleich dreier digitaler „Antwortmaschinen“

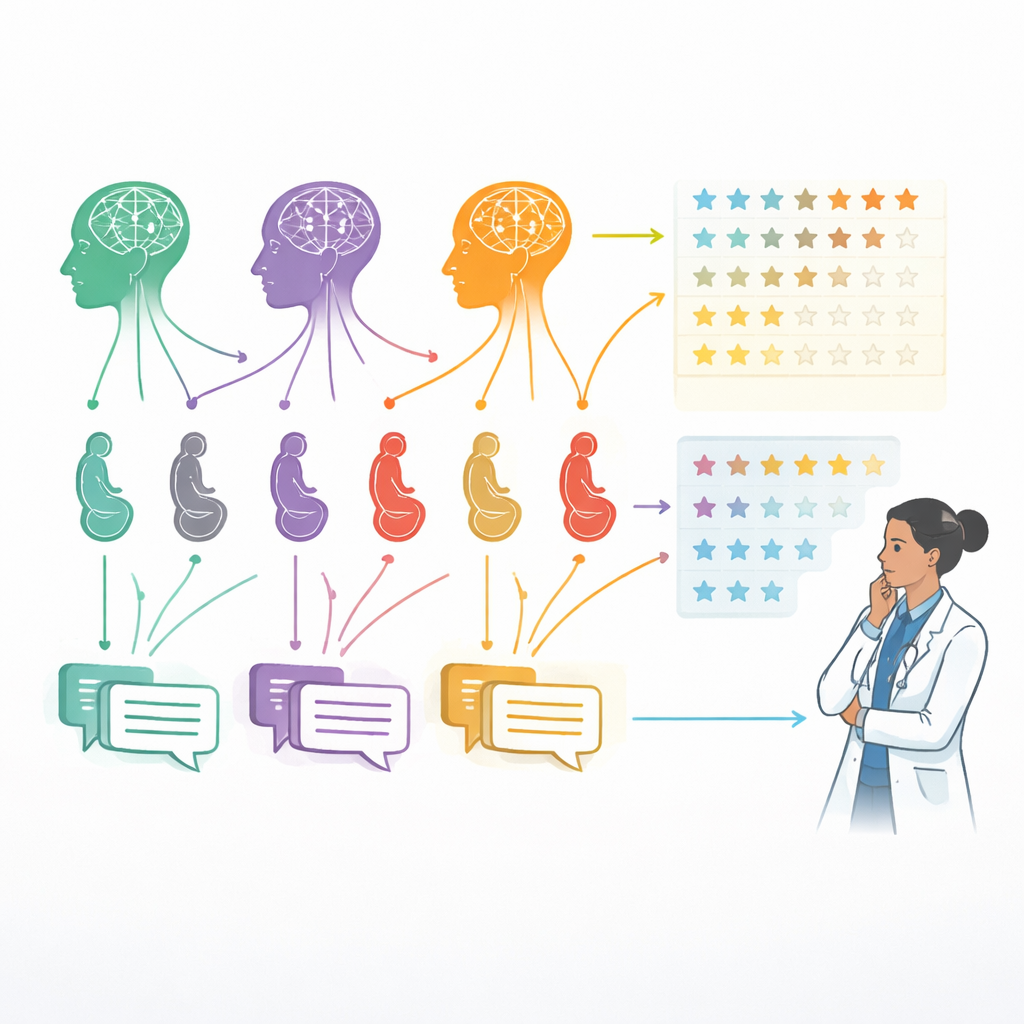

Forscher in der Türkei wollten drei bekannte KI-Sprachmodelle vergleichen – eine frühere Version von ChatGPT (3.5), eine neuere Version (4.0) und Googles Gemini. Sie konzentrierten sich auf zehn alltägliche Fragen, die Schwangere häufig stellen, etwa welche Lebensmittel zu vermeiden sind, ob Bewegung und Sex sicher sind, was frühe Blutungen bedeuten könnten, wie man Kindsbewegungen einschätzt und welche Warnsignale sofortige ärztliche Hilfe erfordern. Jede Frage wurde mit denselben einfachen Anweisungen in alle drei Systeme eingegeben, wobei die Einstellungen so angepasst wurden, dass die Antworten weniger zufällig und eher konsistent als kreativ oder gesprächig ausfielen.

Jedes Modell lieferte pro Frage eine Antwort auf Türkisch, ohne Folgefragen oder Bearbeitung. Die Antworten wurden dann von Hinweisen befreit, die auf das erzeugende System schließen ließen, und in zufälliger Reihenfolge gemischt. Auf diese Weise bewerteten die menschlichen Gutachter – Fachärzte für Gynäkologie und Geburtshilfe – nur den Text selbst, nicht die Markenbezeichnung oder einen erkannten Schreibstil.

Wie die Ärzte die Antworten beurteilten

Fünfundsiebzig Fachärzte für Geburtshilfe, vom Berufsanfänger bis zum sehr erfahrenen Kliniker, bewerteten alle 30 anonymisierten Antworten. Für jede Antwort nutzten sie eine fünfstufige Skala, um vier Eigenschaften zu beurteilen: Genauigkeit (entspricht es dem aktuellen medizinischen Wissen und Leitlinien?), Zuverlässigkeit (ist die Aussage innerlich konsistent und frei von unsicheren Ratschlägen?), Patientenfreundlichkeit (ist Tonfall geeignet und beruhigend für Laien?) und Verständlichkeit (ist die Sprache klar, gut strukturiert und leicht nachzuvollziehen?). Insgesamt lieferten die Expertinnen und Experten 9.000 Einzelbewertungen – ein großer Datensatz, der es den Forschern ermöglichte, aussagekräftige Unterschiede zwischen den drei KI-Werkzeugen zu erkennen.

Das Team nutzte anschließend statistische Verfahren für Rating-Skalen, um die Modelle zu vergleichen. Außerdem prüften sie, wie einheitlich verschiedene Ärzte dieselben Antworten bewerteten, und untersuchten, ob erfahrenere Klinikärzte anders bewerteten als jüngere Kolleginnen und Kollegen. Ziel war nicht, einen funktionalen Chatbot zu bauen, sondern eine sorgfältige Momentaufnahme davon zu machen, wie diese Systeme unter kontrollierten Bedingungen auf realistische Schwangerschaftsfragen antworten.

Welcher Chatbot schnitt am besten ab?

Im Gesamtergebnis ging die neuere ChatGPT-4.0-Version als Sieger hervor. Die Ärzte bewerteten deren Antworten als am genauesten und am patientenfreundlichsten; auch bei der Zuverlässigkeit lag sie vorn. Gemini landete überwiegend in der Mitte: Seine Antworten waren oft klar und gut lesbar, und bei reiner Verständlichkeit war es ähnlich wie ChatGPT-4.0, tendierte jedoch dazu, etwas weniger detailliert und präzise zu sein. ChatGPT-3.5, das ältere Modell, erhielt durchgehend die niedrigsten Bewertungen und lieferte häufig kürzere oder weniger vollständige Erklärungen. Interessanterweise ähnelten sich alle drei Modelle stärker, wenn es um grundlegende Klarheit und Struktur ging, was darauf hindeutet, dass Texte lesbar zu machen offenbar leichter zu erreichen ist als sicherzustellen, dass jedes medizinische Detail korrekt und ausgewogen ist.

Die Bewertungen der Ärzte waren untereinander sehr konsistent, was darauf hinweist, dass die Ergebnisse nicht durch wenige Ausreißermeinungen bestimmt wurden. Es gab einen leichten Trend, dass erfahrenere Kliniker insgesamt etwas höhere Zuverlässigkeitsbewertungen vergaben, aber ihre Einschätzungen unterschieden sich kaum hinsichtlich Freundlichkeit oder Verständlichkeit der Antworten.

Was das für den Einsatz in der Praxis bedeutet

Für Laien lautet die Schlussfolgerung, dass moderne KI-Werkzeuge – insbesondere ChatGPT-4.0 – bereits Schwangerschaftsinformationen liefern können, die viele Fachärzte für Geburtshilfe als relativ genau, sicher und gut lesbar einschätzen. Gleichzeitig macht die Studie eine wichtige Einschränkung deutlich: Selbst das leistungsstärkste System ist kein Arzt. Die Forschenden verglichen die Chatbot-Antworten nicht mit offiziellen Leitlinien als „Goldstandard“, und sie untersuchten nicht, wie Patienten die Ratschläge tatsächlich interpretieren oder darauf reagieren. Da die Untersuchung vollständig auf Türkisch durchgeführt wurde, kann die Leistung in anderen Sprachen und Kulturen abweichen.

Einfach gesagt können diese KI-Chatbots hilfreiche Begleiter beim Informieren über Schwangerschaft sein, besonders wenn ein Klinikbesuch weit entfernt ist oder die Zeit mit einer medizinischen Fachkraft knapp ist. Sie können Gespräche unterstützen, sollten aber nicht die persönliche Beratung durch Gesundheitsfachpersonen ersetzen. Die Autoren betonen, dass professionelle Aufsicht weiterhin essenziell ist, um Fehler zu erkennen, falsche Beruhigung zu vermeiden und sicherzustellen, dass differenzierte oder risikoreiche Fälle die persönliche, vor Ort erforderliche Versorgung erhalten.

Zitation: Keyif, B., Yurtçu, E., Başbuğ, A. et al. Evaluation of AI language models in answering pregnancy-related questions assessed by obstetrics specialists. Sci Rep 16, 9322 (2026). https://doi.org/10.1038/s41598-026-40609-0

Schlüsselwörter: Schwangerschaftsaufklärung, KI-Chatbots, Online-Gesundheitsberatung, Geburtshilfe, Qualität von Patienteninformationen