Clear Sky Science · de

Das Gleichgewicht zwischen Fairness und Leistung bei der Vorhersage des Gliomgrades mit Bias-Minderungs‑Techniken

Warum faire Behandlung von Tumoren wichtig ist

Wenn Ärztinnen und Ärzte künstliche Intelligenz zur Unterstützung bei der Diagnose von Hirntumoren einsetzen, könnte man annehmen, die Maschine sei neutral. Wenn die Daten, mit denen diese Werkzeuge trainiert wurden, jedoch bestehende Ungleichheiten im Gesundheitswesen abbilden, kann die Software einige Patientengruppen stillschweigend ungerechter behandeln. Diese Studie untersucht, wie maschinelle Lernsysteme, die die Schwere von Gliomen—einer häufigen Form von Hirntumoren bei Erwachsenen—vorhersagen, unbeabsichtigt bestimmte Rassen- oder Geschlechtsgruppen bevorzugen können, und testet praktische Wege, diese Vorhersagen gerechter zu machen, ohne zu viel Genauigkeit zu opfern.

Hirntumore und computerbasierte Helfer

Gliome sind Hirntumore, die von langsam wachsenden, besser behandelbaren Formen bis zu sehr aggressiven Krebserkrankungen mit schlechter Überlebensprognose reichen. Die korrekte Einordnung dieser Tumoren ist entscheidend, weil sie Operation, Strahlentherapie und medikamentöse Behandlung steuert. Die Forschenden arbeiteten mit einem öffentlichen Datensatz von 839 Erwachsenen mit entweder niedriggradigem Gliom oder dem aggressiven Glioblastom. Für jede Patientin bzw. jeden Patienten lagen Alter, Geschlecht, Rasse und 20 häufige genetische Marker des Tumors vor. Sie trainierten drei gängige Vorhersagemodelle—logistische Regression, Random Forests und Gradient Boosting—um die beiden Tumorgrade anhand dieser Merkmale zu unterscheiden, und prüften dann sowohl die Gesamtgenauigkeit der Modelle als auch deren Behandlung verschiedener Patientengruppen.

Auf der Suche nach verborgener Ungleichheit

Um Fairness zu untersuchen, konzentrierte sich das Team auf zwei „geschützte“ Merkmale: Rasse (weiß vs. nicht-weiß) und Geschlecht (männlich vs. weiblich). Der Datensatz selbst war verzerrt—über 90 Prozent der Patientinnen und Patienten waren weiß, und es gab merklich mehr Männer als Frauen. Die Autorinnen und Autoren verwendeten Gruppen-Fairness‑Maßzahlen, die vergleichen, wie häufig verschiedene Gruppen eine korrekte „hochgradige“ Vorhersage erhalten und wie oft das Modell Fehler für jede Gruppe macht. Alle drei Modelle waren insgesamt recht genau, wobei die logistische Regression am besten abschnitt. Unter dieser Erfolgsbilanz zeigten die Fairness‑Prüfungen jedoch, dass nicht‑weiße Patientinnen und Patienten im Allgemeinen schlechtere Ergebnisse hatten als weiße, insbesondere bei der korrekten Erkennung der weniger aggressiven Tumore. Im Gegensatz dazu war die Leistung für Männer und Frauen deutlich ausgewogener, mit nur geringen Unterschieden zwischen den Geschlechtern.

Versuche, den Bias zu beheben

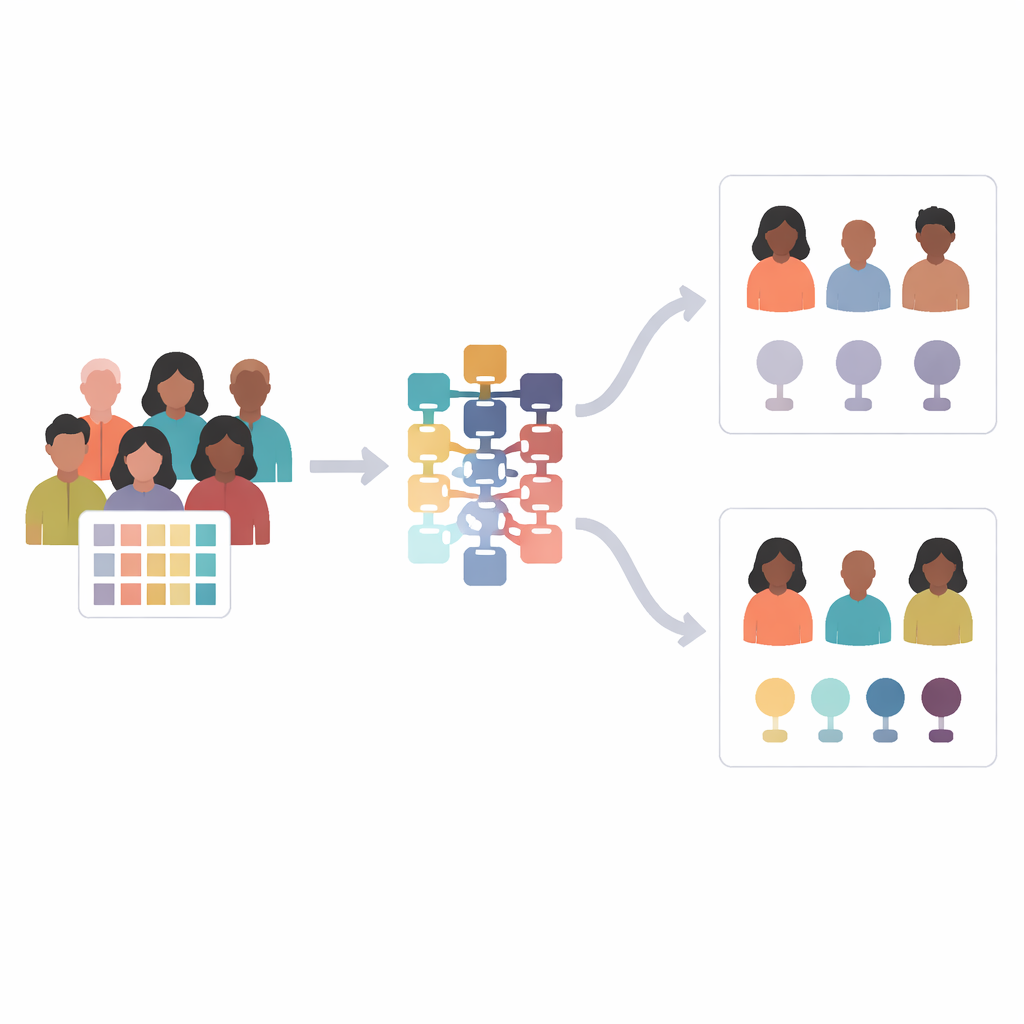

Die Forschenden fragten dann, ob sich die Fairness verbessern ließe, ohne die medizinische Nützlichkeit des Modells ernsthaft zu schwächen. Sie wählten die logistische Regression als Basismodell, da sie von den dreien sowohl am genauesten als auch am fairsten war. Sie testeten zwei gängige Entbiasierungsstrategien. Ein „Pre‑Processing“-Ansatz namens Reweighting gab unterrepräsentierten Patientengruppen während des Trainings ein höheres Gewicht, damit das Modell ihnen mehr Aufmerksamkeit schenkte. Ein „Post‑Processing“-Ansatz namens Equalized Odds beließ das trainierte Modell, passte aber seine Ausgaben so an, dass die Fehlerraten zwischen den Gruppen ähnlicher wurden.

Was sich änderte, als das Modell angepasst wurde

Beim Geschlecht halfen beide Strategien im Allgemeinen: Die Vorhersagequalität für Frauen verbesserte sich, und die Unterschiede zwischen Männern und Frauen schrumpften weitgehend. Bei der Rasse, wo die Verzerrung in den Daten deutlich stärker war, war das Bild komplizierter. Reweighting schlug mitunter fehl, verschlechterte die Leistung für nicht‑weiße Patientinnen und Patienten leicht und erhöhte laut einigen Maßen sogar die Ungerechtigkeit. Im Gegensatz dazu reduzierte die Post‑Processing‑Methode die rassentypischen Unterschiede in den Fehlerraten deutlich, während die Gesamtgenauigkeit des Modells hoch blieb, wenngleich sie die Leistung der Mehrheitsgruppe leicht senkte. Die Autorinnen und Autoren zeigten außerdem, dass Fairness‑Kennzahlen für die deutlich kleinere nicht‑weiße Gruppe statistisch instabil sind—die Änderung der Vorhersage einer einzigen Person kann die Fairness‑Werte merklich verschieben—weshalb diese Ergebnisse vorsichtig interpretiert werden müssen.

Was das für Patientinnen, Patienten und Ärztinnen bedeutet

Die Studie kommt zu dem Schluss, dass es keine kostenlose Lösung gibt: Die Verbesserung von Fairness in medizinischer KI geht oft mit Leistungstauschgeschäften einher, und die beste Maßnahme hängt davon ab, wie stark die Daten verzerrt sind und welches Fairness‑Ziel Priorität hat. In diesem Beispiel mit Hirntumoren war das Nachbearbeiten der Modell‑Ausgaben nach dem Training die praktikabelste Methode, um Behandlungsempfehlungen über Rassen und Geschlechter hinweg gleichmäßiger zu gestalten und zugleich eine starke Vorhersagekraft zu bewahren. Die Arbeit unterstreicht, dass Fairness‑Checks Routine sein sollten, wenn KI im Gesundheitswesen eingesetzt wird—insbesondere bei ernsten Erkrankungen wie Gliomen—und dass es Methoden gibt, diese Werkzeuge gerechter zu machen, die jedoch sorgfältig ausgewählt und interpretiert werden müssen.

Zitation: Sánchez-Marqués, R., García, V. & Sánchez, J.S. Addressing the balance between fairness and performance in glioma grade prediction using bias mitigation techniques. Sci Rep 16, 9785 (2026). https://doi.org/10.1038/s41598-026-40555-x

Schlüsselwörter: Gliom‑Grading, Fairness medizinischer KI, algorithmische Verzerrung, Hirntumore, Bias‑Minderung