Clear Sky Science · de

Erklärbare KI im Bildungswesen: Integration bildungswissenschaftlichen Domain-Wissens in ein Deep-Learning-Modell zur Verbesserung der Vorhersage von Schülerleistungen

Warum klügere Vorhersagen über Schülerinnen und Schüler wichtig sind

Schulen greifen zunehmend auf künstliche Intelligenz zurück, um zu erkennen, welche Lernenden Schwierigkeiten haben könnten und wer zusätzliche Unterstützung benötigt. Wenn diese Systeme jedoch wie verschlossene Black Boxes agieren, können sie merkwürdige Muster hervorheben – etwa zu suggerieren, dass das Liebesleben eines Teenagers wichtiger sei als seine Lernzeit – und Lehrkräfte sowie Eltern im Unklaren lassen, ob den Ergebnissen zu trauen ist. Diese Arbeit zeigt, wie man ein System zur Vorhersage von Schülerleistungen baut, das nicht nur bessere Prognosen für Mathematiknoten liefert, sondern auch in einer Weise "begründet", die mit dem übereinstimmt, was jahrzehntelange Bildungsforschung bereits nahelegt.

Von Rohdaten zu Risiko-Warnungen

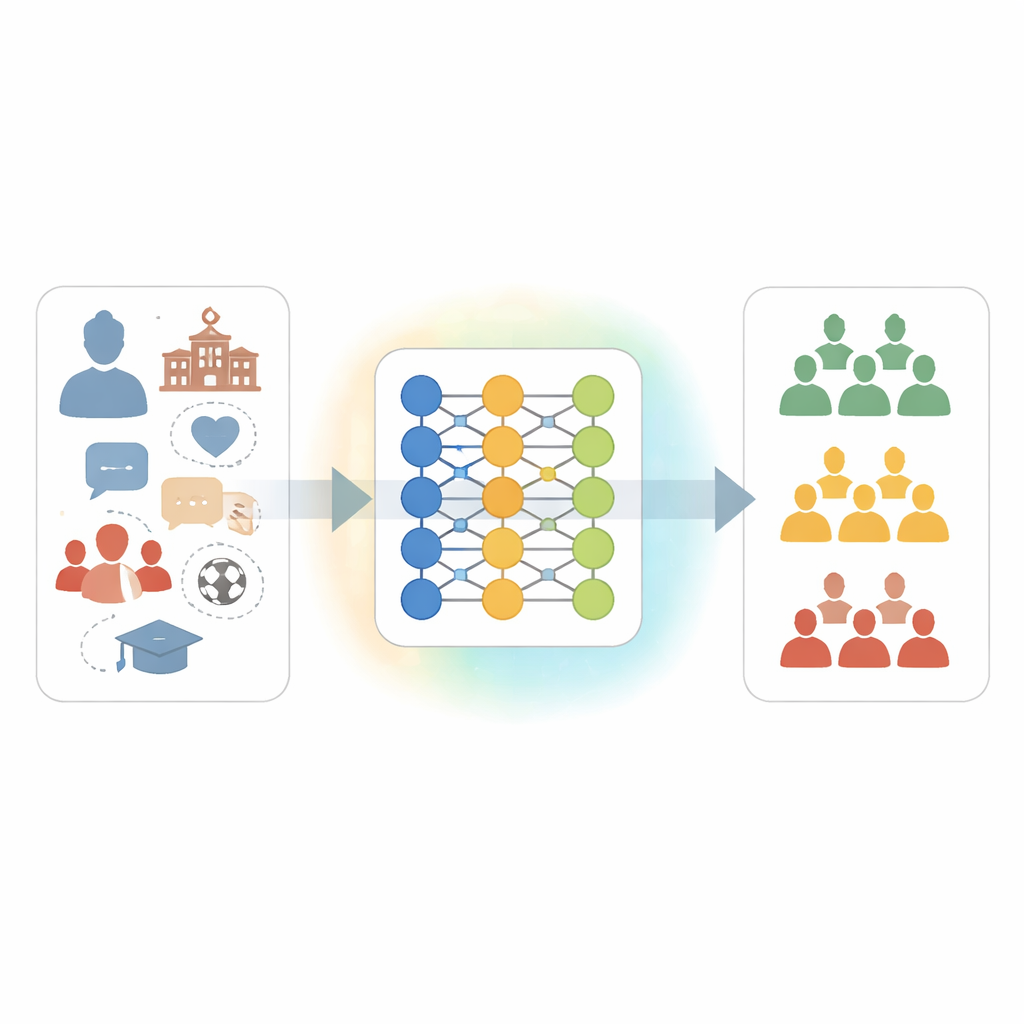

Die Forschenden arbeiteten mit einem bekannten öffentlichen Datensatz von 395 portugiesischen Oberstufenschülern, jeweils beschrieben durch 30 Merkmale. Diese reichten von grundlegenden demografischen Angaben (Alter, Geschlecht, Familiengröße) über schulbezogene Details (Lernzeit, Fehlzeiten, Nachhilfe) bis hin zu Aspekten des Soziallebens und Wohlbefindens (Familienbeziehungen, Freizeit, Ausgehen mit Freundinnen und Freunden). Ziel war es, die Abschlussnote in Mathematik vorherzusagen und die Lernenden dann in drei praxisnahe Kategorien einzuteilen: wahrscheinlich durchfallend, auf Kurs oder hervorragend. Ein Deep-Learning-Modell, ein künstliches neuronales Netzwerk (ANN), wurde darauf trainiert, subtile Muster über all diese Faktoren hinweg zu erkennen.

Wenn die Black Box falsch liegt

Obwohl das ursprüngliche ANN eine respektable Genauigkeit erreichte, zeigte eine genauere Untersuchung etwas Beunruhigendes. Mit einer modernen Erklärungstechnik namens SHAP analysierten die Autorinnen und Autoren, auf welche Merkmale das Modell am stärksten zurückgriff. Einige seiner stärksten Signale standen im Widerspruch zu gut abgesicherten bildungswissenschaftlichen Erkenntnissen. Beispielsweise erschienen die besuchte Schule, der Beziehungsstatus und wie häufig jemand ausging ungewöhnlich einflussreich, während forschungsgestützte Faktoren wie die Bildung der Eltern, der Beruf der Mutter, frühe Betreuung, Familiengröße und wöchentliche Lernzeit überraschend wenig Gewicht erhielten. Diese Diskrepanzen deuteten darauf hin, dass das ANN Eigenheiten dieses speziellen Datensatzes ausnutzte, statt Beziehungen zu lernen, die Pädagoginnen und Pädagogen als bedeutsam oder fair betrachten würden.

Dem Netzwerk beibringen, was Lehrende bereits wissen

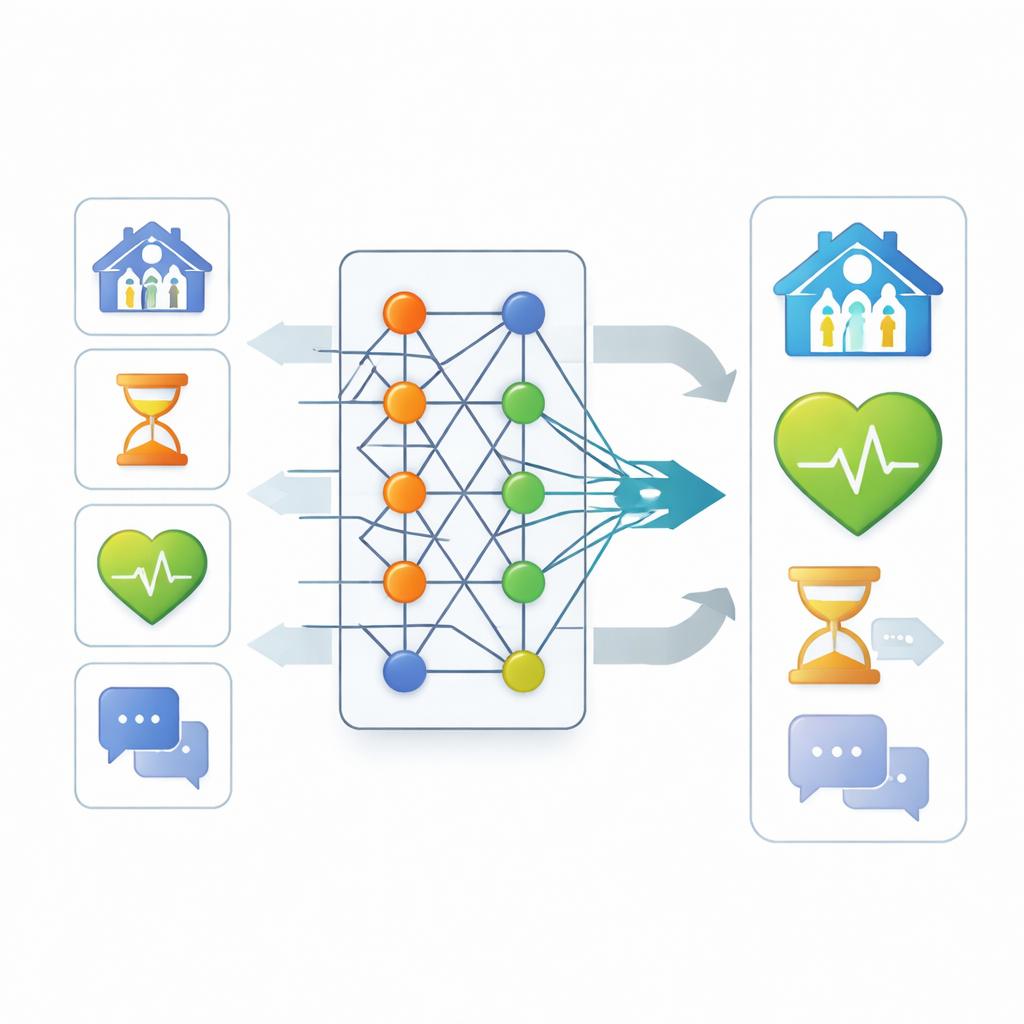

Um das Modell mit bildungswissenschaftlichem Wissen in Einklang zu bringen, schlugen die Autorinnen und Autoren eine neue Trainingsstrategie namens Students’ Performance Prediction Explanation (SPPE)-Algorithmus vor. Zunächst sichteten sie die Bildungsforschung, um Merkmale grob in zwei Gruppen zu sortieren: solche, die konsistent mit Leistungen verknüpft sind (wie Lernzeit, Bildung der Eltern und Ambitionen für höhere Bildung) und solche, die schwächere oder unsicherere Prädiktoren darstellen (etwa Beziehungsstatus oder allgemeine Bewertungen der Familienbeziehungen). Während des Trainings lenkt SPPE das neuronale Netzwerk dazu, seine Abhängigkeit von der ersten Gruppe zu verstärken und die Bedeutung der zweiten zu reduzieren. Dies geschieht, indem überwacht wird, wie viel jedes Merkmal zur Vorhersage beiträgt, und eine sanfte Strafe hinzugefügt wird, wenn das erlernte Wichtigkeitsmuster vom domänenspezifischen Wissen abweicht.

Klarere Erklärungen und schärfere Vorhersagen

Nach den SPPE-Anpassungen veränderte sich die interne Argumentation des Modells in einer Weise, die besser den Erwartungen von Lehrkräften entsprach. Lernzeit, der Hintergrund der Eltern, Familiengröße und frühe Schulbildung rückten auf der Wichtigkeitsskala nach oben, während Schulzugehörigkeit, Ausgehen und Beziehungsstatus weniger dominant wurden. Ebenso wichtig: Diese Neukalibrierung ging nicht zulasten der Genauigkeit – sie verbesserte diese sogar. Bei der Vorhersage, in welches der drei Notenbänder ein Schüler fällt, klassifizierte das verbesserte Netzwerk etwa zwei Drittel der Lernenden korrekt, verglichen mit etwas mehr als einem Drittel beim ursprünglichen Modell. Standardmaße wie Precision, Recall und der kombinierte F1-Score stiegen deutlich an, und statistische Tests bestätigten, dass die Verbesserungen kaum zufällig zu erwarten sind. Die Autorinnen und Autoren zeigten außerdem, dass die gleiche SPPE-Strategie mehrere andere neuronale Netzwerkarchitekturen verbesserte, was dafür spricht, dass der Ansatz robust ist und kein einmaliger Trick.

Was das für Klassenzimmer und KI bedeutet

Für Lehrkräfte und politische Entscheidungsträger bietet die Studie einen Ausweg aus der unangenehmen Wahl zwischen genauen, aber undurchsichtigen Modellen und transparenten, aber schwächeren. Indem menschliche Expertise direkt in den Lernprozess integriert wird, erzeugt SPPE Vorhersagen, die sowohl verlässlicher als auch leichter zu begründen sind: Lernzeit und langfristige Bildungsziele zählen mehr als die Frage, welche Schule eine Schülerin oder ein Schüler zufällig besucht. Obwohl die Arbeit sich auf einen Mathematikdatensatz aus Portugal konzentriert, lautet die übergeordnete Botschaft, dass erklärbare, wissensgeleitete KI bessere und gerechtere Entscheidungen zur Unterstützung von Lernenden ermöglichen kann – vorausgesetzt, der lokale Kontext und fachliche Einschätzung werden von Anfang an mit einbezogen.

Zitation: Qiang, M., Liu, Z. & Zhang, R. Explainable AI in education: integrating educational domain knowledge into the deep learning model for improved student performance prediction. Sci Rep 16, 9515 (2026). https://doi.org/10.1038/s41598-026-40538-y

Schlüsselwörter: Vorhersage von Schülerleistungen, erklärbare KI, Educational Data Mining, Neuronale Netze im Bildungswesen, Integration von Fachwissen