Clear Sky Science · de

Quellenzuweisung von Kameras mittels regelbasierter, erklärbarer Faltungs-Neuronaler Netzwerke

Warum Ihre Fotos mehr verraten können, als Sie denken

Jedes Foto, das Sie aufnehmen, enthält versteckte Hinweise auf die Kamera, die es erstellt hat. Für digitale Ermittler können diese Hinweise helfen zu bestätigen, ob ein Bild echt ist, welches Gerät es erstellt hat, oder Bilder über verschiedene Tatorte hinweg zu verknüpfen. Heute können leistungsfähige Werkzeuge der künstlichen Intelligenz (KI) diese Muster besser erkennen als Menschen – doch sie arbeiten oft als rätselhafte "Black Boxes". Dieser Artikel stellt eine Methode vor, diese Box zu öffnen: ein regelbasiertes Verfahren, das in einer für menschliche Gutachter verständlichen und vertrauenswürdigen Form erklärt, wie ein Deep-Learning-Modell entscheidet, welche Kamera ein Bild aufgenommen hat.

Die Herausforderung, smarten forensischen Werkzeugen zu vertrauen

Die moderne digitale Forensik muss riesige Datenmengen sichten – von Smartphones, Cloud-Backups und sozialen Medien – weit mehr, als menschliche Analysten manuell überprüfen können. Deep-Learning-Systeme können Bilder schnell markieren oder diejenigen vorschlagen, die wichtig sind, doch ihre inneren Abläufe sind notorisch undurchsichtig. In sensiblen Kontexten wie Gerichtsverfahren reicht das bloße "das neuronale Netz meint so" nicht aus. Bestehende Erklärungswerkzeuge heben meist Bildregionen hervor, die das Modell als wichtig erachtet, was bei Aufgaben wie Gesichtserkennung oder Objektidentifikation hilfreich ist. Bei der Zuordnung zur Kameraquelle jedoch ist das entscheidende Signal kein sichtbares Merkmal, sondern ein schwacher Sensor-Fingerabdruck – subtile Rauschmuster, die Menschen nicht sehen können. Daher zeigen heutige visuelle Erklärungen nicht klar, warum ein Modell denkt, dass ein Bild von einer bestimmten Kamera stammt, und helfen Gutachtern nicht dabei, Fehler des Modells zu erkennen.

Eine neue Art, dem Denkprozess eines neuronalen Netzes zuzuschauen

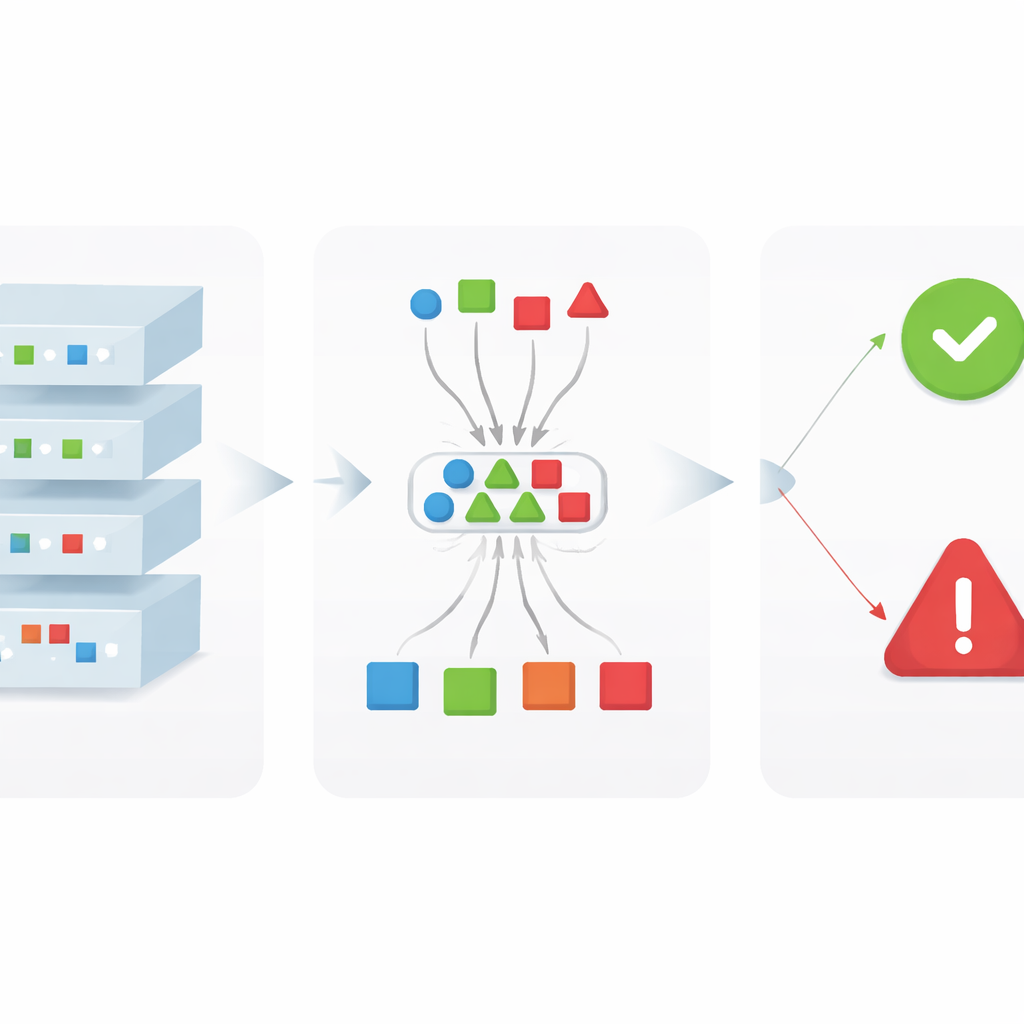

Die Autoren stellen xDFAI vor, ein speziell für die digitale Forensik entwickeltes Framework, das erklärt, wie ein Faltungsneuronales Netzwerk (CNN) zu seinen Entscheidungen gelangt, ohne das ursprüngliche Modell zu verändern. Anstatt das Netzwerk als eine einzelne undurchsichtige Black Box zu behandeln, blickt xDFAI schichtweise hinein. Für jede Schicht und jede Kameraklasse identifiziert es eine Menge wiederkehrender interner Muster, sogenannte "Traces", die konsistent aktiviert werden, wenn das Modell glaubt, ein Bild gehöre zu dieser Kamera. Diese Traces werden aus einem trainierten Modell mithilfe vorhandener Attributionsmethoden extrahiert und dann gefiltert, sodass nur die Muster erhalten bleiben, die zuverlässig in vielen Trainingsbildern auftreten. Zusammen bilden diese Traces eine strukturierte Karte davon, wie sich Hinweise auf die Kamerazugehörigkeit entwickeln, während das Bild durch das Netzwerk fließt.

Die Schichten abstimmen lassen und Stimmen in Regeln übersetzen

Sind die Traces bekannt, verwendet xDFAI sie, um neue, unbekannte Bilder zu untersuchen. Für ein gegebenes Testfoto misst das Framework, wie ähnlich dessen interne Aktivierungen den gespeicherten Traces für jede Kamera in jeder Schicht sind. Jede Schicht gibt effektiv Stimmen für die Kameramodelle ab, deren Traces ihr am nächsten kommen. Eine schichtübergreifende "Mehrheitsabstimmung" fasst dann zusammen, wie stark das Netzwerk insgesamt jede Kandidatenkamera unterstützt. Entscheidender Punkt: Die Autoren ersetzen damit nicht die Vorhersage des Modells; sie nutzen die Abstimmung als Kontrolle. Einfache logische Regeln vergleichen die Mehrheitsabstimmung mit der ursprünglichen Vorhersage: Wird die prognostizierte Kamera auch stark von vielen Schichten unterstützt, wird die Entscheidung bestätigt; sind die Stimmen verstreut oder sprechen sie für eine andere Kamera, wird das Verhalten als abnormal markiert und dem Gutachter als potenzieller Modellfehler angezeigt.

Das Framework einem Praxistest unterziehen

Um xDFAI zu demonstrieren, wenden die Autoren es auf ein siebenlagiges CNN an, das darauf trainiert wurde, zu erkennen, welches von 27 Kameramodellen ein Bild aufgenommen hat, unter Verwendung eines weithin bekannten forensischen Datensatzes. Das Basismodell des CNN liefert bereits sehr gute Ergebnisse und klassifiziert etwa 97% der Testbilder korrekt. Wenn die Regeln von xDFAI zusätzlich angewendet werden, markiert das System automatisch 27 der 37 falschen Vorhersagen als verdächtig. Diese markierten Fälle zählen dann nicht mehr als vertrauenswürdige Identifikationen, wodurch die Präzision – der Anteil der akzeptierten Entscheidungen, die tatsächlich korrekt sind – von 97,33% auf 99,2% steigt, bei nur geringer Verringerung der Gesamtgenauigkeit. Für forensische Arbeiten, bei denen eine einzelne falsche Zuschreibung schwerwiegende Folgen haben kann, ist dieser Kompromiss sehr wünschenswert: weniger Fehlalarme unter den Schlussfolgerungen, denen Analysten vertrauen.

Was das für reale Ermittlungen bedeutet

Diese Arbeit zeigt, dass es möglich ist, die volle Leistungsfähigkeit moderner Deep-Learning-Modelle beizubehalten und zugleich menschenfreundliche Erklärungen hinzuzufügen, die forensische Integritätsanforderungen respektieren – kein erneutes Training, keine Manipulation des ursprünglichen Modells und keine ausschließliche Abhängigkeit von vagen Heatmaps. Indem stabile interne Traces offengelegt, durch ein transparentes Abstimmungsverfahren aggregiert und das Ergebnis als einfache Regeln ausgedrückt wird, bietet xDFAI Gutachtern eine Möglichkeit, KI-generierte Kamerazuweisungen zu bestätigen oder zu hinterfragen. Obwohl die Studie auf die Identifikation der Kamerquelle fokussiert ist, könnten dieselben Ideen auf andere forensische Zuordnungsaufgaben ausgeweitet werden. Langfristig könnten Ansätze wie dieser helfen, die Lücke zwischen hochpräzisen KI-Systemen und dem Maß an Transparenz und Zuverlässigkeit zu schließen, das in Gerichten und der Ermittlungspraxis verlangt wird.

Zitation: Nayerifard, T., Amintoosi, H. & Ghaemi Bafghi, A. Source camera attribution using a rule-based explainable convolutional neural network. Sci Rep 16, 9137 (2026). https://doi.org/10.1038/s41598-026-40387-9

Schlüsselwörter: digitale Forensik, erklärbare KI, Kameraidentifikation, faltungsneuronale Netze, Bildforensik