Clear Sky Science · de

MedicalPatchNet: eine patch-basierte, selbst-erklärende KI-Architektur zur Klassifikation von Thorax-Röntgenaufnahmen

Warum klügere Röntgenaufnahmen wichtig sind

Thorax-Röntgenaufnahmen gehören zu den weltweit häufigsten medizinischen Untersuchungen, und künstliche Intelligenz (KI)-Systeme unterstützen Ärzte zunehmend bei deren Interpretation. Viele der derzeit leistungsfähigsten KI-Modelle verhalten sich jedoch wie „Black Boxes“: Sie können zwar genau sein, aber selbst Expertinnen und Experten können nicht leicht nachvollziehen, warum ein bestimmter Befund gestellt wurde. Diese fehlende Transparenz erschwert es Klinikerinnen und Klinikern, der KI zu vertrauen und sie sicher in der Versorgung von Patientinnen und Patienten einzusetzen. Die Studie stellt MedicalPatchNet vor, einen neuen KI-Ansatz, der starke Genauigkeit beibehalten will und zugleich seine Entscheidungsfindung sichtbar und verständlich macht – selbst für Personen ohne Hintergrund in Machine Learning.

Bilder in kleine, aussagekräftige Regionen zerlegen

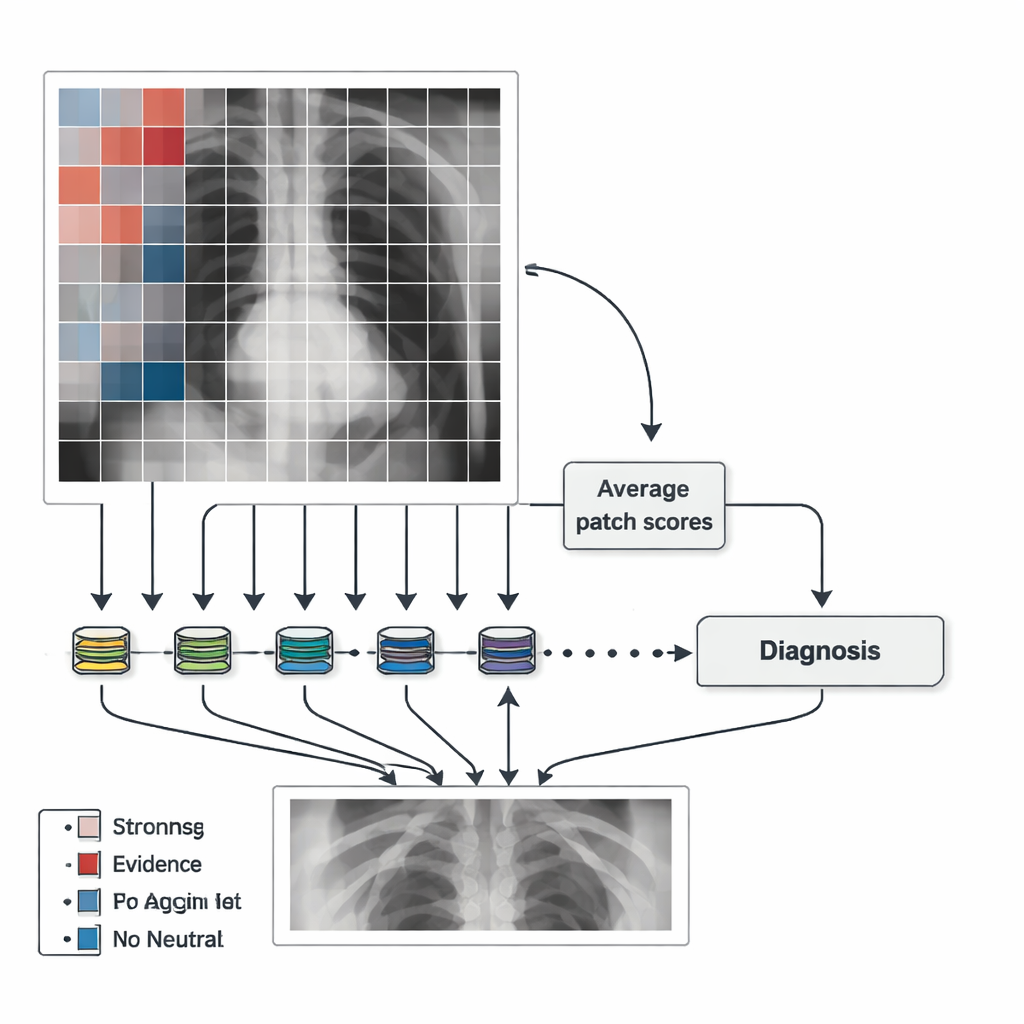

Anstatt eine Thorax-Röntgenaufnahme als ein großes, undurchsichtiges Ganzes zu analysieren, arbeitet MedicalPatchNet, indem es das Bild in viele kleine, nicht überlappende Quadrate oder „Patches“ aufteilt. Jeder Patch wird durch dasselbe neuronale Netz geschickt, das für mehrere mögliche Befunde einen Wert ausgibt, etwa für Lungeninfiltrat, Pneumonie oder Pleuraerguss (Flüssigkeit um die Lunge). Diese Patch-Level-Werte werden dann einfach gemittelt, um eine Gesamtentscheidung für das gesamte Bild zu erhalten. Da die Endantwort nur die Summe vieler lokaler Stimmen ist, lässt sich leicht zeigen, wie stark jeder Patch zur Diagnose beigetragen hat. Entscheidend ist, dass es keine versteckten Aufmerksamkeitsmechanismen oder komplexe interne Gewichtungsschemata gibt – der Einfluss jeder Region ist explizit definiert und nicht auf undurchsichtige Weise gelernt.

Modellentscheidungen in klare visuelle Karten übersetzen

Die Autoren verwenden diese Patch-Werte, um „Salienzkarten“ zu erstellen, die hervorheben, wo die KI Hinweise für oder gegen eine Erkrankung gefunden hat. Patches, die einen Befund stark unterstützen, werden in warmen Farben (z. B. Rot) gezeigt, solche, die dagegen sprechen, in kühlen Farben (z. B. Blau) und neutrale Bereiche in Grau. So ist leicht zu erkennen, ob sich das Modell auf die Lungen, das Herz oder – besorgniserregend – auf irrelevante Merkmale wie Randartefakte oder Textetiketten konzentriert. Um die Karten glatter und weniger blockartig wirken zu lassen, erzeugt das Team zusätzlich Karten, nachdem das Bild in vielen kleinen Schritten leicht verschoben wurde, und bildet dann den Durchschnitt der Ergebnisse. Das erhöht zwar den Rechenaufwand, ergibt aber Heatmaps, die besser zur zugrunde liegenden Anatomie passen und gleichzeitig die klare Verbindung zwischen jeder Region und ihrem Beitrag zur Endentscheidung bewahren.

Black-Box-Leistung erreichen und gleichzeitig Vertrauen verbessern

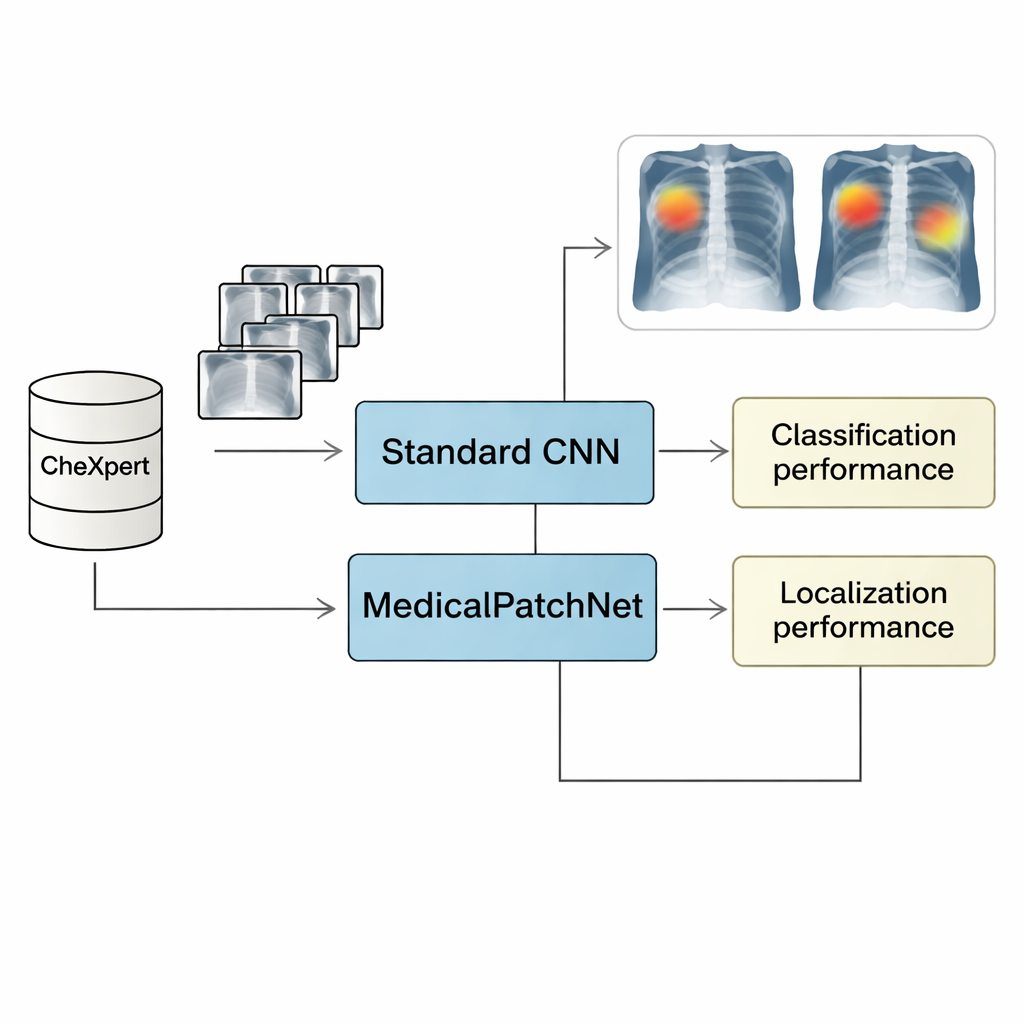

Um MedicalPatchNet zu testen, trainierten die Forschenden das System mit CheXpert, einem großen öffentlichen Datensatz mit mehr als 220.000 Thorax-Röntgenaufnahmen, die für 14 häufige Befunde gelabelt sind. Sie verglichen seine Leistung mit einem starken, konventionellen Bild-auf-Ebene-Modell, das dieselbe Backbone-Architektur (EfficientNetV2-S) nutzte. Im Durchschnitt erzielten beide Modelle nahezu identische diagnostische Leistungen, gemessen an der Fläche unter der Receiver-Operating-Characteristic-Kurve (AUROC), Sensitivität, Spezifität und Genauigkeit. Anders gesagt: Die Einschränkung, das Modell Patch für Patch rechnen zu lassen und dann zu mitteln, schwächte seine Fähigkeit, Erkrankungen zu erkennen, nicht in nennenswertem Maße. Das deutet darauf hin, dass für viele Aufgaben bei Thorax-Röntgenaufnahmen lokale Bildinformationen ausreichen und das Modell nicht auf komplexe, vollständig globale Muster angewiesen sein muss, um gut zu funktionieren.

Sehen, wohin das Modell „blickt“, um eine Erkrankung zu finden

Über die Gesamtgenauigkeit hinaus ist die entscheidende Frage, ob MedicalPatchNet sich zuverlässiger erklärt als verbreitete „nachträgliche“ Werkzeuge wie Grad-CAM und dessen Varianten. Dazu nutzte das Team einen zweiten Datensatz, CheXlocalize, der von Radiologinnen und Radiologen gezeichnete Umrisse tatsächlicher Krankheitsregionen liefert. Gemessen wurde, wie oft der am stärksten hervorgehobene Punkt einer Methode innerhalb des tatsächlichen abnormalen Bereichs lag (die „Trefferquote“) und wie gut die hervorgehobene Region mit Expertenanmerkungen überlappt (mittlere Intersection over Union, mIoU). Die patch-basierten Karten von MedicalPatchNet erreichten höhere Trefferquoten als Grad-CAM-ähnliche Erklärungen bei neun von zehn Befunden und die beste Gesamtüberlappung, wenn man sowohl korrekte als auch fehlerhafte Vorhersagen zählt. Diese breitere Bewertung ist wichtig, weil sie Erklärungen bestraft, die nur dann gut aussehen, wenn das Modell richtig liegt, aber irreführendes Verhalten nicht aufdecken, wenn das Modell falsch liegt.

Von undurchsichtigen Vermutungen zu transparenten Partnern

Für Nicht-Fachleute ist das wichtigste Ergebnis, dass MedicalPatchNet zeigt, dass es möglich ist, eine nahezu state-of-the-art Leistung bei Thorax-Röntgen-Diagnosen beizubehalten und gleichzeitig die Entscheidungsfindung der KI erheblich transparenter zu machen. Anstatt mysteriöser Heatmaps, die vielleicht oder vielleicht nicht widerspiegeln, was die Entscheidung wirklich trieb, verknüpft dieser Ansatz jede Hervorhebung direkt mit einer lokalen Stimme in der Berechnung des Modells. Klinikerinnen und Kliniker können nicht nur sehen, ob die KI eine Erkrankung vermutet, sondern auch genau, wo im Bild sie unterstützende oder widersprechende Hinweise gefunden hat. Obwohl die Methode weiterhin Grenzen hat – etwa bei Befunden, die davon abhängen, dass weit auseinanderliegende Regionen des Bildes zusammen betrachtet werden – bietet sie einen praktikablen Weg zu KI-Werkzeugen, die weniger wie Black Boxes und mehr wie klare, verantwortliche Partner in der medizinischen Bildgebung handeln.

Zitation: Wienholt, P., Kuhl, C., Kather, J.N. et al. MedicalPatchNet: a patch-based self-explainable AI architecture for chest X-ray classification. Sci Rep 16, 7467 (2026). https://doi.org/10.1038/s41598-026-40358-0

Schlüsselwörter: KI für Thorax-Röntgen, erklärbares Deep Learning, MedicalPatchNet, Salienzkarten für medizinische Bilder, radiologische Entscheidungsunterstützung