Clear Sky Science · de

Bildkolorierung mittels Deep-Transfer-Learning mit VGG19 und CLAHE

Alte Fotos zum Leben erwecken

Viele von uns haben Kisten mit schwarz-weißen Familienfotos oder schätzen klassische Filme und historische Dokumentationen. Sich vorzustellen, wie diese Szenen im echten Leben aussahen — blauer Himmel, grüne Felder, warme Hauttöne — kann die Vergangenheit näher und greifbarer machen. Dieses Paper untersucht eine neue computergestützte Methode, die Graustufenbilder automatisch mit realistischen Farben und ansprechendem Kontrast versieht. So lassen sich alte Bilder leichter restaurieren, Schwarz-Weiß-Filme auffrischen und selbst medizinische Aufnahmen verbessern, ohne dass ein Experte jeden Farbton per Hand malen muss.

Von Handkolorierung zu intelligenten Maschinen

Das Kolorieren von Bildern ist schwieriger als es scheint, weil ein einzelner Grauwert vielen möglichen Farben entsprechen kann: Ein mittleres Grau könnte ein roter Ziegel, ein grünes Blatt oder ein blaues Hemd sein. Frühere Werkzeuge setzten stark auf menschliche Hinweise. Künstler konnten schnelle Farb‑„Kritzeleien“ auf Teile eines Bildes zeichnen, und Software verbreitete diese Hinweise auf ähnliche Regionen. Andere Systeme entnahmen Farben einem Referenzfoto mit ähnlichem Inhalt. Diese Methoden konnten zwar überzeugend wirken, versagten aber, wenn die Hinweise spärlich waren, das Referenzbild nicht gut passte oder die Szene komplex war. Mit dem Aufkommen des Deep Learning lernten neue Programme, Farben direkt aus großen Sammlungen von Beispielbildern „zu erraten“, wodurch manueller Aufwand reduziert wurde, jedoch zu Lasten enormer Trainingszeiten und Rechenressourcen.

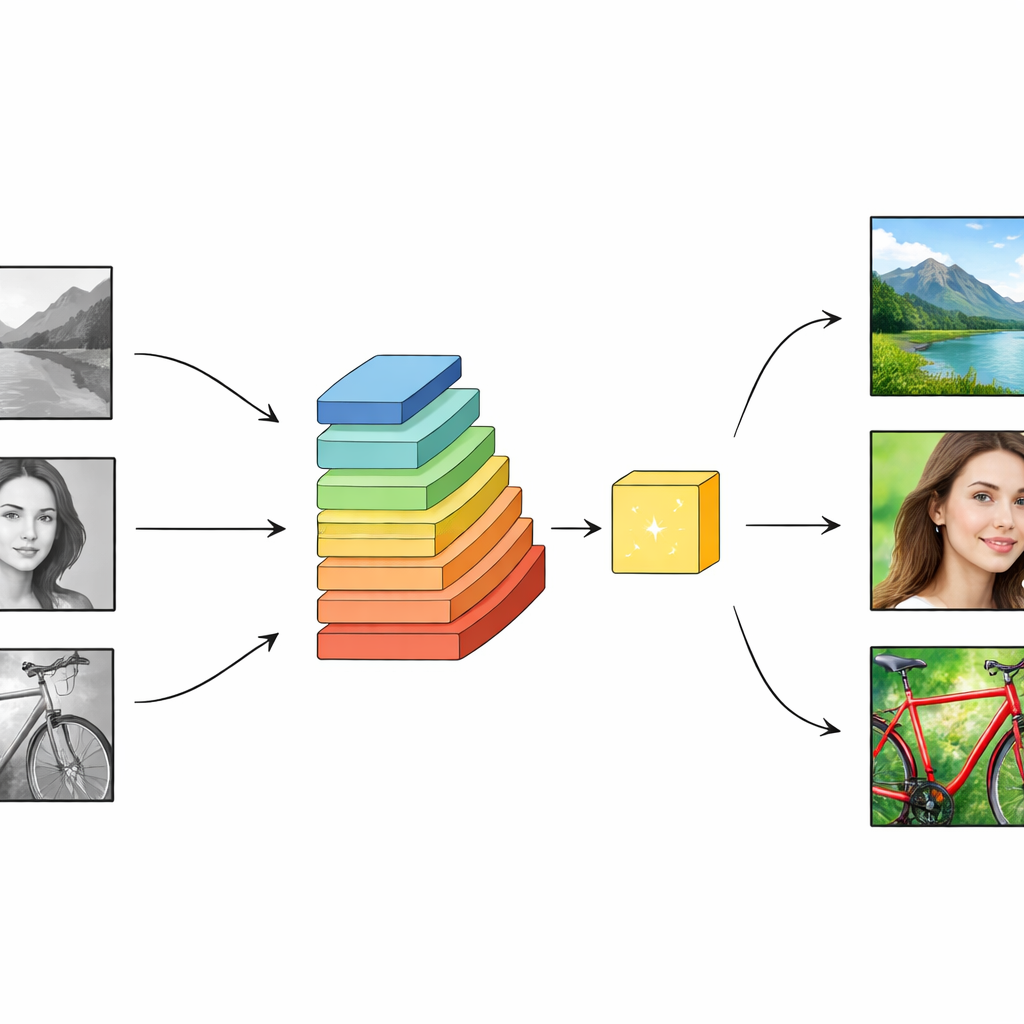

Einem Netzwerk beibringen, wie die Welt aussieht

Die Autoren bauen auf diesem Fortschritt mit einer Strategie namens Transfer Learning auf. Statt ein neues System von Grund auf zu trainieren, nutzen sie ein leistungsfähiges Vision-Netzwerk namens VGG19, das bereits an Millionen farbiger Bilder vortrainiert ist. Dieses Netzwerk hat viele Schichten, die schrittweise von einfachen Mustern wie Kanten und Texturen zu ganzen Objekten und Szenen übergehen: Gesichter, Bäume, Gebäude, Himmel. Das Kolorisierungssystem stellt eine Graustufenvariante eines Bildes in VGG19 ein und entnimmt Merkmale aus mehreren Schichten gleichzeitig, wodurch für jeden Pixel ein reichhaltiger „Stack“ an Informationen entsteht. Das hilft dem Modell, sowohl feine Details — etwa Haarsträhnen oder Blattkanten — als auch den größeren Kontext zu verstehen, etwa ob es sich um einen Strand, eine Stadtstraße oder einen Wald handelt. Mit diesem Kontext ist das Netzwerk besser in der Lage, glaubwürdige Farben zu wählen, nicht nur mathematisch mögliche.

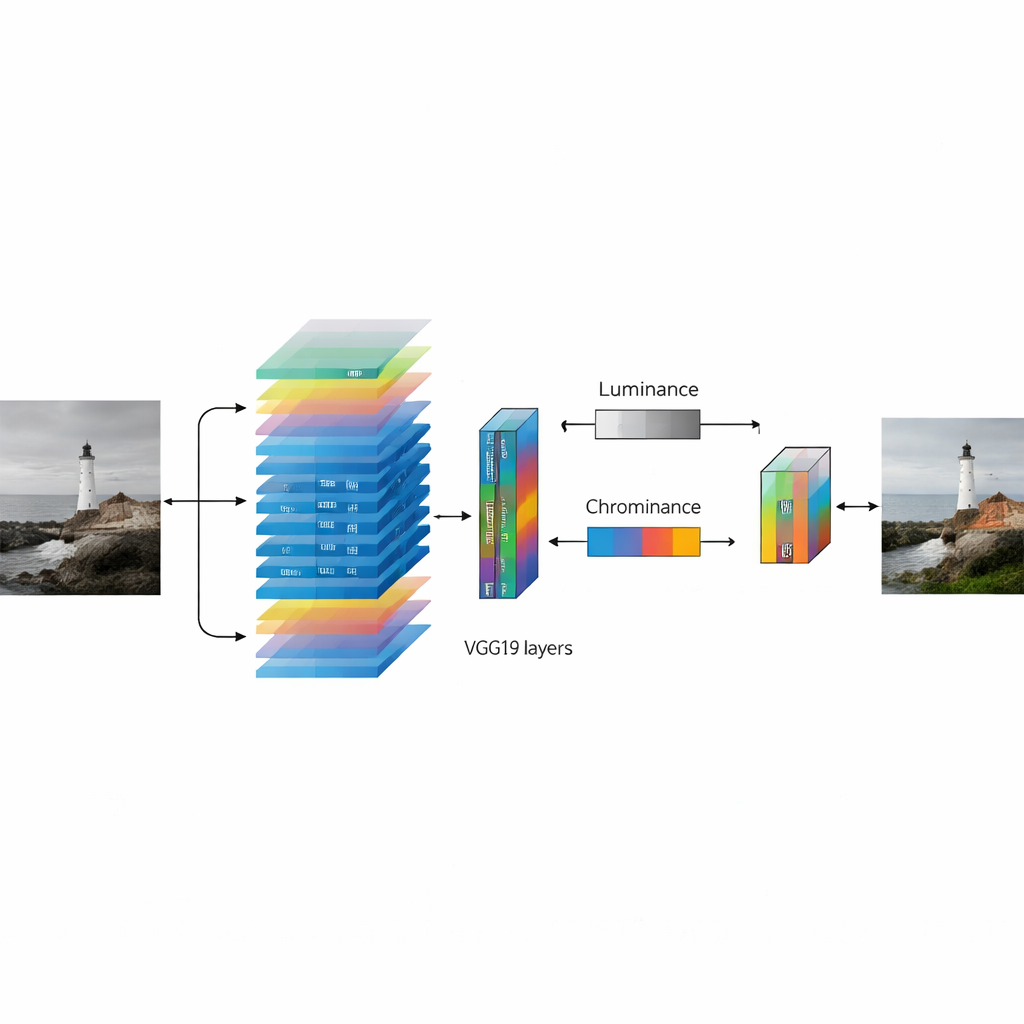

Licht und Schatten in Farbe und Kontrast verwandeln

Um Farbentscheidungen stabiler zu machen, stellt die Methode Bilder in einem Farbraum dar, der Helligkeit vom Farbinhalt trennt. Die Graustufen-Eingabe dient als Helligkeitskanal, während die Aufgabe des Netzwerks darin besteht, die beiden verbleibenden Kanäle vorherzusagen, die subtile Verschiebungen zwischen Rot und Grün sowie zwischen Blau und Gelb kodieren. Durch das Fixieren der Helligkeit bewahrt das System die ursprüngliche Schattierung und Struktur des Bildes. Nachdem das Netzwerk seine beste Schätzung der fehlenden Farbinformationen erzeugt hat, wird ein letzter Verbesserungsschritt angewandt. Hier nutzen die Autoren eine Technik namens adaptive Histogrammgleichung (CLAHE), die lokal den Bereich zwischen dunklen und hellen Bereichen streckt. Das macht Texturen klarer, Kanten schärfer und Farben lebendiger, ohne einfach helle Regionen „auszublenden“ oder Details in Schatten zu verlieren.

Die Methode auf die Probe stellen

Um zu prüfen, wie gut ihr Ansatz in der Praxis funktioniert, trainierten und evaluieren die Forschenden ihn auf mehreren bekannten Bildsammlungen, die Objekte, Szenen, Menschen und Alltagsumgebungen enthalten. Sie verglichen ihre Ergebnisse mit einer Reihe konkurrierender Methoden, darunter benutzergeführte Systeme, generative Modelle, die realistische Bilder zu erfinden versuchen, und neuere transformerbasierte Modelle. Anhand standardisierter Qualitätsmaße für Bilder lieferte ihre Methode durchgängig schärfere, treuere Farben und klarere Strukturen, mit besonders guter Leistung bei einer anspruchsvollen Sammlung von Szenenfotografien. Visuelle Vergleiche zeigen, dass die kolorierten Ausgaben häufig näher an den originalen Farbfotos liegen, mit reichhaltiger, aber kontrollierter Sättigung und besser ausbalanciertem Kontrast. Sie weisen auch auf Schwächen hin: Sehr dunkle oder überbelichtete Bilder sowie Szenen mit ungewöhnlichen Texturen und seltenen Farben können weiterhin zu seltsamen Farbtönen oder ungleichmäßiger Beleuchtung führen.

Was das für Alltagbilder bedeutet

Einfach ausgedrückt zeigt diese Studie, dass ein Kolorisierungssystem, dem eine starke Vorbildung über die visuelle Welt vermittelt wird — und dessen Ergebnis anschließend sorgfältig verstärkt wird — Bilder erzeugen kann, die für das menschliche Auge natürlicher wirken. Indem die Autoren auf einem großen, vortrainierten Netzwerk aufbauen und einen intelligenten Kontrastverstärkungs-Schritt ergänzen, liefern sie ein praktisches Werkzeug, das historischen Fotografien Leben einhauchen, Schwarz-Weiß-Filme bereichern und bestimmte medizinische Bildarten besser interpretierbar machen kann. Zwar ist es nicht perfekt und kann bei extremen Lichtverhältnissen oder sehr ungewöhnlichen Szenen scheitern, doch rückt dieser Ansatz die automatisierte Kolorierung näher an eine Lösung, auf die auch Laien sich verlassen können, und macht realistische Farbe für viele alltägliche Anwendungen erreichbar.

Zitation: Ghosh, N., Mandal, G. Deep transfer learning based image colorization using VGG19 and CLAHE. Sci Rep 16, 9528 (2026). https://doi.org/10.1038/s41598-026-40292-1

Schlüsselwörter: Bildkolorierung, Deep Learning, Transfer Learning, Foto-Restaurierung, Kontrastverstärkung