Clear Sky Science · de

Ein integriertes Rahmenkonzept zur proaktiven Deepfake‑Abwehr durch auf Aufmerksamkeit basierendes Watermarking und blockchain‑gestützte Echtheitsprüfung

Warum gefälschte Videos ein Problem für alle sind

Videos, die echt wirken und klingen, lassen sich heute mit handelsüblicher Software fälschen und verwischen online die Grenze zwischen Wahrheit und Fiktion. Diese sogenannten Deepfakes werden bereits für Betrug, Belästigung und politische Manipulationen eingesetzt. Statt Fälschungen erst nach ihrer Verbreitung zu erkennen, stellt diese Studie eine andere Frage: Was wäre, wenn wir echte Videos stillschweigend in dem Moment schützen könnten, in dem sie entstehen, sodass spätere Manipulationen offensichtlich werden?

Vom Jagd auf Fälschungen zum Schutz der Originale

Der Großteil der aktuellen Forschung versucht, Deepfakes nachträglich zu entdecken, indem Algorithmen auf winzige Unregelmäßigkeiten achten, die generative Modelle hinterlassen. Doch mit der Verbesserung dieser Modelle wird dieses Katz‑und‑Maus‑Spiel zunehmend schwerer zu gewinnen. Die Autorinnen und Autoren plädieren für einen proaktiven Ansatz: authentisches Material bereits bei der Aufnahme schützen, damit Zuschauer und Plattformen später prüfen können, ob sie das unveränderte Original sehen. Ihr Rahmenkonzept kombiniert drei Ebenen: einen intelligenten Videoanalysator, der entscheidet, wo Schutz besonders wichtig ist, ein unsichtbares digitales Zeichen, das in jeden Frame eingewebt wird, und einen Blockchain‑Eintrag, der die Identität der Datei als Ganzes festschreibt.

Dem System beibringen, was im Video wirklich zählt

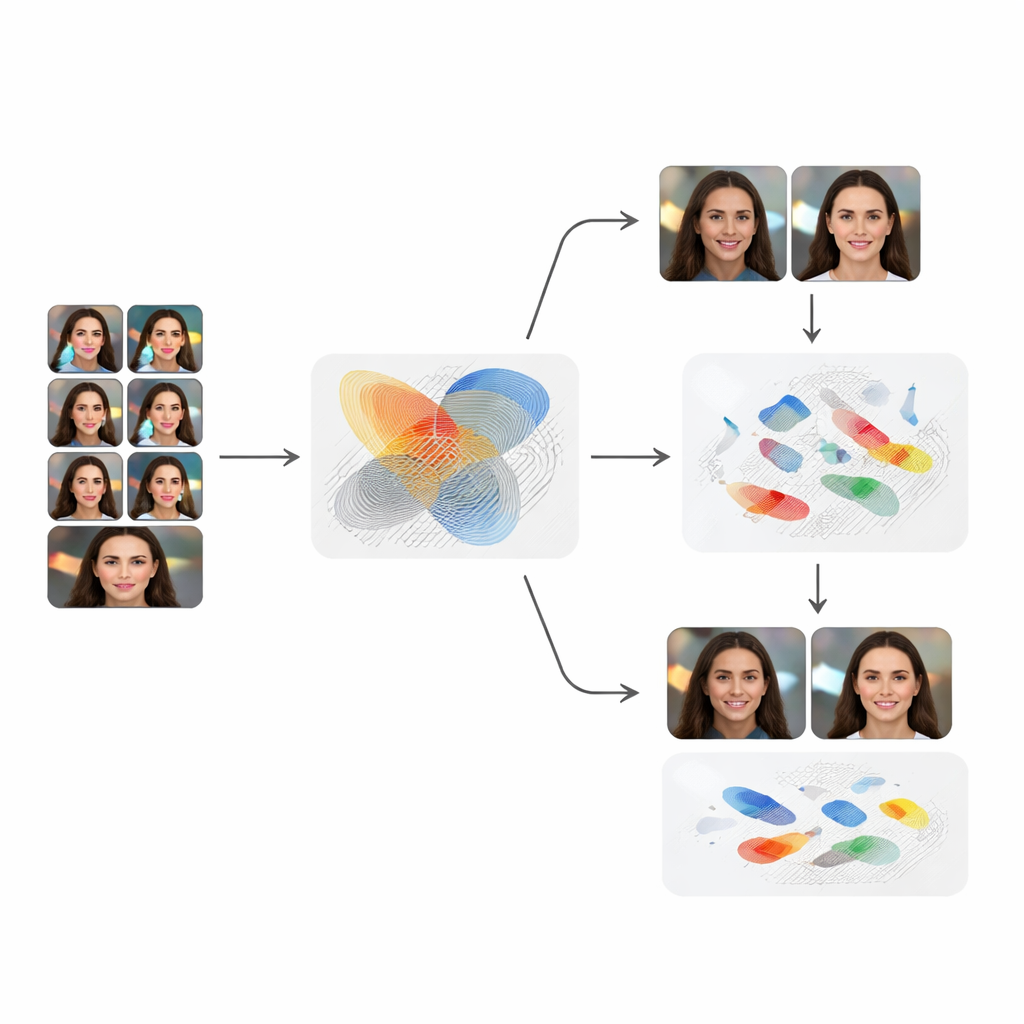

Die erste Ebene ist ein Aufmerksamkeitsmodell, das lernt, welche Bereiche eines Videos über die Zeit die bedeutsamsten Bewegungen und Details tragen. Das Team trainiert ein kompaktes, aber leistungsfähiges Netzwerk an Tausenden alltäglicher Clips mit Menschen bei Handlungen. Ein Teil des Netzwerks betrachtet jeden Frame wie ein Standbild, während ein anderer analysiert, wie sich Dinge über 16‑Frame‑Schnipsel hinweg bewegen. Zusammen erreichen sie auf einem Standard‑Test zur Aktionserkennung über 97 % Genauigkeit, was zeigt, dass das System reiche Muster dafür gelernt hat, wie Menschen und Szenen sich zeitlich verändern. Diese Muster werden dann in Aufmerksamkeitskarten umgewandelt, die Regionen hervorheben, in denen jede Manipulation die Erzählung des Videos am stärksten beeinflussen würde.

Ein geheimes Zeichen dort verstecken, wo Fälscher den größten Schaden anrichten

Als Nächstes wird in jeden Frame ein unsichtbares digitales Zeichen — ein Wasserzeichen — eingebettet, jedoch nicht gleichmäßig. Ein generatives Netzwerk erzeugt ein subtil Rauschen ähnliches Muster, das in den vom Aufmerksamkeitsmodell als wichtig markierten Bereichen wie Gesichtern oder bewegten Händen stärker eingemischt wird und anderswo schwächer, um die visuelle Qualität zu erhalten. Zuschauer bemerken keinen Unterschied, und Qualitätsbewertungen bestätigen, dass die markierten Frames kaum vom Original zu unterscheiden sind. Gleichzeitig ist das Muster stark und komplex genug, dass ein Begleitnetzwerk, das als Decoder trainiert wurde, später die versteckte Signatur aus echtem Material Frame für Frame wiederherstellen kann.

Deepfakes und alltägliche Verzerrungen auf die Probe stellen

Um zu prüfen, ob dieser Schutz in der realen Welt standhält, führen die Autorinnen und Autoren eine Reihe von Stresstests durch. Zunächst werden verschiedene kurze Stock‑Videos watermarkt und dann in DeepFaceLab, eines der am weitesten verbreiteten Face‑Swap‑Tools, eingespeist, um überzeugende Deepfakes zu erzeugen. In allen 50 manipulierten Clips wird das versteckte Zeichen entweder zerstört oder stark verfälscht, und das System erkennt korrekt, dass das Video manipuliert wurde. Die Methode hält auch gängigen Verarbeitungsschritten wie starker Neukompression, Größenänderung und Unschärfe stand, wie sie beim Teilen von Clips online häufig auftreten, obwohl sehr starkes zufälliges Rauschen das versteckte Signal schließlich überdecken kann. Sorgfältige Experimente zeigen, dass sowohl die Aufmerksamkeitslenkung als auch die Nutzung von Bewegung über die Zeit entscheidend sind; das Entfernen einer dieser Komponenten schwächt den Schutz deutlich.

Vertrauen festschreiben mit einem dauerhaften Fingerabdruck

Die letzte Ebene geht über den Inhalt der Frames hinaus und sichert die Videodatei selbst. Nach dem Watermarking wird die vollständige Datei durch eine kryptografische Funktion geführt, die einen kurzen digitalen Fingerabdruck erzeugt. Dieser Fingerabdruck sowie grundlegende Informationen über den Clip werden in ein Blockchain‑Ledger geschrieben, das nicht verändert werden kann, ohne Spuren zu hinterlassen. Später kann jeder eine Kopie des Videos hochladen: Das System versucht, das Wasserzeichen wiederherzustellen und berechnet außerdem den Fingerabdruck neu. Stimmen sowohl das versteckte Zeichen als auch der kryptografische Fingerabdruck mit den Originaleinträgen überein, kann das Video mit hoher Sicherheit als authentisch angesehen werden; fällt einer von beiden aus, wissen Betrachter, dass das Material verändert wurde.

Was das für die Videos bedeutet, die Sie sehen

Vereinfacht gesagt zeigt diese Arbeit, dass wir vom Raten, ob ein Video gefälscht ist, zu dem Beweis übergehen können, dass ein Video echt ist. Indem wir intelligent und schwer zu fälschende Zeichen in die bedeutendsten Bereiche jedes Frames einweben und diese zusätzlich mit einem manipulationssicheren Ledger‑Eintrag absichern, fängt das Rahmenkonzept alle getesteten Face‑Swap‑Angriffe ab und übersteht viele alltägliche Verzerrungen. Zwar gerät es unter extremem visuellen Rauschen an seine Grenzen und bedarf noch breiterer Tests, doch es weist in Richtung einer Zukunft, in der Kameras, Plattformen und Redaktionen Videos mit eingebautem Echtheitsnachweis ausliefern — sodass es für Deepfakes deutlich schwerer wird, als Wahrheit durchzugehen.

Zitation: Hajjej, F., Hamid, M. & Alluhaidan, A.S. An integrated framework for proactive deepfake mitigation via attention-driven watermarking and blockchain-based authenticity verification. Sci Rep 16, 9545 (2026). https://doi.org/10.1038/s41598-026-40166-6

Schlüsselwörter: Deepfake‑Schutz, Video‑Echtheit, digitale Wasserzeichen, Blockchain‑Verifizierung, Medien‑Sicherheit