Clear Sky Science · de

Ensemble-Maschinenlernstrategien zur Kartierung der Mineralvorkommen bei Datenknappheit

Erz finden mit wenigen Hinweisen

Die moderne Gesellschaft ist auf Metalle wie Blei und Zink für Batterien, Elektronik und Infrastruktur angewiesen, doch die leicht zugänglichen Lagerstätten sind bereits weitgehend entdeckt. In neuen Regionen verfügen Geologen oft nur über eine Handvoll bestätigter Funde, verstreute chemische Proben und lückenhafte Karten. Diese Studie zeigt, wie maschinelles Lernen so eingesetzt werden kann, dass es nicht nur den höchstmöglichen Score auf historischen Daten maximiert, sondern Vorhersagen liefert, denen Entscheidungsträger tatsächlich vertrauen können, wenn Informationen knapp sind.

Warum Daten in der Praxis dünn gesät sind

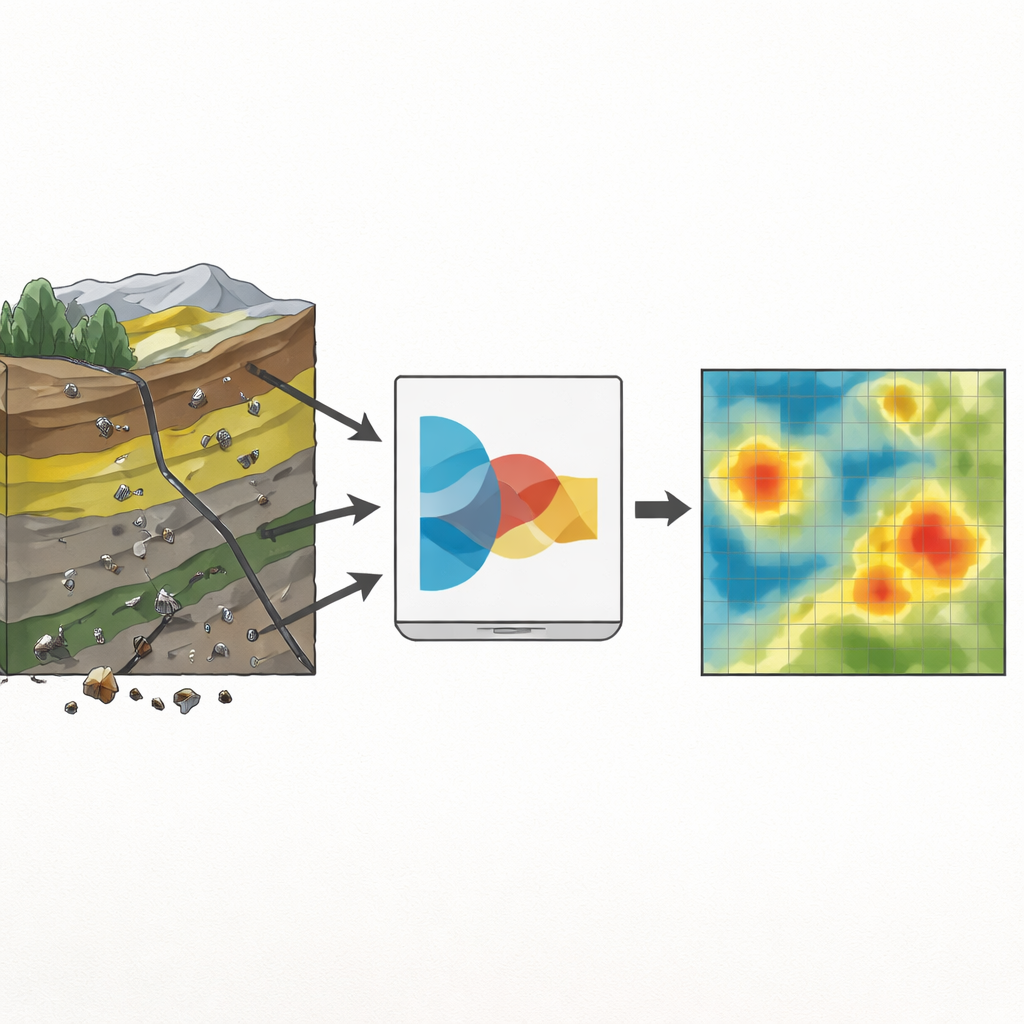

Die Kartierung der Mineralvorkommen zielt darauf ab, Landesteile hervorzuheben, die eher Erz enthalten könnten. Dabei werden Informationsschichten wie Gesteinsarten, Verwerfungen, Satellitenbilder und die Chemie von Flusssedimenten zu einer Wahrscheinlichkeitskarte kombiniert, die Feldarbeit und Bohrungen leitet. In frühen Projektphasen sind jedoch oft nur wenige Vorkommen bekannt und viele Bereiche der Karte wurden nie beprobt. Standardverfahren des maschinellen Lernens gedeihen bei großen, gut etikettierten Datensätzen; wenn nur einige Dutzend positive Beispiele vorliegen, können sie instabil und übermäßig zuversichtlich werden und Werte liefern, die präzise erscheinen, aber kaum mit der Realität übereinstimmen.

Aus spärlichen Hinweisen brauchbare Signale machen

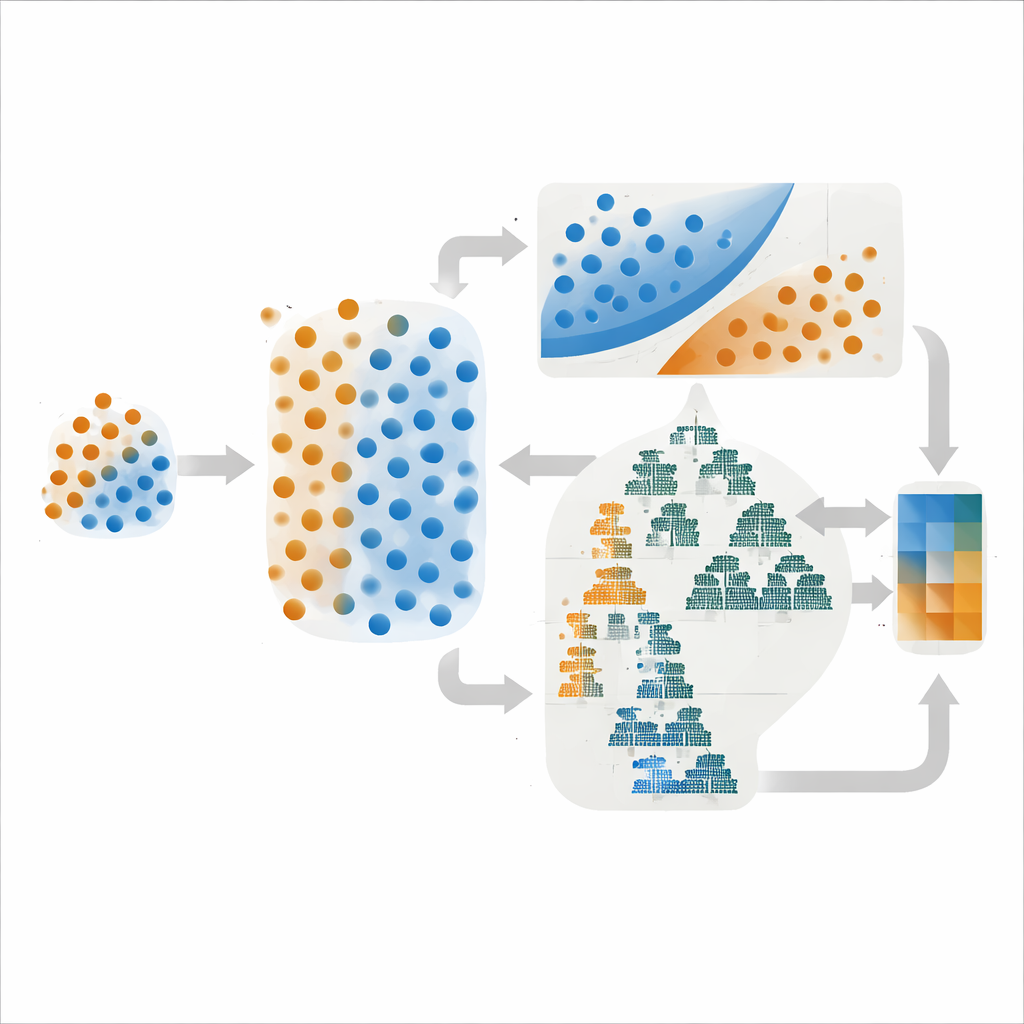

Die Autoren arbeiteten im Dehaq-Blei-Zink-Bezirk in Zentraliran, einer Gegend, in der Mineralisationen an bestimmte Kalksteinschichten, Verwerfungen und Zonen chemischer Alteration gebunden sind. Sie erstellten digitale Karten von Wirtsgesteinen, Bruchdichte und Alteration aus geologischen Aufnahmen und Satellitenbildern und extrahierten geochemische Anomalien aus 624 Sedimentproben. Aus dieser reichen, aber ungleichmäßigen Evidenz destillierten sie nur 108 bezeichnete Standorte: 27 mit bekannten Lagerstätten und 81 ohne. Um zu verhindern, dass die Mehrheitsklasse die wenigen Erzbeispiele überwältigt, verwendeten sie eine Technik, die realistische synthetische Lagerstättenpunkte erzeugt, indem sie zwischen bestehenden Punkten interpoliert und die Klassen nur innerhalb der Trainingsdaten ausgleicht. Dadurch entstand ein ausgewogeneres Beispielsatz, während separate Validierungs- und Testsets erhalten blieben, die die reale Seltenheit widerspiegeln.

Teams von Modellen statt eines Einzelkämpfers

Statt sich auf einen einzigen Algorithmus zu verlassen, kombinierten die Autoren Methoden mit unterschiedlichen Stärken. Ein Ensemble verband eine Support-Vektor-Maschine, die die schärfstmögliche Grenze zwischen Klassen zieht, mit einem einfachen probabilistischen Modell namens Gaussian Naive Bayes. Das andere mischte zwei baumbasierte Methoden, LightGBM und AdaBoost, die hervorragend darin sind, komplexe Muster in vielen Variablen zu erfassen. In beiden Fällen war die Endvorhersage ein Mittelwert der Wahrscheinlichkeitsschätzungen der Komponentenmodelle — eine Strategie, die oft extreme Leistungsschwankungen reduziert. Entscheidenderweise verglichen die Autoren nicht nur, wie oft diese Modelle richtig lagen, sondern auch, wie gut ihre vorhergesagten Wahrscheinlichkeiten mit der Realität übereinstimmen — eine Eigenschaft, die als Kalibrierung bezeichnet wird.

Auf Vertrauen statt nur auf Score abstimmen

Die Wahl der Modellparameter — wie stark Fehler bestraft werden, wie viele Bäume erzeugt werden usw. — kann das Verhalten eines Modells stark verändern. Das Team testete drei gängige Abstimmungsstrategien: Grid Search, das systematisch ein festes Menü von Optionen durchscannt; Random Search, das Kombinationen zufällig auswählt; und Bayessche Optimierung, die frühere Versuche nutzt, um vielversprechende neue Kandidaten zu vermuten. Auf dem Papier lieferte die Bayessche Optimierung für das support‑vektor‑basierte Ensemble den höchsten Diskriminationswert (ein ROC–AUC von 0,95). Doch bei Betrachtung der Kalibrierungskurven, die vorhergesagte Wahrscheinlichkeiten mit tatsächlichen Ergebnissen vergleichen, erzeugten die Grid-Search-Versionen beider Ensembles glattere, stabilere Resultate, insbesondere im mittleren Wahrscheinlichkeitsbereich, in dem üblicherweise Explorations-Schwellen gesetzt werden.

Von Zahlen zu Entscheidungen im Feld

Für die frühe Exploration, bei der jede Bohrung teuer ist, argumentieren die Autoren, dass gut verhaltene Wahrscheinlichkeiten wichtiger sind als das Herausholen eines kleinen Genauigkeitsvorteils. Ihre praktischste Empfehlung ist das einfachere Support‑Vektor‑plus‑Bayes‑Ensemble, das mit Grid Search abgestimmt wurde. Es erreicht eine starke Diskriminierung und bietet zugleich die verlässlichste Verbindung zwischen Wahrscheinlichkeitswerten und realen Entdeckungsraten, sodass Geologen Schwellenwerte festlegen können, die ihrer Risikotoleranz entsprechen. Wenn Projekte reifen und mehr Daten anfallen, können komplexere baumbasierte Modelle wie das LightGBM-Ensemble eingeführt werden, um Vorhersagen zu verfeinern — stets mit Blick auf die Kalibrierung. Auf diese Weise wird maschinelles Lernen nicht zu einem Black‑Box‑Punktesystem, sondern zu einem transparenten Partner bei risikobewussten Entscheidungen darüber, wo nach der nächsten Generation an Mineralressourcen gesucht werden soll.

Zitation: Amirajlo, P., Hassani, H., Pour, A.B. et al. Ensemble machine learning strategies for mineral prospectivity mapping under data scarcity. Sci Rep 16, 9171 (2026). https://doi.org/10.1038/s41598-026-40125-1

Schlüsselwörter: Kartierung von Mineralvorkommen, Ensemble-Maschinenlernen, Datenknappheit, Modellkalibrierung, Mineralerkundung