Clear Sky Science · de

Die Auswirkungen generativer KI auf soziale Medien: eine experimentelle Studie

Warum das für Ihr Online-Leben wichtig ist

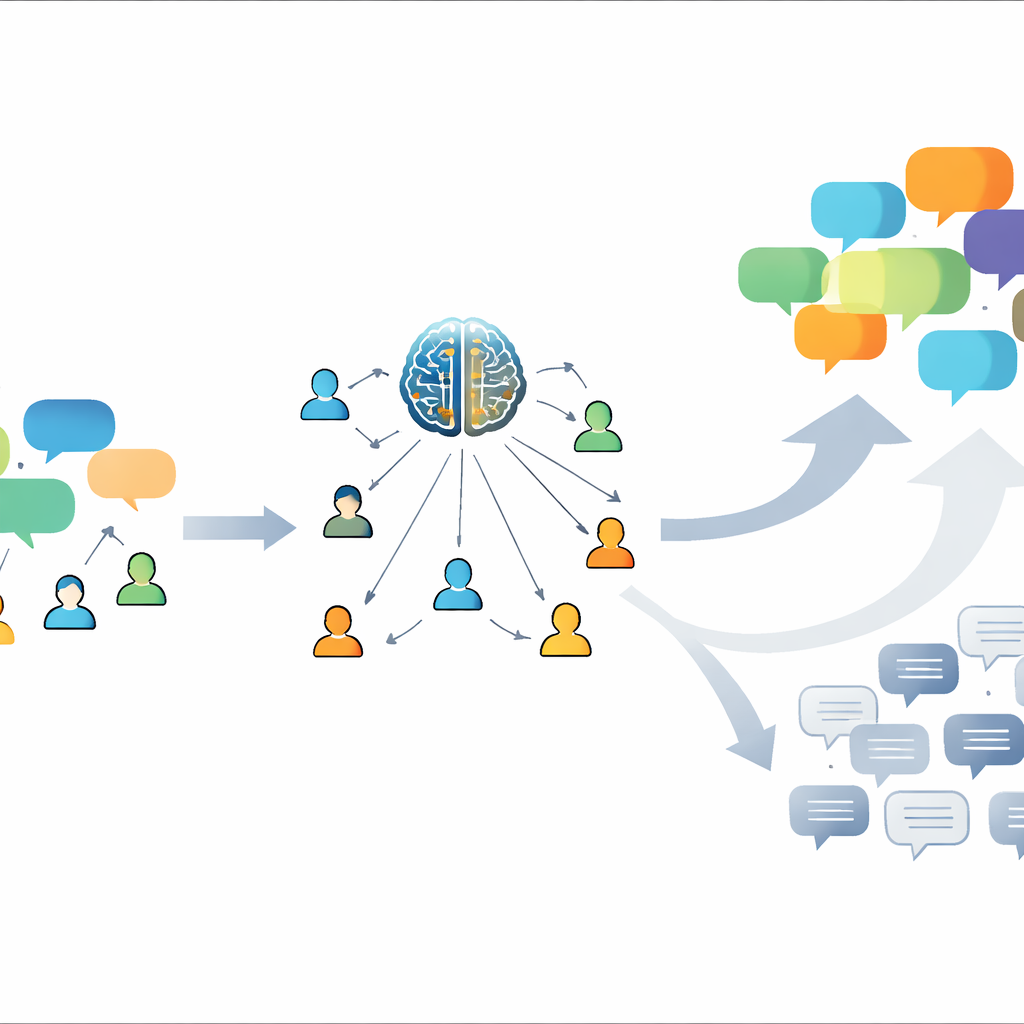

Immer mehr von dem, was wir täglich in sozialen Medien lesen und schreiben, wird im Stillen von künstlicher Intelligenz mitgeformt. Diese Studie stellt eine Frage, die alle betrifft, die posten, kommentieren oder scrollen: Wenn KI Menschen beim Schreiben unterstützt, machen die Gespräche das besser — oder nur lauter? Indem die Forschenden einen diskussionsähnlichen Social-Media-Raum mit Hunderten alltäglicher Nutzerinnen und Nutzer nachbildeten, zeigen sie, dass KI-Tools mehr Menschen in die Diskussion ziehen können – zugleich aber diese Unterhaltungen generischer, weniger vertrauenswürdig und weniger menschlich wirken lassen können.

Aufbau einer realistischen Online-Diskussion

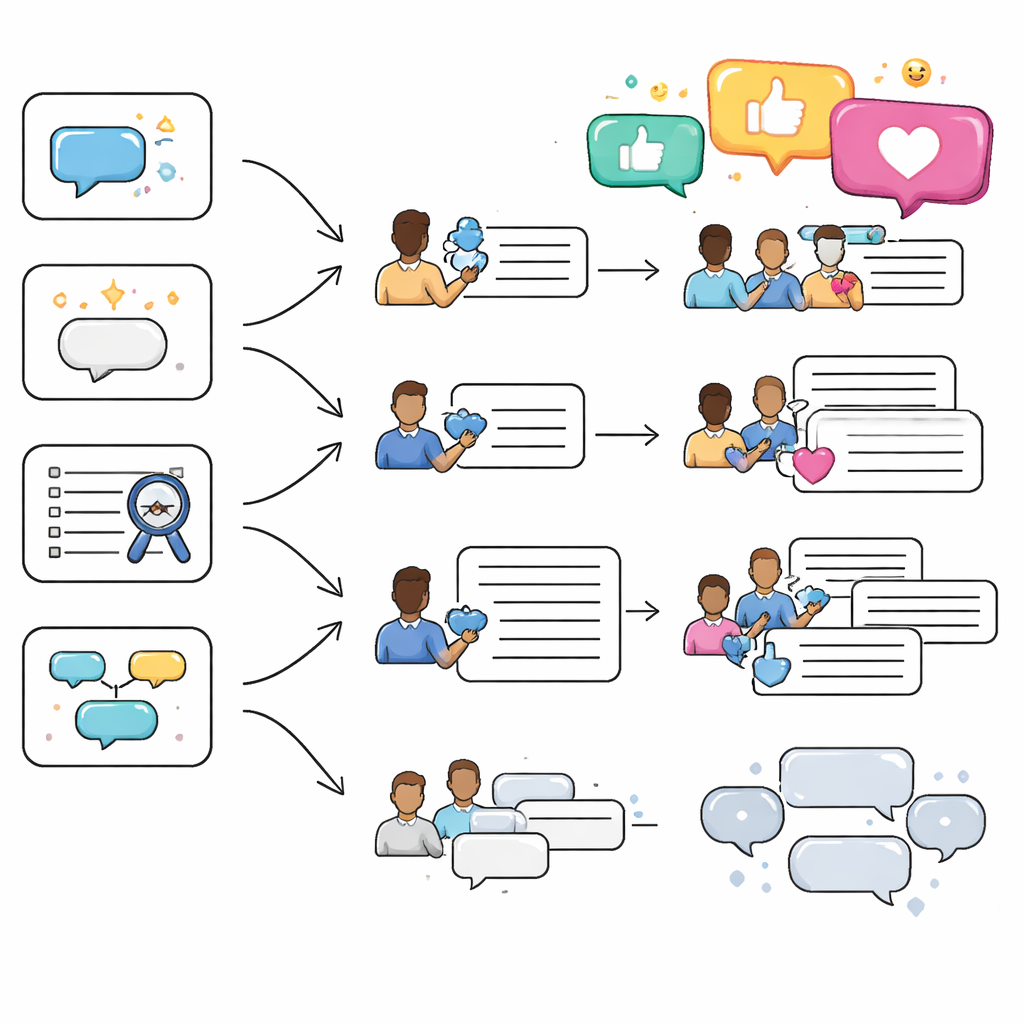

Um diese Fragen zu untersuchen, bauten die Forschenden eine eigene Diskussionsplattform, die an gängige Foren angelehnt war. 680 Erwachsene aus den ganzen Vereinigten Staaten wurden in Kleingruppen zu jeweils fünf Personen eingeteilt und gebeten, drei Arten von Themen zu debattieren: ein leichtes (Katzen gegen Hunde), ein naturwissenschaftlich geprägtes (Gesundheitsvorteile von Hafer) und ein politisches (universelles Grundeinkommen). Einige Gruppen erhielten keinerlei technische Hilfe. Andere nutzten eines von vier verschiedenen KI-Tools: einen offenen Chat-Assistenten, kurze KI-erstellte Gesprächseinstiege, Vorschläge für Antworten oder Feedback zu selbst verfassten Entwürfen. Dieses Design erlaubte den Forschenden, zu vergleichen, wie sich Menschen mit und ohne KI-Unterstützung verhielten und wie sie die Diskussionen einschätzten.

Mehr Stimmen und längere Beiträge, aber gemischte Gefühle

Auf einer Ebene taten die KI-Tools genau das, was sich Designer erhoffen könnten. Teilnehmende mit KI-Unterstützung verfassten mehr und längere Kommentare als diejenigen in den Kontrollgruppen. Manche Werkzeuge förderten außerdem eine breitere Beteiligung, sodass die Diskussion weniger von ein oder zwei Personen dominiert wurde. Beispielsweise halfen KI-generierte Einstiegsprompts ruhigeren Nutzenden, sich einzubringen, und der Chat-Assistent machte viele Menschen eher bereit zu posten, indem er Ideen, Fakten oder Formulierungen lieferte, wenn sie nicht wussten, was sie sagen sollten.

Wenn Hilfreiches hohl wird

Aus der Perspektive der Lesenden veränderte sich das Bild jedoch. In den meisten KI-Bedingungen bewerteten die Menschen das Gesehene als weniger informativ und von geringerer Qualität als in rein menschlichen Diskussionen. Sie reagierten mit mehr „Nicht mögen“-Angaben und beschrieben viele KI-beeinflusste Kommentare als „robotisch“ oder „generisch“. Während Antwortvorschläge mitunter geschätzt wurden, ließen andere Werkzeuge das Gefühl aufkommen, der Ton der Diskussion sei weniger authentisch geworden. Selbst diejenigen, die die KI nicht selbst nutzten, konnten ihre Präsenz spüren, sobald sie in einen Thread eingeführt wurde, weil sie den Gesamtstil hin zu längeren, aber weniger bedeutungsvollen Antworten lenkte — eine Art „semantischer Müll“, der den Raum verstopft, ohne viel Substanz beizutragen.

Wie die Menschen die Werkzeuge tatsächlich nutzten

Ein genauer Blick auf das Verhalten zeigte, dass Teilnehmende nicht alle KI-Hilfen gleichbehandelten. Der Chat-Assistent wurde breit genutzt, insbesondere zur Faktenprüfung beim wissenschaftlichen Thema und zum Erproben von Argumenten beim politischen Thema. Feedback zu Entwürfen wurde angenommen, wenn die Einsätze höher erschienen — etwa bei Gesundheits- oder politischen Fragestellungen — und führte oft dazu, dass Struktur und Argumentation gestärkt wurden. Gesprächseinstiege senkten die Hürde für eine Beteiligung, wurden aber genauso häufig ignoriert, wenn sie nicht zur Absicht der Nutzenden passten. Antwortvorschläge wurden moderat genutzt und in kontroversen Themen zogen die Teilnehmenden Vorschläge, die zustimmten, deutlich denen vor, die widersprachen, was andeutet, dass KI Diskussionen eher in sichere, weniger konfrontative Bahnen lenken könnte.

Design-Lehren für eine menschlichere Online-Zukunft

Aus diesen Experimenten folgern die Autorinnen und Autoren, dass der Weg nach vorn nicht darin besteht, KI in sozialen Medien grundsätzlich abzulehnen, sondern sie sorgfältiger zu gestalten. Menschen schätzten KI als optionalen Helfer, besonders zum Brainstorming, zur Informationsprüfung und zur Überwindung von „Schreibblockaden“, verlangten aber Werkzeuge, die persönlicher wirkten und besser auf das Thema sowie die eigene Stimme abgestimmt waren. Die Forschenden empfehlen klare Kennzeichnung, wenn Text direkt von KI übernommen wurde, intelligentere Personalisierung, die sich an einzelne Nutzende anpasst, kontextbewusstes Verhalten, das den Ton zwischen locker, wissenschaftlich und politisch verlagert, sowie einfache, vertraute Schnittstellen. Ohne solche Schutzmechanismen, warnen sie, laufen Plattformen Gefahr, öffentliche Räume mit glatt wirkendem, aber oberflächlichem Geplänkel zu füllen, das Vertrauen untergräbt. Mit ihnen könnte KI stattdessen Barrieren für die Teilnahme senken und inklusivere, nachdenklichere Gespräche unterstützen, die weiterhin so klingen und sich so anfühlen, als kämen sie von echten Menschen.

Zitation: Møller, A.G., Romero, D.M., Jurgens, D. et al. The impact of generative AI on social media: an experimental study. Sci Rep 16, 9376 (2026). https://doi.org/10.1038/s41598-026-40110-8

Schlüsselwörter: soziale Medien, generative KI, Online-Diskussion, Authentizität, Mensch-Computer-Interaktion