Clear Sky Science · de

Tief probabilistische Befahrbarkeit mit Testzeit‑Anpassung für unsicherheitsbewusste Planetenerkundungs‑Rovernavigation

Warum sicheres Rover‑Fahren wichtig ist

Wenn wir Radroboter zum Mond oder Mars schicken, müssen sie selbstständig über Sand, Felsen und Hänge fahren können. Eine einzige falsche Einschätzung darüber, wie weich der Boden ist, kann einen Milliarden-Dollar‑Rover für immer festsetzen – wie es geschah, als NASAs Opportunity‑Rover wochenlang in geripptem Sand steckenblieb. Diese Studie stellt einen neuen Ansatz vor, mit dem Rover das Risiko des vorausliegenden Bodens „fühlen“ können, sicherere Routen wählen und sich während der Fahrt aus Fehlschlägen lernen können.

Weicher Boden als versteckte Gefahr

Auf anderen Himmelskörpern sind die gefährlichsten Hindernisse nicht immer Felsblöcke oder Klippen, die Kameras leicht erfassen können, sondern trügerisch glatte Flächen mit lockerem Boden. Drehen die Räder des Rovers in solchem Terrain durch, rutscht das Fahrzeug, kriecht deutlich langsamer als befohlen voran, verliert Energie und kann dauerhaft bewegungsunfähig werden. Traditionelle Navigationssysteme konzentrieren sich vor allem auf sichtbare geometrische Gefahren – was wie ein Hindernis aussieht und was nicht – und erfassen nicht vollständig, wie sich der Boden unter den Rädern verhalten wird. Zugleich können maschinelle‑Lern‑Methoden, die Schlittern aus Bildern und 3D‑Karten vorhersagen, in unbekannten Bedingungen falsch liegen, etwa bei neuer Beleuchtung oder steileren Hängen, und sie geben meist nicht an, wie sicher ihre Vorhersagen sind.

Dem Rover beibringen, über Risiko nachzudenken

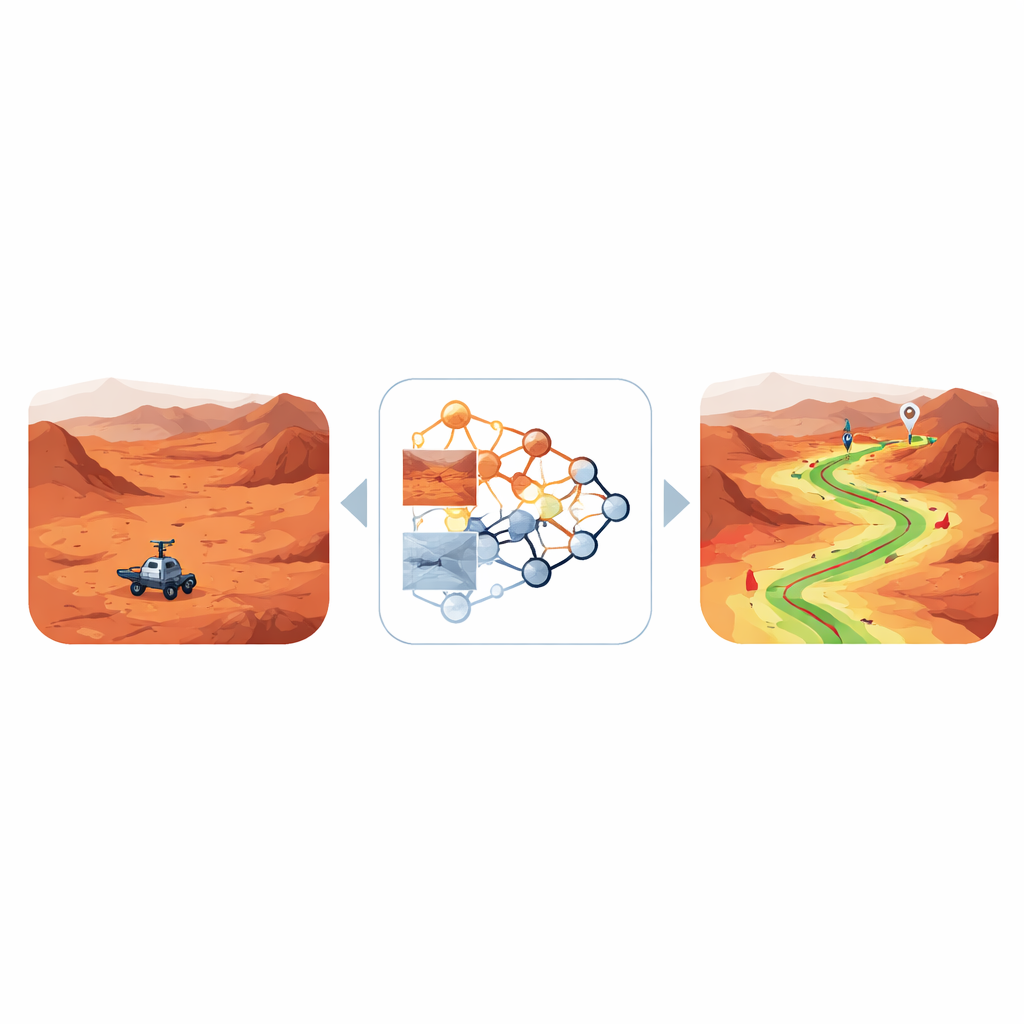

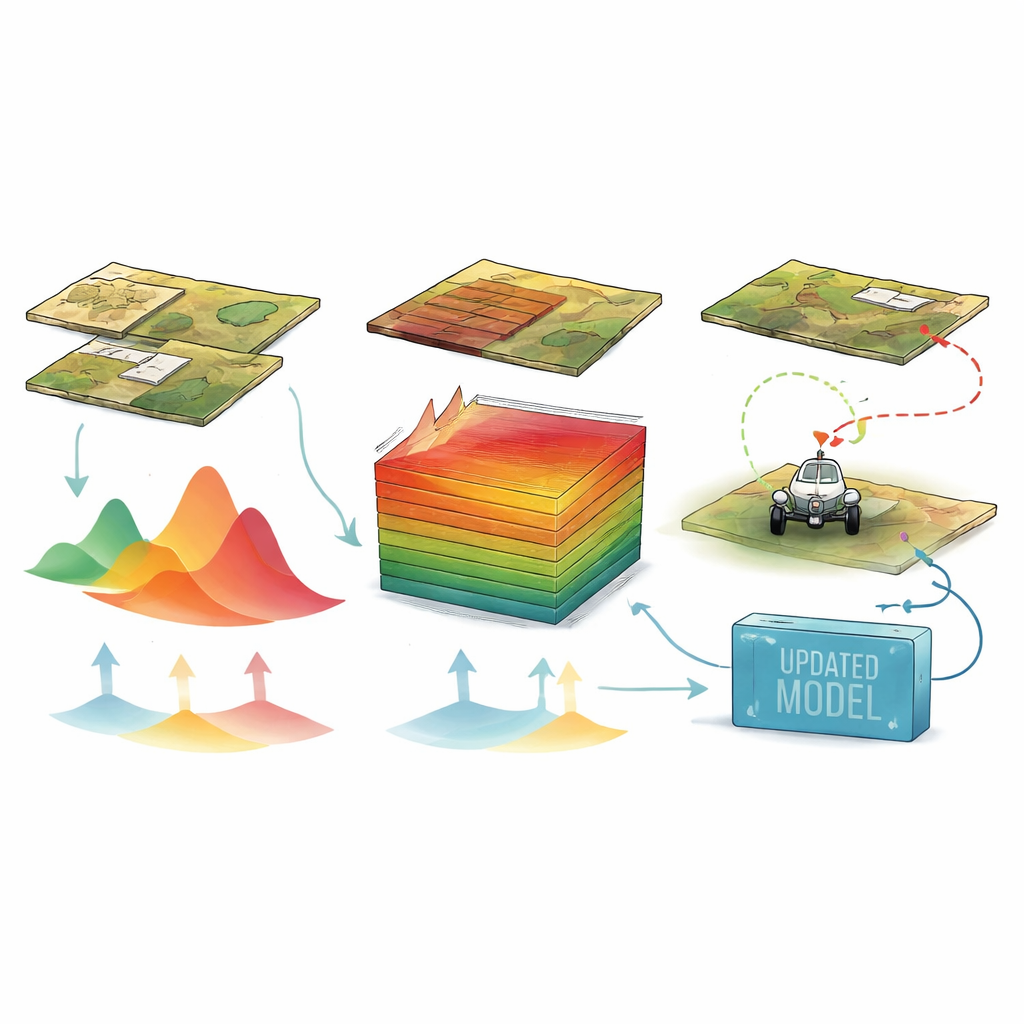

Die Autorinnen und Autoren schlagen ein integriertes Lern‑ und Planungsframework vor, das sie „tief probabilistische Befahrbarkeit“ nennen. Anstatt für jeden Bodensektor eine einzelne „beste Schätzung“ des Raddurchrutschens auszugeben, sagt ihr Modell eine vollständige Wahrscheinlichkeitsverteilung möglicher Schlupfwerte voraus, basierend auf Farbbildern und der lokalen Neigung. Ein Ensemble tiefer neuronaler Netze betrachtet die Landschaft von oben und liefert für jede mögliche Bewegung auf einem Gitter sowohl einen erwarteten Schlupfwert als auch dessen Unsicherheit. Aus dieser Verteilung übersetzt das System den Schlupf in eine effektive Fahrgeschwindigkeit und letztlich in eine Reisezeitkostenfunktion für jeden Schritt. Bereiche, in denen der Rover wahrscheinlich steckenbleibt, erhalten sehr hohe Kosten; Gebiete, in denen die Vorhersage günstig und sicher ist, niedrige Kosten. Ein Standard‑Pfadsuchalgorithmus findet dann eine Route, die Distanz gegen das geringe Risiko der Immobilisierung abwägt.

Den Rover unterwegs lernen lassen

Eine große Herausforderung in der Planetenerkundung ist, dass die Bedingungen bei Ankunft erheblich von denen in den Trainingsdaten abweichen können: Hänge können steiler sein, Bodenbeschaffenheiten ungewohnt oder die Beleuchtung sehr unterschiedlich. Um damit umzugehen, enthält das Framework einen Testzeit‑Anpassungsmechanismus. Während der Rover fährt, misst er den tatsächlich erlebten Schlupf. Nach jeder kurzen Bewegung werden diese frischen Messungen genutzt, um zusätzliche „Skalierungs‑ und Verschiebungs“-Schichten in den neuronalen Netzen sanft anzupassen, während die ursprünglichen Gewichte unverändert bleiben. Diese Strategie erlaubt dem Modell, sich schnell an neue Gelände mit nur wenigen Beobachtungen anzupassen und zugleich das bereits Gelernte über zuvor gesehene Bedingungen zu bewahren. Aktualisierte Vorhersagen fließen dann in die Neuplanung ein, sodass die gewählte Route sich im Betrieb verbessern kann.

Das System harten Tests unterziehen

Da reale Roverdaten nur begrenzte Geländetypen abdecken, erstellte das Team einen großen synthetischen Datensatz mit marsähnlichen Landschaften. Sie kombinierten computergenerierte, raue Topografie mit zehn versteckten Geländeklassen, jede mit eigener Farbe und Schlupfverhalten, und variierten sowohl Hangneigung als auch Beleuchtungsrichtung, um vertraute und unbekannte Szenarien zu erzeugen. In Tausenden simulierten Missionen wurde die neue Methode gegen zwei hochmoderne Planer verglichen, die Unsicherheit entweder ignorieren oder weniger direkt nutzen. Unter vertrauten Bedingungen lieferten alle Ansätze ähnliche Ergebnisse. In den herausforderndsten Fällen – dunkle Beleuchtung und steiles, kraterähnliches Terrain – erreichte der tief probabilistische Befahrbarkeitsansatz jedoch höhere Erfolgsraten und geringeren maximalen Schlupf bei gleichzeitig konkurrenzfähigen Reisezeiten. Mit aktivierter Online‑Anpassung verringerte das System zusätzlich Vorhersagefehler und verbesserte die Sicherheit, besonders in stark von den Trainingsdaten abweichenden Umgebungen.

Was das für künftige Missionen bedeutet

Für den allgemeinen Leser lautet die Kernbotschaft, dass diese Arbeit Planetenerkundungsrovern eine vorsichtigere und selbstbewusstere Fahrweise auf tückischem Untergrund ermöglicht. Anstatt einer einzelnen Vorhersage über den Radgriff blind zu vertrauen, können Rover jetzt erwartetes Verhalten und Unsicherheit abwägen und Routen wählen, die schnell sind, aber kaum die Gefahr eines Festfahrens bergen. Indem sie kontinuierlich aus eigenen Schlupferfahrungen lernen, können sie sich an neuartige Sandarten, Hänge und Beleuchtung anpassen, ohne auf menschliche Rettung angewiesen zu sein. Da Raumfahrtagenturen längere und ambitioniertere Oberflächenmissionen planen, könnte eine solche unsicherheitsbewusste Navigation dazu beitragen, dass wertvolle Roboter mehr Zeit mit dem Erkunden neuer wissenschaftlicher Ziele verbringen und weniger Zeit damit, sich aus Schwierigkeiten zu befreien.

Zitation: Endo, M., Taniai, T. & Ishigami, G. Deep probabilistic traversability with test-time adaptation for uncertainty-aware planetary rover navigation. Sci Rep 16, 9499 (2026). https://doi.org/10.1038/s41598-026-40109-1

Schlüsselwörter: Navigation von Planetenerkundungsrovern, Geländebefahrbarkeit, unsicherheitsbewusste Planung, maschinelles Lernen Robotik, autonome Erkundung